Clear Sky Science · pt

Avaliação comparativa de modelos de reconhecimento de ações para detecção de autolesão em conjuntos de dados de estúdio e do mundo real

Vigilando os pacientes com olhos digitais

Em hospitais psiquiátricos, enfermeiros trabalham incansavelmente para manter os pacientes seguros, especialmente aqueles em risco de se ferirem. Ainda assim, mesmo a equipe mais dedicada não consegue vigiar todos os quartos em todos os segundos. Este estudo investiga se a inteligência artificial (IA) pode ajudar ao escanear automaticamente vídeos das câmeras da enfermaria para detectar sinais precoces de autolesão — oferecendo uma camada extra de proteção sem substituir o cuidado humano.

Por que a autolesão é tão difícil de detectar

Autolesão — qualquer ferimento intencional que uma pessoa inflige a si mesma — frequentemente acontece em momentos breves e ocultos: um arranhão rápido sob um cobertor, ou uma pequena ferramenta usada fora de vista. As enfermarias psiquiátricas dependem de rondas regulares e de vigilância por câmeras, mas pontos cegos, fadiga da equipe e quadro reduzido à noite ou em feriados tornam a vigilância constante impossível. Ao mesmo tempo, gravar e compartilhar imagens reais de pacientes levanta sérias preocupações de privacidade e ética. Como resultado, os pesquisadores têm tido muito poucos vídeos realistas para treinar sistemas de IA que poderiam detectar comportamentos perigosos em tempo real.

Construindo ambientes de teste mais seguros para IA

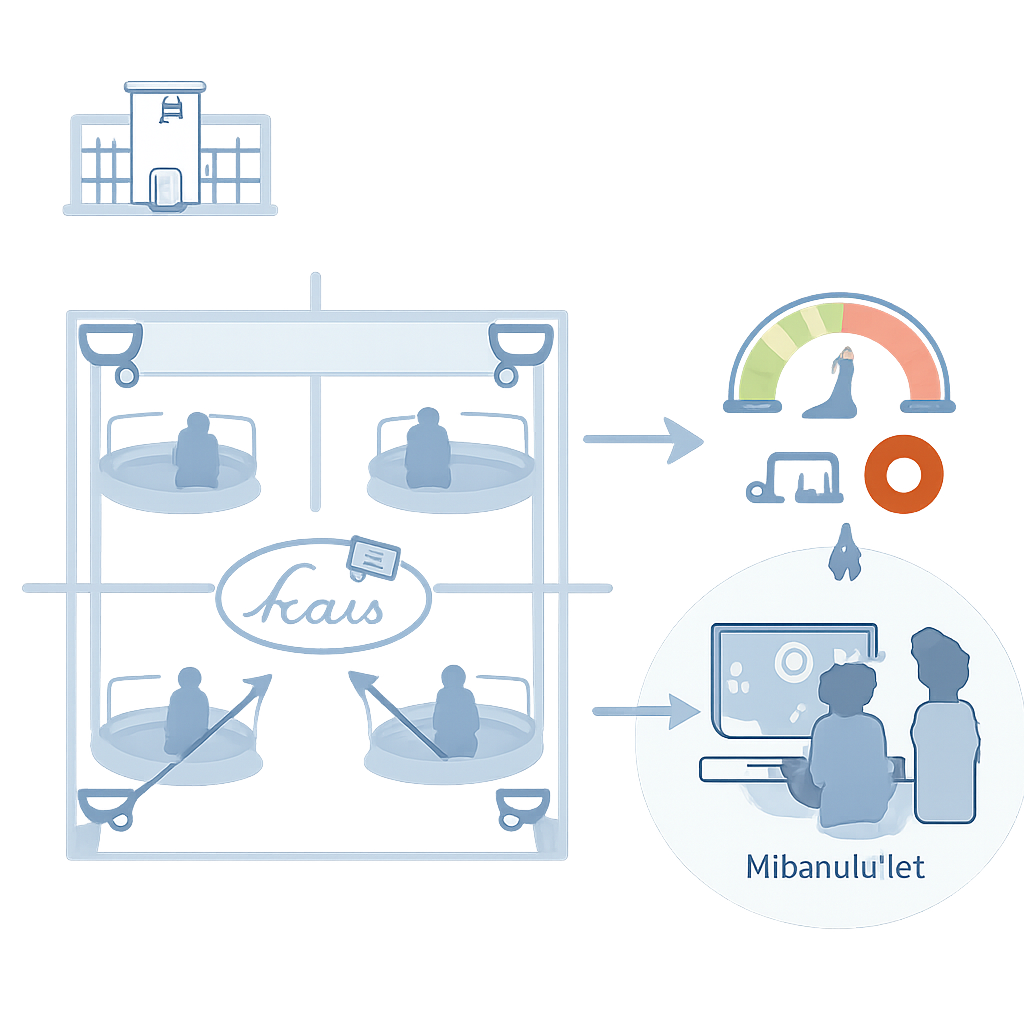

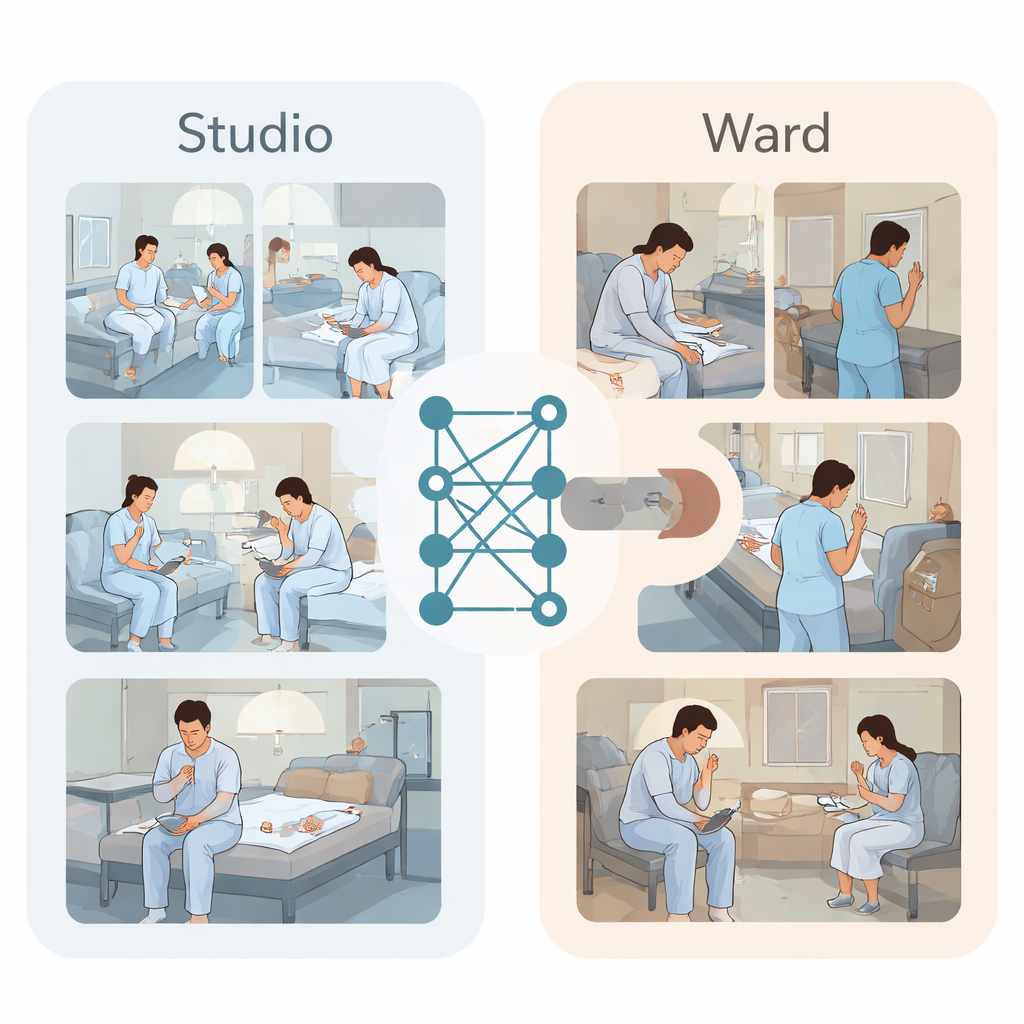

Para romper esse impasse, os pesquisadores criaram dois tipos de conjuntos de vídeo. Primeiro, em um estúdio montado para se assemelhar a um quarto psiquiátrico com quatro leitos, sete atores jovens em camisolas de paciente realizaram cenas cuidadosamente planejadas. Eles procuraram objetos cotidianos como tampas plásticas, tubos de protetor labial ou pequenos pregos, e então encenaram sequências curtas de movimentos autolesivos no pulso, antebraço ou coxa, com câmeras aéreas gravando de todos os cantos. Especialistas rotularam cada segmento de vídeo como comportamento normal ou autolesão, formando uma coleção limpa e balanceada de 1120 clipes. Em segundo lugar, a equipe reuniu filmagens reais de vigilância de enfermarias psiquiátricas seguras ao longo de dez meses. Clínicos consultaram prontuários em busca de anotações sobre comportamentos como coçar, cutucar ou cortar e então localizaram os vídeos correspondentes. Após desfocar rostos e remover detalhes identificáveis, eles montaram 59 clipes mostrando autolesão real e 59 clipes normais para comparação.

Testando a melhor IA de vídeo atual

Com esses conjuntos em mãos, a equipe avaliou sistemas líderes de reconhecimento de ações — programas de computador projetados para entender o que as pessoas fazem em um vídeo. Alguns eram baseados em redes convolucionais mais antigas, que analisam sequências curtas de quadros, enquanto modelos mais novos baseados em transformers usam mecanismos de atenção para conectar padrões no espaço e no tempo. Todos os modelos foram treinados apenas nos vídeos de estúdio para decidir se um clipe mostrava autolesão ou comportamento normal. Importante: os pesquisadores usaram um esquema de teste rigoroso — em cada rodada, todos os clipes de um ator foram mantidos fora como dados de teste completamente novos, garantindo que os algoritmos não pudessem simplesmente memorizar pessoas individuais.

Quando vídeos limpos de estúdio encontram a realidade confusa

No material limpo do estúdio, o modelo transformer mais avançado, chamado VideoMAEv2, sobressaiu. Ele equilibrou melhor falsos negativos e falsos positivos que os demais, alcançando uma pontuação F1 (uma medida combinada de precisão e recall) de cerca de 0,65, enquanto métodos mais simples ficaram perto do chute aleatório. Explicações visuais mostraram que esse modelo se concentrava fortemente no ponto em que uma ferramenta tocava a pele, em vez de se distrair com movimento de fundo. Mas quando os mesmos sistemas treinados foram aplicados às gravações reais da enfermaria — sem qualquer retreinamento — seu desempenho caiu. O VideoMAEv2 ainda se saiu melhor que o acaso, com uma pontuação F1 em torno de 0,61, porém teve dificuldade especialmente com comportamentos sutis como cutucar e coçar que nunca haviam aparecido nos dados simulados, e com pacientes pequenos, distantes da câmera ou parcialmente ocultos.

O que isso significa para a segurança do paciente

No conjunto, os resultados revelam uma clara lacuna de “simulação para realidade”. Sistemas de IA que parecem promissores em vídeos cuidadosamente encenados podem falhar quando confrontados com a desordem, ângulos estranhos e comportamentos variados da vida real hospitalar. A principal contribuição do estudo não é um produto de segurança finalizado, mas um ponto de partida: um conjunto de estúdio público e bem anotado, um conjunto de teste do mundo real coletado com cuidado e um benchmark transparente que mostra onde os métodos atuais quebram. Para leigos, a mensagem é direta: a IA já pode ajudar a destacar momentos suspeitos nas transmissões de vídeo das enfermarias, mas ainda não pode ser confiada como guardiã autônoma. Fechar essa lacuna exigirá dados de treinamento mais ricos e diversos e modelos mais inteligentes, desenvolvidos com privacidade, equidade e julgamento clínico em primeiro plano.

Citação: Lee, K., Lee, D., Ham, HS. et al. Benchmarking action recognition models for self-harm detection in studio and real-world datasets. Sci Rep 16, 6850 (2026). https://doi.org/10.1038/s41598-026-36999-w

Palavras-chave: detecção de autolesão, enfermarias psiquiátricas, reconhecimento de ações em vídeo, inteligência artificial na saúde, segurança do paciente