Clear Sky Science · pt

Inferência causal molda a pós-dição crossmodal na integração multissensorial

Como visões e sons posteriores reescrevem o que acabamos de vivenciar

Pense em quando você percebe que um amigo está chamando seu nome numa rua movimentada e, de repente, se dá conta de que ele já vinha gritando há um tempo. Dá a sensação de que a mente volta no tempo e reescreve o que você ouviu e viu há um momento. Este estudo investiga como o cérebro combina o que chega pelos olhos e ouvidos em uma janela temporal curta e mostra que visões e sons posteriores podem literalmente mudar o que acreditamos ter visto no passado.

Um truque estranho de flashes e bipes

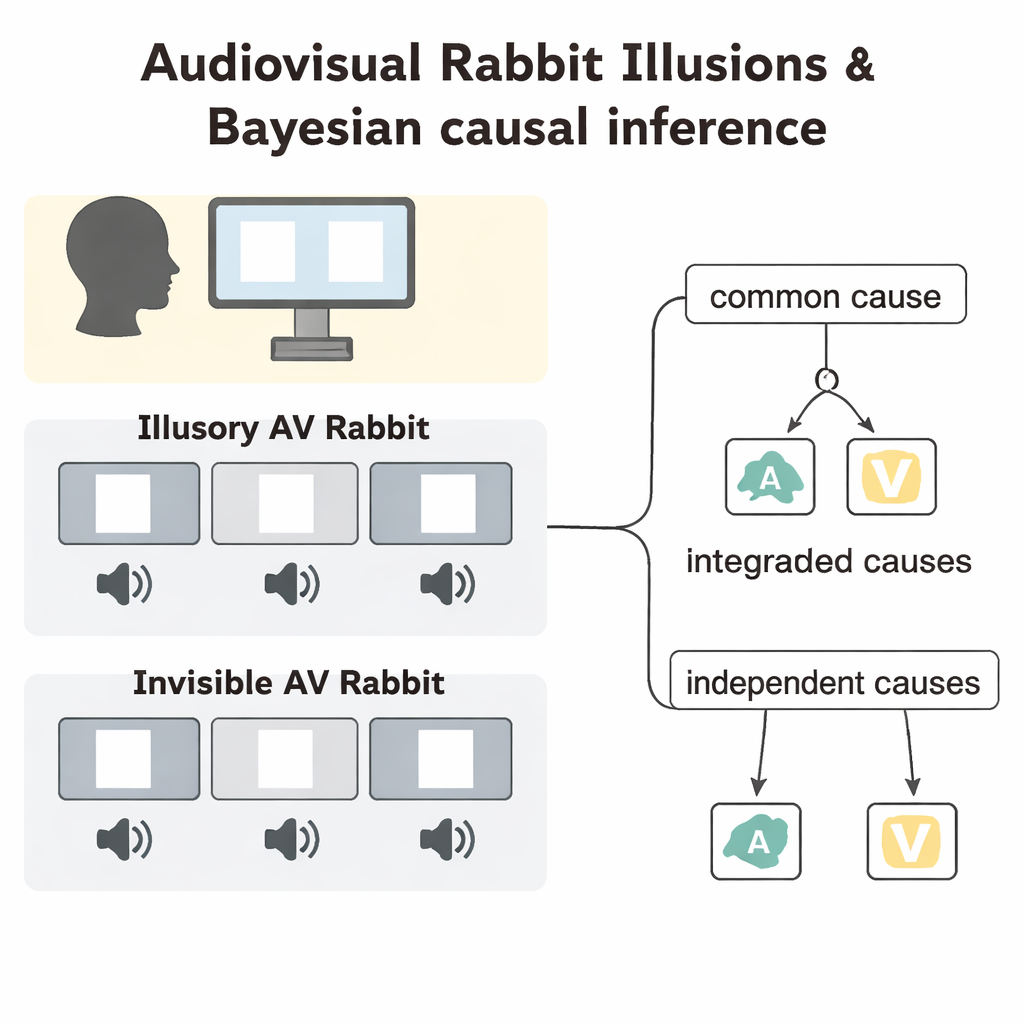

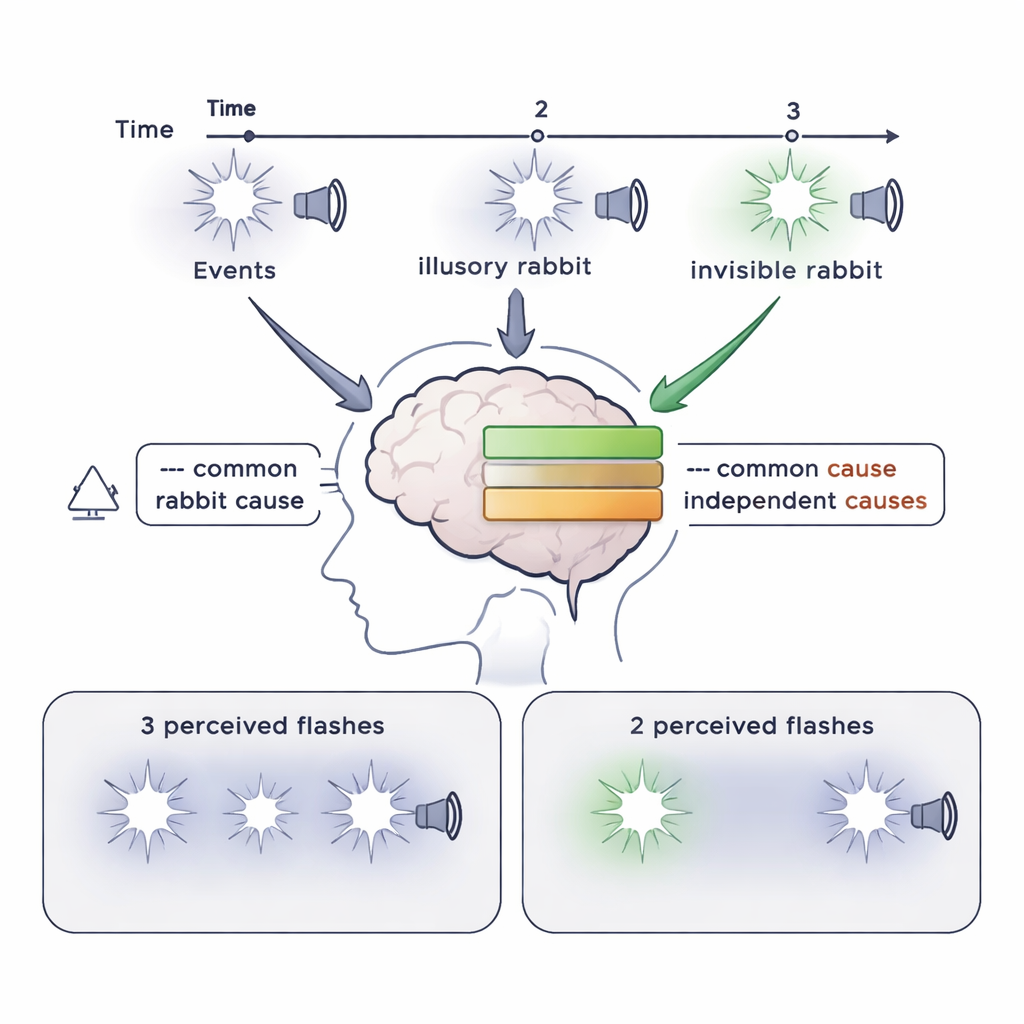

Os pesquisadores concentraram-se em duas ilusões curiosas chamadas “Coelho AV Ilusório” e “Coelho AV Invisível”. Nessas ilusões, flashes breves de luz na tela são pareados com bipes rápidos de um alto-falante. Às vezes falta um flash, mas há um bipe; em outras ocasiões há um flash sem bipe. Quando os flashes e bipes são organizados numa sequência específica e ocorrem próximos no tempo, as pessoas relatam com consistência ver um flash extra que nunca apareceu ou deixar de ver um flash que realmente esteve presente. De maneira crucial, o último par flash–bipe da sequência pode alterar como as pessoas percebem momentos anteriores, mostrando que a percepção não avança simplesmente no tempo, mas pode ser editada após o fato.

Testando como o cérebro escolhe uma única história

Para entender as regras ocultas por trás dessas ilusões, a equipe apresentou 28 condições cuidadosamente desenhadas a 28 voluntários. Os participantes foram instruídos a ignorar os sons e simplesmente relatar quantos flashes viram e onde apareceram em uma fila de cinco posições possíveis. As sequências de flashes podiam mover-se para a esquerda ou direita ou até mudar de direção, e os sons podiam estar perfeitamente sincronizados com os flashes ou deslocados por cerca de dois décimos de segundo. Esse desenho reduziu estratégias de adivinhação simples e permitiu aos pesquisadores investigar quando o cérebro combinaria visão e audição e quando os manteria separados. Eles então mediram com que frequência as pessoas relataram flashes ilusórios no meio (o “Coelho Ilusório”) ou deixaram de ver flashes reais no meio (o “Coelho Invisível”).

Quando o tempo se alinha, as ilusões predominam

Os resultados mostraram que os ensaios de ilusão produziram muito mais flashes ilusórios ou faltantes do que os ensaios de controle, nos quais os flashes apareciam isolados ou em combinações audiovisual mais simples. Quando flashes e bipes estavam perfeitamente alinhados no tempo, os participantes relataram as ilusões em cerca de 40% dos ensaios. Mas quando os sons antecediam ou atrasavam os flashes por 225 milissegundos, as taxas de ilusão caíram. Isso sugere que o cérebro possui uma “janela temporal multissensorial” limitada — de algumas centenas de milissegundos — dentro da qual está disposto a tratar visão e audição como parte do mesmo evento. Dentro dessa janela, eventos posteriores podem retroativamente alterar como flashes anteriores são percebidos; fora dela, o cérebro tende a tratar visão e audição como fluxos não relacionados.

Um cérebro que pondera causas como um estatístico

Para explicar esses achados, os autores compararam quatro modelos computacionais de como o cérebro poderia combinar informações sensoriais. O modelo-chave foi o de Inferência Causal Bayesiana (ICB), que assume que o cérebro se comporta um pouco como um estatístico: pesa expectativas prévias e evidência sensorial ruidosa para decidir se visão e audição provêm de uma única causa comum ou de causas separadas. Se uma causa comum for provável, o modelo funde flashes e bipes em um único evento, dando mais peso ao sentido mais confiável — neste caso, os bipes, nítidos e precisos. Três modelos alternativos ou sempre fundiam visão e som, ou sempre os mantinham separados, ou usavam inferência causal mas ignoravam o último par flash–bipe ao tomar a decisão, e assim não conseguiam capturar plenamente a pós-dição.

Por que a narrativa bayesiana é a que melhor se ajusta

O modelo ICB correspondeu melhor ao comportamento das pessoas em todas as condições. Reproduziu com precisão as altas taxas de ilusão nas condições-chave do coelho, as taxas mais baixas nos ensaios de controle e a queda nas ilusões quando flashes e bipes estavam dessincronizados. Importante, quando os pesquisadores removeram a influência do último par flash–bipe do cálculo causal, o modelo subestimou consistentemente com que frequência as ilusões ocorriam. Isso indica que o cérebro não constrói a percepção apenas a partir do primeiro evento para frente; em vez disso, acumula evidências ao longo de toda a sequência e então decide retrospectivamente qual é a narrativa mais provável. Quando o último par flash–bipe apoia fortemente uma causa compartilhada, o cérebro fica mais disposto a “preencher” um flash ausente ou apagar um flash fraco no meio.

O que isso significa para a percepção cotidiana

Na vida cotidiana, nossos sentidos estão constantemente inundados por visões e sons sobrepostos. Este trabalho sugere que o cérebro espera um curto momento, reúne informação de eventos passados, presentes e um pouco futuros, e então se fixa em uma interpretação coerente — às vezes à custa da precisão. O arcabouço da inferência causal bayesiana oferece uma explicação simples: nossos cérebros favorecem uma história única e plausível do que aconteceu, mesmo que isso signifique adicionar ou apagar detalhes após o fato. Em outras palavras, o que você pensa ter visto há uma fração de segundo pode ser discretamente reescrito pelo que você ouve ou vê em seguida.

Citação: Günaydın, G., Moran, J.K., Rohe, T. et al. Causal inference shapes crossmodal postdiction in multisensory integration. Sci Rep 16, 7490 (2026). https://doi.org/10.1038/s41598-026-36884-6

Palavras-chave: integração multissensorial, ilusão audiovisual, inferência causal, pós-dição, percepção bayesiana