Clear Sky Science · pt

Melhorando a estimativa de profundidade em longa distância via codificação heterogênea CNN-transformer e fusão semântica cross-dimensional

Vendo profundidade com um único olho

Robôs modernos, carros autônomos e drones frequentemente dependem de sensores 3D caros para saber a que distância as coisas estão. Este estudo mostra como câmeras comuns de cor, como as de smartphones, podem ser aproveitadas muito além do usual: os autores projetam uma nova forma de o computador inferir profundidade a partir de apenas uma imagem, com foco na parte mais difícil da cena — as grandes distâncias, onde os obstáculos ficam minúsculos, borrados e fáceis de interpretar errado.

Por que objetos distantes são tão difíceis de julgar

Estimar profundidade a partir de uma única imagem, chamado estimativa de profundidade monocular, é um tipo de truque visual. Objetos próximos ocupam muitos pixels e têm texturas nítidas, então as redes neurais atuais já se saem bem em curtas e médias distâncias. Mais longe, porém, carros encolhem a poucos pixels e as sinalizações da estrada desvanecem-se na névoa. Redes convolucionais padrão são boas em notar detalhes locais finos, mas têm dificuldade em captar o panorama completo de uma rua inteira. Modelos Transformer mais recentes percebem bem o contexto global, mas são menos sensíveis a bordas e texturas tênues. Como resultado, ambas as famílias de métodos frequentemente tropeçam justamente onde a navegação segura mais precisa de estimativas confiáveis: em longas distâncias.

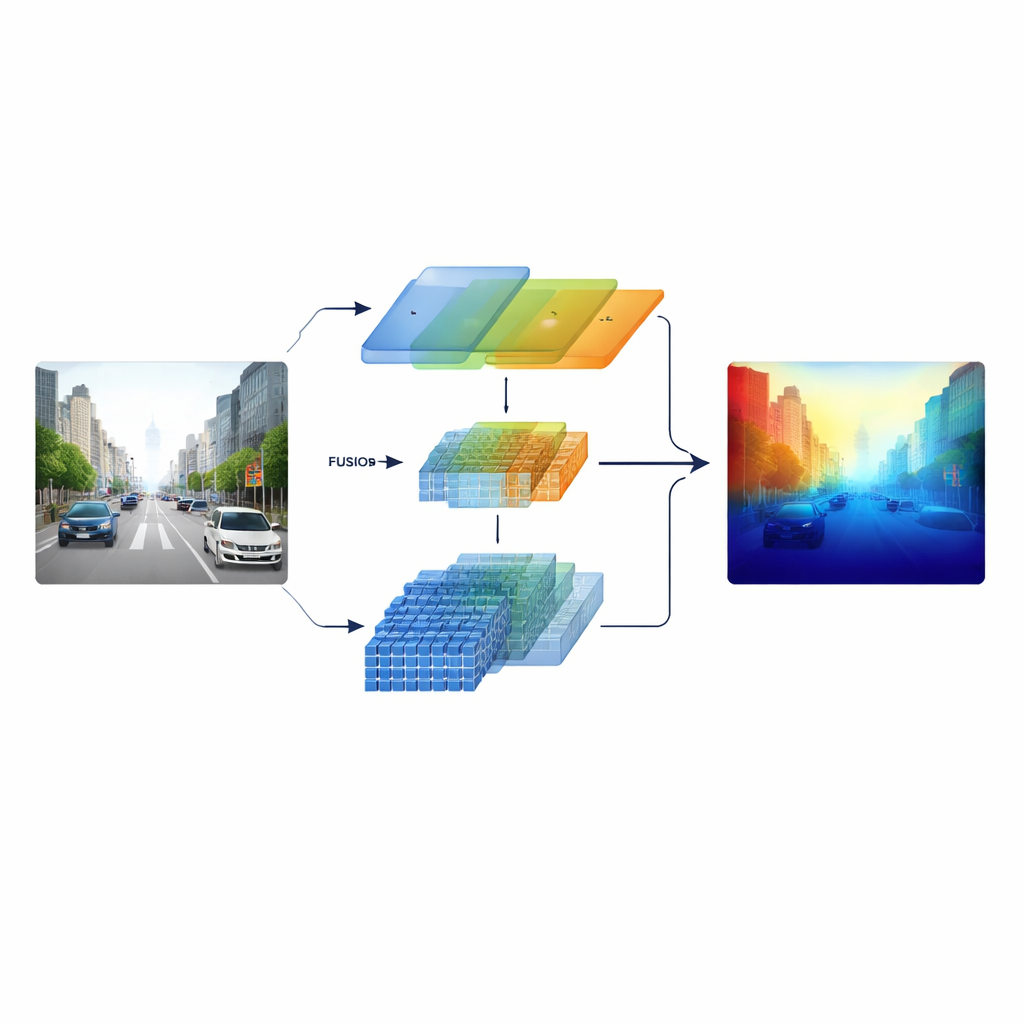

Misturando duas formas de enxergar

Os pesquisadores enfrentam isso construindo um codificador “heterogêneo” que executa dois tipos diferentes de processamento visual em paralelo. Um ramo é baseado em uma rede convolucional estilo ResNet clássica, que se especializa em padrões locais nítidos, como marcas de faixa, postes e contornos de objetos. O outro ramo usa um Swin Transformer, projetado para capturar conexões de longo alcance na imagem, como a disposição de um corredor de estrada ou o contorno de edifícios distantes. Em vez de combinar essas duas visões apenas ao final, o sistema mantém recursos multi-escala de ambos os ramos e os alimenta em uma etapa de fusão cuidadosamente projetada, de modo que estrutura fina e contexto amplo se informem mutuamente ao longo do processo.

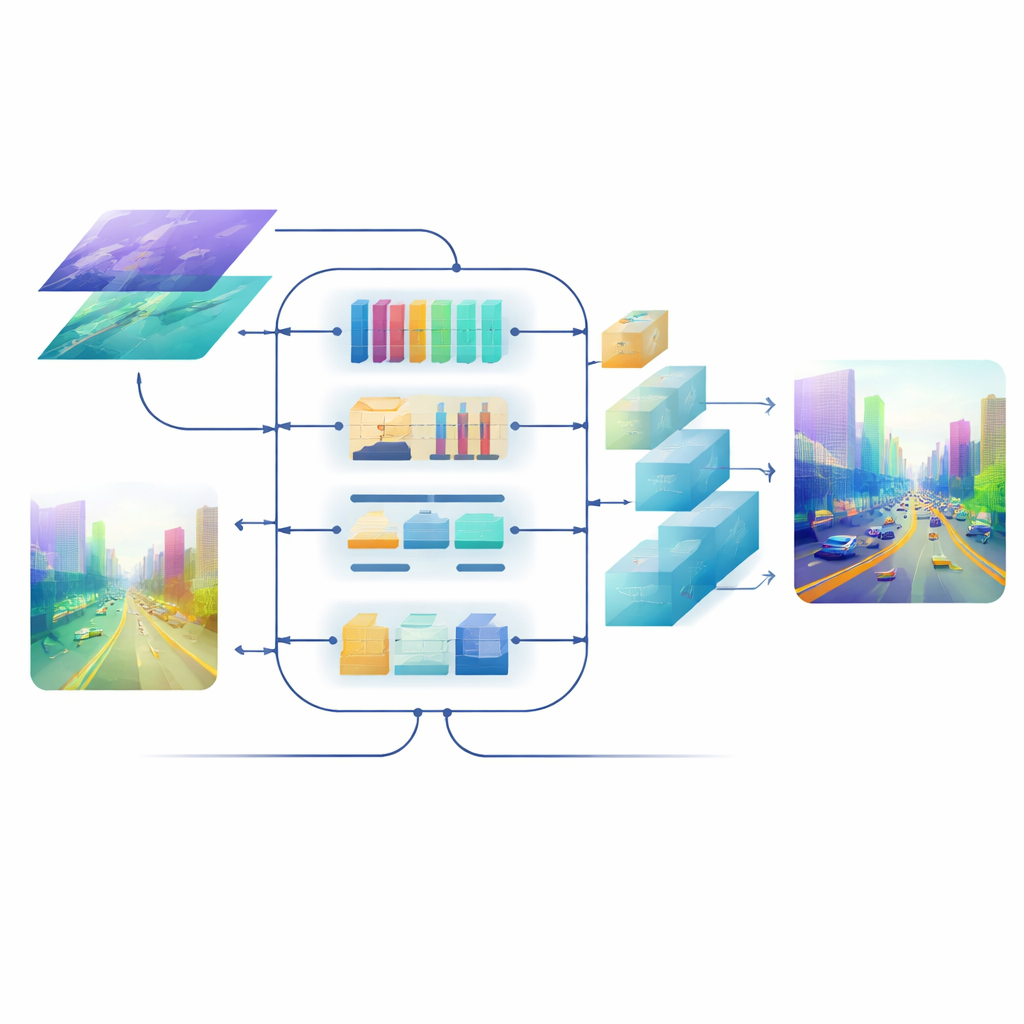

Cruzando canais, espaço e escala

No cerne do modelo está um módulo de Fusão Semântica Cross-dimensional que age como uma sala de reuniões inteligente para os dois fluxos de informação. Primeiro, ele decide quais canais — diferentes tipos de padrões visuais aprendidos — merecem mais atenção, equilibrando sinais de texturas detalhadas e pistas de cena de alto nível. Em seguida, ele observa separadamente ao longo das direções horizontal e vertical, que são especialmente significativas em cenas repletas de estradas, edifícios e árvores, para destacar estruturas importantes que se estendem pela imagem. Finalmente, ele mistura recursos rasos, ricos em detalhes, com outros mais profundos e abstratos através de várias escalas. Uma etapa de ponderação aprendível permite que a rede decida quanto confiar em cada ramo para cada região, de modo que objetos pequenos e distantes não sejam abafados pela cena próxima.

Afinando a imagem final

Mesmo com bons recursos fundidos, reconvertê-los em um mapa de profundidade em resolução total pode borrar bordas e apagar estruturas finas. Para evitar isso, a equipe projeta um decodificador guiado por atenção. Seus blocos de upsampling usam convoluções depth-wise leves para ampliar o mapa sem perder contexto, e um mecanismo de autoatenção multi-escala agrupa canais de recurso de forma que a atenção possa ser computada de maneira eficiente. Essa etapa refina as previsões de profundidade em cada escala enquanto mantém o custo computacional sob controle. O resultado é um campo de profundidade suave e coerente, onde as bordas dos objetos — como o contorno de um ciclista distante ou os degraus de um beliche — permanecem nítidas.

Quão bem isso funciona no mundo real

O método é testado em vários conjuntos de dados padrão. No KITTI, uma grande coleção de cenas de direção, o modelo alcança precisão de ponta na maioria das métricas comuns e, crucialmente, produz o menor erro em regiões designadas de longo alcance. Também gera contornos de profundidade mais limpos ao redor de objetos do que sistemas concorrentes. No NYU Depth V2, que contém cenas internas, e no benchmark SUN RGB-D, o mesmo modelo generaliza com sucesso, reconstruindo móveis e disposições de ambientes em nuvens de pontos 3D convincentes. Estudos de ablação — testes sistemáticos que removem ou trocam componentes — mostram que cada peça proposta, desde o codificador híbrido até o módulo de fusão e o bloco de atenção do decodificador, melhora o desempenho de forma mensurável, especialmente para áreas distantes e de baixa textura.

O que isso significa para a tecnologia do dia a dia

Em termos simples, este trabalho ensina uma rede neural a usar ao mesmo tempo uma lupa e uma lente grande-angular, e a combiná-las com sabedoria. Ao equilibrar melhor detalhes locais com compreensão global da cena, a estrutura proposta melhora significativamente a capacidade de uma única câmera julgar profundidade lá no fim da estrada ou do outro lado de um cômodo. Isso torna mais viável equipar robôs, veículos e drones com sensores mais baratos, mantendo-lhes um senso 3D rico do mundo — um passo importante rumo a sistemas autônomos mais seguros, capazes e acessíveis.

Citação: Chen, Y., Yin, Q., Zhao, L. et al. Enhancing long-range depth estimation via heterogeneous CNN-transformer encoding and cross-dimensional semantic fusion. Sci Rep 16, 9396 (2026). https://doi.org/10.1038/s41598-026-36755-0

Palavras-chave: estimativa de profundidade monocular, visão computacional, fusão transformer e CNN, condução autônoma, reconstrução de cena 3D