Clear Sky Science · pt

Explorando o reconhecimento das emoções dos estudantes e o feedback didático dos professores em aulas de língua estrangeira na universidade com base no modelo AFCNN

Por que seu professor pode em breve "ler a sala" com IA

Quem já passou por uma aula entediante sabe que o tédio pode minar o aprendizado silenciosamente. Ainda assim, os professores frequentemente contam apenas com a intuição para inferir como os alunos estão se sentindo naquele momento. Este estudo explora uma nova forma de oferecer aos docentes de língua estrangeira nas universidades uma espécie de "painel emocional" alimentado por inteligência artificial (IA). Ao ler as expressões faciais dos estudantes em tempo real, o sistema ajuda os professores a ajustar o ensino na hora e, a longo prazo, apoia seu desenvolvimento profissional.

Sentimentos importam tanto quanto a gramática

As aulas de língua estrangeira não se resumem a listas de vocabulário e regras gramaticais. São espaços sociais onde confiança, ansiedade, curiosidade e tédio influenciam o quanto os alunos aprendem. Pesquisas anteriores mostraram que a formação docente costuma se concentrar em métodos e conteúdo, prestando menos atenção às emoções dos alunos durante a aula. Ferramentas tradicionais, como pesquisas no fim do semestre ou conversas pós‑aula, chegam tarde demais para resgatar uma aula que está entrando em crise. Os autores argumentam que, se os professores pudessem ver como as emoções mudam minuto a minuto, poderiam reagir mais rápido — acelerando, desacelerando ou mudando as atividades antes que os alunos desliguem mentalmente.

Transformando rostos em sinais úteis

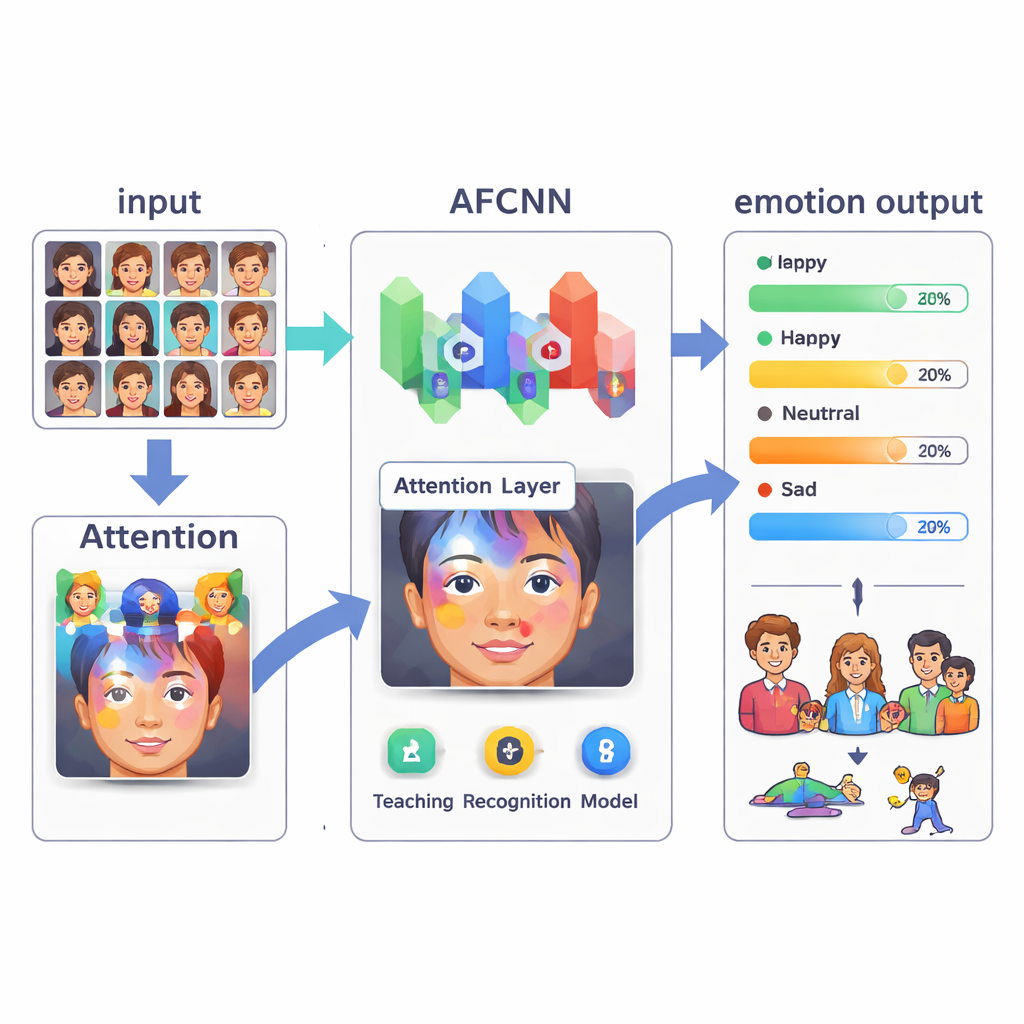

O cerne do estudo é um modelo de deep learning chamado Attention Feature Convolutional Neural Network, ou AFCNN. Em termos simples, uma câmera na sala captura os rostos dos estudantes enquanto aprendem. O modelo então segue três etapas: localiza cada rosto, extrai características relacionadas às expressões e as classifica em uma das sete emoções básicas, como felicidade, tristeza, medo ou um estado neutro. Um mecanismo especial de "atenção" ajuda a IA a focar nas partes mais informativas do rosto — como olhos ou boca — enquanto ignora distrações. Ao contrário de abordagens mais antigas que funcionam melhor com fotos limpas e de frente, este sistema foi projetado para lidar com condições mais realistas, como vistas parciais, mãos no rosto ou alunos olhando de lado.

Quão bem o sistema realmente funciona

Para testar o AFCNN, os pesquisadores o treinaram em uma coleção conhecida de imagens faciais rotuladas com categorias emocionais e ampliaram os dados com ajustes simples, como rotação e alterações de brilho. Em seguida, compararam seu desempenho com dois modelos estabelecidos de reconhecimento de imagem, VGG16 e ResNet18. Em condições claras, sem obstrução, o novo modelo identificou corretamente as emoções cerca de 81% das vezes e se saiu especialmente bem ao reconhecer expressões felizes e neutras, alcançando na faixa de meados dos 80% em precisão. Quando os rostos estavam parcialmente bloqueados — por cabelo, mãos ou chapéus — a precisão caiu para todos os sistemas, mas o AFCNN ainda superou os demais e apresentou resultados mais equilibrados entre as diferentes emoções, sugerindo que é mais robusto para salas de aula reais.

Dos resultados emocionais a aulas melhores

O estudo vai além da precisão bruta e pergunta se essa tecnologia realmente melhora o ensino. Em um ensaio de um mês com 200 professores universitários de língua estrangeira, metade usou o sistema de reconhecimento emocional e a outra metade lecionou como de costume. Professores com acesso ao feedback emocional em tempo real modificaram seus planos de aula mais do que o dobro durante uma sessão, relataram maior satisfação com o ensino e observaram maior participação e interação dos alunos. Os pesquisadores também desenharam um mapeamento simples de padrões emocionais para respostas sugeridas — por exemplo, passar para discussão ou revisão quando surgem sinais de confusão ou frustração — deslocando o sistema de mera observação das emoções para orientação ativa do comportamento.

O que isso significa para as salas de aula do futuro

Em termos práticos, esta pesquisa sugere que salas de aula futuras podem contar com um assistente silencioso que observa os rostos dos alunos e sussurra ao professor quando o ambiente perde energia ou quando muitos estudantes parecem confusos. O sistema AFCNN não é perfeito — ainda encontra dificuldades com emoções sutis, como nojo ou medo, e depende de imagens rotuladas de alta qualidade —, mas demonstra que a IA pode captar tendências emocionais de forma confiável e que os professores podem usar essa informação para ensinar de maneira mais responsiva. Para os alunos, isso pode significar aulas mais engajadoras e acolhedoras; para os professores, oferece uma nova ferramenta de desenvolvimento profissional que combina psicologia, educação e IA em um ambiente de aprendizagem mais inteligente e atento ao aspecto humano.

Citação: Shi, L. Exploring students’ emotion recognition and teachers’ teaching feedback in college foreign language classroom based on AFCNN model. Sci Rep 16, 5657 (2026). https://doi.org/10.1038/s41598-026-36747-0

Palavras-chave: reconhecimento de emoções em sala de aula, IA na educação, ensino de língua estrangeira, desenvolvimento profissional docente, modelos de deep learning