Clear Sky Science · pt

Migração adaptativa de serviços ciente de latência e energia em computação de borda móvel

Por que aproximar os apps de você importa

Cada vez que você joga online no carro, transmite direções em AR no celular ou um sensor em uma cidade inteligente envia dados, essas tarefas digitais precisam ser processadas em algum lugar. A Computação de Borda Móvel (MEC) desloca esse trabalho de centros de dados distantes para pequenos servidores próximos às estações base celulares, reduzindo a latência e tornando os aplicativos mais responsivos. Mas manter esses serviços próximos de usuários em movimento exige “mover” (migrar) frequentemente a aplicação em execução entre servidores de borda próximos. Migrar demais desperdiça energia e dinheiro; migrar de menos gera atraso e frustração. Este estudo explora como alcançar um equilíbrio inteligente usando aprendizado de máquina avançado.

Equilibrando velocidade e consumo de energia

A maior parte das pesquisas anteriores sobre migração de serviços em MEC concentrou‑se principalmente em um objetivo: manter a latência percebida pelo usuário o mais baixa possível. Isso normalmente implica perseguir o usuário enquanto ele se move e transferir repetidamente seu app para o servidor mais próximo. Contudo, cada migração consome energia adicional de comunicação e adiciona sua própria latência. Muitos métodos anteriores também presumiram ampla capacidade nos servidores e condições estáveis, ignorando a realidade de que servidores de borda têm recursos limitados, competem por muitos usuários e enfrentam cargas e qualidades de link sem fio que mudam rapidamente. Os autores defendem que a energia de migração deve ser tratada como um objetivo central, em pé de igualdade com a latência, e que políticas de migração precisam se adaptar online ao movimento do usuário, carga dos servidores e flutuações da rede.

De um problema matemático a um agente que aprende

Os pesquisadores primeiro constroem um modelo matemático detalhado de um sistema MEC com múltiplas estações base, servidores de borda co‑localizados e usuários móveis. Cada usuário descarrega tarefas de computação para servidores próximos por links sem fio. A latência total do serviço é dividida em três partes: tempo para enviar a tarefa até a estação base, tempo para processá‑la no servidor e tempo gasto caso o serviço seja movido entre servidores pela retaguarda com fio. A energia de migração é modelada principalmente a partir da quantidade de dados que precisa ser transferida quando um serviço se desloca. O objetivo geral é minimizar tanto a latência quanto a energia de migração respeitando limites de capacidade de computação de cada servidor e prazos de cada serviço. Resolver esse problema misto, inteiro e não linear exatamente é intratável em tempo real, então a equipe recorre ao aprendizado por reforço profundo, onde um agente aprende boas decisões interagindo com um ambiente simulado.

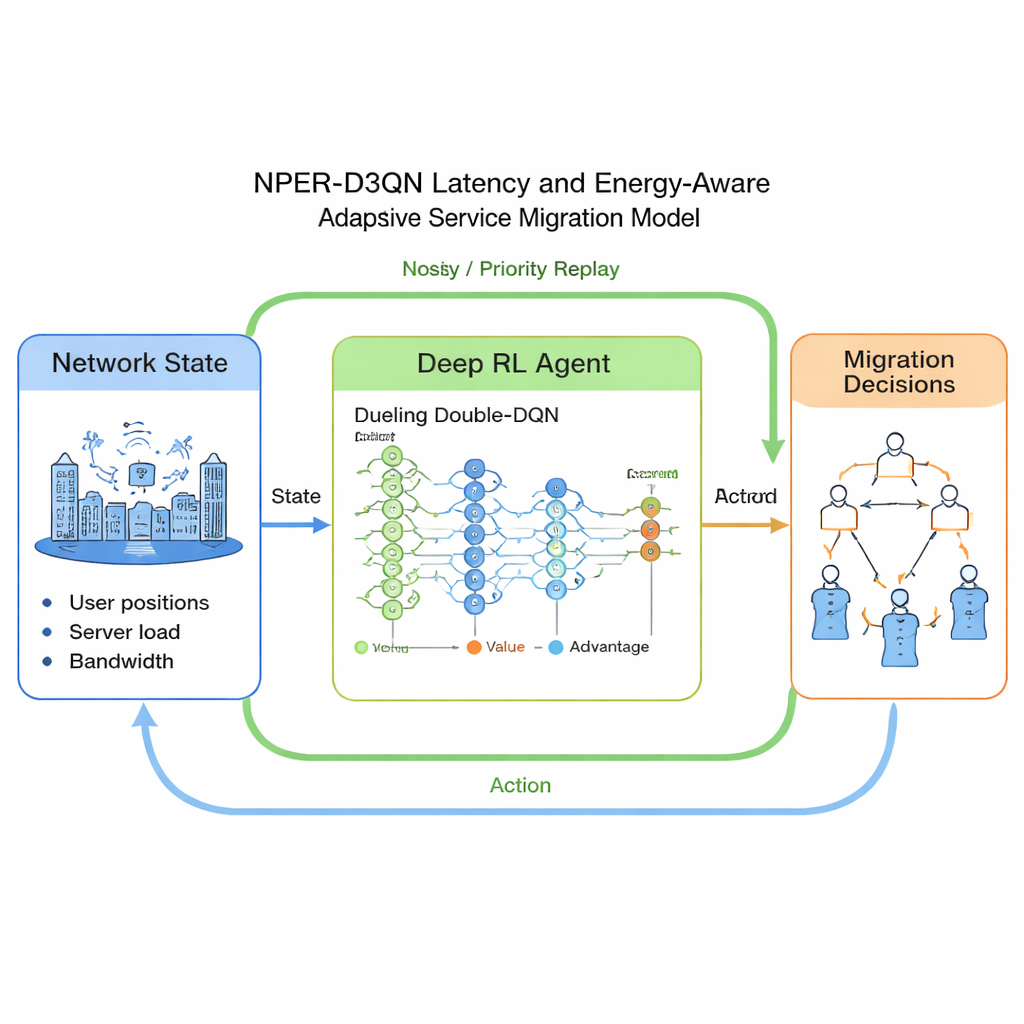

Como funciona o cérebro adaptativo de migração

O método proposto, chamado NPER‑D3QN, é uma variante sofisticada das Deep Q‑Networks (DQN). O “estado” de entrada do agente resume onde os usuários estão, quão longe estão da estação base que os serve, quão carregado está cada servidor de borda, capacidade de computação disponível, taxas de dados sem fio e o quão grandes e exigentes em computação são os serviços. Suas “ações” são escolhas de qual servidor de borda deve hospedar o serviço de cada usuário no próximo intervalo de tempo. A função de recompensa incentiva baixa latência em relação ao prazo de cada serviço enquanto penaliza a energia de migração, pressionando o agente a equilibrar velocidade e consumo de energia. Tecnicamente, o modelo combina três ideias: uma rede dueling que estima separadamente o valor de estar em um estado e o benefício de cada ação, uma estrutura de Q‑learning “double” que reduz estimativas excessivamente otimistas, e dois assistentes de exploração — redes ruidosas e replay de experiência priorizado — que permitem aprender mais rápido e com mais confiabilidade em condições complexas e mutáveis.

Colocando a abordagem à prova

Para avaliar o desempenho do NPER‑D3QN, os autores simulam uma malha urbana com dezenas de estações base e até centenas de usuários móveis que se movem aleatoriamente e enviam tarefas de tamanhos variados. Servidores de borda têm poder de computação limitado e podem hospedar apenas um número fixo de máquinas virtuais, criando filas e contenção realistas. Eles comparam seu método com seis linhas de base de última geração, incluindo DQN clássico, variantes double‑dueling aprimoradas e esquemas que ou sempre perseguem o servidor mais próximo ou se concentram exclusivamente em minimizar a latência. Em uma variedade de cenários, o NPER‑D3QN converge mais rápido para boas estratégias e consistentemente alcança menor latência média de serviço, menor consumo de energia relacionado à migração e menos migrações rejeitadas quando os servidores estão cheios. Em um teste em larga escala com 720 usuários e 96 servidores, ele reduz a latência em até cerca de dois terços e a energia de migração em mais de 90% em comparação com algumas alternativas, mantendo o tempo de computação por decisão dentro de limites práticos.

O que isso significa para serviços conectados no futuro

Para não especialistas, a conclusão é que simplesmente aproximar aplicativos dos usuários não basta: também precisamos de controle inteligente sobre quando e onde serviços em execução se movem. Este trabalho mostra que um controlador baseado em aprendizado pode “malabarizar” objetivos concorrentes de responsividade, economia de energia e capacidade limitada de borda sem regras feitas à mão. Se sistemas semelhantes forem implantados em redes reais, eles podem ajudar operadoras a oferecer experiências mais suaves para aplicações como direção autônoma, AR imersiva e IoT industrial, enquanto reduzem contas de energia e a pressão sobre a infraestrutura. Os autores observam que o estudo é baseado em simulação e omite alguns detalhes do mundo real, como consumo total de energia dos servidores e monitoramento imperfeito, mas representa um passo promissor rumo a uma computação de borda mais verde e adaptável.

Citação: Li, L., Lv, J., Wang, S. et al. Latency and energy-aware adaptive service migration in mobile edge computing. Sci Rep 16, 6178 (2026). https://doi.org/10.1038/s41598-026-36711-y

Palavras-chave: computação de borda móvel, migração de serviços, aprendizado por reforço profundo, otimização de latência, eficiência energética