Clear Sky Science · pt

Algoritmo de Otimização Secante para otimização global eficiente

Busca mais inteligente para problemas difíceis

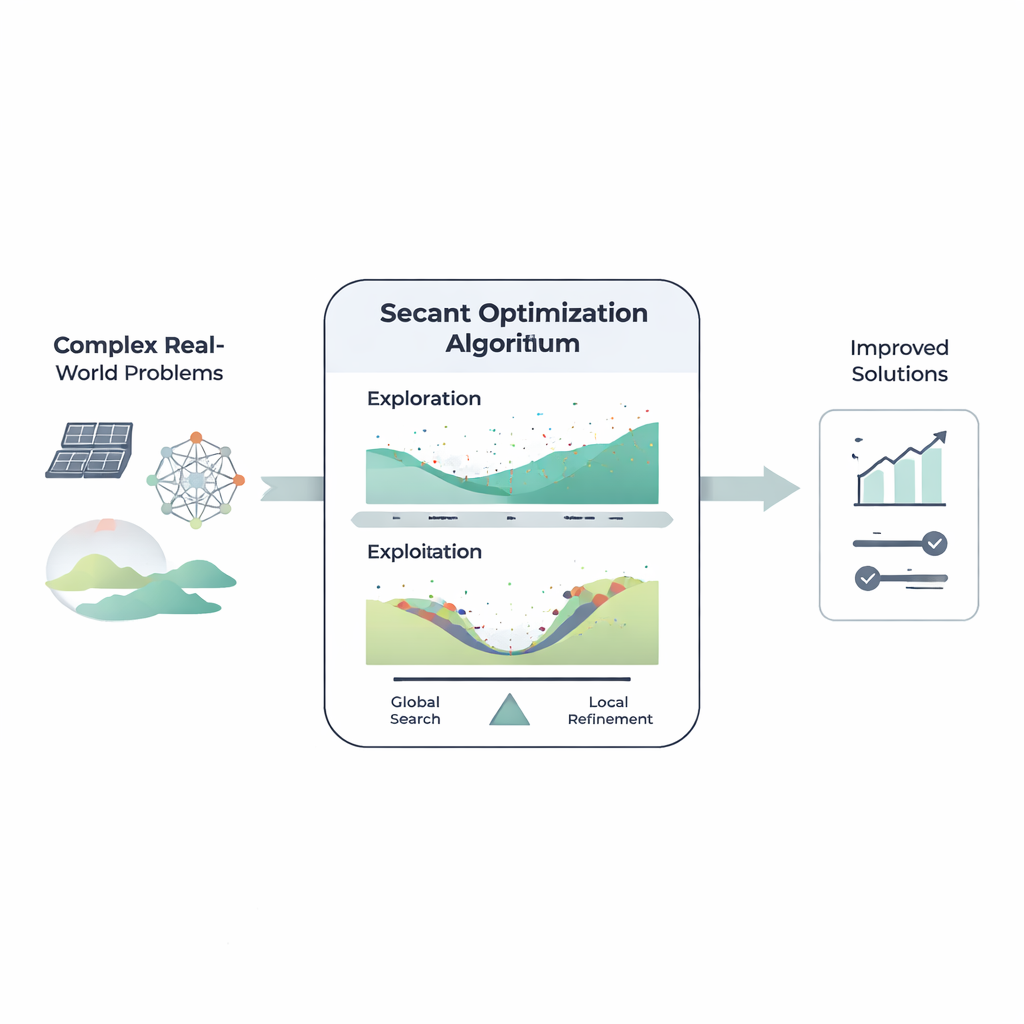

De projetar painéis solares mais limpos a treinar sistemas de reconhecimento de imagem precisos, muitos dos desafios atuais se reduzem à mesma tarefa: vasculhar um espaço enorme de possibilidades para encontrar uma boa solução. Este artigo apresenta o Algoritmo de Otimização Secante (SOA), uma nova maneira de conduzir essa busca de forma mais eficiente. Inspirado por uma ideia clássica do cálculo, mas adaptado para dados do mundo real, muitas vezes ruidosos, o SOA busca ser rápido e confiável quando os métodos tradicionais encontram dificuldades.

Por que a otimização precisa de novas ideias

Problemas modernos de engenharia e ciência de dados frequentemente envolvem dezenas ou centenas de parâmetros ajustáveis, múltiplos objetivos e relações intrincadas que são difíceis de descrever com fórmulas simples. Técnicas clássicas que seguem gradientes exatos, como o gradiente descendente, podem falhar quando a paisagem do problema é irregular, cheia de armadilhas locais, ou quando derivadas são difíceis ou impossíveis de calcular. Em resposta, pesquisadores desenvolveram algoritmos “metaheurísticos” que imitam processos da natureza, da física ou da matemática para explorar esses cenários difíceis. Esses métodos, como algoritmos genéticos ou otimizadores por enxame, mostraram-se versáteis, mas ainda enfrentam trade-offs entre explorar amplamente e refinar com precisão.

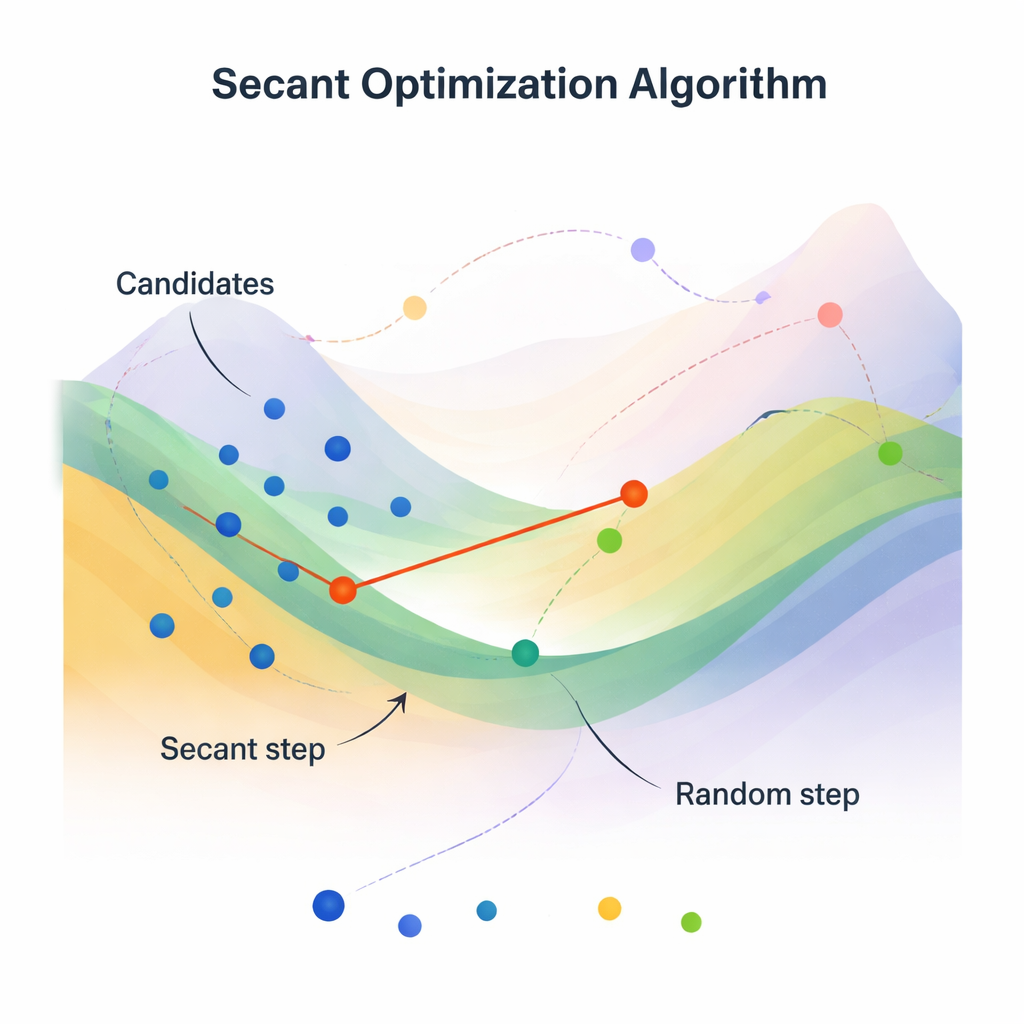

Transformando um truque de livro-texto em um motor de busca

O cerne do SOA é o método secante, um velho recurso numérico para encontrar onde uma curva cruza zero sem precisar de derivadas exatas. Em vez de usar um declive calculado pelo cálculo, o método secante traça uma linha reta entre dois pontos próximos na curva e usa essa linha como uma inclinação aproximada. O SOA generaliza essa ideia para muitas dimensões e para vários candidatos de solução ao mesmo tempo. Ele mantém uma população de vetores (possíveis respostas) e os atualiza repetidamente usando passos do tipo secante que aproximam como a função objetivo está se comportando, mas apenas com valores de função. Isso torna o método atraente em situações onde gradientes são ruidosos, caros ou indefinidos, como ao ajustar hiperparâmetros de redes neurais observando o erro de validação.

Equilibrando exploração ampla com foco preciso

O desenho do SOA separa explicitamente como ele explora e como refina soluções. Na fase de exploração, cada candidato é ajustado por uma regra baseada na secante que combina informações da melhor solução atual, do vetor corrente e de um par aleatoriamente escolhido. Isso ajuda a orientar a busca em direções aparentemente promissoras, sem ser puramente aleatório. Na fase de exploração fina (exploitation), o SOA introduz um “fator de expansão” e uma aleatoriedade controlada. Ele impulsiona soluções em direção ao melhor, à média, ao mais próximo e até ao mais distante ponto da população, e mistura caminhadas aleatórias. Uma regra simples de mutação ocasionalmente conserva uma posição antiga em vez da nova, preservando diversidade. Em conjunto, esses mecanismos ajudam o SOA a escapar de armadilhas locais enquanto ainda converge para respostas de alta qualidade.

Testes em benchmarks e dispositivos reais

Para verificar se o SOA é mais do que uma ideia elegante no papel, os autores testam o algoritmo em famílias de benchmark amplamente usadas conhecidas como CEC2021 e CEC2020. Essas funções são projetadas para serem exigentes: algumas são de baixa dimensão, mas cheias de mínimos falsos; outras se estendem a 50 ou 100 dimensões. Nesses testes, o SOA é comparado com dois grupos de algoritmos concorrentes, incluindo 11 métodos inspirados em matemática e 9 otimizadores recentes ou variantes. Usando estatísticas como erro médio, variabilidade, curvas de convergência e testes baseados em ranqueamento, o SOA consistentemente iguala ou supera a maioria dos rivais, particularmente ao atingir boas soluções de forma rápida e confiável. Os autores então vão além de testes sintéticos para duas tarefas reais exigentes: estimar parâmetros chave em modelos fotovoltaicos (PV) e ajustar automaticamente os hiperparâmetros de redes neurais convolucionais para vários conjuntos de imagens.

De painéis solares a redes neurais

Na energia solar, modelos precisos de células e módulos fotovoltaicos são essenciais para prever a produção e otimizar a operação. A equipe aplica o SOA a vários modelos PV padrão, incluindo descrições de diodo único, diodo duplo e módulos completos. Usando dados medidos de corrente–tensão, o SOA ajusta os parâmetros do modelo para minimizar o erro e mostra conseguir erro quadrático médio menor ou comparável ao de diversos otimizadores estabelecidos. Em experimentos de aprendizado de máquina, o SOA é usado para afinar a arquitetura e configurações de treinamento de uma rede neural convolucional em MNIST e conjuntos de imagens relacionados. Também aqui o algoritmo encontra combinações de hiperparâmetros que proporcionam acurácias de classificação competitivas ou superiores em relação a outras estratégias automáticas de busca.

O que isso significa na prática

Para não especialistas, a mensagem principal é que o SOA oferece um novo “motor de busca” prático para problemas de otimização difíceis, onde a paisagem é irregular e gradientes não estão disponíveis. Ao incorporar a geometria do método secante em uma busca baseada em população com aleatoriedade bem calibrada, o algoritmo frequentemente converge mais rápido e com mais precisão do que muitas alternativas atuais. Por ser relativamente simples, livre de derivadas e com poucos parâmetros para ajustar, o SOA pode ser integrado em diversas aplicações — desde projetar sistemas de energia solar mais eficientes até configurar modelos de deep learning — tornando-se uma adição promissora à caixa de ferramentas de engenheiros e cientistas de dados.

Citação: Ibrahim, M.Q., Qaraad, M., Hussein, N.K. et al. Secant Optimization Algorithm for efficient global optimization. Sci Rep 16, 6659 (2026). https://doi.org/10.1038/s41598-026-36691-z

Palavras-chave: otimização global, algoritmos metaheurísticos, algoritmo de otimização secante, modelagem fotovoltaica, ajuste de hiperparâmetros