Clear Sky Science · pt

Detecção em tempo real de fogo e fumaça usando transformers de visão e aprendizado espaço-temporal

Por que alertas mais rápidos contra incêndios importam

Incêndios em residências, fábricas e florestas podem se tornar letais em minutos. Hoje, muitos alarmes ainda dependem de sensores de calor ou fumaça que só reagem depois que as chamas já estão bem estabelecidas. Este artigo descreve um novo sistema de visão computacional capaz de detectar sinais de fogo e fumaça em feeds de câmeras quase instantaneamente, mesmo em condições desafiadoras como pouca luz ou névoa intensa. Ao combinar várias técnicas avançadas de inteligência artificial em um único modelo, os pesquisadores buscam fornecer a bombeiros, planejadores urbanos e agências ambientais um sinal de aviso muito mais precoce — potencialmente salvando vidas, bens e ecossistemas.

O desafio crescente de detectar chamas

Cidades modernas e florestas estão cada vez mais monitoradas por câmeras, mas ensinar computadores a reconhecer fogo e fumaça de forma confiável nessas imagens e vídeos é complicado. Abordagens tradicionais usam redes neurais que funcionam bem em imagens estáticas ou clipes curtos, mas frequentemente têm dificuldade em cenas reais e desordenadas. Uma única foto pode mostrar algo que parece fumaça, mas ser apenas neblina ou escapamento. Sistemas focados em vídeo conseguem rastrear como formas se movem ao longo do tempo, mas tendem a ser lentos e exigentes em hardware. Como resultado, modelos anteriores frequentemente geram alarmes falsos ou deixam passar sinais sutis e de rápida mudança — especialmente em iluminação ruim, fumaça densa ou fundos poluídos.

Um “observador” híbrido de IA para imagens e vídeo

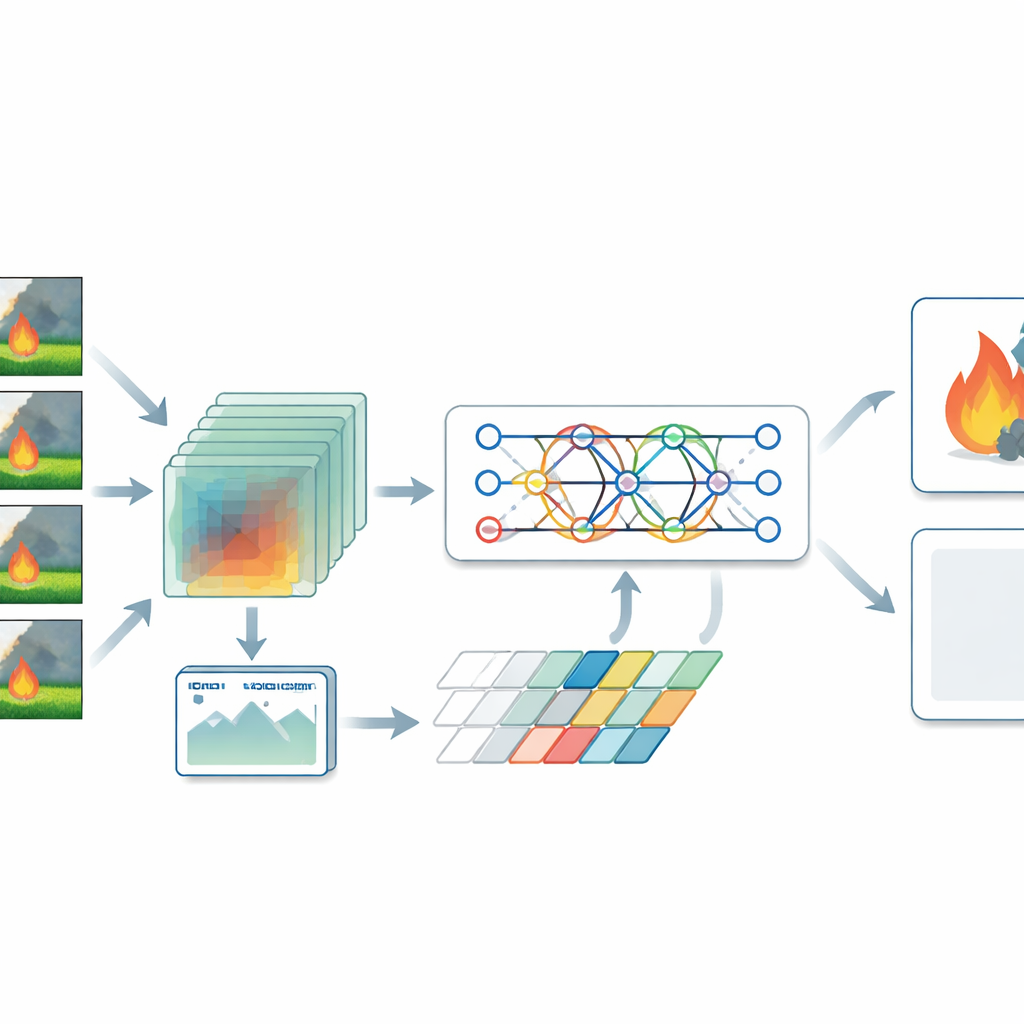

Os autores propõem um modelo híbrido que trata a detecção de incêndio tanto como um problema espacial quanto temporal. Para imagens estáticas, eles usam um tipo de rede neural chamada vision transformer, que analisa a imagem como um mosaico de regiões e aprende como áreas distantes se relacionam. Isso o ajuda a notar padrões amplos, como fiapos de fumaça se espalhando por um vale ou chamas dispersas em uma floresta. Para vídeo, o sistema recorre a uma rede convolucional tridimensional que processa pilhas de quadros de uma só vez, capturando como fumaça e fogo mudam ao longo do tempo. Um codificador transformer então examina esses padrões em mudança e foca atenção nos momentos e regiões mais propensos a indicar perigo, em vez de dar peso igual a cada quadro.

Misturando pistas e equilibrando os dados

Uma etapa chave no sistema é uma camada de fusão que combina pistas detalhadas de imagens estáticas com padrões de movimento do vídeo. Ao unificar essas visões complementares, o modelo pode distinguir melhor incêndios reais de parecidos inofensivos, como reflexos do pôr do sol, neblina ou nuvens. Os pesquisadores também perceberam que muitos conjuntos de dados públicos contêm muito mais exemplos com fogo do que sem fogo, o que pode enviesar um modelo a relatar chamas em excesso. Para contornar isso, eles geraram uma grande variedade de cenas realistas sem fogo por meio de uma cuidadosa augmentação de dados — alterando brilho, recortando e espelhando imagens, e simulando situações como manhãs enevoadas ou interiores pouco iluminados. Em seguida, treinaram o modelo com uma função de perda que equilibra explicitamente erros em casos com e sem fogo, melhorando a confiabilidade no uso cotidiano.

Colocando o sistema à prova

Para avaliar o desempenho de sua abordagem, os autores testaram-na em dois conjuntos de dados amplamente usados: um com quase mil imagens estáticas do NASA Space Apps Challenge, e outro com vídeos relacionados a incêndio do Kaggle. Após pré-processamento e balanceamento, eles treinaram e avaliaram seu modelo híbrido ao lado de baselines conhecidos como ResNet, VGG, LSTM, redes puras de convolução 3D e vários emparelhamentos híbridos desses métodos mais antigos. O novo sistema alcançou cerca de 99,2% de acurácia nas imagens da NASA e 98,3% no conjunto de vídeos, superando claramente os modelos tradicionais, que tipicamente variavam da casa dos 80 e poucos até meados dos 90%. Também teve tempo de execução rápido — dezenas de milissegundos por quadro — e tamanho de modelo modesto, tornando-o adequado para implantação em dispositivos de borda como GPUs pequenas e placas embarcadas.

O que isso significa para a segurança cotidiana

Em termos práticos, esta pesquisa mostra que uma IA bem projetada pode monitorar feeds de câmeras em tempo real e responder de forma confiável a uma pergunta simples, mas vital: “Há fogo ou fumaça perigosa aqui agora?” Ao combinar contexto visual amplo, movimento ao longo do tempo e atenção seletiva aos detalhes mais reveladores, o modelo híbrido reduz drasticamente tanto incêndios não detectados quanto alarmes falsos. Com ajustes adicionais e exposição a cenas mais variadas — como cidades densas, espaços subterrâneos e condições climáticas extremas — ele pode se tornar uma base prática para sistemas de alarme mais inteligentes, redes de monitoramento de incêndios florestais e ferramentas de segurança industrial que reagem mais rápido e com mais precisão do que muitas soluções atuais.

Citação: Lilhore, U.K., Sharma, Y.K., Venkatachari, K. et al. Real time fire and smoke detection using vision transformers and spatiotemporal learning. Sci Rep 16, 8928 (2026). https://doi.org/10.1038/s41598-026-36687-9

Palavras-chave: detecção de incêndio, detecção de fumaça, visão computacional, modelos transformer, monitoramento em tempo real