Clear Sky Science · pt

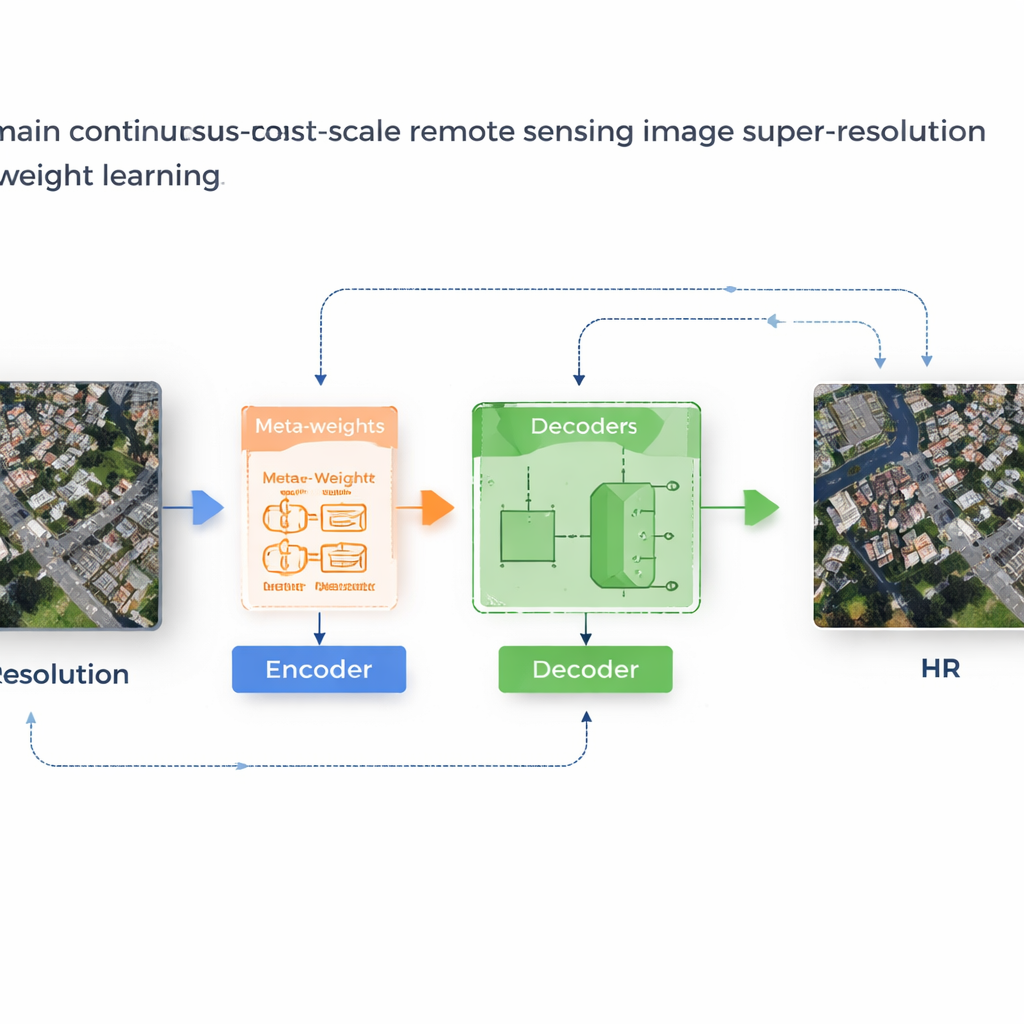

Super-resolução de imagens de sensoriamento remoto em escala contínua entre domínios via aprendizado de meta-pesos

Visões mais nítidas do espaço

Imagens de satélite alimentam tudo, desde o planejamento urbano até a resposta a desastres, mas muitas fotos ficam mais borradas do que gostaríamos por limitações do hardware das câmeras e da transmissão de dados. Este artigo apresenta uma nova forma de transformar fotos de satélite borradas em imagens mais nítidas em qualquer nível de zoom escolhido, usando uma estratégia de aprendizado que se adapta ao aspecto particular das imagens aéreas sem precisar ser re-treinada para cada situação.

Por que imagens de satélite mais nítidas importam

Imagens de sensoriamento remoto de alta resolução são cruciais para detectar objetos pequenos, acompanhar mudanças no terreno e mapear o uso do solo com detalhes. No entanto, satélites reais precisam equilibrar resolução com custo, tamanho do sensor e largura de banda, então muitas imagens chegam com qualidade inferior ao desejado pelos analistas. Técnicas tradicionais de “super-resolução” podem aprimorar imagens, mas geralmente são treinadas para um zoom fixo, como exatamente duas ou quatro vezes maior. Isso obriga os operadores a manter modelos separados para cada nível de zoom, o que é ineficiente e pouco flexível quando se lida com muitos satélites e tarefas variadas.

Além do zoom único para todos

Pesquisas recentes desenvolveram super-resolução em “escala contínua”, que trata a imagem como um sinal suave e pode gerar saídas nítidas para qualquer fator de zoom com um único modelo. A maioria desses métodos foi construída e testada em fotos cotidianas, não em dados de satélite. Eles tipicamente decidem como misturar informações dos pixels vizinhos usando regras geométricas fixas — essencialmente ponderando vizinhos pela distância. Isso funciona razoavelmente bem para cenas naturais, como rostos ou paisagens, mas imagens de satélite contêm prédios densos, texturas repetitivas e bordas abruptas que não seguem os mesmos padrões. Quando modelos treinados em fotos naturais são aplicados a vistas de satélite, suas suposições se desfazem e detalhes como telhados, estradas e veículos não são recuperados com fidelidade.

Um sistema de aprendizado que adapta suas próprias regras

Os autores propõem uma estrutura chamada MLIN (Implicit Neural Network baseada em Meta-Aprendizado) para resolver esse problema entre domínios. Em vez de definir manualmente como as características dos pixels vizinhos devem ser combinadas, o MLIN aprende essas regras de combinação a partir dos dados. Ele mantém um codificador de imagem potente, originalmente treinado em fotos naturais, completamente congelado, para que continue extraindo padrões visuais ricos sem ser distorcido pelos conjuntos de dados menores de satélite. Sobre isso, o MLIN adiciona um novo “decodificador implícito” equipado com um módulo de meta-aprendizado. Para cada ponto da imagem de alta resolução que o modelo deseja reconstruir, esse módulo observa as características circundantes e suas posições precisas e então prevê um conjunto de pesos suaves que dizem ao decodificador com que intensidade usar cada vizinho. Em outras palavras, o sistema não assume mais que apenas a distância importa; ele deixa o conteúdo local — como texturas de telhados, campos ou água — moldar a reconstrução.

De blocos borrados a estruturas nítidas

Tecnicamente, o método funciona amostrando uma pequena vizinhança 2×2 de características ocultas ao redor de cada localização alvo na imagem de saída. Uma meta-rede então combina informações sobre essas características, suas coordenadas relativas e o fator de zoom solicitado para escolher pesos que somam um. O decodificador usa esses pesos para misturar previsões de cada vizinho, produzindo um valor de cor final naquele ponto. Como essa ponderação é aprendida, o MLIN pode tratar regiões complexas — como blocos residenciais densos, portos com navios ou aeroportos com pistas — de maneira muito diferente de áreas suaves como desertos ou oceanos. Experimentos em dois conjuntos de dados de satélite amplamente usados (WHU‑RS19 e UCMerced) mostram que o MLIN fornece consistentemente pontuações numéricas mais altas e detalhes visivelmente mais nítidos do que vários métodos líderes de zoom contínuo, tanto para níveis de zoom familiares quanto para ampliações extremas de até dez vezes.

Treinamento mais rápido sem atraso extra

Uma vantagem prática do projeto é que apenas o novo decodificador e a meta-rede de pesos precisam ser treinados com imagens de satélite, enquanto o grande codificador permanece fixo. Isso reduz muito o tempo de treinamento em comparação com métodos que re-treinam todos os parâmetros do zero. Embora a meta-rede introduza computação extra, processadores gráficos modernos lidam com essas operações de forma eficiente, de modo que o tempo para processar uma única imagem permanece quase o mesmo que nas abordagens existentes. Estudos de ablação — testes cuidadosos nos quais partes do sistema são removidas ou simplificadas — confirmam que a ponderação sensível ao conteúdo é o ingrediente-chave que melhora tanto a nitidez de bordas quanto a continuidade de texturas.

Olhos mais claros sobre a Terra

Em termos simples, este trabalho mostra como reutilizar modelos de imagem poderosos treinados em fotos cotidianas e adaptá-los de forma inteligente ao mundo muito diferente das imagens de satélite. Ao permitir que o sistema aprenda a equilibrar informações de pixels vizinhos com base no que realmente está na cena, o MLIN produz imagens de satélite mais claras e confiáveis em qualquer nível de zoom a partir de um único modelo. Isso significa ferramentas melhores para cientistas, planejadores e equipes de resposta a emergências que dependem de visões detalhadas do nosso planeta, mantendo ao mesmo tempo demandas de computação e armazenamento gerenciáveis.

Citação: Zhang, Q., Ma, S., Tang, Y. et al. Cross-domain continuous-scale remote sensing image super-resolution via meta-weight learning. Sci Rep 16, 6073 (2026). https://doi.org/10.1038/s41598-026-36632-w

Palavras-chave: super-resolução de satélite, imagens de sensoriamento remoto, meta-aprendizado, aumento em escala arbitrária, aperfeiçoamento de imagens