Clear Sky Science · pt

Uma estrutura automatizada para a educação corânica de pessoas com deficiência auditiva usando classificação de posturas corporais e integração da Língua de Sinais Árabe

Abrindo um Texto Sagrado para Vozes Silenciosas

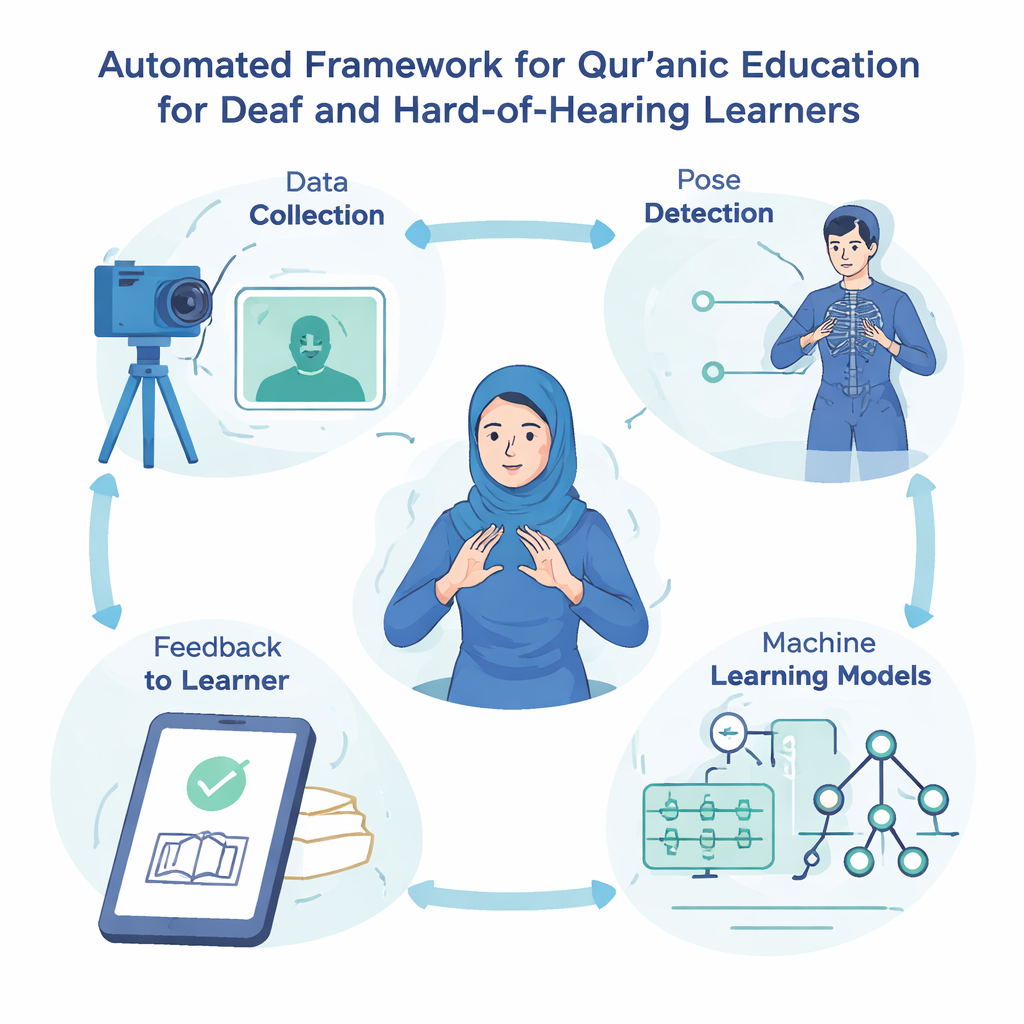

Para muitos muçulmanos surdos e com perda auditiva, aprender a recitar o Alcorão pode ser extremamente difícil, porque o ensino tradicional depende de ouvir e repetir. Este estudo apresenta um recurso pedagógico baseado em tecnologia que "vê" gestos da Língua de Sinais Árabe e os vincula a versos de um capítulo curto do Alcorão. Ao transformar movimentos corporais em uma ponte entre a língua de sinais e as escrituras, a proposta visa tornar o aprendizado religioso mais inclusivo para milhões de pessoas que se comunicam principalmente por sinais.

Por que Aprendizes com Deficiência Auditiva Ficam de Fora

Muçulmanos surdos muitas vezes dependem de gestos e sinais para se comunicar, mas a maior parte da educação corânica é construída em torno do som—professores recitam em voz alta, alunos imitam a melodia e a pronúncia. Famílias podem não dominar bem a língua de sinais, e intérpretes qualificados são escassos, especialmente para material religioso. Como resultado, muitos crentes surdos têm dificuldade em acessar o mesmo nível de educação espiritual que seus pares ouvintes. Avanços recentes em visão computacional e inteligência artificial, capazes de reconhecer movimentos das mãos e do corpo a partir de imagens de câmera, oferecem uma forma de mudar isso ao transformar a língua de sinais em algo que um computador pode entender e responder em tempo real.

Transformando Gestos em Unidades Ensináveis

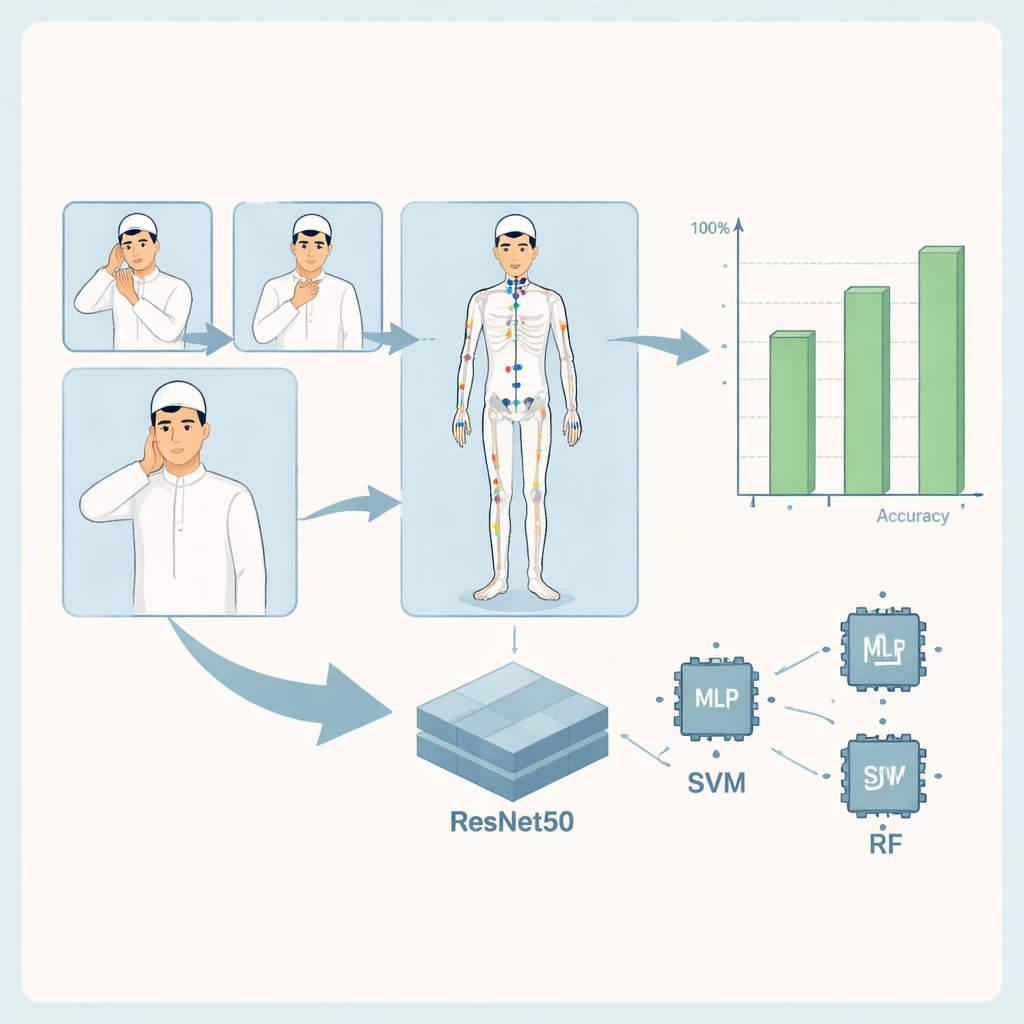

Os pesquisadores concentraram-se na Sūrat al-Ikhlāṣ, um capítulo curto porém teologicamente denso que muitos muçulmanos memorizam cedo na vida. Trabalhando com instituições que atendem usuários surdos no Egito, registraram 2.054 imagens de gestos da Língua de Sinais Árabe que correspondem a palavras corânicas individuais desse capítulo. Para evitar confusões sobre sentido e pronúncia, cada gesto foi rotulado usando tanto a escrita árabe quanto um sistema de transliteração padronizado amplamente empregado nos estudos islâmicos acadêmicos. Essa rotulagem cuidadosa assegura que o sistema vincule cada sinal ao termo corânico correto, mantendo flexibilidade suficiente para expandir a outros capítulos no futuro.

Como o Computador Aprende a Ver Posturas de Oração

No cerne do sistema está um pipeline visual que primeiro detecta a postura do usuário e depois classifica qual palavra corânica está sendo sinalizada. Todas as imagens são redimensionadas e limpas para um formato padrão. Um kit de ferramentas de software chamado MediaPipe identifica 33 pontos-chave no corpo—como ombros, cotovelos e pulsos—e acompanha suas posições. Essas coordenadas formam uma descrição compacta de cada postura, que é então alimentada a três tipos de modelos de aprendizado de máquina: um perceptron multicamadas customizado (uma rede neural simples), uma máquina de vetores de suporte e uma floresta aleatória composta por muitas pequenas árvores de decisão. Em paralelo, um modelo de deep learning mais poderoso, o ResNet50, analisa a imagem completa para aprender padrões visuais detalhados associados a cada palavra.

Reconhecimento Notavelmente Preciso dos Sinais Corânicos

Para testar o sistema, os autores dividiram seu conjunto de dados em subconjuntos de treinamento, validação e teste e avaliaram com que precisão cada modelo reconhecia os gestos. Todas as abordagens tiveram desempenho sólido, com os modelos baseados em postura identificando corretamente a maioria dos sinais entre 14–16 classes de palavras corânicas. O modelo de floresta aleatória, por exemplo, alcançou pontuações quase perfeitas para muitas palavras, com apenas algumas confusões entre gestos visualmente semelhantes. O modelo combinado baseado em ResNet50, que analisa diretamente as imagens ao mesmo tempo em que se beneficia da informação de postura, alcançou desempenho quase impecável nos dados de teste: todo gesto foi classificado corretamente, e medidas padrão de acurácia, precisão, recall e uma métrica de discriminação chamada ROC–AUC atingiram seus valores máximos. Esses resultados sugerem que até coleções de imagens relativamente pequenas, quando cuidadosamente preparadas, podem sustentar reconhecimento altamente preciso da língua de sinais religiosa.

Promessa, Limites e o Caminho à Frente

Embora os números de desempenho sejam impressionantes, os autores ressaltam que se aplicam apenas às condições controladas do estudo: um único capítulo, um número limitado de sinalizadores e imagens estáticas em vez de sinalização contínua em movimento. O uso no mundo real exigiria conjuntos de dados maiores e mais variados, melhor cobertura dos movimentos da parte inferior do corpo e testes cuidadosos com sinalizadores de diferentes regiões. Mesmo assim, o trabalho demonstra que ferramentas modernas de visão e aprendizado podem reconhecer sinais corânicos de forma confiável e fornecer feedback instantâneo, por exemplo, mostrando uma marca de verificação ou uma animação corretiva quando um aprendiz executa um gesto. Em termos práticos, isso significa que um estudante surdo poderia praticar versos corânicos em língua de sinais diante de uma câmera simples e receber orientação sem precisar de um intérprete ao vivo—um passo importante para tornar o conhecimento sagrado mais acessível a todos.

Citação: AbdElghfar, H., Youness, H.A., Wahba, M. et al. An automated framework for qur’anic education of the hearing-impaired using body pose classification and Arabic sign language integration. Sci Rep 16, 5939 (2026). https://doi.org/10.1038/s41598-026-36578-z

Palavras-chave: Educação corânica, Língua de Sinais Árabe, aprendizes com deficiência auditiva, reconhecimento de postura, tecnologia assistiva