Clear Sky Science · pt

Relatações científicas: transformador gráfico de atenção dupla multirrelacional para análise de sentimento em nível fino

Por que pistas pequenas em avaliações importam

Avaliações online estão cheias de sentimentos mistos: um restaurante pode ter “comida ótima, mas atendimento lento”, ou um celular pode ter uma “tela bonita, porém bateria terrível”. Empresas e pesquisadores querem que computadores entendam esse tipo de opinião detalhada, não apenas se uma avaliação inteira é positiva ou negativa. Este artigo apresenta um novo modelo de inteligência artificial que focaliza partes específicas da frase — como “atendimento” ou “duração da bateria” — e determina exatamente como as pessoas se sentem sobre cada aspecto, mesmo quando as pistas estão dispersas e são sutis.

Indo além do sentimento único e genérico

A análise de sentimento tradicional trata uma frase ou avaliação como um bloco único de texto e decide se, no geral, é positiva ou negativa. Isso funciona para comentários simples, mas falha quando alguém elogia um aspecto e critica outro na mesma frase. A área de Análise de Sentimento Baseada em Aspecto lida com isso perguntando: qual é o sentimento em relação a cada alvo específico, como “atendimento”, “ambiente” ou “equipe” em uma avaliação de restaurante. Métodos anteriores dependeram de regras manuais ou de aprendizado de máquina simples que contavam palavras, evoluindo depois para redes neurais que leem o texto em sequência, como da esquerda para a direita. Esses modelos sequenciais melhoraram a acurácia, mas ainda perdiam ligações de longa distância e sinais sutis, especialmente quando as palavras relevantes estão distantes entre si ou ligadas por termos de contraste como “mas” e “embora”.

Transformando frases em mapas conectados

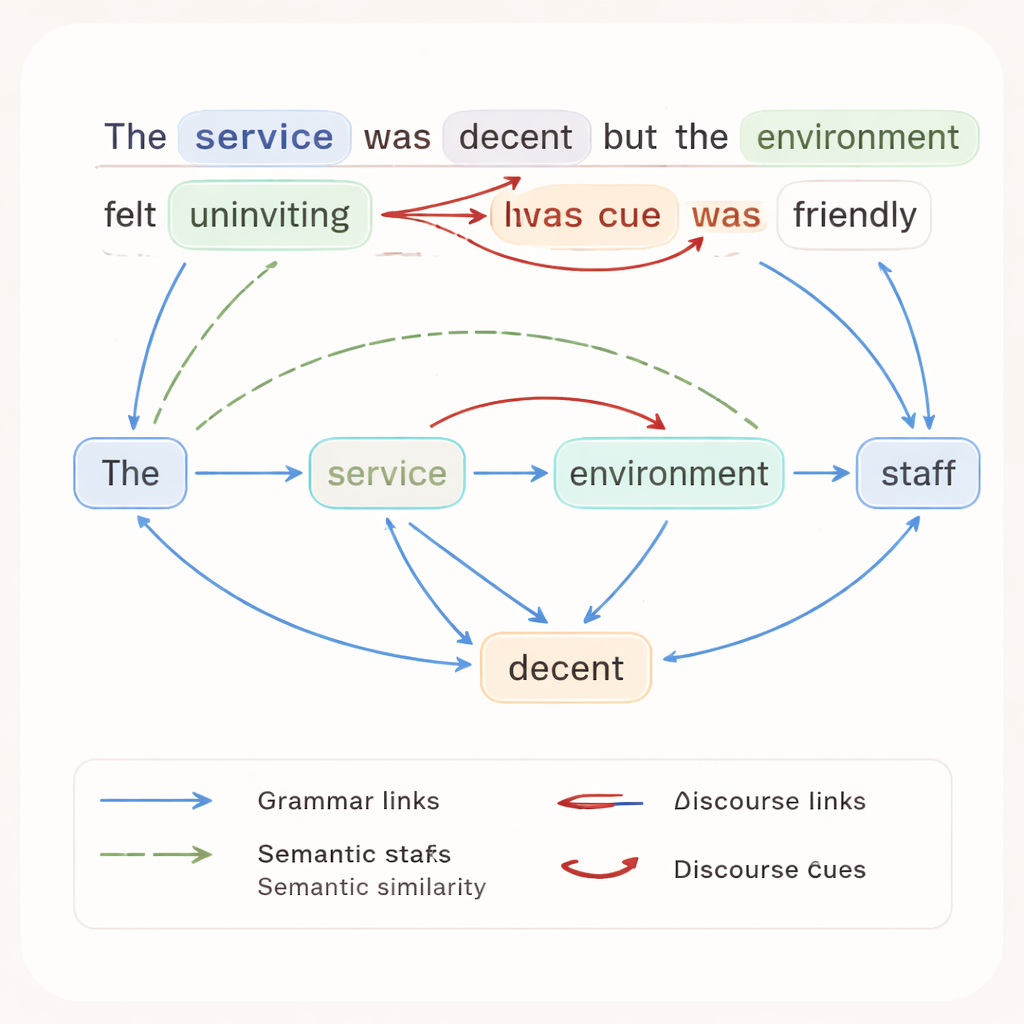

Os autores argumentam que, para entender opiniões em nível fino, um computador deve ver uma frase como uma rede, e não como uma linha reta. Em sua abordagem, cada palavra vira um nó em um grafo, e diferentes tipos de relações se tornam arestas. Um conjunto de arestas captura a gramática, como qual palavra é sujeito ou objeto. Outro conjunto liga palavras com significado semelhante, mesmo que não estejam lado a lado. Um terceiro identifica pistas de discurso — palavras como “mas”, “no entanto” ou “embora” que frequentemente sinalizam mudança de sentimento. Em uma frase como “O atendimento foi razoável, mas o ambiente parecia pouco convidativo embora a equipe fosse simpática”, esse grafo mostra como elogios e críticas se entrelaçam ao redor de diferentes aspectos.

Um duplo foco em contexto e alvos

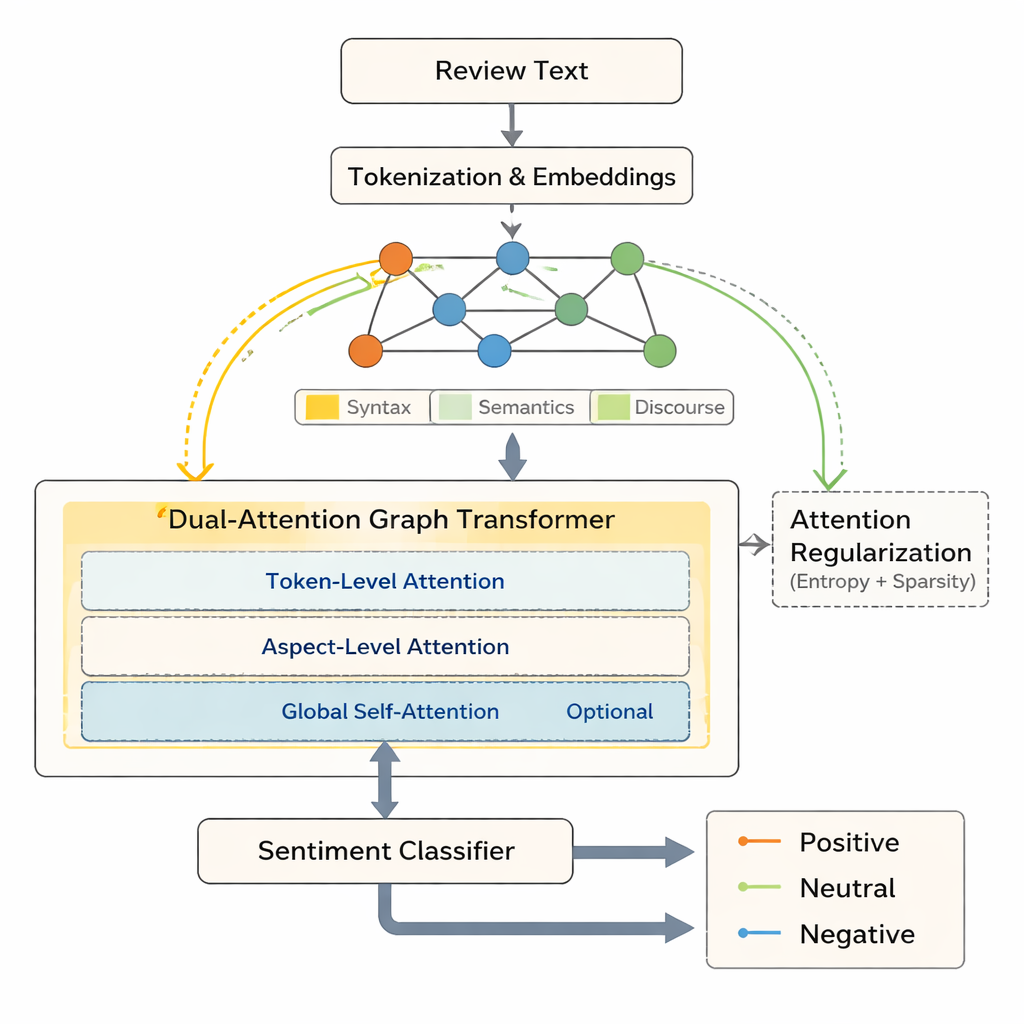

Com base nessa visão em grafo, o artigo apresenta o Transformador Gráfico de Atenção Dupla Multirrelacional (MRDAGT). Esse modelo usa um mecanismo de atenção no estilo Transformer adaptado para grafos. Uma cabeça de atenção observa amplamente como todas as palavras na frase se relacionam, reunindo contexto local útil. Uma segunda cabeça foca especificamente no aspecto em consideração — por exemplo, “atendimento” ou “ambiente” — e aumenta a influência de palavras que moldam opiniões sobre esse alvo, como “razoável” ou “pouco convidativo”. Quando há vários aspectos numa única frase, uma camada opcional de atenção global ajuda o modelo a ponderar as interações entre eles. Na prática, o sistema acende dois holofotes coordenados: um sobre a estrutura geral da frase e outro diretamente sobre o aspecto cujo sentimento se busca avaliar.

Tornando a atenção da máquina mais seletiva e explicável

Uma preocupação chave com IA moderna é que os pesos de atenção — os números que indicam em quais palavras o modelo focou — podem ficar muito dispersos, tornando as decisões difíceis de interpretar. O MRDAGT resolve isso com duas forças de regularização. Uma penalidade de entropia desencoraja atenção excessivamente plana, empurrando o modelo a se concentrar mais nitidamente em poucas palavras importantes. Ao mesmo tempo, um termo de esparsidade L1 empurra muitas ligações de atenção para zero, aparando conexões fracas e ruidosas. Juntas, essas forças criam uma “esparsidade focada”: o modelo tende a atribuir pesos claros e altos a pares palavra–aspecto realmente relevantes enquanto ignora distrações. Experimentos em três conjuntos de referência — avaliações formais de laptops, avaliações complexas com múltiplas frases e posts informais no Twitter — mostram que o MRDAGT supera consistentemente sistemas fortes existentes por cerca de um a dois pontos percentuais em acurácia, além de gerar mapas de atenção mais limpos e interpretáveis.

O que isso significa para mineração de opinião no mundo real

Para não especialistas, a conclusão é que esse modelo oferece uma maneira mais precisa e confiável de extrair opiniões de textos desordenados do mundo real. Em vez de apenas dizer que uma avaliação é “no geral positiva”, o MRDAGT pode relatar separadamente que clientes gostam da velocidade de um aparelho, mas não gostaram da bateria, ou que frequentadores apreciam a equipe de um café, enquanto reclamam do barulho. Como seus padrões de atenção alinham-se com a intuição humana — focando em palavras de contraste, adjetivos de sentimento e termos de aspecto —, fica mais fácil para analistas verem por que o modelo fez determinado juízo. Os autores sugerem que essa abordagem pode apoiar melhores decisões de design de produto, monitoramento mais preciso de redes sociais e futuras extensões para muitos idiomas e até dados multimodais como áudio e imagens, tudo isso mantendo o processo de raciocínio relativamente transparente.

Citação: Anilkumar, A.P., Kim, SK. & Yoon, YC. Scientific reports multi relational dual attention graph transformer for fine grained sentiment analysis. Sci Rep 16, 7236 (2026). https://doi.org/10.1038/s41598-026-36490-6

Palavras-chave: análise de sentimento baseada em aspecto, redes neurais gráficas, atenção do transformer, mineração de opinião, processamento de linguagem natural