Clear Sky Science · pt

Uma rede colaborativa de multi-atenção para detecção em tempo real de pequenos objetos em imagens de VANT

Por que identificar detalhes minúsculos vistos do alto é importante

À medida que drones se tornam ferramentas comuns para monitoramento de tráfego, resposta a desastres e segurança, eles precisam identificar de forma confiável objetos muito pequenos — como carros, bicicletas ou pessoas — vistos de grandes altitudes. Nessas visões aéreas, os alvos ocupam apenas alguns pixels, facilmente perdidos em sombras, reflexos e fundos cheios de elementos. Este artigo apresenta um novo sistema de visão computacional, chamado Collaborative Multi-Attention Network (CMA-Net), projetado para detectar esses pequenos objetos em imagens de drones de forma rápida e precisa o suficiente para uso em tempo real.

Desafios de ver coisas pequenas lá do alto

Detectar pequenos objetos em imagens de drones é mais difícil do que em fotos de rua convencionais. Como os drones voam alto e observam cenas de vários ângulos, veículos e pessoas aparecem minúsculos e desfocados, e a iluminação pode mudar rapidamente. Detectores tradicionais em duas etapas podem ser muito precisos, mas frequentemente são lentos demais para uso em tempo real em plataformas voadoras com poder de processamento e largura de banda limitados. Métodos mais rápidos de etapa única operam em tempo real, porém tendem a perder alvos pequenos porque seus detalhes se diluem à medida que as imagens são processadas camada por camada. Os autores argumentam que uma melhor detecção de pequenos objetos requer formas mais inteligentes de combinar informação em diferentes escalas e focar a atenção computacional nas partes mais informativas da imagem.

Construindo uma escada de características mais inteligente

CMA-Net parte de um backbone amplamente usado no processamento de imagens, o ResNet-50, e adiciona uma Efficient Bi-directional Feature Pyramid Network (E-BiFPN). Essa estrutura constrói uma espécie de escada de mapas de características em diferentes tamanhos, permitindo que o sistema misture detalhes finos de camadas iniciais com contexto mais abstrato de camadas profundas. Diferentemente de designs anteriores, a E-BiFPN remove camadas de alto nível desnecessárias e acrescenta um bloco de processamento leve que usa convoluções parciais para reduzir o custo computacional. Um esquema de fusão ponderada então aprende quanto confiar em características rasas versus profundas em cada escala, de modo que informações frágeis sobre carros ou pedestres minúsculos sejam enfatizadas enquanto o ruído do fundo é reduzido.

Ensinando a rede onde olhar

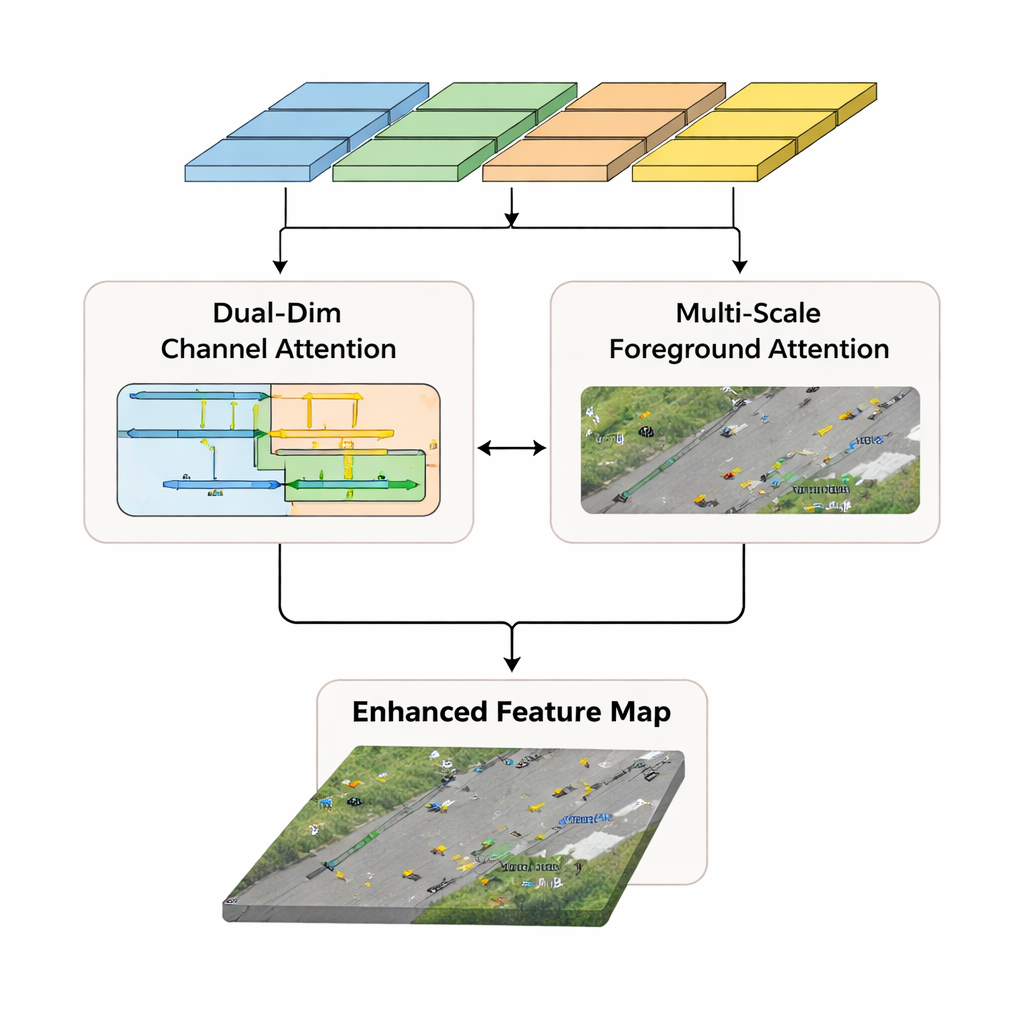

Além de rearranjar características, o CMA-Net usa mecanismos de atenção que imitam como humanos focam nas partes relevantes de uma cena. Um módulo Dual-Dimensional Channel Attention (DDCA) analisa características separadamente ao longo da largura e da altura da imagem, em vez de comprimir tudo em um único resumo global. Esse projeto ajuda a rede a capturar padrões de longo alcance tanto na direção horizontal quanto na vertical, preservando pistas de localização que são cruciais quando pequenos objetos se misturam a cenários complexos. Em paralelo, um módulo Multi-Scale Foreground Attention (MSFA) conecta objetos maiores e facilmente reconhecíveis em camadas profundas com objetos menores em camadas rasas. Ao amostrar e fundir informação de três escalas, o MSFA aprende a realçar regiões de primeiro plano onde veículos provavelmente estão e a suprimir texturas de fundo enganosas.

De características aprimoradas a decisões rápidas

As saídas dos ramos DDCA e MSFA são mescladas em mapas de características ricos e favoráveis a pequenos objetos, que são encaminhados para uma cabeça de detecção "sem âncoras". Em vez de depender de uma grade densa de caixas pré-definidas, essa cabeça prevê diretamente tanto a categoria quanto a posição dos objetos, simplificando os cálculos e tornando o treinamento mais flexível. Os autores avaliaram o CMA-Net em dois conjuntos de dados públicos exigentes para drones, UAVDT e Stanford Drone, que incluem estradas lotadas, variações climáticas e condições dia–noite. O CMA-Net alcançou pontuações de precisão de 67,2% e 62,0% nesses conjuntos enquanto rodava a 64 quadros por segundo, o que significa que pode processar vídeo em tempo real superando muitos detectores populares, incluindo alguns da família YOLO e modelos mais complexos baseados em transformers.

O que isso significa para o uso real de drones

Para não-especialistas, a principal conclusão é que o CMA-Net melhora significativamente a capacidade de um drone de notar objetos pequenos e difíceis de ver sem torná-lo mais lento. Ao fundir cuidadosamente informação por múltiplas escalas e guiar a atenção da rede tanto ao longo dos canais de imagem quanto entre primeiro plano e fundo, o método evita que veículos e pessoas minúsculos sejam negligenciados. Essa combinação de precisão e velocidade torna a abordagem promissora para aplicações práticas, como monitoramento inteligente de tráfego, observação de multidões e resposta a emergências, onde perder um pequeno objeto ou reagir de forma lenta pode ter consequências graves.

Citação: Yang, J., Yue, X. & Wu, L. A collaborative multi-attention network for real-time small object detection in UAV imagery. Sci Rep 16, 5852 (2026). https://doi.org/10.1038/s41598-026-36440-2

Palavras-chave: visão por drone, detecção de pequenos objetos, vigilância em tempo real, redes de atenção, monitoramento de tráfego