Clear Sky Science · pt

Desacoplamento de conteúdo e estilo para geração de imagens com múltiplos estilos usando arquitetura de difusão latente

Por que estilos de imagem mais inteligentes importam

De pôsteres de filmes e artes de jogos a filtros de redes sociais, cada vez mais esperamos que as imagens sejam ao mesmo tempo visualmente impactantes e altamente personalizadas. Mas nos bastidores, muitos sistemas de transferência de estilo ainda enfrentam problemas: podem deformar o rosto de uma pessoa, entortar edifícios ou exigir hardware pesado. Este artigo apresenta um novo modelo de IA que promete estilos artísticos mais ricos mantendo a imagem original intacta e rodando com eficiência suficiente para dispositivos do dia a dia.

Separando “o que é” de “como parece”

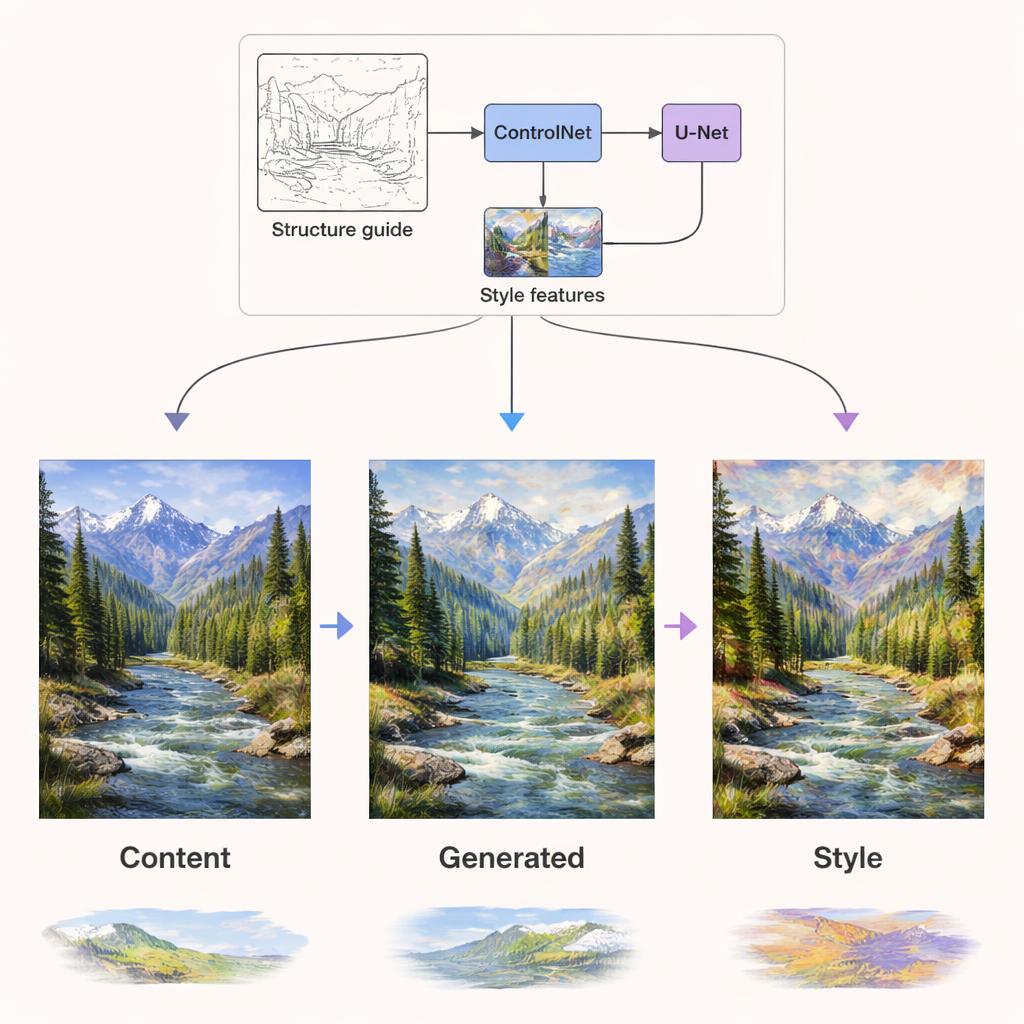

No cerne deste trabalho está um modelo chamado Modelo de Difusão Leve com Dupla Condição de Estilo (DCLSDM). A ideia-chave é tratar a substância de uma imagem — os objetos, o layout e a cena — como um “canal”, e o tratamento artístico — cores, texturas, pinceladas — como outro, e controlá‑los separadamente. Em vez de deixar uma única rede embaralhar esses dois aspectos, o DCLSDM usa duas vias dedicadas: uma para conteúdo e outra para estilo. O caminho de conteúdo foca em entender formas e significados na imagem de entrada ou descrição em texto, enquanto o caminho de estilo foca em aprender o caráter visual de uma obra escolhida ou de uma descrição de estilo.

Como o novo modelo é construído

O DCLSDM se baseia em modelos de difusão, a mesma família de técnicas por trás de muitos geradores de imagem modernos. Em vez de trabalhar diretamente em imagens em resolução total, ele opera em um espaço “latente” comprimido, que é muito mais eficiente. Um módulo chamado Perceiver IO extrai o conteúdo: recebe uma imagem ou legenda e destila a geometria e a semântica da cena em uma representação compacta. Um módulo de estilo separado lê uma ou mais imagens de estilo ou textos e as converte em vetores de características de estilo. Essas características de estilo podem ser misturadas com um esquema de interpolação ponderada, permitindo transições suaves entre, por exemplo, um visual impressionista e um minimalista sem a média “lamacenta” habitual.

Preservando a estrutura enquanto muda o estilo

No interior da rede de difusão que realmente gera a imagem, os dois tipos de informação são injetados por rotas independentes. Sinais de conteúdo guiam as camadas da rede que se preocupam com a estrutura — onde arestas, objetos e layouts devem ficar. Sinais de estilo são injetados por camadas de atenção dedicadas que moldam principalmente texturas, cores e traços de pincel. Além disso, um componente chamado ControlNet adiciona orientação estrutural extra usando mapas de bordas ou profundidade extraídos do conteúdo original. Essa combinação permite que o sistema repinte uma paisagem de verão em uma paleta de inverno, ou represente uma fotografia como uma pintura ao estilo Van Gogh, mantendo montanhas, árvores e edifícios no lugar certo e sem distorções.

Melhor qualidade, mais estilos, menos computação

Os autores testam rigorosamente o DCLSDM em dois conjuntos de dados públicos: WikiArt, que abrange dezenas de movimentos artísticos, e Summer2Winter Yosemite, que foca em mudanças sazonais numa paisagem. Eles comparam seu modelo com uma variedade de sistemas de ponta usados tanto na pesquisa quanto na indústria. Em métricas de similaridade estrutural, qualidade visual percebida e quão próximas as imagens geradas se parecem com obras reais, o DCLSDM pontua consistentemente mais alto. Ele também roda mais rápido, usa menos memória e tem menos parâmetros do que muitos concorrentes, ainda oferecendo mistura flexível de múltiplos estilos e suportando entrada de estilo tanto por imagem quanto por texto.

O que isso significa para a criatividade do dia a dia

Na prática, este trabalho mostra que é possível dar aos usuários controle fino sobre a aparência de uma imagem sem sacrificar o que a imagem mostra — e fazer isso em hardware mais modesto. Designers podem explorar rapidamente muitos tratamentos artísticos de um mesmo layout, apps móveis podem oferecer filtros mais ricos que não deformam rostos ou cenas, e projetos de patrimônio cultural podem reestilizar fotos antigas preservando detalhes estruturais cruciais. Ao separar de forma limpa conteúdo e estilo dentro de um framework moderno de difusão, o DCLSDM aponta para um futuro em que ferramentas criativas de imagem são ao mesmo tempo mais poderosas e mais confiáveis para uso cotidiano.

Citação: Chu, K., Shang, Y., Zhang, L. et al. Content style decoupling for multi style image generation using latent diffusion architecture. Sci Rep 16, 6642 (2026). https://doi.org/10.1038/s41598-026-36407-3

Palavras-chave: transferência de estilo de imagem, modelos de difusão, desacoplamento conteúdo‑estilo, geração de arte digital, geração de imagem eficiente