Clear Sky Science · pt

Um modelo profundo de sentimento que combina contexto conduzido por ALBERT e arquitetura otimizada por EHO

Por que uma Leitura de Sentimentos Mais Inteligente Importa

Todo dia, milhões de pessoas compartilham opiniões sobre produtos, serviços, política e eventos na internet. Transformar esse fluxo de textos em insights confiáveis é vital para empresas, governos e pesquisadores. Ainda assim, nossa linguagem online é confusa: piadas sarcásticas, gírias, erros de digitação e emoções raras podem facilmente confundir computadores. Este artigo apresenta um novo sistema de análise de sentimento que busca ler essas emoções com mais precisão, usando menos poder computacional do que muitos modelos atuais de inteligência artificial.

De Contagens Simples de Palavras a uma Leitura Sensível ao Contexto

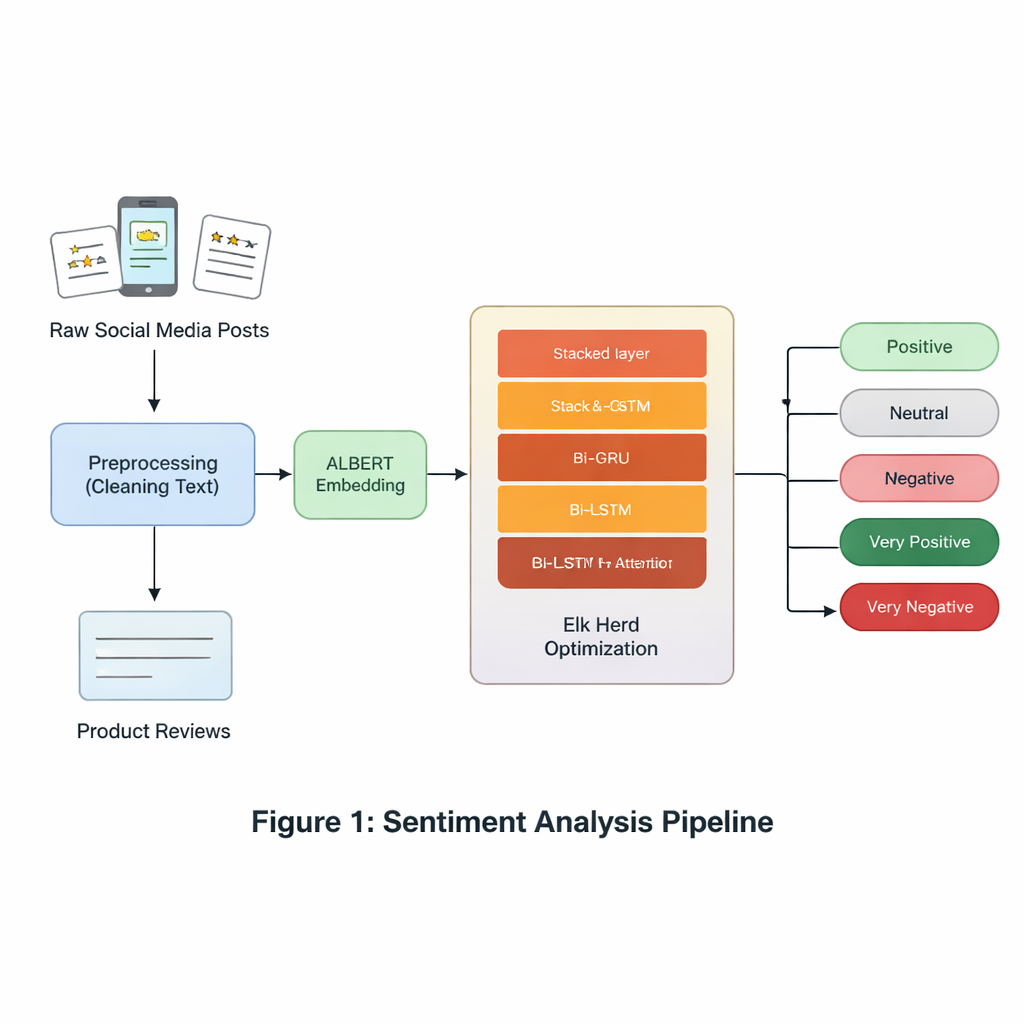

Ferramentas iniciais de análise de sentimento tratavam o texto como um saco de palavras desconectadas, contando com que frequência termos como “bom” ou “terrível” apareciam. Essa abordagem ignorava a ordem das palavras e contextos sutis, como “não é ruim” significando algo mais próximo de “bem bom”. Métodos de aprendizado profundo melhoraram isso ao processar o texto como sequências, mas frequentemente exigiam vastos conjuntos rotulados e grande poder de computação. Modelos Transformer como o BERT aumentaram ainda mais a precisão, mas seu grande porte os torna caros de rodar em cenários reais, como plataformas de atendimento ao cliente ou sistemas de monitoramento de redes sociais. Os autores deste trabalho respondem a esse desafio combinando diversos componentes mais leves, porém poderosos, em um sistema enxuto.

Um Cérebro Mais Enxuto para Entender Texto

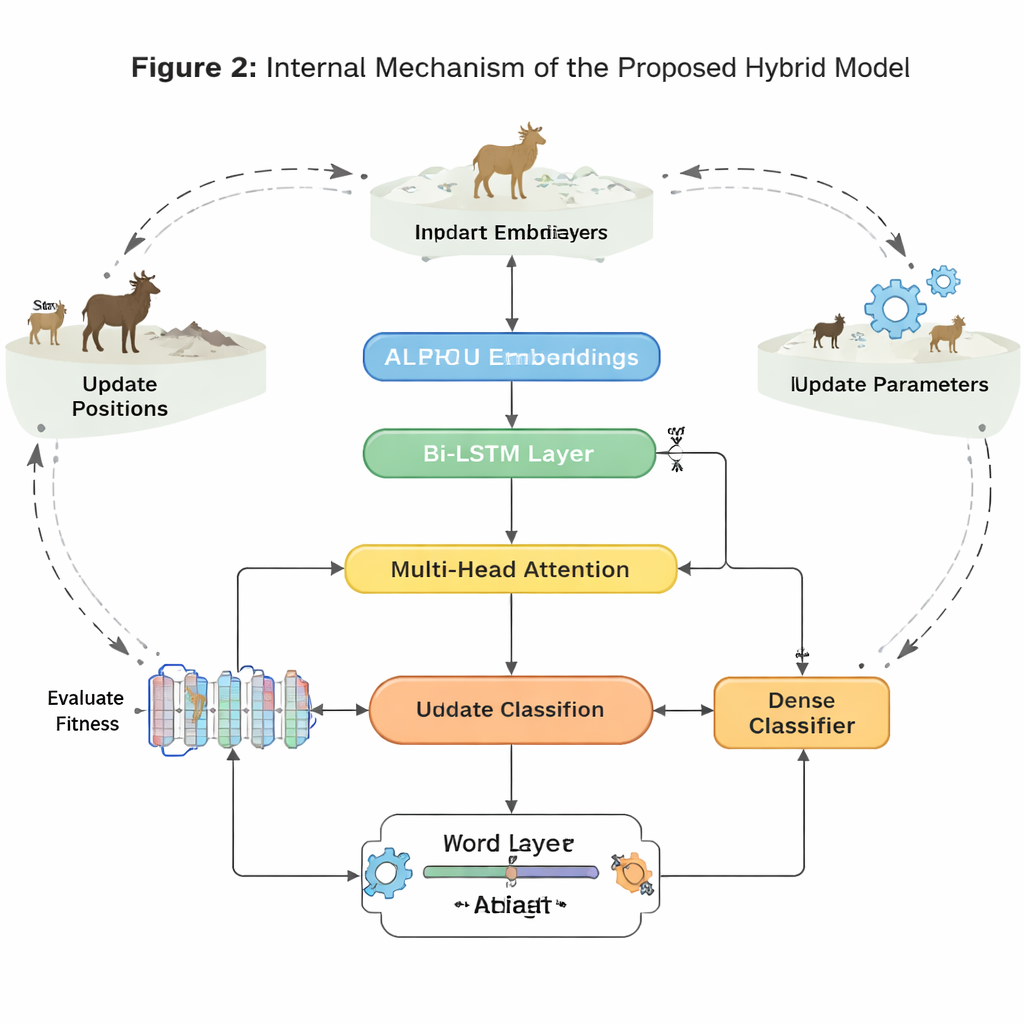

No centro do modelo está o ALBERT, um primo compacto do modelo de linguagem BERT. O ALBERT transforma cada palavra de uma sentença em uma representação numérica sensível ao contexto, capturando como os significados mudam dependendo das palavras vizinhas. Diferentemente de modelos maiores, o ALBERT reduz o uso de memória ao compartilhar parâmetros entre camadas e compactar seu vocabulário de palavras. Isso facilita sua execução em hardware padrão sem sacrificar grande parte do entendimento. Essas representações de palavras baseadas em ALBERT tornam-se a entrada para uma sequência de camadas especializadas que se concentram em como os sentimentos se desenvolvem ao longo de uma frase.

Deixando Dois Sistemas de Memória Trabalharem Juntos

Para acompanhar como o sentido muda de palavra para palavra, o sistema usa dois tipos de redes recorrentes: GRUs (Gated Recurrent Units) e LSTMs (Long Short-Term Memory), cada uma operando nas direções direta e reversa. GRUs são eficientes em rastrear frases curtas com menos parâmetros, enquanto LSTMs são melhores em reter informação por trechos mais longos de texto. Ao empilhar uma camada GRU bidirecional sobre uma camada LSTM bidirecional e adicionar um mecanismo de atenção, o modelo pode destacar as partes mais carregadas de sentimento de cada sentença — como a expressão “exceto a duração da bateria” em uma avaliação por outro lado positiva. Esse desenho híbrido busca capturar tanto mudanças rápidas de tom quanto contexto de longo alcance que pode inverter o sentimento geral.

Ajuste Inspirado na Natureza para Casos Difíceis

Além da arquitetura, os autores enfrentam um obstáculo chave do mundo real: conjuntos de dados de sentimento costumam ser desequilibrados e ruidosos. Emoções como nojo ou surpresa, e enunciados neutros, aparecem com menos frequência do que os claramente positivos ou negativos, levando muitos modelos a ignorá‑los. Para contornar isso, o artigo usa Elk Herd Optimization, uma estratégia de busca inspirada na natureza modelada em como os alces se movem, competem e formam grupos. Depois que a rede neural produz vetores internos de sentimento, essa etapa de otimização ajusta finamente como esses vetores representam cada classe, especialmente as raras, ao melhorar iterativamente uma pontuação de “fitness”. Esse processo ajuda o modelo a evitar soluções superficiais e melhora sua capacidade de distinguir emoções sutis ou sub‑representadas.

Submetendo o Modelo ao Teste

Os autores avaliam seu sistema em seis conjuntos de dados amplamente usados, incluindo postagens no Twitter, avaliações de restaurantes e laptops e um benchmark de resenhas de filmes com cinco níveis que distingue opiniões muito positivas e muito negativas de opiniões mais moderadas. Nestas fontes variadas, a nova abordagem supera de forma consistente vários concorrentes avançados baseados em grafos e Transformers, tanto em acurácia quanto em pontuação F1, uma métrica que equilibra acertos corretos e casos perdidos. Os ganhos são especialmente fortes na tarefa de cinco classes das resenhas de filmes e nas classes de sentimento sub‑representadas, mostrando que o método lida tanto com emoção fina quanto com dados desequilibrados. Um estudo de ablação, no qual componentes são removidos um a um, confirma que ALBERT, o design combinado GRU–LSTM, a atenção e a otimização inspirada nos alces contribuem cada um para o desempenho global.

O Que Isso Significa para Aplicações Cotidianas

Para não especialistas, a principal conclusão é que esta pesquisa oferece uma forma mais eficiente e confiável de interpretar grandes volumes de opinião online. Ao mesclar um modelo de linguagem compacto com camadas de memória complementares e uma etapa de ajuste inspirada biologicamente, o sistema lê nas entrelinhas com mais precisão, especialmente quando os sentimentos são sutis ou os dados são enviesados. Isso o torna promissor para usos do mundo real, como rastrear satisfação do cliente, monitorar atitudes de saúde pública ou avaliar reações a políticas e eventos, onde tanto a precisão quanto o custo computacional são importantes.

Citação: Oqaibi, H., Sharma, S. A deep sentiment model combining ALBERT-driven context and EHO-optimized architecture. Sci Rep 16, 5784 (2026). https://doi.org/10.1038/s41598-026-36389-2

Palavras-chave: análise de sentimento, ALBERT, aprendizado profundo, classificação de texto, otimização metaheurística