Clear Sky Science · pt

Arquitetura adaptativa transformadora sensível a séries temporais ADAT para tradução de língua de sinais

Fechando a lacuna de comunicação

Para milhões de pessoas surdas e com deficiência auditiva, tarefas cotidianas como visitar um médico ou assistir a um boletim meteorológico podem ser mais difíceis do que deveriam, simplesmente porque intérpretes qualificados de língua de sinais são raros. Este artigo apresenta um novo sistema de inteligência artificial chamado ADAT que transforma vídeos em língua de sinais em sentenças escritas com mais precisão e eficiência do que muitos sistemas existentes, aproximando-nos de tradução em tempo real e amplamente disponível em telefones, tablets e computadores hospitalares.

Por que a língua de sinais é difícil para computadores

As línguas de sinais são ricas e complexas, com gramática própria, e dependem de muito mais do que movimentos das mãos. Expressões faciais, postura corporal e tempo sutil alteram o significado de uma sentença assinada. Sistemas modernos de tradução frequentemente usam um design de IA poderoso conhecido como transformer, muito eficaz em entender frases longas em linguagem falada ou escrita. Mas quando se trata de vídeo em alta velocidade — 30 a 60 quadros por segundo — esses sistemas podem se tornar lentos e ter dificuldade em perceber movimentos rápidos e de alta resolução que distinguem um sinal do outro. Também exigem muita potência computacional e tempo de treinamento, o que dificulta mantê-los atualizados conforme as línguas de sinais evoluem.

Uma forma mais inteligente de ler a assinatura

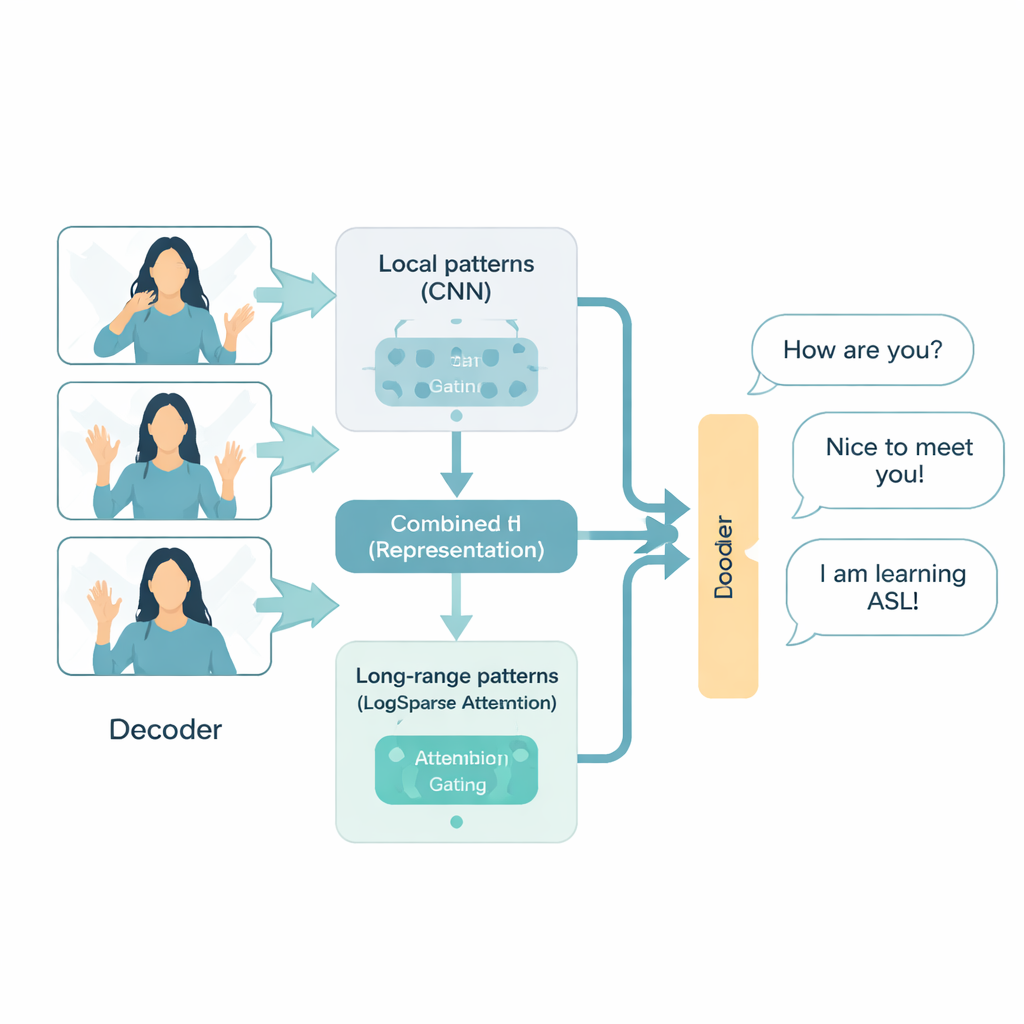

A arquitetura ADAT é projetada especificamente para vídeo de língua de sinais, tratando-o como uma série temporal: um fluxo rápido de eventos visuais que se desenrolam ao longo do tempo. Ela combina três ideias. Primeiro, usa redes neurais convolucionais, uma técnica comprovada em imagens, para focalizar padrões locais como formatos de mão e pistas faciais. Segundo, emprega uma forma mais eficiente de atenção, que revisita seletivamente momentos-chave do vídeo em vez de comparar cada quadro com todos os outros. Terceiro, um “portão” adaptativo aprende a mesclar informações detalhadas de curto prazo com contexto mais amplo de longo prazo, decidindo dinamicamente o que importa mais para cada parte de uma sentença. Juntas, essas partes permitem que o ADAT capture tanto o movimento rápido de um dedo quanto a estrutura geral de uma conversa sem desperdiçar computação.

De sinais a palavras de duas maneiras

A tradução de língua de sinais pode ser organizada em duas etapas principais: primeiro reconhecer as unidades básicas da sinalização, conhecidas como glossas, e então transformar essas glossas em texto falado ou escrito. Isso é chamado de sinal-para-glossa-para-texto. Alternativamente, um sistema pode tentar ir diretamente do vídeo para o texto em um único passo, chamado sinal-para-texto. Os autores testam o ADAT em ambos os estilos. Eles o comparam com vários fortes baselines baseados em transformer, incluindo um sistema bem conhecido chamado SLTUNET, em três conjuntos de dados: um grande corpus alemão de previsões meteorológicas, uma coleção de Língua de Sinais Indiana, e um novo conjunto de dados de Língua de Sinais Americana voltado para contexto médico que os autores criaram para refletir conversas realistas entre médico e paciente.

Treinamento mais rápido e traduções mais nítidas

Em todos esses testes, o ADAT iguala ou supera os melhores modelos concorrentes em qualidade de tradução, medida por pontuações BLEU padrão, enquanto treina de forma perceptivelmente mais rápida. No esquema em duas etapas sinal-para-glossa-para-texto, entrega pontuações similares ou ligeiramente melhores que um transformer clássico, mas reduz o tempo de treinamento em cerca de um quinto, em média. No mais desafiador esquema direto sinal-para-texto, o ADAT supera claramente baselines apenas codificador, apenas decodificador e transformers unificados, muitas vezes melhorando a precisão em cerca de um ponto percentual ou mais, novamente com aproximadamente 20% de treinamento mais rápido. A análise detalhada da matemática subjacente mostra que a atenção mais seletiva e o design de caminho duplo do ADAT reduzem substancialmente o número de operações necessárias, especialmente ao lidar com vídeos longos ou de alta taxa de quadros.

Novos dados para conversas críticas

Para garantir que esses métodos se estendam além do ambiente de laboratório, os autores introduzem o MedASL, o primeiro conjunto de dados em Língua de Sinais Americana focado em comunicação médica. Ele consiste em 500 sentenças únicas e cuidadosamente projetadas que simulam interações reais entre pacientes e profissionais de saúde e inclui anotações tanto de glossas quanto de texto. Esse foco médico importa porque equívocos em um hospital ou clínica podem ter consequências sérias, e conjuntos de dados existentes raramente cobrem esse domínio. O ADAT apresenta desempenho forte no MedASL, embora os resultados também revelem o quão desafiador é para qualquer sistema generalizar perfeitamente para sentenças novas do mundo real.

O que isso significa para a vida cotidiana

Em termos simples, o estudo mostra que podemos construir sistemas de tradução de língua de sinais que são ao mesmo tempo mais inteligentes e mais enxutos: precisam de menos tempo e poder computacional para treinar, e ainda capturam melhor as sutilezas da sinalização. O ADAT ainda não é um intérprete plug-and-play para toda língua de sinais em toda situação, e ainda fica atrás de sistemas que se apoiam em modelos pré-treinados gigantes. Mas ao focar em padrões de vídeo sensíveis ao tempo e em eficiência, aponta o caminho para ferramentas práticas que um dia poderão rodar em dispositivos comuns, suportar múltiplas línguas de sinais e ajudar usuários surdos a se comunicarem mais facilmente em cenários críticos como saúde, resposta a emergências e serviços públicos.

Citação: Shahin, N., Ismail, L. ADAT novel time-series-aware adaptive transformer architecture for sign language translation. Sci Rep 16, 6551 (2026). https://doi.org/10.1038/s41598-026-36293-9

Palavras-chave: tradução de língua de sinais, transformer adaptativo, atenção para séries temporais, ASL médico, IA acessível