Clear Sky Science · pt

IASUNet: extração de edificações baseada em Swin-UperNet com atenção aprimorada

Por que identificar cada edifício a partir do espaço importa

À medida que as cidades crescem e o clima muda, saber exatamente onde estão os edifícios — e como eles evoluem ao longo do tempo — tornou-se essencial. Desde planejar bairros mais seguros e rastrear construções irregulares até orientar a resposta a desastres após cheias ou terremotos, mapas detalhados de edificações são hoje um ingrediente central de cidades inteligentes e resilientes. Este artigo apresenta o IASUNet, um novo sistema de inteligência artificial que aprende a identificar automaticamente edifícios a partir de imagens de satélite de alta resolução com precisão notável, mesmo em cenas do mundo real confusas e densas.

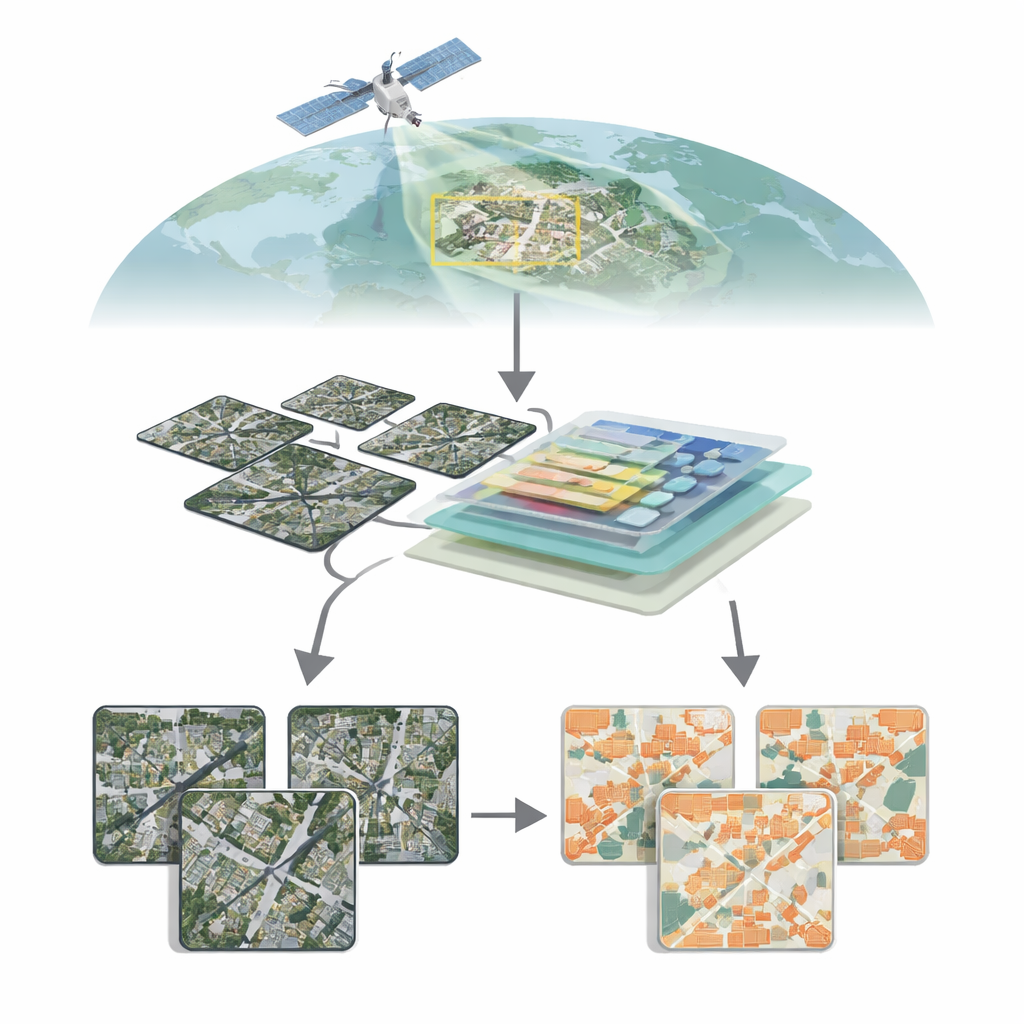

Observando as cidades do alto

Satélites modernos conseguem fotografar a Terra com detalhe extraordinário, revelando telhados individuais, ruas e até becos estreitos. Transformar esse mar de pixels em mapas limpos de edificações, no entanto, está longe de ser trivial. Os edifícios variam muito em tamanho, forma, cor e entorno: arranha-céus de vidro em centros urbanos, casas baixas na periferia, construções agrícolas espalhadas no campo. Em áreas rurais ou mistas, os edifícios podem ocupar apenas uma fração minúscula de cada imagem, enquanto vegetação, solo e água predominam. Métodos tradicionais de visão computacional, baseados principalmente em redes neurais convolucionais, podem ter dificuldade em capturar o panorama geral de toda a cena ao mesmo tempo em que preservam limites finos, levando a estruturas pequenas perdidas ou bordas borradas.

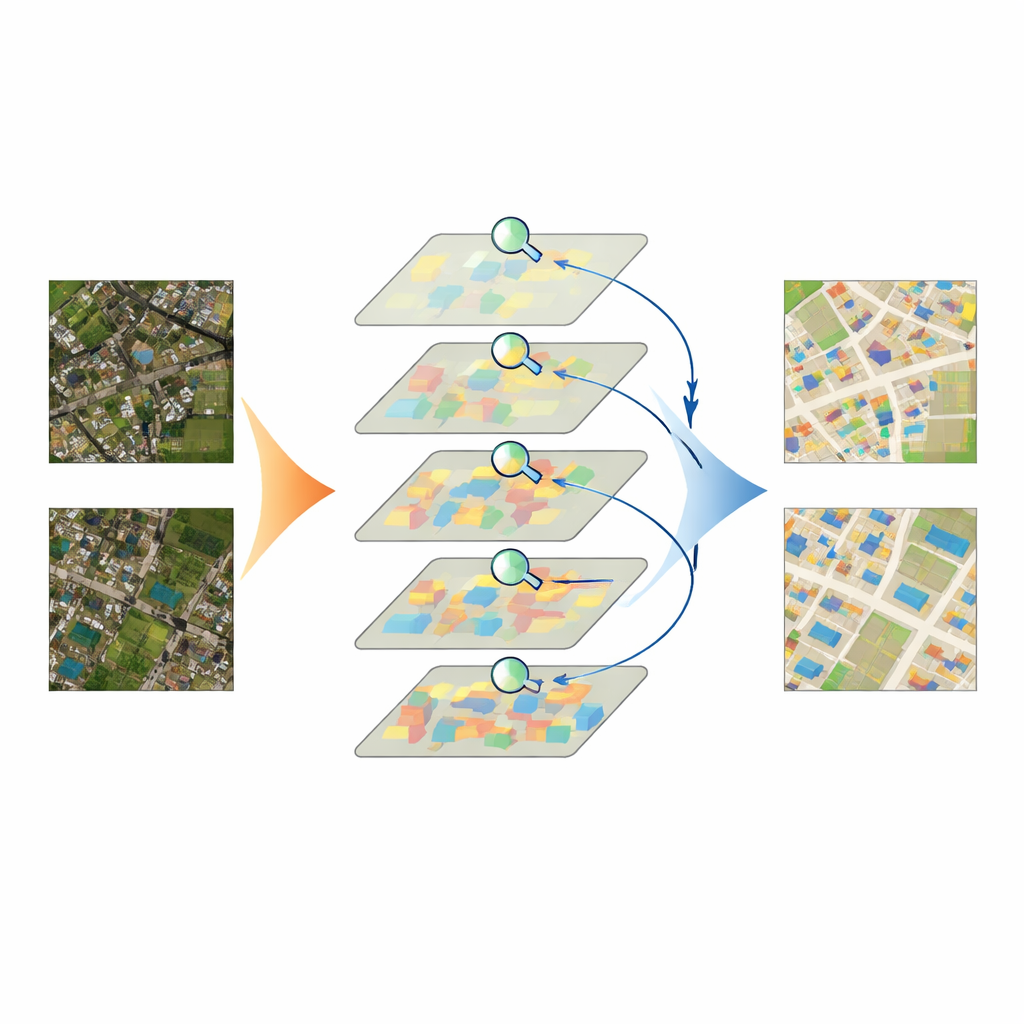

Uma atenção mais inteligente aos detalhes

O IASUNet enfrenta esses desafios combinando duas ideias poderosas: um codificador baseado em Transformer chamado Swin Transformer e um decodificador flexível conhecido como UperNet. O Swin Transformer divide a imagem em muitos pequenos blocos e aprende como eles se relacionam entre si ao longo de toda a cena, em vez de olhar apenas por uma janela de tamanho fixo. Isso ajuda o modelo a entender o contexto mais amplo — por exemplo, se um retângulo claro está dentro de um quarteirão denso ou em um campo isolado — enquanto ainda preserva detalhes. Além disso, os autores inserem um mecanismo de atenção chamado Convolutional Block Attention Module (CBAM) em várias etapas. O CBAM aprende, canal por canal e região por região, quais características da imagem têm maior probabilidade de pertencer a edifícios e quais são ruído de fundo, reforçando as primeiras e suprimindo as últimas antes que o decodificador reconstrua o mapa completo de edificações.

Equilibrando as probabilidades quando edifícios são raros

Outro obstáculo prático é o desequilíbrio: em muitas cenas de satélite, a maioria dos pixels mostra ruas, campos, árvores ou água, enquanto os edifícios ocupam apenas pequenas ilhas. Métodos de treinamento padrão tendem a favorecer o que aparece com mais frequência, o que corre o risco de ensinar o modelo a tratar edifícios menos comuns como coadjuvantes. Para contornar isso, os autores adaptam uma função de perda chamada Focal Cross‑Entropy. Essa estratégia reduz a influência de pixels de fundo “fáceis” e amplifica o impacto de pixels de edifício difíceis de classificar durante o treinamento. Como resultado, o modelo presta atenção extra a estruturas pequenas, fracas ou incomuns que de outra forma seriam negligenciadas, melhorando a sensibilidade sem inundar o mapa com alarmes falsos.

Submetendo o modelo ao teste

A equipe testou o IASUNet em três conjuntos de dados de edificações bem conhecidos da Alemanha, Nova Zelândia e Estados Unidos, além de uma coleção cuidadosamente curada de imagens de satélite chinesas que prepararam e verificaram quanto à qualidade. Nesses benchmarks, o IASUNet consistentemente igualou ou superou abordagens de ponta, incluindo fortes redes convolucionais e outros modelos baseados em Transformer. No conjunto de dados ultra‑detalhado de Potsdam, atingiu sobreposição quase perfeita entre as regiões previstas e as verdadeiras de edifícios, mantendo velocidades práticas em hardware gráfico moderno. Mesmo em paisagens mais irregulares, onde edificações estão espalhadas, parcialmente ocultas ou muito próximas, o IASUNet traçou contornos mais limpos, capturou mais alvos pequenos e evitou muitas das omissões e erros de limite observados em métodos concorrentes.

Dos pixels a cidades melhores

Em termos práticos, o estudo mostra que agora podemos ensinar computadores a ler paisagens urbanas a partir da órbita com clareza sem precedentes. Ao direcionar cuidadosamente a “atenção” do modelo para as partes certas da imagem e ao ponderar deliberadamente pixels raros mas cruciais de edifícios, o IASUNet transforma imagens brutas de satélite em mapas de edificações precisos e atualizados com custo computacional extra modesto. Tais mapas podem alimentar planejamento urbano, estudos de energia e ilhas de calor, regulamentação do uso do solo e avaliação rápida de danos após desastres. Embora o trabalho seja técnico em sua essência, sua conclusão é simples: IA mais inteligente pode oferecer aos tomadores de decisão uma visão mais nítida e confiável do ambiente construído, ajudando as cidades a crescer de formas mais seguras e sustentáveis.

Citação: Zhang, H., Ma, Y., Wang, G. et al. IASUNet: building extraction based on impoved attention Swin-UperNet. Sci Rep 16, 7969 (2026). https://doi.org/10.1038/s41598-026-36270-2

Palavras-chave: sensoriamento remoto, extração de edificações, segmentação semântica, redes transformer, mapeamento urbano