Clear Sky Science · pt

Um framework de aprendizado híbrido integrando evolução caótica Niche alpha para previsão do desempenho acadêmico de estudantes

Por que prever notas cedo importa

As escolas acumulam cada vez mais um verdadeiro tesouro de informações sobre seus alunos — desde registros de frequência e notas de trabalhos até respostas de pesquisas sobre a vida em casa e hábitos de estudo. Este artigo explora como transformar esses dados brutos em alertas precoces sobre quem pode ter dificuldades ou se destacar numa disciplina. Os autores apresentam um novo framework computacional que prevê com mais precisão as notas finais de estudantes do ensino médio, abrindo caminho para intervenções mais precoces e personalizadas em vez de esforços de socorro de última hora.

De boletins a trilhas ricas de dados

Salas de aula modernas geram muito mais do que algumas notas de prova. O conjunto de dados usado neste estudo inclui 480 alunos e 32 diferentes informações para cada um: idade, histórico familiar, tempo de deslocamento, acesso à internet, tempo dedicado ao estudo, faltas e três notas de curso ao longo do ano letivo. Juntos, esses detalhes traçam uma jornada de aprendizagem — como esforço, circunstâncias e resultados anteriores se acumulam até a nota final. Ainda assim, essa riqueza também torna a previsão mais difícil: os dados são ruidosos, irregulares e altamente variados de um aluno para outro.

Uma forma mais inteligente de ler a aprendizagem ao longo do tempo

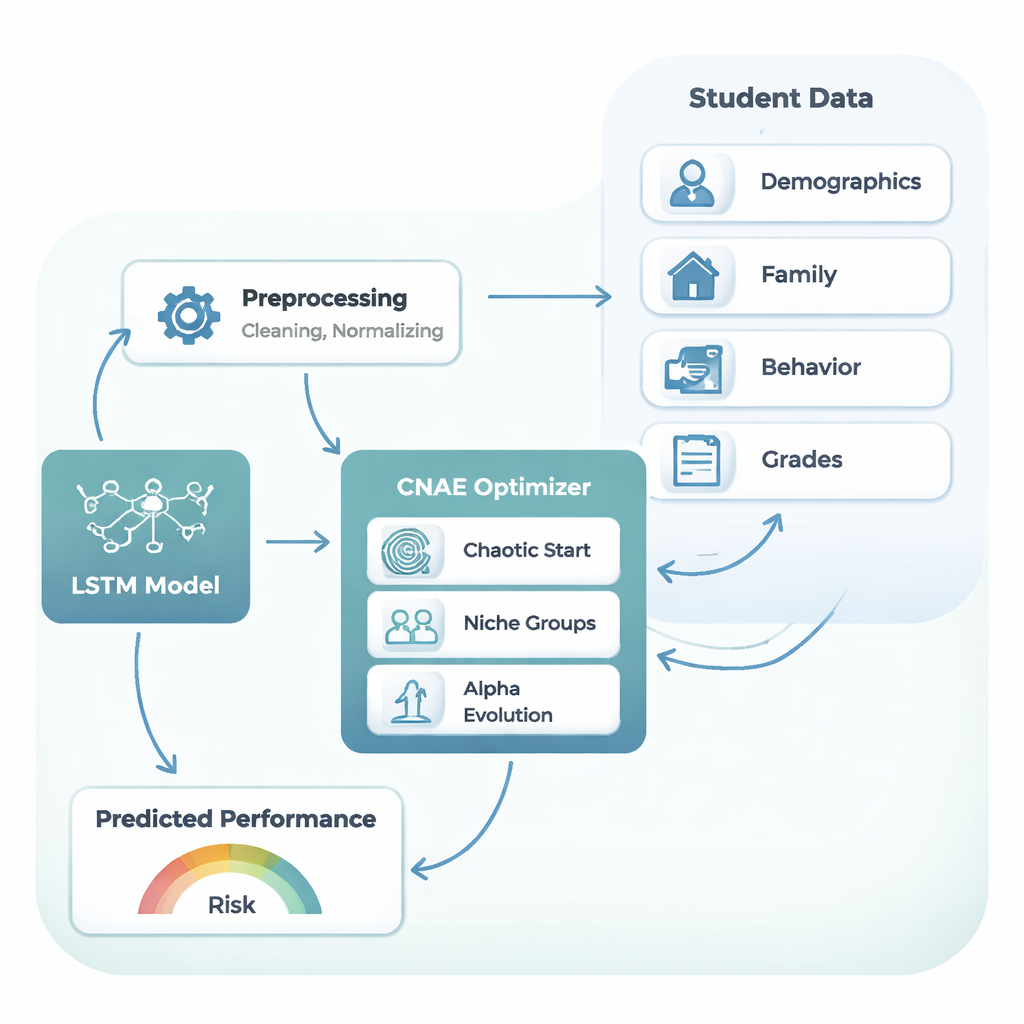

Para acompanhar essas jornadas de aprendizagem, os autores usam um tipo de rede neural chamada Long Short-Term Memory, ou LSTM. Em vez de tratar cada dado como um fato desconectado, uma LSTM é projetada para lembrar sinais úteis de pontos anteriores em uma sequência — muito parecido com um professor que percebe a melhora constante de um aluno ou seu desengajamento gradual, em vez de olhar apenas para o último quiz. Neste estudo, a LSTM recebe a combinação de fatores de contexto, comportamento e notas prévias e produz uma previsão da nota do exame final numa escala de 0 a 20. Contudo, LSTMs são sensíveis: seu desempenho depende fortemente de escolhas de projeto, como quantas camadas têm, quantas unidades por camada, a taxa de aprendizado, o nível de regularização e quantos registros de alunos são vistos por vez durante o treinamento.

Deixando a evolução buscar o melhor modelo

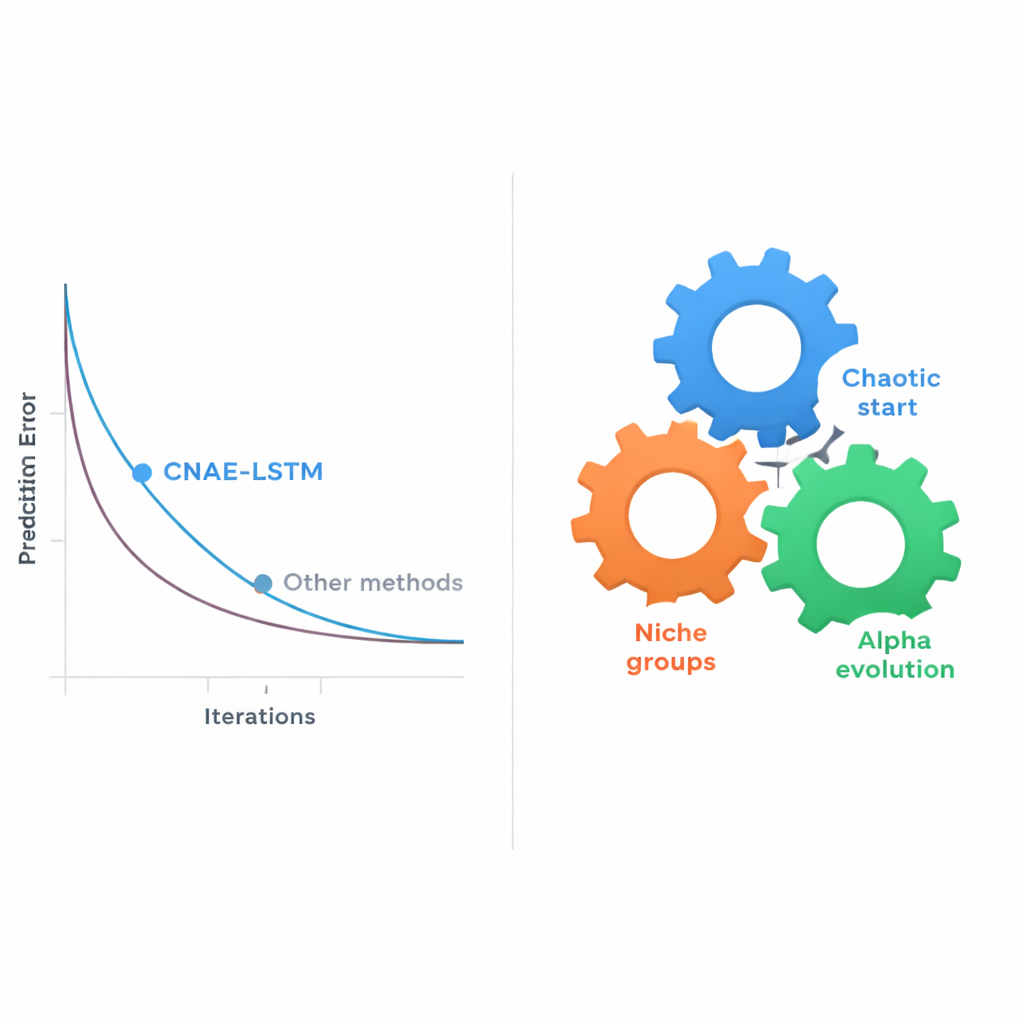

Escolher esses parâmetros manualmente — ou mesmo por grades de tentativa e erro simples — rapidamente se torna impraticável conforme as combinações se multiplicam. O cerne deste artigo é uma nova estratégia automática de busca chamada Evolução Caótica Niche Alpha (Chaotic Niche Alpha Evolution, CNAE), que os autores combinam com a LSTM, formando o framework CNAE‑LSTM. A CNAE começa gerando uma grande variedade de candidatos a projeto de LSTM usando um processo matemático inspirado pelo caos, garantindo que as opções iniciais estejam bem distribuídas pelo espaço de busca. Em seguida, agrupa candidatos semelhantes em “nichos”, mantendo apenas o exemplar mais forte de cada cluster enquanto os muta ligeiramente para sondar possibilidades próximas. Finalmente, uma etapa de “evolução alpha” empurra a busca em direção às regiões mais promissoras ao mesmo tempo em que faz uma transição gradual de exploração ampla para ajuste fino. Cada LSTM candidata é avaliada pelo quão bem prevê as notas em um conjunto de validação reservado, e os melhores projetos sobrevivem para moldar a próxima geração.

O que os experimentos mostram

Os pesquisadores testaram sua abordagem no conjunto de dados real do ensino médio, comparando o CNAE‑LSTM com uma série de alternativas: uma máquina de vetor de suporte (um método clássico de aprendizado de máquina), dois modelos de deep learning (uma rede convolucional e um Transformer), uma LSTM padrão ajustada manualmente e várias LSTMs cujas configurações foram escolhidas por métodos evolutivos conhecidos ou por buscas em grade e aleatória. O desempenho foi medido pela proximidade das notas previstas em relação às reais e pela parcela da variação nas notas que o modelo conseguiu explicar. O CNAE‑LSTM ficou na liderança em todas as métricas: teve o menor erro médio de previsão e a maior capacidade de explicar diferenças entre os alunos, reduzindo o erro em mais de 10% em comparação com a melhor linha de base evolucionária existente. Repetir os experimentos 30 vezes mostrou que o CNAE‑LSTM não foi apenas mais preciso, mas também mais estável — seus resultados variaram menos de uma execução para outra.

Por que isso é importante para alunos e escolas

Para um leitor leigo, a conclusão é direta: ao permitir que um procedimento de busca evolucionária projete o modelo preditivo, as escolas podem obter previsões mais confiáveis sobre como os alunos terminarão um curso muito antes do exame final. O framework CNAE‑LSTM transforma dados educacionais reais e imperfeitos em um quadro mais claro de quem está no caminho certo e quem pode precisar de ajuda extra, usando recursos computacionais de forma eficiente o suficiente para ser prático. Embora o estudo atual foque em um único conjunto de dados de ensino médio, a mesma abordagem poderia ser adaptada a outras disciplinas e níveis escolares. Se combinada com intervenções ponderadas e humanizadas, essa ferramenta de previsão pode ajudar educadores a passar de reagir à falha para preveni‑la.

Citação: Chen, H., Zhou, Y. & Cao, Q. A hybrid learning framework integrating chaotic Niche alpha evolution for student academic performance prediction. Sci Rep 16, 5302 (2026). https://doi.org/10.1038/s41598-026-36263-1

Palavras-chave: previsão de desempenho estudantil, mineração de dados educacionais, LSTM, otimização evolucionária, sistemas de alerta precoce