Clear Sky Science · pt

Decisão hierárquica de NBV baseada em informação mútua para SLAM visual semântico ativo em ambientes dinâmicos

Robôs que Podem Pensar à Frente

Conforme robôs saem das fábricas e entram em casas, hospitais e escritórios, eles precisam navegar por espaços cheios de pessoas e outros objetos em movimento. Este artigo apresenta uma nova forma de um robô "pensar à frente" sobre onde olhar e como se mover para que possa construir um mapa confiável de seu entorno — mesmo quando esse entorno se recusa a ficar parado. O trabalho é relevante para quem se interessa por robôs de serviço mais seguros, entregadores autônomos mais inteligentes ou futuros assistentes domésticos que terão de compartilhar espaço com humanos em vez de corredores vazios.

Por que Pessoas em Movimento Confundem os Robôs

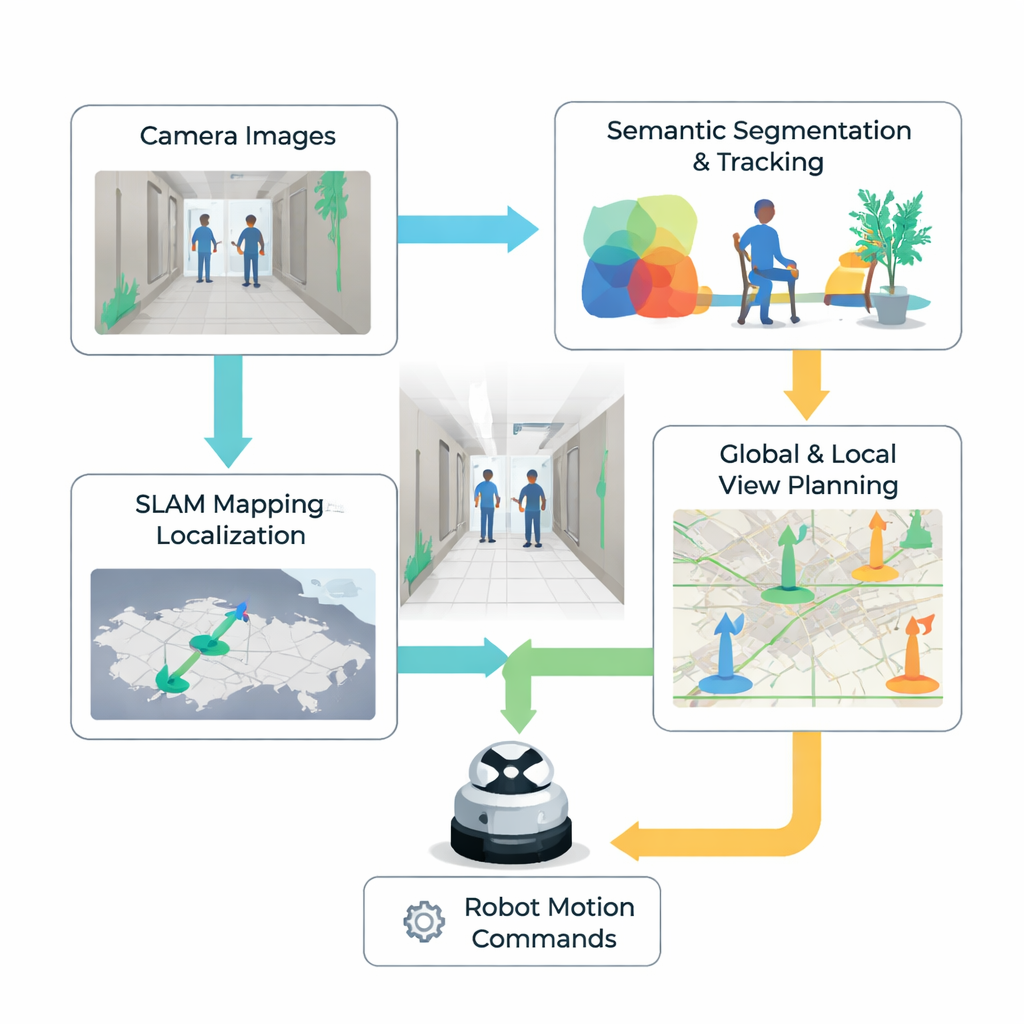

Para se locomover de forma autônoma, muitos robôs usam uma técnica chamada SLAM visual, na qual uma câmera ajuda a construir um mapa e estimar a própria posição ao mesmo tempo. Isso funciona bem em ambientes estáticos, mas entra em colapso quando pessoas passam, bloqueiam a visão ou carregam objetos. Uma solução comum é usar visão "semântica" para que o robô reconheça pessoas, carros e cadeiras e simplesmente os ignore ao construir o mapa. No entanto, isso gera um novo problema para robôs ativos que escolhem suas próprias rotas: se descartarem pistas visuais demais, podem perder completamente o rastreamento de sua posição. O campo de visão limitado da câmera torna isso ainda mais difícil, porque uma única pessoa passando perto pode ocultar a maior parte do cenário útil dos olhos do robô.

Uma Estratégia em Dois Níveis para Escolher Onde Olhar a Seguir

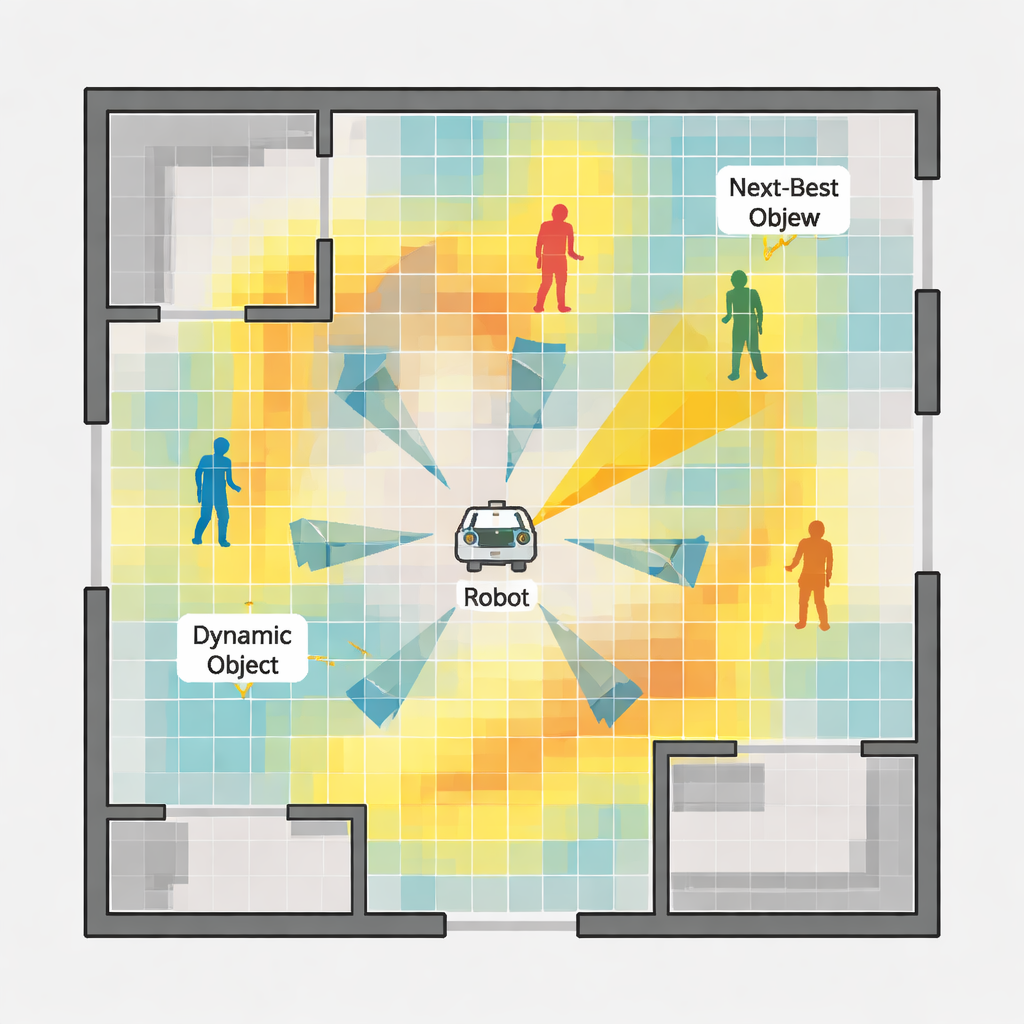

Os autores propõem um sistema de decisão hierárquico que ajuda o robô a escolher seus próximos pontos de vista de forma mais informada. No nível superior, o robô mantém um mapa em grade visto de cima das áreas livres, ocupadas e desconhecidas. Ele avalia possíveis pontos de vista distantes estimando quanto cada um reduziria a incerteza nesse mapa, um conceito emprestado da teoria da informação. O robô prefere locais que revelem grandes regiões inexploradas enquanto também considera a distância a percorrer e quanto precisa girar a câmera. Uma vez escolhido um setor promissor, um processo de nível inferior assume para ajustar finamente exatamente como o robô deve se mover e orientar-se naquela vizinhança para realmente ver detalhes úteis com sua visão estreita.

Ver o que é Estável e Desviar do que Não é

No cerne do processo de decisão local está um "mapa de probabilidade de características" construído a partir de cada imagem da câmera. Primeiro, o sistema detecta pontos visuais — cantos e padrões na cena — que provavelmente permanecerão estáveis ao longo do tempo e são úteis para rastrear o movimento. Em seguida, usa um detector de objetos moderno para encontrar objetos potencialmente móveis, como pessoas, e os rastreia ao longo dos quadros. Ao analisar como esses objetos se movem, o sistema estima não apenas onde eles estão agora, mas onde provavelmente estarão no futuro próximo. Essas duas fontes de informação são fundidas em um mapa térmico sobre a imagem: regiões claras indicam alta chance de ver marcos confiáveis, enquanto regiões mais escuras marcam locais pobres em características ou propensos a serem cobertos por objetos em movimento. O robô usa esse mapa para julgar qual pequeno movimento — virar à esquerda, à direita ou avançar — lhe dará a vista mais nítida e estável a seguir.

Testes em Mundos Virtuais e no Mundo Real

Os pesquisadores testaram sua abordagem em dois espaços internos simulados de tamanhos e complexidades diferentes, cada um populado por pedestres virtuais errantes, e depois em um robô físico percorrendo um ambiente interno real. Eles compararam seu método com várias estratégias de exploração consolidadas que visam principalmente cobrir espaço ou reduzir distância de viagem. Nas simulações, o novo sistema produziu mapas com menos distorção e alcançou melhor precisão de posicionamento enquanto explorava em tempo semelhante ou menor. Também foi menos provável perder o rastreamento de sua posição ou se aproximar perigosamente de pessoas em movimento. No experimento no mundo real, o método rodou em tempo real em um computador de robô comercial, confirmando que é prático para implantação fora do laboratório.

O que Isso Significa para Robôs do Dia a Dia

Em termos simples, este trabalho ensina um robô a ser seletivo sobre onde olhar e para onde ir quando há pessoas por perto. Ao combinar entendimento da cena, previsão de movimento e uma medida de ganho de informação, o robô pode se dirigir a vistas que sejam ao mesmo tempo informativas e seguras, em vez de simplesmente marchar para o canto inexplorado mais próximo. Isso torna seu mapa interno mais confiável e seus movimentos mais previsíveis, que são ingredientes-chave para robôs que precisam compartilhar espaços lotados com humanos. Alguns desafios permanecem — como multidões grandes e repentinas que bloqueiam a câmera —, mas a abordagem representa um passo em direção a robôs domésticos e de serviço capazes de lidar com a natureza bagunçada e dinâmica da vida real de forma mais elegante.

Citação: Yang, Z., Sang, A.W.Y., Muthugala, M.A.V.J. et al. Mutual information-based hierarchical NBV decision for active semantic visual SLAM under dynamic environments. Sci Rep 16, 5847 (2026). https://doi.org/10.1038/s41598-026-36259-x

Palavras-chave: SLAM ativo, navegação de robôs, ambientes dinâmicos, mapeamento semântico, próxima melhor vista