Clear Sky Science · pt

Monitoramento das proximidades agrícolas e identificação de objetos baseado em configurações otimizadas You Only Look Once e Single Shot Multibox Detector usando imagens combinadas de visão e térmicas

Olhos mais inteligentes para máquinas agrícolas mais seguras

Tratores e colheitadeiras modernos estão ficando maiores, mais rápidos e mais automatizados, o que coloca uma questão simples, porém séria: como garantir que não atinjam pessoas, animais ou outras máquinas escondidos em poeira, neblina ou escuridão? Este artigo descreve um sistema de segurança prático que dá aos equipamentos agrícolas uma espécie de “supervisão”, combinando câmeras de vídeo convencionais e câmeras termográficas, e compara diferentes soluções de inteligência artificial para ver quais conseguem detectar riscos com mais precisão e rapidez.

Por que o trabalho no campo precisa de melhor visão

A agricultura hoje depende fortemente de máquinas grandes e potentes que trabalham longas horas, frequentemente à noite ou em condições meteorológicas adversas. Uma câmera de vídeo básica pode ajudar o operador a ver ao redor do trator, mas imagens ordinárias falham quando há neblina, chuva, brilho intenso ou escuridão. Câmeras térmicas, que detectam calor em vez de luz, funcionam bem nessas condições difíceis e fazem com que corpos quentes — pessoas e animais — se destaquem do fundo. Os autores defendem que combinar os dois tipos de imagem é a melhor forma de construir um sistema de aviso acessível, que possa ser adaptado em máquinas existentes e integrado aos painéis de controle padrão dos tratores.

Como funcionam os sistemas duplo e unificado

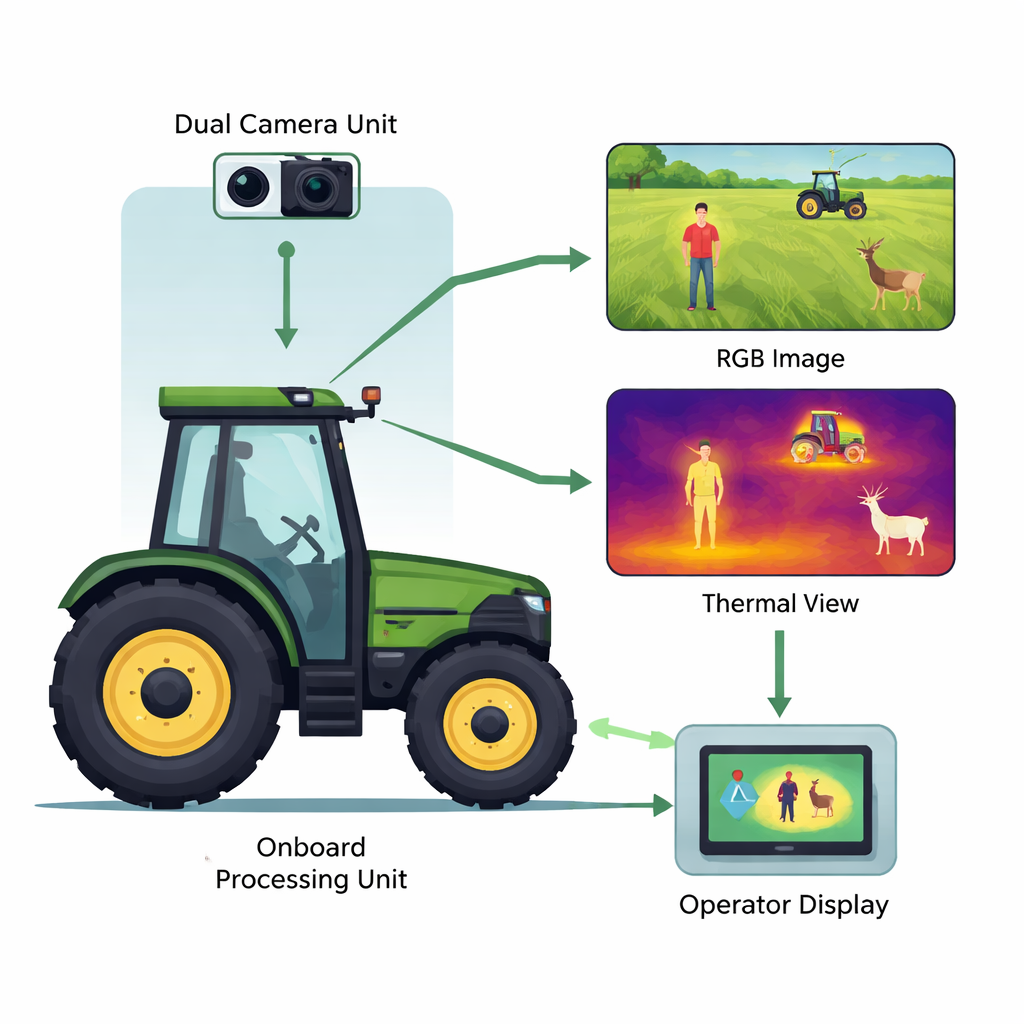

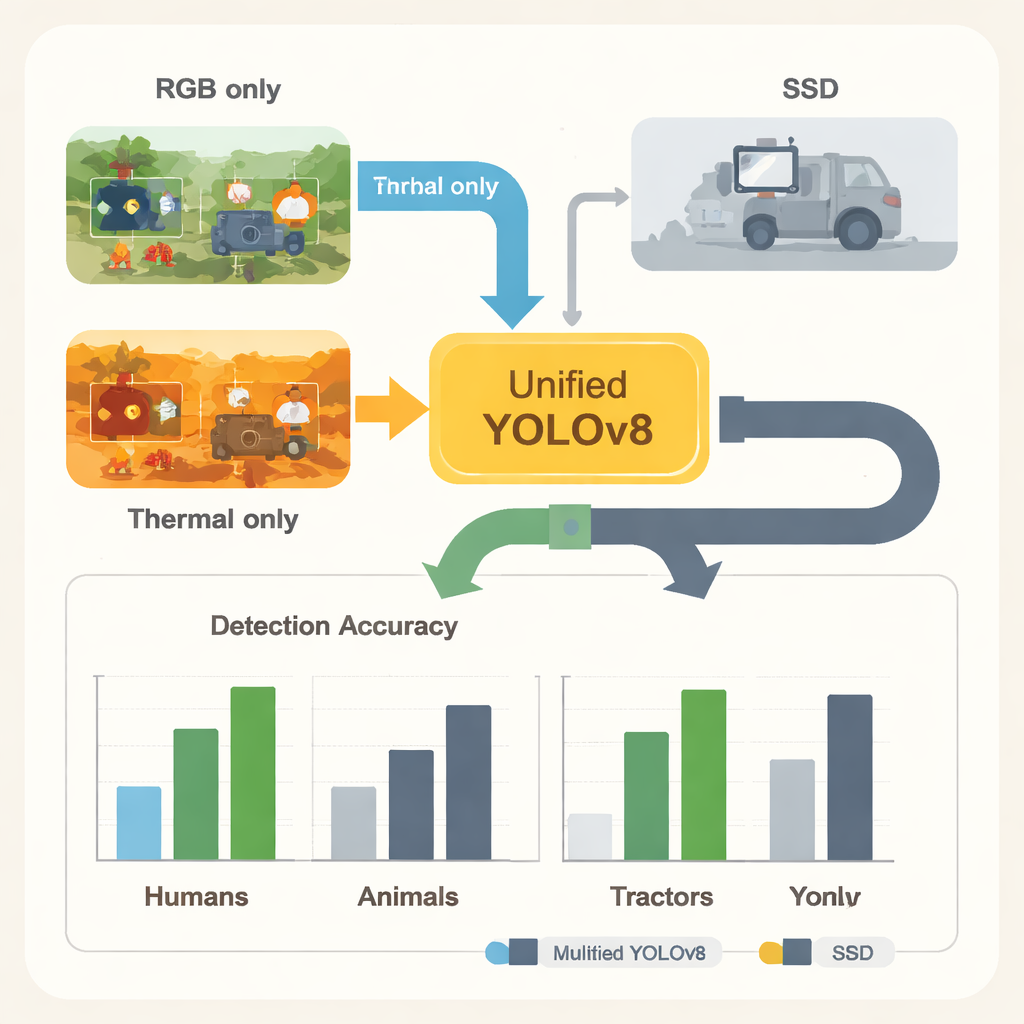

A equipe montou uma unidade combinada de câmera RGB (cor normal) e térmica no teto de um trator e enviou os dois fluxos de imagem para uma unidade de processamento de baixo custo na cabine. Eles exploraram duas abordagens principais para usar inteligência artificial na detecção de objetos nessas imagens. Na primeira, a abordagem “duas redes”, uma rede neural foi treinada apenas em imagens normais e uma segunda rede apenas em imagens térmicas; os resultados foram então mesclados. Na segunda, a abordagem “unificada”, as duas imagens foram cuidadosamente alinhadas, empilhadas e passadas por uma única rede que aprendeu com ambas simultaneamente. Ambos os projetos foram implementados com uma família de modelos rápidos de detecção de objetos conhecidos como YOLOv8 e com um projeto alternativo chamado SSD, adaptado para computadores pequenos e embarcados.

Construindo e treinando a visão da máquina para o campo

Para ensinar essas redes o que procurar, os pesquisadores montaram um grande conjunto de dados a partir de bibliotecas públicas de imagens e de gravações feitas com suas próprias câmeras. As imagens cobriram pessoas, animais selvagens e domésticos, tratores, colheitadeiras, caminhões, ônibus e outras máquinas agrícolas, em visões tanto visíveis quanto térmicas. Cada objeto foi cercado por uma caixa desenhada à mão e recebeu um rótulo, e as imagens foram então aumentadas — espelhadas, rotacionadas ou ligeiramente desfocadas — para imitar a variedade vista em campos reais. Os dados foram divididos em conjuntos de treinamento, validação e teste para que as redes pudessem aprender em uma parte e ser avaliadas de forma justa em imagens que nunca haviam visto. Cuidado especial foi dado para medir não apenas a acurácia bruta, mas também quantas operações de computação e quantos quadros por segundo cada modelo exigia, já que qualquer sistema real para tratores precisa rodar com rapidez e confiabilidade no campo.

Quais “olhos” digitais se saíram melhor?

Ao longo de milhares de imagens de teste, todas as configurações do YOLOv8 detectaram a maioria dos alvos muito bem, especialmente grandes máquinas agrícolas e animais de corpo quente. O modelo unificado que recebeu dados RGB e térmicos em um único fluxo alcançou uma pontuação geral (mean average precision) de cerca de 0,90, ligeiramente à frente da configuração de duas redes, com 0,88. Em outras palavras, fundir ambos os tipos de visão dentro de uma única rede deu um pequeno, mas real, ganho de desempenho sem tornar o sistema mais complexo de operar. Os maiores benefícios da imagem térmica apareceram para pessoas e animais em iluminação ruim, enquanto as imagens normais permaneceram melhores para formas detalhadas como tratores. Quando a equipe trocou o YOLOv8 pelo seu modelo SSD simplificado, o desempenho caiu de forma perceptível para a maioria das classes, embora o SSD treinasse muito mais rápido. O YOLOv8, especialmente sua versão menor “Nano”, entregou maior precisão enquanto ainda alcançava velocidades em tempo real de cerca de 27 quadros por segundo em hardware modesto.

Transformando detecções de IA em avisos simples

Em vez de sobrecarregar o motorista com fluxos de vídeo, o sistema converte as detecções em uma visualização simples no painel que segue um padrão comum de comunicação de tratores (ISOBUS). Em um painel verde simples, ícones mostram se um humano, animal ou veículo está à frente da máquina, junto com distância, direção e quão confiante o sistema está. Essa interface enxuta pode rodar em terminais de operador já existentes e é projetada para condições agrícolas severas, com câmeras protegidas, suportes estabilizados e controle de poeira e temperatura planejado para versões futuras.

O que isso significa para a agricultura do dia a dia

Para um público não especializado, a conclusão é que dar aos tratores “dois tipos de olhos” e um cérebro de IA bem escolhido pode melhorar substancialmente a segurança sem exigir hardware exótico. Uma única rede YOLOv8 cuidadosamente ajustada que mescla visões normais e térmicas oferece a melhor combinação de precisão, velocidade e simplicidade entre as opções testadas, superando claramente o desenho SSD. Embora o sistema ainda tenha alguma dificuldade para reconhecer humanos em todas as situações — em parte porque havia menos exemplos deles nos dados de treinamento — o estudo mostra que sistemas de aviso práticos baseados em câmeras para máquinas agrícolas são viáveis e estão próximos de estarem prontos para uso em campo. Com dados mais balanceados e métodos de fusão refinados, versões futuras poderiam ajudar a prevenir acidentes, proteger a vida selvagem e tornar a agricultura em grande escala mais segura para todos dentro e ao redor do campo.

Citação: Tarasiuk, K., Mystkowski, A., Ostaszewski, M. et al. Agriculture surrounding monitoring and object identification based on optimized you only look once and single shot multibox detector setups using combined vision and thermal images. Sci Rep 16, 5129 (2026). https://doi.org/10.1038/s41598-026-36181-2

Palavras-chave: segurança agrícola, imagens térmicas, visão computacional, detecção de objetos, YOLOv8