Clear Sky Science · pt

Segurança e eficácia de modelos que preservam a privacidade para criar resumos em linguagem leiga de laudos de ressonância magnética cerebral

Por que seu laudo pode parecer tão confuso

Cada vez mais pacientes conseguem ler seus próprios resultados de exames on‑line, incluindo laudos detalhados de radiologia de exames cerebrais. Mas esses documentos são escritos para médicos, não para pacientes, e estão repletos de termos pouco familiares que podem alimentar preocupação em vez de transmitir segurança. Este estudo pergunta se programas modernos de inteligência artificial (IA) podem transformar com segurança laudos reais de ressonância magnética cerebral de emergência — escritos em francês para pessoas com cefaleia — em resumos em linguagem simples que os pacientes realmente entendam, sem enviar dados médicos sensíveis para servidores comerciais distantes.

Transformando a linguagem médica em palavras do cotidiano

Os pesquisadores focaram em “resumos leigos”: explicações curtas que mantêm os fatos médicos, mas os traduzem para uma linguagem comum e vinculam diretamente as descobertas aos sintomas do paciente. Eles usaram três grandes modelos de linguagem (LLMs) — Llama 3.3, Athene V2 e Mistral Small — executados inteiramente em computadores dentro de um hospital universitário francês, de modo que nenhum laudo saiu da rede segura do hospital. Cada sistema de IA recebeu a mesma instrução: escrever um resumo em francês de 4–6 frases para um paciente, cobrindo todos os pontos-chave, explicando termos difíceis e conectando os achados da tomografia ao quadro de cefaleia do paciente.

Como os médicos avaliaram precisão e segurança

A partir de quase 600 laudos de ressonância magnética cerebral redigidos em 2022 para pacientes de emergência com cefaleia, a equipe selecionou aleatoriamente 105. Três neurorradiologistas experientes leram cada laudo original juntamente com três resumos anônimos gerados pela IA (um de cada modelo). Eles os avaliaram quanto à correção médica, completude, utilidade para explicar ao paciente e se o texto era bom o bastante para ser exibido diretamente no portal on‑line do paciente. Em média, as avaliações foram altas: os médicos consideraram os resumos em grande parte precisos e abrangentes, e frequentemente adequados para uso clínico. Ainda assim, cerca de um em cada cinco resumos continha pelo menos um problema, como uma explicação errada de uma abreviação, uma descrição anatômica ligeiramente imprecisa, redação estranha ou um detalhe inventado que não constava no laudo original.

O que pessoas não‑médicas realmente entenderam

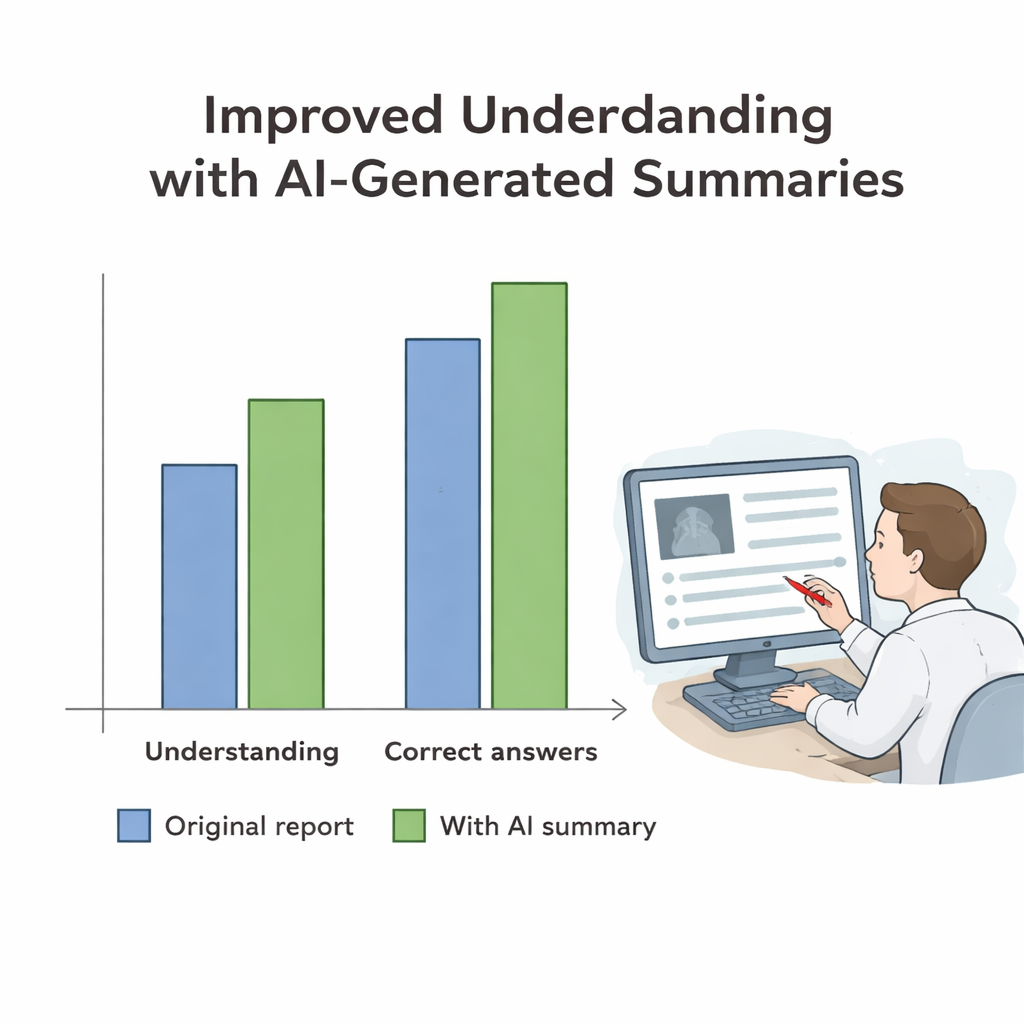

Para verificar se esses resumos realmente ajudavam leitores leigos, os pesquisadores recrutaram 11 não‑médicos que trabalham em informática médica e lidam regularmente com dados de saúde, mas não são médicos treinados. Esse grupo avaliou 30 laudos de RM, alguns em sua forma original e outros com um resumo de IA adicionado. Eles pontuaram o quanto sentiram que entenderam cada laudo, quanta confiança tinham para explicar os resultados a amigos ou familiares e quanta ansiedade sentiriam se o laudo fosse deles. Também responderam a perguntas simples de sim‑ou‑não: há algo anormal neste laudo, e há um achado que poderia razoavelmente explicar a cefaleia do paciente?

Laudos mais claros; ganhos modestos, porém reais, de compreensão

Adicionar resumos gerados por IA aumentou dramaticamente o quanto os participantes sentiram que entendiam os laudos, elevando a compreensão autoavaliada de níveis “moderados” para “altos”. A confiança em poder discutir os resultados com outras pessoas também aumentou, enquanto a ansiedade relatada diminuiu ligeiramente. Quanto à compreensão objetiva, o efeito foi mais modesto, mas ainda relevante. Os participantes ficaram melhores em identificar quando um exame estava anormal e em reconhecer achados que poderiam realmente causar a cefaleia, com melhorias concentradas nos laudos que continham anormalidades reais. Para exames normais, as pessoas já estavam perto da perfeição em reconhecer que nada grave foi encontrado, de modo que os resumos ofereceram pouco benefício adicional.

Por que a supervisão humana ainda importa

Embora essas ferramentas de IA que preservam a privacidade tenham melhorado substancialmente a clareza percebida e oferecido pequenos, porém importantes ganhos na compreensão factual, elas não foram infalíveis. Cerca de 20% dos resumos continham erros médicos ou de linguagem, frequentemente ligados a abreviações médicas complexas ou à infiltração de palavras em inglês e chinês em frases em francês. Como mesmo pequenos erros podem induzir o paciente a engano, os autores defendem que a IA seja usada em um esquema “human‑in‑the‑loop”: o modelo elabora um resumo acessível, e um radiologista o verifica e corrige rapidamente antes que chegue ao paciente. Usada dessa forma, o estudo sugere que a IA local poderia ajudar hospitais a oferecer explicações mais claras e tranquilizadoras sobre resultados de RM cerebral, mantendo dados de saúde sensíveis confinados em suas instalações.

Citação: Le Guellec, B., Bentegeac, R., Shorten, L. et al. Safety and efficacy of privacy-preserving models to create Lay summaries of brain MRI reports. Sci Rep 16, 6316 (2026). https://doi.org/10.1038/s41598-026-36081-5

Palavras-chave: laudos de radiologia, comunicação com o paciente, ressonância magnética cerebral, grandes modelos de linguagem, privacidade médica