Clear Sky Science · pt

M6: bancos de dados para detecção de música gerada por máquina multigerador, multidomínio, multilíngue e multicultural, multigêneros, multi-instrumental

Por que a ascensão da música feita por IA importa

Plataformas de streaming de música estão silenciosamente se enchendo de faixas escritas não por pessoas, mas por algoritmos. Essas composições geradas por máquina podem ser ferramentas úteis para terapia, trilhas sonoras de filmes ou playlists do dia a dia, mas também borram a linha entre a criatividade humana e a produção automatizada. Este artigo apresenta o M6, uma grande nova coleção de música construída para ajudar pesquisadoras e pesquisadores a distinguir música feita por humanos da feita por IA e para entender o que as diferencia. O objetivo é apoiar o crédito justo aos artistas, ao mesmo tempo em que permite que a IA desempenhe um papel construtivo na criação musical.

Construindo um amplo laboratório musical

Os autores sustentam que o avanço na detecção de música gerada por IA foi prejudicado pela falta de dados adequados. Coleções existentes ou focam em outras tarefas, como emparelhar música com descrições textuais, ou cobrem apenas uma fatia estreita de estilos musicais. O M6 foi projetado para preencher essa lacuna. Ele combina milhares de faixas feitas por humanos com milhares feitas por vários sistemas de IA diferentes, empacotadas em um formato de áudio padrão. O conjunto de dados é intencionalmente amplo: abrange muitos instrumentos, idiomas, culturas, gêneros, durações de canções e inclui músicas vocais e peças instrumentais de fundo. Essa rica variedade permite que cientistas testem se os métodos de detecção funcionam em cenários musicais realistas e em constante mudança.

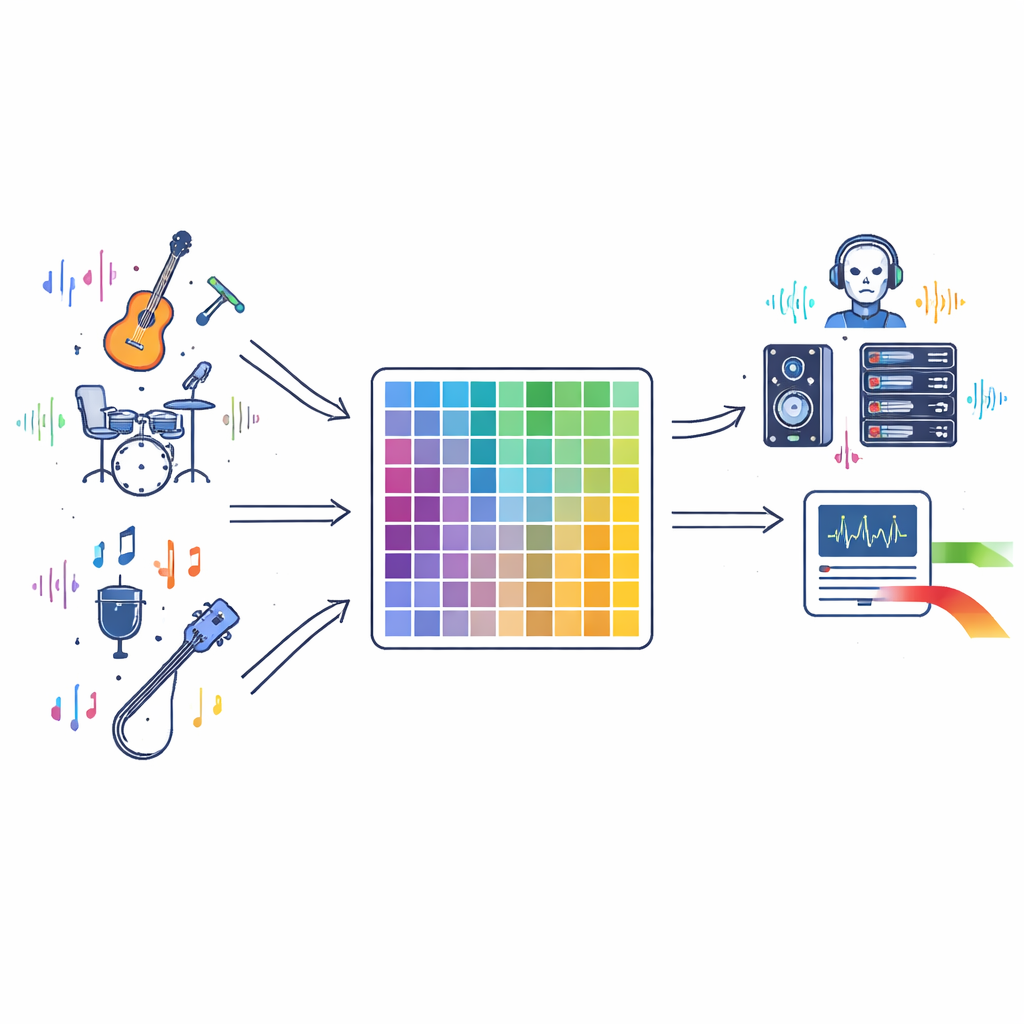

Coletando músicas de pessoas e máquinas

Para montar o lado humano do M6, a equipe recorreu a coleções abertas conhecidas, como GTZAN (para gêneros musicais), o Free Music Archive, COSIAN (música vocal japonesa) e um conjunto de dados de sons de instrumentos individuais. Também amostraram faixas adicionais de plataformas de streaming quando as licenças permitiam, escolhendo clipes que mostram claramente a ideia musical principal em vez de meros interlúdios breves. No lado das máquinas, geraram novas músicas usando vários sistemas de ponta, incluindo modelos de pesquisa abertos e ferramentas comerciais. Prompts cuidadosamente elaborados, alguns produzidos por um modelo de linguagem, pediram a esses sistemas que criassem música em estilos, tempos ou com instrumentos específicos, de modo que as faixas de IA espelhassem a diversidade da música humana.

Verificando qualidade e identificando diferenças sutis

Como os julgamentos sobre qualidade musical são subjetivos, os autores combinaram opiniões de ouvintes com medidas objetivas. Eles calcularam descritores numéricos simples para cada faixa, capturando aspectos como quão complexos são os ritmos, quão ampla é a extensão melódica, quão brilhante aparece o espectro sonoro e quanta energia o sinal carrega. Em média, peças feitas por IA diferiram das humanas nessas medidas — por exemplo, frequentemente tinham faixas de altura ligeiramente mais estreitas ou energia geral mais baixa —, mas as diferenças eram pequenas o bastante para que a maioria dos ouvintes não percebesse sem uma comparação cuidadosa. Em testes de escuta com 50 voluntários, as pessoas identificaram corretamente se um clipe era humano ou gerado por IA em apenas cerca de metade das vezes, essencialmente sem desempenho melhor do que jogar uma moeda. Isso sugere que a música de IA já alcançou um nível de polimento capaz de enganar facilmente ouvintes casuais.

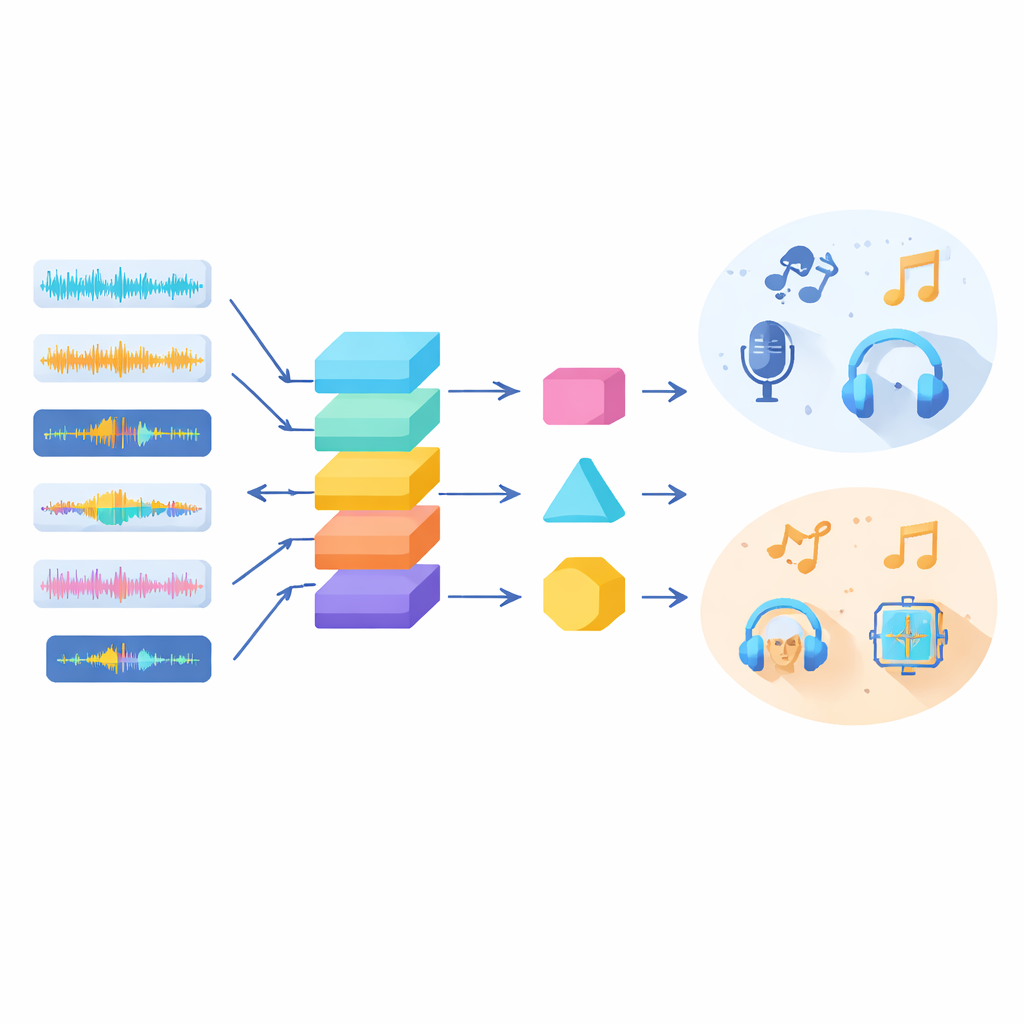

Colocando métodos de detecção à prova

Com o M6 disponível, os pesquisadores avaliaram uma variedade de modelos computacionais para ver quão bem eles conseguiam detectar música gerada por IA. Testaram aprendizado de máquina clássico, redes neurais estilo imagem que processam espectrogramas, modelos transformer e sistemas de áudio modernos originalmente construídos para detectar fala falsa. Quando os modelos foram treinados e testados em tipos de música semelhantes, vários alcançaram alta precisão, especialmente redes convolucionais que focam em padrões na imagem tempo–frequência do som. No entanto, o desempenho caiu drasticamente quando os modelos encararam música “fora de domínio” — estilos, idiomas ou geradores que não tinham visto antes. O estudo também revelou que diferentes sistemas de música por IA deixam “impressões digitais” acústicas distintas, tornando alguns geradores mais fáceis de detectar do que outros e suscitando preocupações de que detectores possam ajustar-se demais a ferramentas particulares em vez de captar traços mais profundos da música feita por máquina.

O que isso significa para música e IA

O projeto M6 mostra que, embora computadores frequentemente consigam sinalizar música gerada por IA com precisão em cenários familiares, a detecção robusta em ambiente real continua sendo um grande desafio. Ouvintes humanos já têm dificuldade em distinguir as faixas, e algoritmos atuais falham quando a música muda de gênero, idioma, duração ou método de geração. Ao lançar um conjunto de dados grande, diversificado e de acesso aberto, os autores esperam estimular o desenvolvimento de ferramentas de detecção mais confiáveis e transparentes. Por sua vez, essas ferramentas poderiam ajudar a manter a confiança nas plataformas de música digital, apoiar o reconhecimento justo de artistas humanos e orientar futuros sistemas de IA rumo à colaboração com músicos em vez de uma substituição silenciosa.

Citação: Li, Y., Li, H., Specia, L. et al. M6: multi-generator, multi-domain, multi-lingual and cultural, multi-genres, multi-instrument machine-generated music detection databases. Sci Rep 16, 9237 (2026). https://doi.org/10.1038/s41598-026-36044-w

Palavras-chave: Música gerada por IA, áudio deepfake, detecção de música, aprendizado de máquina, criatividade digital