Clear Sky Science · pt

Compreendendo o discurso sobre saúde mental no Reddit com transformers e interpretabilidade

Por que falar online sobre sentimentos importa

Muitas pessoas que enfrentam ansiedade, depressão, transtorno bipolar ou transtorno de personalidade limítrofe recorrem à internet antes de conversar com um profissional. O Reddit, com suas comunidades anônimas, tornou‑se um grande ponto de encontro para compartilhar medos, pedir ajuda e apoiar outras pessoas. Este estudo explora como são milhares dessas conversas e como a inteligência artificial pode classificá‑las e destacar as palavras que as pessoas mais usam ao falar sobre diferentes desafios de saúde mental.

Uma espiada nas comunidades de apoio

Os pesquisadores focaram em quatro grandes comunidades do Reddit dedicadas à ansiedade, depressão, transtorno bipolar e transtorno de personalidade limítrofe (frequentemente abreviado como TPL). Cada postagem no conjunto de dados foi rotulada apenas pela comunidade de origem, não por um diagnóstico médico. A equipe tratou essas comunidades como “espaços de preocupação”, onde pessoas com dificuldades semelhantes se reúnem para desabafar, buscar conselhos e oferecer conforto. Ao estudar como a linguagem difere entre esses espaços, os autores esperavam entender como as pessoas descrevem suas experiências em suas próprias palavras, fora de uma clínica.

Ensinando computadores a classificar conversas

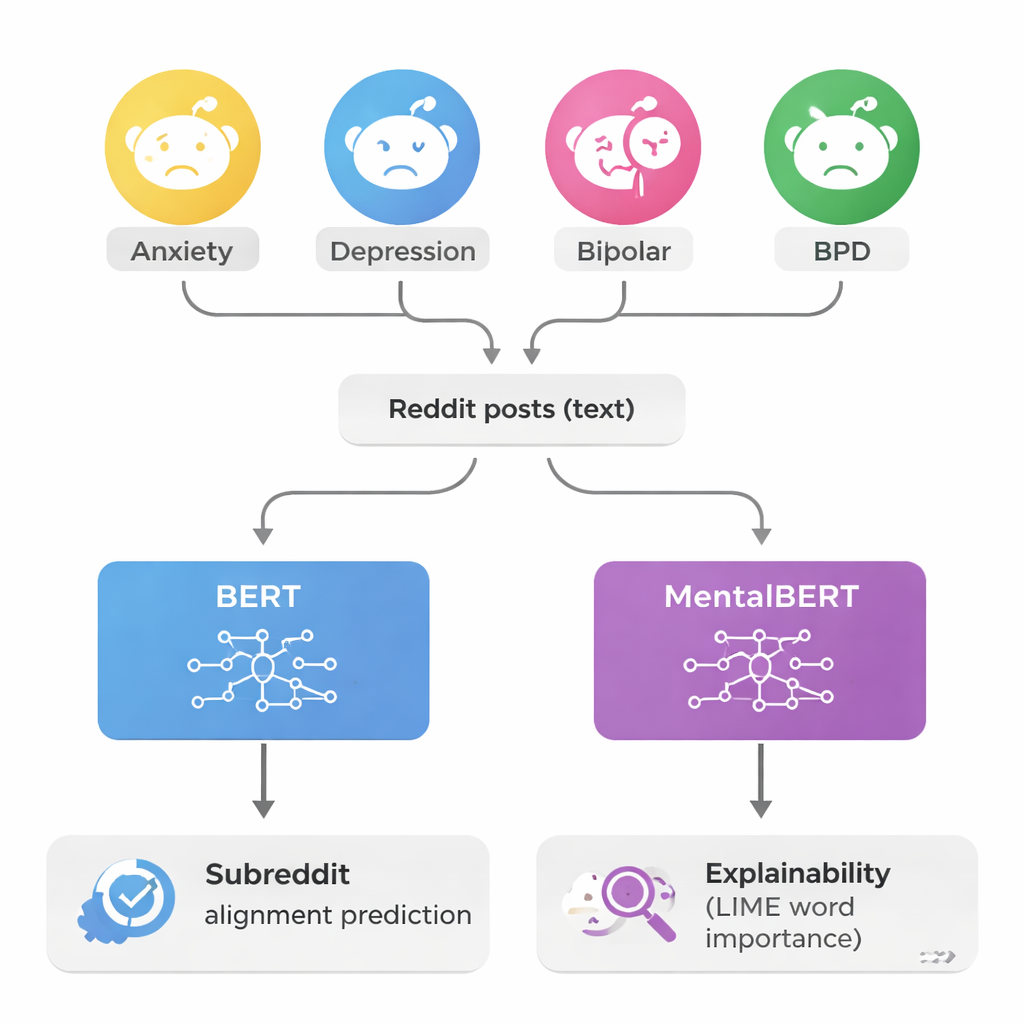

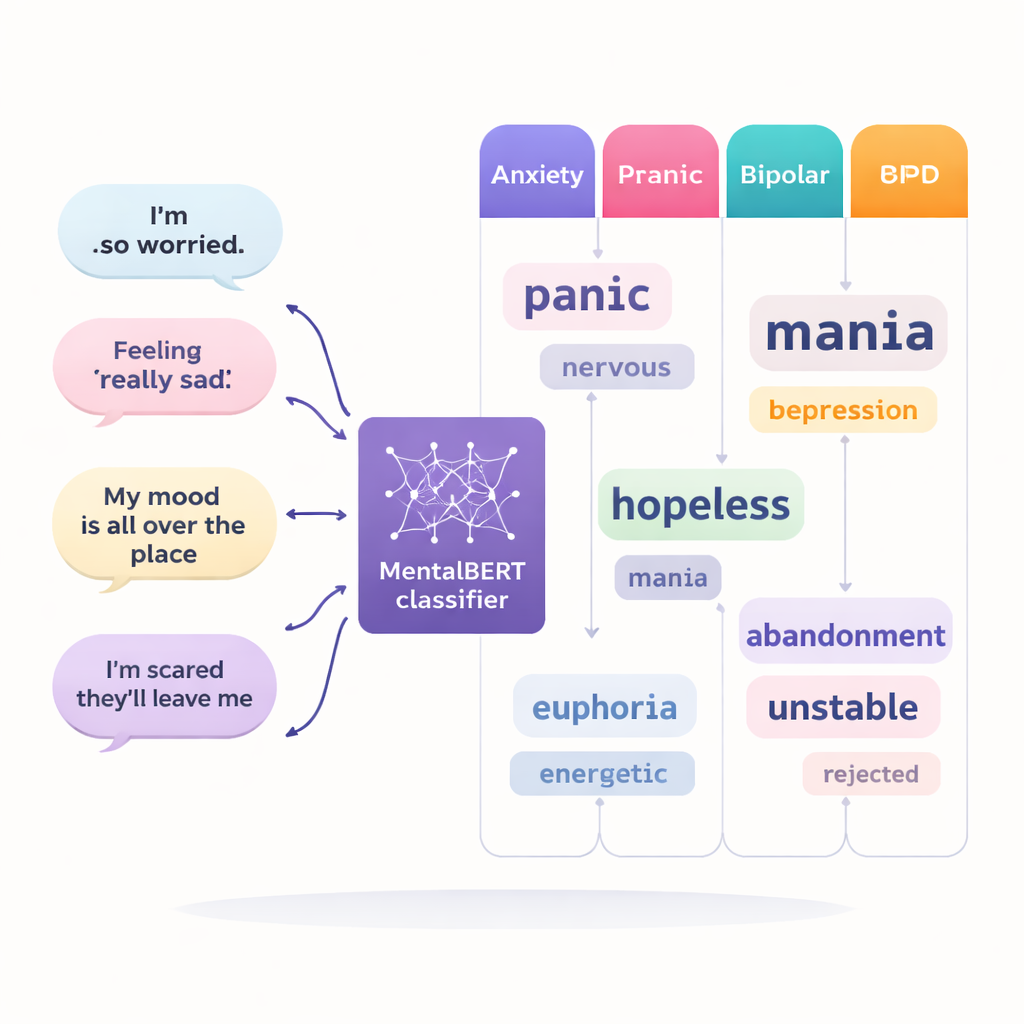

Para analisar mais de 150.000 postagens, os autores utilizaram modelos de linguagem potentes chamados transformers, especificamente o BERT e uma versão focada em saúde mental chamada MentalBERT. Esses modelos leem cada postagem e tentam adivinhar a qual das quatro comunidades ela pertence. Como algumas comunidades tinham muito mais postagens que outras, a equipe balanceou cuidadosamente o conjunto de dados para que cada grupo fosse igualmente representado. Isso tornou a tarefa mais difícil, mas mais justa, forçando os modelos a realmente aprender diferenças de formulação em vez de favorecer apenas as comunidades mais comuns. Nos testes, os modelos rotularam corretamente as postagens em cerca de 82% das vezes — um avanço grande em relação ao palpite aleatório, que acertaria apenas um quarto das vezes.

Abrindo a caixa‑preta da IA

Uma preocupação importante em tecnologia para saúde mental é que os sistemas computacionais pareçam “caixas‑pretas” misteriosas, oferecendo previsões sem razões claras. Para enfrentar isso, os pesquisadores usaram uma abordagem chamada LIME que revela quais palavras empurraram o modelo para uma decisão específica. Em termos simples, o LIME oculta ou modifica trechos de uma postagem e observa como a resposta do modelo muda. Se remover uma palavra como “pânico” altera subitamente a comunidade prevista, essa palavra é considerada importante. Repetindo esse processo milhares de vezes em muitas postagens, a equipe construiu listas das palavras mais influentes para cada comunidade e verificou se essas palavras correspondiam ao que os clínicos sabem sobre cada condição.

Vozes distintas para diferentes dificuldades

As explicações revelaram padrões de linguagem claros. Nas comunidades de ansiedade, palavras como “pânico”, “ataque” e “preocupação” se destacaram, frequentemente ligadas a sintomas físicos e surtos súbitos de medo. Postagens sobre depressão incluíam com frequência termos como “sem esperança”, “inútil”, “vida” e “mais” (no sentido de “mais não aguento”), ecoando uma tristeza profunda e a sensação de que as coisas não vão melhorar. Nas discussões sobre TPL, as palavras-chave deslocaram‑se para relacionamentos e emoções, incluindo “abandono”, “relacionamento”, “apego” e “fp” (abreviação de “favorite person”, termo comum nesses grupos). Postagens sobre transtorno bipolar destacaram alterações de humor e linguagem de tratamento, com palavras como “mania”, “maníaco”, “hipomania”, “humor” e nomes de medicamentos como “lítio” e “lamictal”. Os modelos também revelaram onde as condições se confundem: posts sobre ansiedade e depressão, por exemplo, podem centrar‑se ambos no sofrimento e em sentimentos negativos, tornando‑as mais fáceis de confundir, assim como ocorre no diagnóstico na vida real.

Das postagens online ao impacto no mundo real

Para um público não especializado, a mensagem principal é que os computadores podem classificar de forma confiável conversas sobre saúde mental por tema e explicar quais palavras impulsionam suas escolhas, mas ainda não podem e não devem diagnosticar ninguém. Os modelos deste estudo atuam mais como bibliotecários para espaços de apoio online: ajudam a verificar se as discussões em uma comunidade correspondem de fato ao foco declarado. Isso pode auxiliar moderadores a manter conversas relevantes e ajudar pesquisadores ou clínicos a entender melhor como as pessoas descrevem suas dificuldades fora de consultas formais. Com supervisão humana cuidadosa e atenção à privacidade e ao estigma, tais ferramentas podem um dia apoiar espaços online mais acolhedores e melhor organizados para falar sobre saúde mental.

Citação: Sánchez Rodríguez, I., Bianchi, J., Pinelli, F. et al. Understanding mental health discourse on Reddit with transformers and explainability. Sci Rep 16, 6796 (2026). https://doi.org/10.1038/s41598-026-35918-3

Palavras-chave: saúde mental, mídias sociais, Reddit, IA explicável, classificação de texto