Clear Sky Science · pt

Agregação hierárquica de informação contextual para segmentação de pólipos

Por que pequenos crescimentos no cólon importam

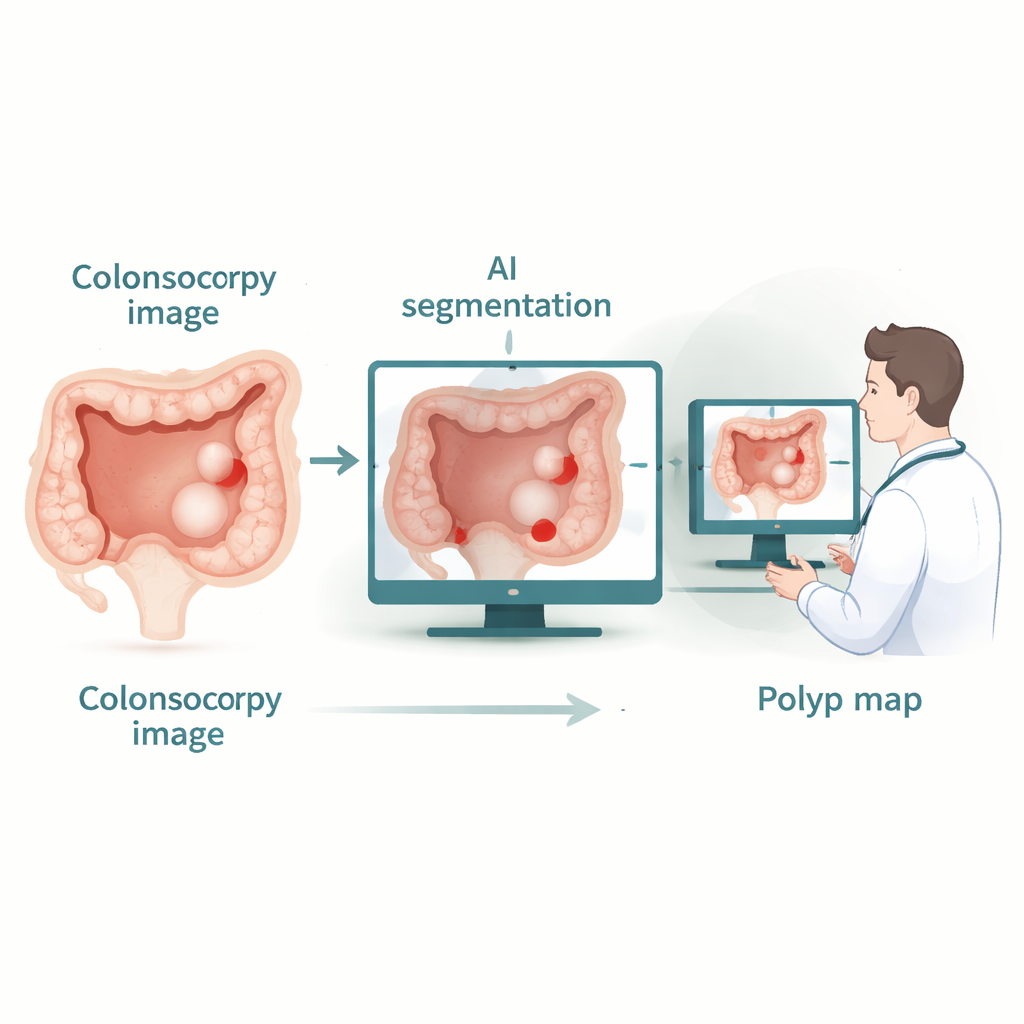

O câncer colorretal frequentemente começa como pequenas protuberâncias aparentemente inofensivas, chamadas pólipos, no revestimento do intestino grosso. Durante uma colonoscopia, os médicos tentam localizar e remover essas lesões antes que se tornem perigosas. Mas humanos se cansam, a visualização é imperfeita, e estudos mostram que até um quarto dos pólipos pode ser perdido. Este artigo apresenta um novo sistema de inteligência artificial (IA) projetado para contornar automaticamente pólipos em imagens de colonoscopia com alta precisão, visando tornar-se um assistente confiável que ajuda os médicos a ver mais — e a errar menos.

Ver a floresta e as árvores

As ferramentas modernas de IA para imagens médicas costumam se dividir em dois campos. Um, baseado em redes neurais convolucionais clássicas, é muito bom em reconhecer detalhes locais finos, como bordas sutis ou mudanças de textura, mas tem dificuldade em entender como regiões distantes de uma imagem se relacionam entre si. O outro, baseado em modelos transformer, sobressai em capturar relações de longo alcance — ver o “quadro geral” em toda a imagem — mas pode perder nitidez em estruturas pequenas, como limites finos de pólipos, e ser caro em termos de processamento. Sistemas híbridos recentes tentam misturar as duas abordagens, porém frequentemente acabam privilegiando a parte convolucional e não exploram plenamente os mecanismos de atenção, resultando em bordas borradas e contexto perdido.

Uma nova maneira de combinar pistas em várias escalas

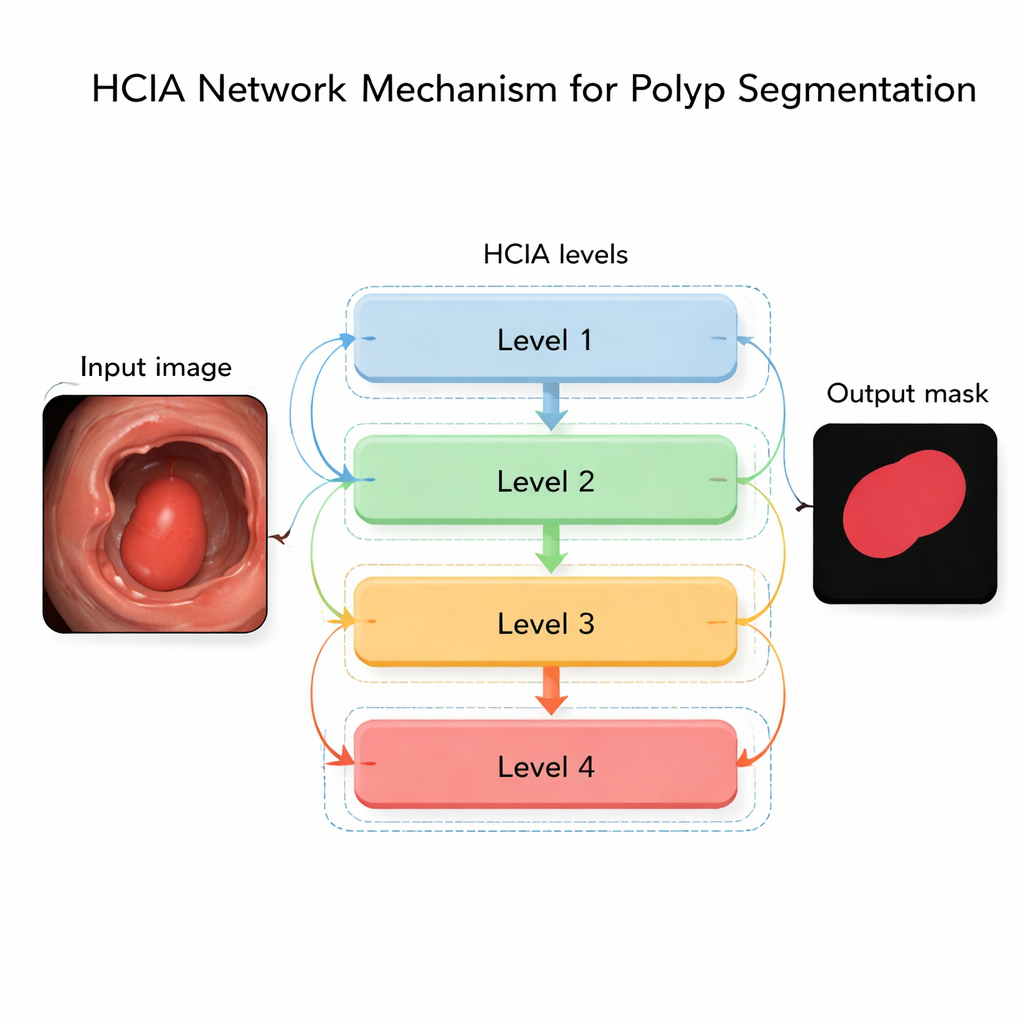

Os autores propõem uma rede chamada Hierarchical Contextual Information Aggregation (HCIA) para superar essas limitações. A HCIA foi projetada para analisar uma imagem de colonoscopia em vários níveis de detalhe ao mesmo tempo — desde visões amplas e grosseiras até visões mais próximas e detalhadas — e permitir que esses níveis troquem informações de forma estruturada. Um componente-chave, o Hierarchical Aggregation Module (HAM), funde informações de níveis vizinhos. Ao combinar contexto grosseiro com detalhes mais finos, o HAM ajuda o sistema a distinguir pólipos do tecido de fundo com cores, formas e tamanhos variados, ao mesmo tempo que afina as fronteiras onde o pólipo encontra o tecido saudável.

Atenção inteligente sem alto custo computacional

O segundo elemento crucial, o Interconnected Attention Module (IAM), enfrenta o desafio do contexto global. Em vez de calcular atenção da maneira habitual — comparando cada pixel com todos os outros, o que rapidamente se torna custoso em termos computacionais — o IAM usa uma “memória” compartilhada que resume o que a rede aprendeu em todos os níveis. Cada nível consulta essa memória para decidir quais partes de suas características merecem mais foco. Esse desenho permite que o IAM construa conexões de longo alcance por toda a imagem mantendo o custo computacional sob controle. Importante: a mesma memória é compartilhada entre os ramos da rede, oferecendo uma forma de supervisão global consistente que ajuda o modelo a manter o foco nos pólipos independentemente de seu tamanho ou localização.

Colocando o sistema à prova

Para descobrir se o projeto da HCIA faz diferença na prática, os autores testaram o método em três conjuntos de imagens de pólipos amplamente usados, cada um contendo centenas a mil quadros de colonoscopia com contornos de pólipos desenhados por especialistas. Eles compararam a HCIA com mais de vinte modelos de IA de ponta, incluindo redes convolucionais tradicionais e híbridos mais recentes baseados em transformers. Em quase todas as métricas — quão bem as regiões previstas de pólipos se sobrepõem aos rótulos de especialistas, quão precisamente as formas são capturadas e quão bem as estruturas se alinham — a HCIA ficou no topo ou igualou os melhores concorrentes. Foi especialmente forte em testes entre diferentes conjuntos de dados, um cenário exigente que imita como uma ferramenta deve funcionar em hospitais com equipamentos e condições de imagem variados. Comparações visuais detalhadas mostraram que a HCIA capturou com mais confiabilidade formas irregulares de pólipos e limites tênues em comparação com métodos rivais.

O que isso significa para pacientes e clínicos

Para leigos, a conclusão principal é que a HCIA é um sistema de IA que contorna com mais precisão crescimentos potencialmente cancerosos em imagens de colonoscopia, ao mesmo tempo em que roda rápido o suficiente para uso em tempo real. Ao combinar detalhes locais nítidos com um forte senso de contexto geral — e fazendo isso de maneira eficiente — ela reduz as chances de que pólipos sutis ou de formato estranho passem despercebidos. Embora o modelo ainda precise de otimização adicional para dispositivos muito leves e não utilize, por enquanto, informações de sequências de vídeo ao longo do tempo, ele representa um passo relevante rumo a assistência computacional mais inteligente e confiável na triagem do câncer colorretal — apoiando médicos a identificar mais lesões perigosas antes que se tornem fatais.

Citação: Li, L., Yang, H., Zhang, J. et al. Hierarchical contextual information aggregation for polyp segmentation. Sci Rep 16, 5959 (2026). https://doi.org/10.1038/s41598-026-35703-2

Palavras-chave: pólipos colorretais, IA para colonoscopia, segmentação de imagens médicas, aprendizado profundo, detecção precoce do câncer