Clear Sky Science · pt

Sinapses neo-Hebbianas para acelerar o treinamento online de hardware neuromórfico

Ensinando Chips a Aprender com a Experiência

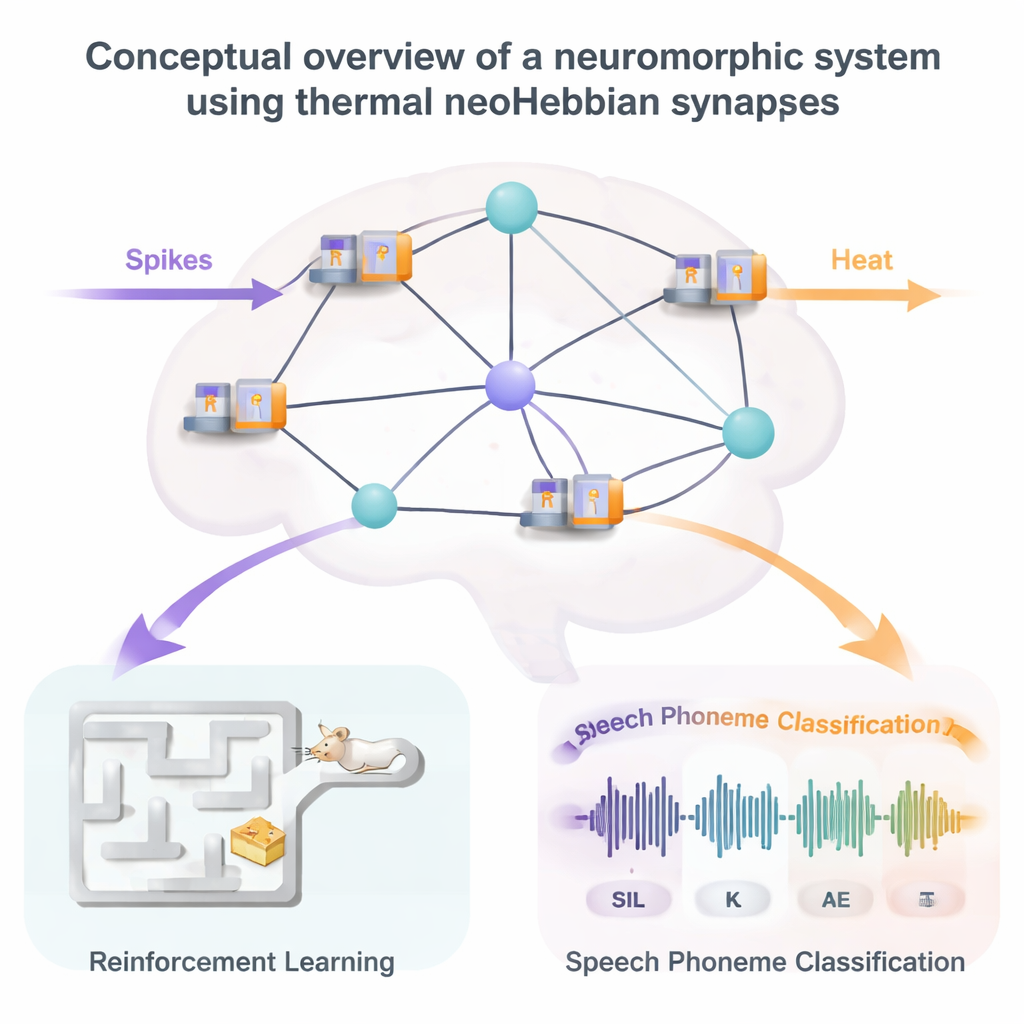

A inteligência artificial moderna é notavelmente poderosa, mas ainda está longe de igualar a habilidade do cérebro de aprender a partir de feedback esparso e atrasado — como lembrar qual atalho na cidade realmente economizou tempo. Este artigo apresenta um novo tipo de "sinapse" artificial, as conexões entre neurônios artificiais, que permite que chips neuromórficos aprendam de maneira mais parecida com o cérebro, online, mantendo-se compactos e energeticamente eficientes. Para leitores interessados no futuro do hardware de IA, mostra como o próprio calor pode ser aproveitado como um sinal útil para aprendizado dentro de minúsculos dispositivos de memória.

Por que Cérebros Neuromórficos Precisam de Melhores Sinapses

A computação neuromórfica busca imitar como o cérebro processa informação: usando redes neurais de pulsos, onde breves picos elétricos atravessam vastas redes de sinapses. O hardware atual já pode implementar sinapses usando componentes memristivos como ReRAM, cuja condutância elétrica pode ser ajustada para armazenar um peso. Entretanto, regras simples de aprendizado “hebbiano” — em que as sinapses se fortalecem ou enfraquecem puramente a partir do tempo relativo dos pulsos locais — têm dificuldades em tarefas realistas que exigem vincular eventos separados no tempo, como entender fala ou resolver problemas de navegação. Técnicas padrão de deep learning tratam isso com retropropagação através do tempo, mas esse método consome muita memória e energia para hardware no estilo cerebral. A comunidade, portanto, recorreu a regras de aprendizado de “três fatores” e algoritmos como a elegibilidade por retropropagação (e‑prop), que introduzem uma pista de memória local adicional em cada sinapse para que um sinal global de recompensa atrasado ainda possa ajustar as conexões corretas.

Armazenando uma Memória Degradante no Calor

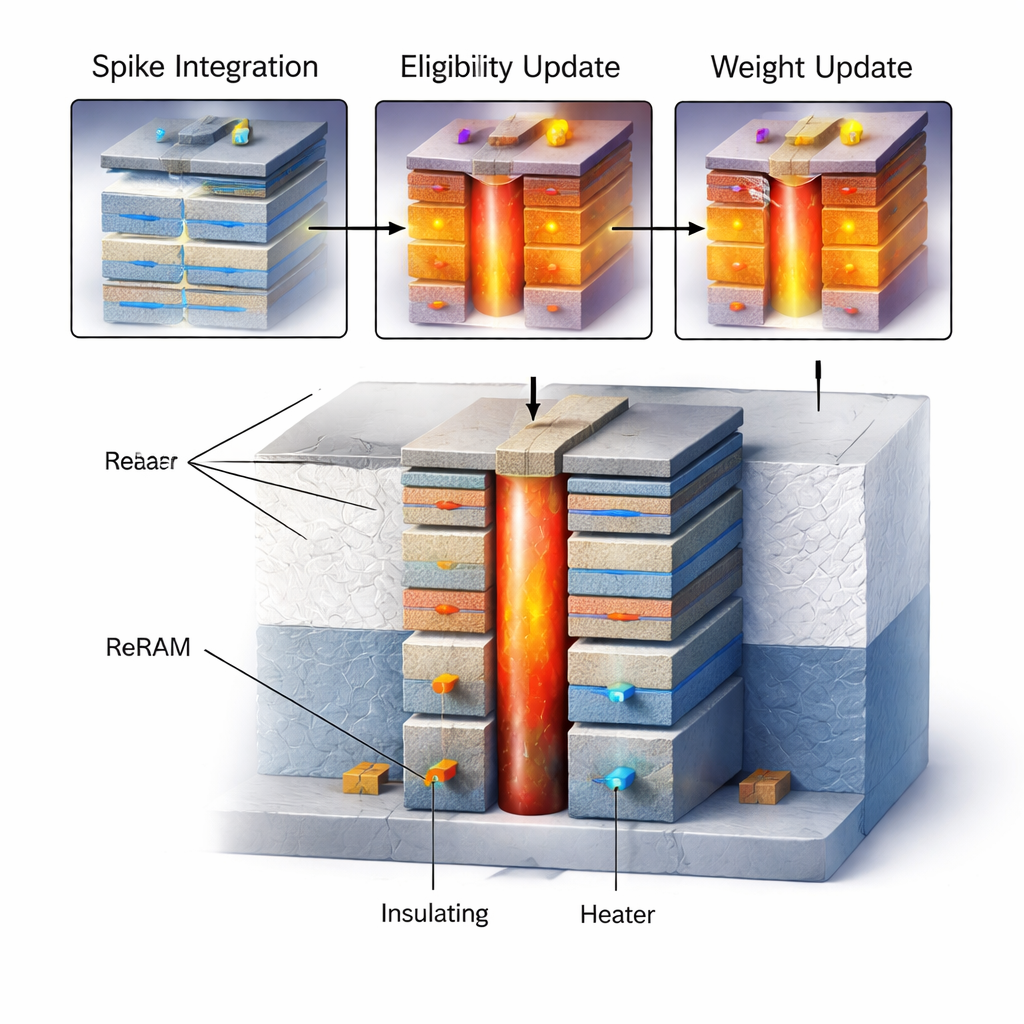

A ideia central deste trabalho é uma sinapse “neo‑Hebbiana” que tem duas variáveis de estado internas: um peso de acoplamento de longo prazo e uma pista de elegibilidade de curto prazo que lembra atividade recente. O peso é codificado, como de costume, na condutância de um dispositivo ReRAM. A pista de elegibilidade, em contraste, é armazenada na temperatura local desse dispositivo, controlada por um aquecedor resistivo em escala nanométrica integrado diretamente acima ou ao lado dele. Durante o processamento normal de pulsos, o ReRAM simplesmente multiplica os pulsos de entrada pelo peso armazenado. Durante o aprendizado, sinais gerados pelos neurônios correspondentes a “o que disparou antes” e “quão sensível o neurônio pós‑sináptico está atualmente” conduzem corrente através do pequeno aquecedor. Como o aquecedor e o ReRAM são acoplados termicamente, essa potência eleva a temperatura do dispositivo proporcionalmente ao produto desses dois sinais — a pista de elegibilidade matemática exigida pelo algoritmo e‑prop.

Como o Calor Muda a Memória

Uma vez que uma sequência curta de entrada — chamada de dataframe — é processada, o aumento de temperatura acumulado codifica quão “elegível” essa sinapse está para mudar. Um pulso de programação fixo é então aplicado ao ReRAM. Crucialmente, experimentos detalhados mostram que a mudança resultante na condutância depende fortemente da temperatura: dispositivos mais quentes mudam mais, e a direção e magnitude dessa mudança dependem do estado inicial de condutância e de se o dispositivo está sendo condicionado para uma condutância maior ou menor. Ao escolher cuidadosamente as amplitudes dos pulsos e explorando essa sensibilidade à temperatura, os autores organizam para que a mudança de peso seja aproximadamente proporcional à elegibilidade armazenada. Modelos numéricos de fluxo térmico em um empilhamento 3D integrado de aquecedor + ReRAM confirmam que a temperatura pode ser elevada e permitir que decaia em escalas de tempo ajustáveis, e que a estrutura pode ser projetada para aumentar o autoaquecimento desejado enquanto limita o “crosstalk” térmico para sinapses vizinhas.

Testando as Sinapses Térmicas

Para avaliar se essa sinapse exótica é realmente útil, os autores simulam sistemas neuromórficos completos que incluem comportamentos realistas do dispositivo, como decaimento de temperatura, variabilidade entre dispositivos e precisão incompleta. Em uma demonstração, uma rede de pulsos controla um rato virtual que deve aprender a navegar um labirinto em grade para encontrar queijo evitando armadilhas. Aqui, o resfriamento térmico natural — que lentamente corrói a elegibilidade armazenada — atua como o “fator de desconto” familiar do aprendizado por reforço: pares estado‑ação recentes importam mais que os antigos. As simulações mostram que o aprendizado é mais rápido quando esse decaimento não é nem rápido demais nem lento demais, e que a variabilidade no comportamento do ReRAM degrada o desempenho apenas gradualmente. Em um segundo teste mais exigente, uma rede recorrente de pulsos com sinapses neo‑Hebbianas térmicas é treinada online no benchmark de classificação de fonemas TIMIT, uma tarefa padrão de reconhecimento de fala. Com resolução de condutância suficiente (equivalente a cerca de 8 bits), o modelo consciente do hardware alcança precisão dentro de poucos pontos percentuais de uma implementação ideal em ponto flutuante.

O Que Isso Significa para o Futuro do Hardware de IA

No geral, o estudo demonstra que a temperatura local pode servir como uma memória interna prática e controlável para regras de aprendizado avançadas, permitindo treinamento rápido no chip sem grande sobrecarga digital. A sinapse proposta ocupa cerca da mesma área que uma célula ReRAM convencional, mas implementa tanto um peso estável quanto uma pista degradante, e seu custo energético por passo de aprendizado está na faixa de picojoules. Embora depender do calor levante desafios reais — temperatura é difícil de medir diretamente e pode acelerar o desgaste do dispositivo — o trabalho sugere que abraçar, em vez de combater, efeitos eletrotérmicos poderia desbloquear novas classes de hardware de aprendizado compacto. Para não especialistas, a conclusão é que chips de IA futuros podem não apenas mover elétrons: eles também poderão computar com padrões de calor cuidadosamente projetados, aproximando o aprendizado de máquina da eficiência e adaptabilidade do cérebro humano.

Citação: Pande, S., Bezugam, S.S., Bhattacharya, T. et al. NeoHebbian synapses to accelerate online training of neuromorphic hardware. Sci Rep 16, 6836 (2026). https://doi.org/10.1038/s41598-026-35641-z

Palavras-chave: computação neuromórfica, redes neurais de pulsos, sinapse ReRAM, aprendizado online, IA eficiente em hardware