Clear Sky Science · pt

CRFusion: uma nova rede de fusão LiDAR-câmera para construção de mapas BEV

Mapas digitais mais inteligentes para carros autônomos

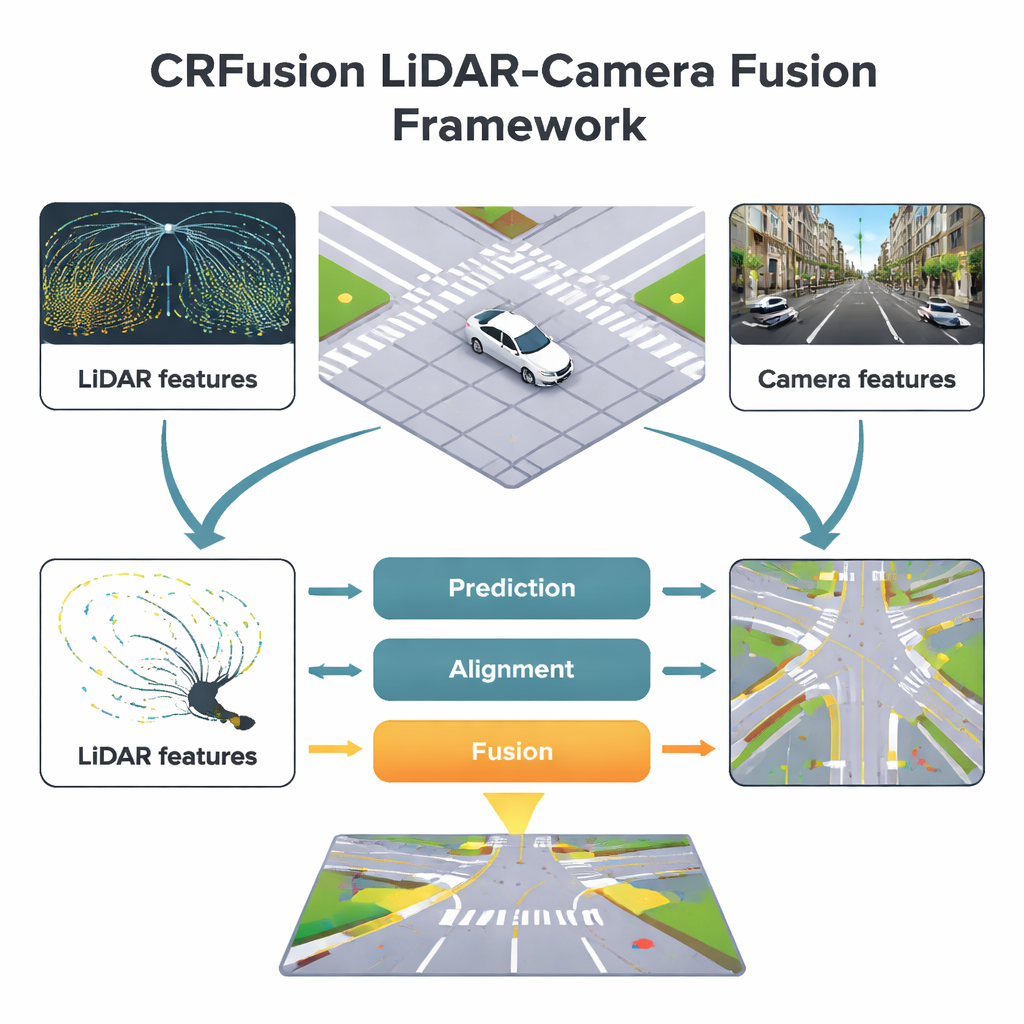

Para um carro autônomo, entender a estrada à frente é como ler um mapa em constante mudança. O veículo precisa saber com precisão onde estão as faixas, as faixas de pedestres e as bordas da pista, mesmo quando está escuro, chovendo ou algo obstrui a visão. Este artigo apresenta o CRFusion, um novo sistema que combina scanners a laser e câmeras para construir mapas aéreo-ortogonais mais limpos e confiáveis das ruas da cidade, ajudando veículos autônomos a manter a trajetória e evitar pedestres com maior segurança.

Por que dois “olhos eletrônicos” são melhores que um

Veículos autônomos modernos dependem fortemente de dois sensores principais. Câmeras capturam imagens ricas em cor, facilitando identificar pintura de faixas, sinais de trânsito e faixas de pedestres a longa distância. Scanners a laser, ou LiDAR, emitem pulsos de luz e medem seu retorno, construindo uma representação 3D precisa das distâncias e formas ao redor do carro. Cada um tem limitações: imagens de câmera podem enganar em condições de baixa iluminação ou mau tempo, enquanto medições LiDAR tornam-se esparsas e incompletas com o aumento da distância. O CRFusion foi projetado para fundir essas forças e fraquezas em uma única visão aérea — um mapa de cima para baixo onde cada pixel representa um pequeno trecho do solo rotulado como faixa, divisor ou faixa de pedestres.

Preenchendo as lacunas na visão de longo alcance

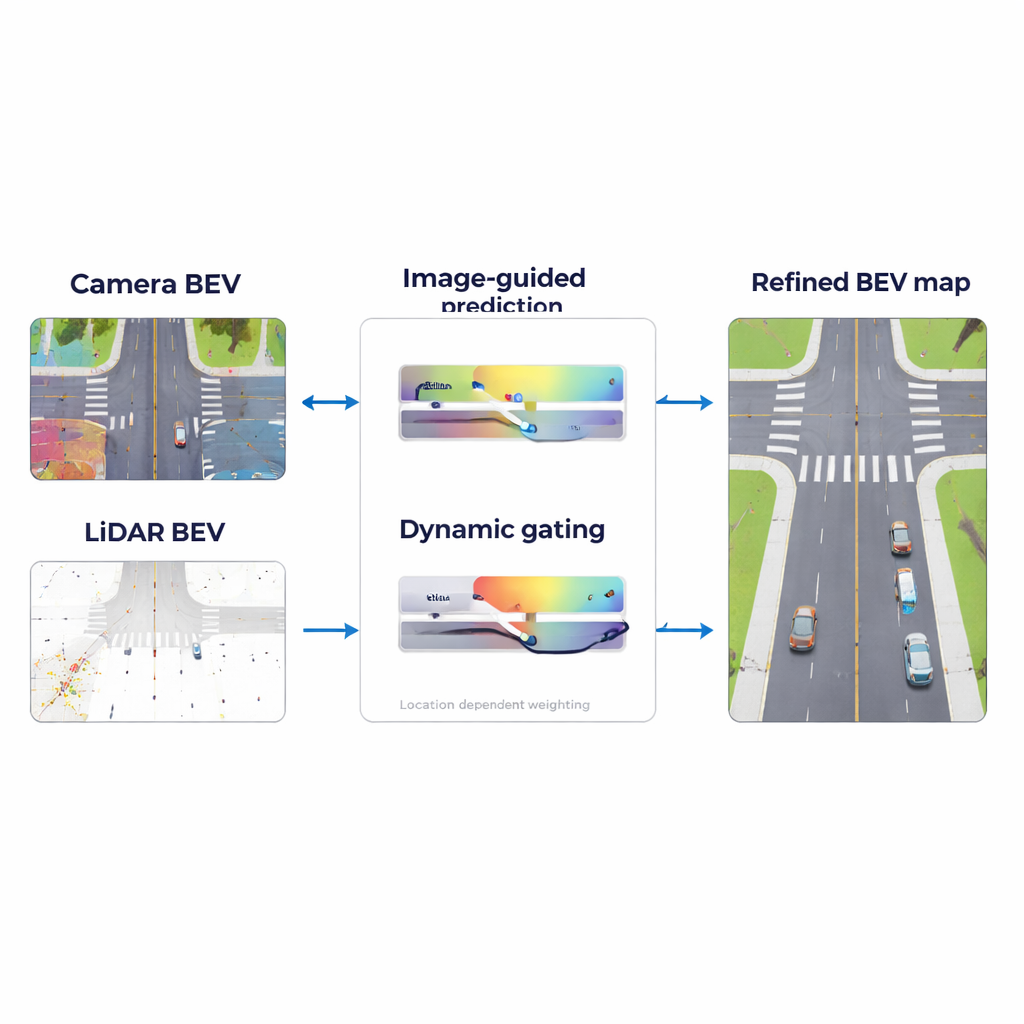

Um desafio central no mapeamento de vias é que o LiDAR frequentemente perde detalhes longe do veículo, justamente onde o planejamento antecipado é mais importante. O CRFusion enfrenta isso com um “Previsor de Alcance do LiDAR”. Em termos simples, o sistema observa o que a câmera enxerga mais adiante e usa essa informação para inferir o que o LiDAR teria medido se fosse denso e completo. Um mecanismo chamado atenção ajuda o modelo a decidir quais partes da visão da câmera explicam melhor as áreas vazias ou incertas no mapa baseado em LiDAR. Em seguida, ele refina essa previsão comparando regiões próximas no mapa, reforçando padrões consistentes — como linhas contínuas de faixa — e reduzindo ruído aleatório.

Fazendo os sensores concordarem sobre a mesma cena

Mesmo quando câmera e LiDAR estão funcionando, eles nem sempre se alinham perfeitamente. Pequenos erros em estimativas de distância ou no posicionamento dos sensores podem fazer com que marcações de faixa vistas pela câmera apareçam ligeiramente deslocadas em relação às leituras do LiDAR. O CRFusion introduz uma etapa de alinhamento que “distorce” suavemente as características top-down da câmera para que combinem melhor com a visão do LiDAR. Isso é feito usando uma rede de correção leve que prevê como cada ponto no mapa da câmera deve ser deslocado. Como resultado, as duas visões descrevem as mesmas posições físicas na estrada, tornando a fusão subsequente muito mais confiável.

Adaptando-se ao dia, à noite e a mau tempo

Uma vez alinhadas as duas vistas dos sensores, o sistema ainda precisa decidir quanto confiar em cada uma em cada localização. Uma rodovia ensolarada com pintura de faixa clara é muito diferente de uma noite chuvosa em uma cidade movimentada. O CRFusion resolve isso com um módulo de “Fusão Dinâmica por Portão” que atribui pesos flexíveis às características da câmera e do LiDAR ao longo do mapa. Onde os retornos do LiDAR são fortes — como bordas de pista próximas ou objetos sólidos — o sistema confia mais no LiDAR. Onde pistas visuais são mais claras — como faixas de pedestre brilhantes à distância — ele depende mais da câmera. Esses pesos são aprendidos automaticamente a partir dos dados, permitindo que a estratégia de fusão mude suavemente conforme as condições variam.

Provando os benefícios em dados do mundo real

Os pesquisadores testaram o CRFusion em um conjunto de dados amplamente usado para direção autônoma chamado NuScenes, que inclui muitas cenas de direção em diferentes cidades, climas e momentos do dia. Em comparação com métodos anteriores de ponta, o CRFusion produziu limites de faixa, divisores e faixas de pedestres mais precisos, especialmente em distâncias médias e longas de até 90 metros. Melhorou medidas padrão de qualidade tanto para sobreposição com mapas de referência quanto para a capacidade de detectar segmentos individuais de faixa, e um estudo de “ablação” mostrou que cada componente principal — a previsão de longo alcance, a rede de alinhamento e a fusão dinâmica — contribuiu com ganhos significativos. Exemplos visuais revelaram continuidade de faixa mais suave e faixas de pedestre mais nítidas, confirmando que os mapas do sistema se assemelham mais a plantas de vias cuidadosamente desenhadas.

O que isso significa para a condução cotidiana

Para não especialistas, a principal conclusão é que o CRFusion ajuda carros autônomos a construir mapas de ruas mais limpos e confiáveis ao permitir que câmeras e LiDAR “conversem” de forma mais inteligente. Ao prever informações LiDAR faltantes a partir de vistas de câmera, alinhar as duas perspectivas de sensor e ajustar quanto confiar em cada uma conforme a situação, o sistema reduz pontos cegos e incertezas. Isso aproxima os veículos autônomos de lidar com ruas urbanas complexas e cheias de obstáculos com a mesma confiança de um motorista humano cuidadoso seguindo faixas e travessias bem marcadas.

Citação: Guan, Y., Wang, T., Cheng, Q. et al. CRFusion: a novel LiDAR-camera fusion network for BEV map construction. Sci Rep 16, 5169 (2026). https://doi.org/10.1038/s41598-026-35551-0

Palavras-chave: direção autônoma, fusão LiDAR-câmera, mapas semânticos HD, percepção bird’s-eye view, mapeamento de vias urbanas