Clear Sky Science · pt

O papel da diagnosticidade ao julgar a competência de robôs

Por que as falhas dos robôs importam para todos nós

Robôs e sistemas de IA estão rapidamente saindo dos laboratórios e entrando em fábricas, hospitais e nossas ruas. À medida que passamos a confiar neles, uma pergunta torna‑se crucial: como as pessoas decidem se um robô é realmente competente? Este artigo explora como julgamos um robô que geralmente atua bem, mas ocasionalmente comete um erro surpreendente — ou realiza um sucesso inesperado. Os achados ajudam a explicar por que nossas “intuições” sobre máquinas podem diferir do que dizemos em voz alta e por que um único erro pode ser desconsiderado ou transformar permanentemente nossa confiança.

Dupla via de avaliação da mente

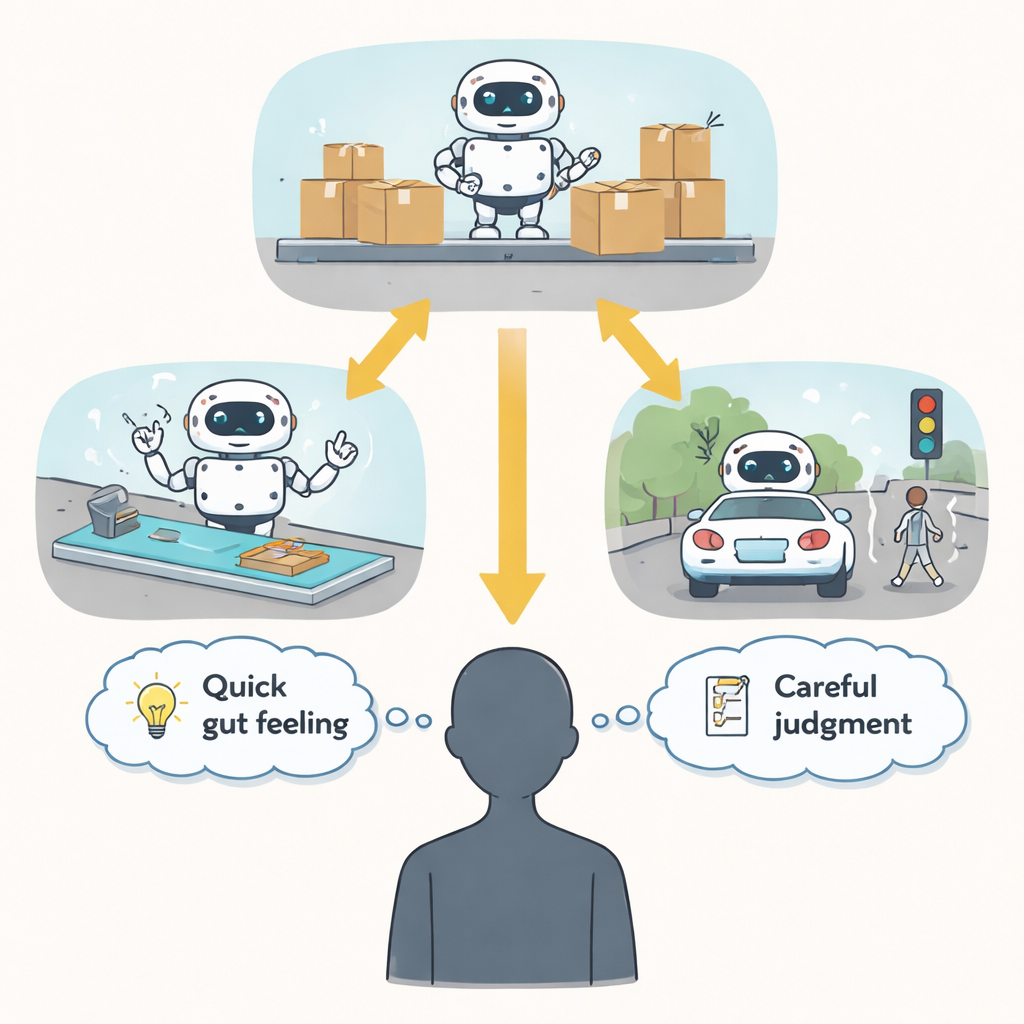

Psicólogos distinguem dois tipos de impressões. Impressões explícitas são os julgamentos que podemos relatar diretamente quando solicitados, como avaliar um robô numa escala de competência de 1 a 7. Impressões implícitas são mais automáticas, refletidas em respostas rápidas que as pessoas dão sem focar explicitamente na avaliação. Trabalhos anteriores sugeriram que impressões explícitas mudam rapidamente ao observar novo comportamento, enquanto impressões implícitas são mais lentas. Este estudo pergunta se essa diferença realmente reflete sistemas mentais distintos — ou se depende de o quão informativo, ou diagnóstico, o novo comportamento parece ser sobre as habilidades reais do robô.

Das linhas de produção às salas de cirurgia e às rodovias

Em nove experimentos online com mais de 3.700 participantes, os pesquisadores mostraram pessoas diferentes robôs atuando em cenários realistas: um robô industrial navegando por um armazém lotado, um robô cirúrgico traçando caminhos precisos e um carro autônomo reagindo a obstáculos na estrada. Às vezes o robô era consistentemente habilidoso ou consistentemente desajeitado. Em outros casos, era em sua maioria competente, mas com um único erro claro, ou em sua maioria incompetente, mas com um sucesso destacado. Após assistir a sequências curtas dessas performances, as impressões dos participantes foram medidas de duas maneiras: perguntas diretas de autorrelato e tarefas indiretas que captavam reações rápidas e automáticas.

Quando uma performance estranha ganha peso

Nesses cenários realistas, as avaliações explícitas das pessoas refletiram tanto o padrão geral de desempenho quanto a ocorrência rara — o “oddball”. Um erro isolado entre muitos sucessos podia reduzir notavelmente as avaliações explícitas, e um sucesso isolado entre muitas falhas podia elevá‑las. As impressões implícitas, no entanto, contaram outra história. Elas responderam fortemente ao comportamento típico do robô — se geralmente era competente ou não — mas em grande parte ignoraram o único oddball. Essa dissociação permaneceu mesmo quando os pesquisadores redesenharam cuidadosamente suas medidas para que as tarefas “explícitas” e “implícitas” parecessem e se sentissem o mais semelhantes possível, diferindo principalmente em o fato de os participantes terem sido instruídos a julgar o robô deliberadamente.

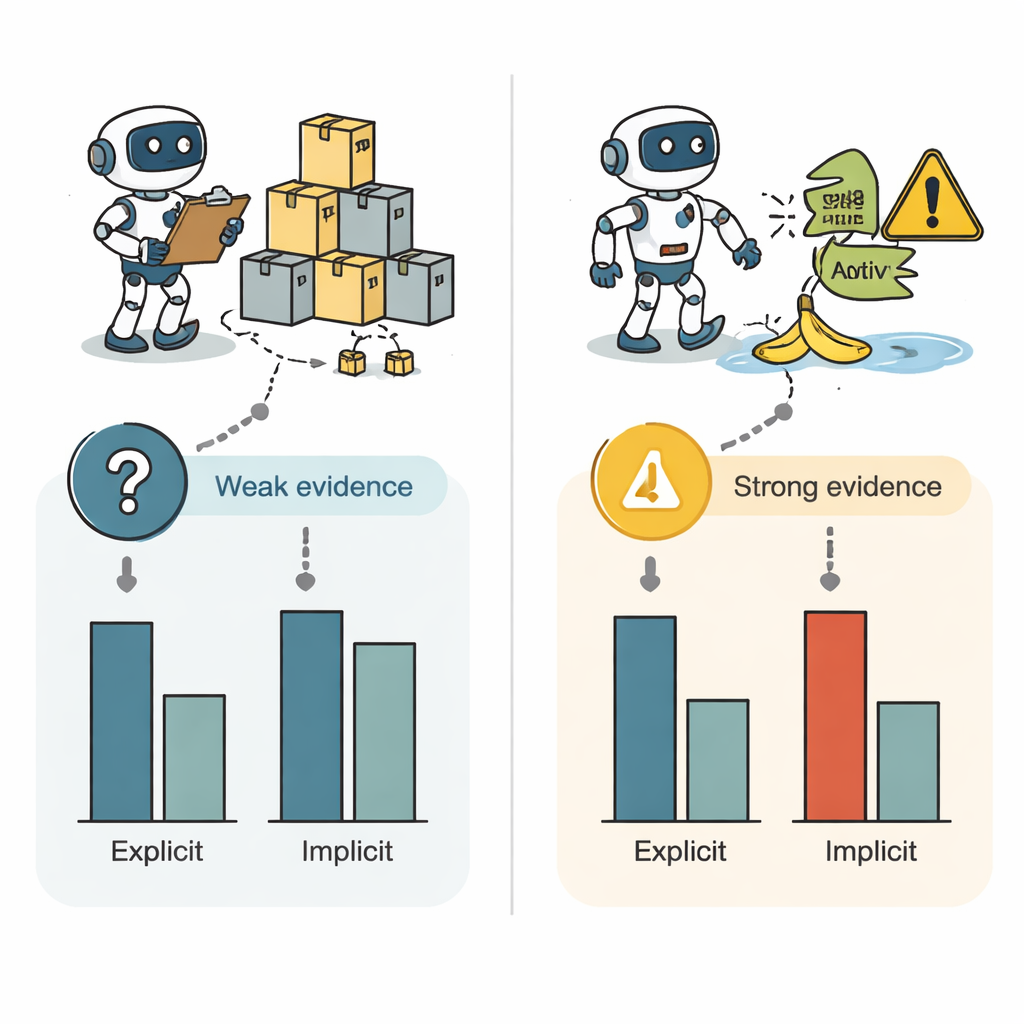

O que torna um erro de robô realmente revelador

Em seguida, a equipe testou uma ideia central: que o impacto de um evento oddball depende de quão diagnóstico ele parece — se as pessoas acreditam que ele realmente revela algo duradouro sobre o robô. Em novos estudos, os participantes primeiro viram o robô executar várias tentativas perfeitas e, depois, ver falhas. Quando as falhas posteriores foram enquadradas como importantes, testes recentes, ou quando várias falhas se acumularam até igualar a quantidade de sucesso anterior, tanto impressões explícitas quanto implícitas foram afetadas. Crucialmente, sob essas condições de alta diagnosticidade até mesmo um único erro foi suficiente para deslocar impressões automáticas e implícitas. Quando o mesmo tipo de deslize foi descrito como desatualizado, sem importância ou um acidente isolado, as impressões implícitas mal se moveram, apesar de as avaliações explícitas ainda se alterarem.

Por que isso importa para a confiança cotidiana em IA

Considerados em conjunto, os achados sugerem que nossas impressões rápidas e automáticas sobre a competência de robôs não são alheias a novas informações, mas exigem evidências mais fortes ou claramente significativas para mudar. Nossas avaliações verbais, em contraste, são altamente responsivas mesmo a eventos fracos ou ambíguos, em parte porque sentimos a pressão de usar a informação disponível quando alguém pede um julgamento. Para designers, engenheiros e formuladores de políticas, isso significa que gerir a confiança em robôs não é apenas reduzir erros, mas também cuidar de como esses erros são enquadrados e compreendidos. Uma única falha altamente reveladora — como um carro que não freia quando claramente deveria — pode remodelar tanto nossas intuições quanto nossas opiniões declaradas, com consequências diretas para a disposição de adotar e depender de máquinas inteligentes.

Citação: Surdel, N., Ferguson, M.J. The role of diagnosticity in judging robot competence. Sci Rep 16, 7578 (2026). https://doi.org/10.1038/s41598-026-35375-y

Palavras-chave: competência de robô, interação humano‑robô, viés implícito, confiança em IA, informação diagnóstica