Clear Sky Science · pt

YOLOv11n aprimorado para detecção de pequenos objetos em imagens de VANT: maior precisão com menos parâmetros

Por que identificar coisas minúsculas do alto é importante

Veículos aéreos não tripulados (drones) estão se tornando parte do cotidiano, desde monitoramento de tráfego e resposta a desastres até entrega de pacotes. Mas há um problema persistente: quando um drone observa o solo a centenas de metros, pessoas, carros e barcos se reduzem a apenas alguns pixels. Sistemas de visão computacional padrão frequentemente não detectam esses pontinhos ou os confundem com ruído de fundo. Este artigo apresenta uma versão mais inteligente e enxuta de um sistema de detecção popular, o YOLOv11n, especialmente ajustada para localizar esses pequenos objetos em imagens de drone, mantendo eficiência em computadores embarcados de baixo consumo.

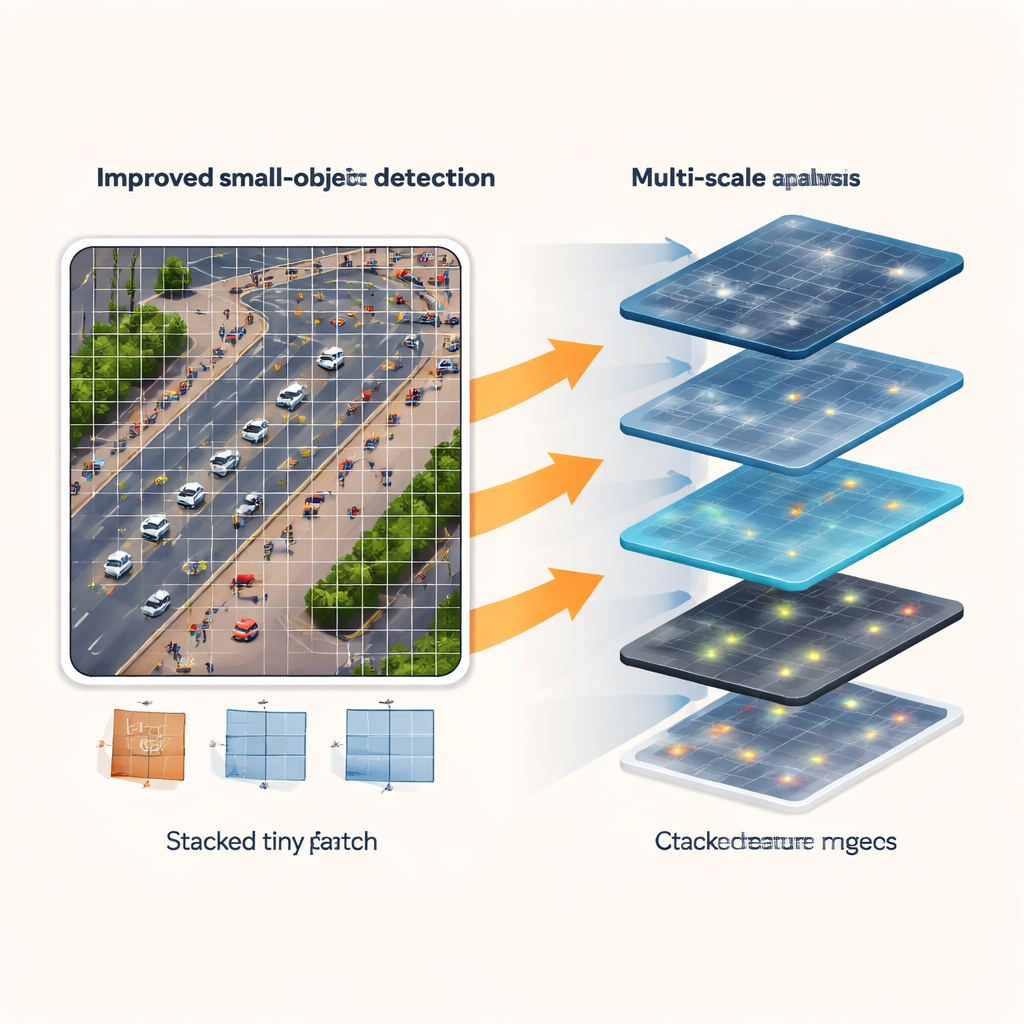

Vendo mais nos detalhes pequenos e borrados

Imagens de drone são desafios severos para algoritmos. A maioria dos alvos é menor que 32×32 pixels, e muitos têm menos de 16 pixels de largura. Movimento, vibração, variação de iluminação, neblina e fundos urbanos ocupados tornam esses alvos ainda mais difíceis de distinguir. Ao mesmo tempo, drones frequentemente dependem de processadores modestos e energia limitada, de modo que modelos pesados são impraticáveis. Os autores partem do YOLOv11n, um detector compacto em tempo real, e redesenham seus componentes internos para extrair mais informação útil de regiões pequenas e de baixo contraste sem inflar o modelo. O objetivo é simples, porém exigente: aumentar significativamente a precisão em objetos pequenos, com igual ou menor número de parâmetros treináveis e velocidade aceitável em hardware de borda.

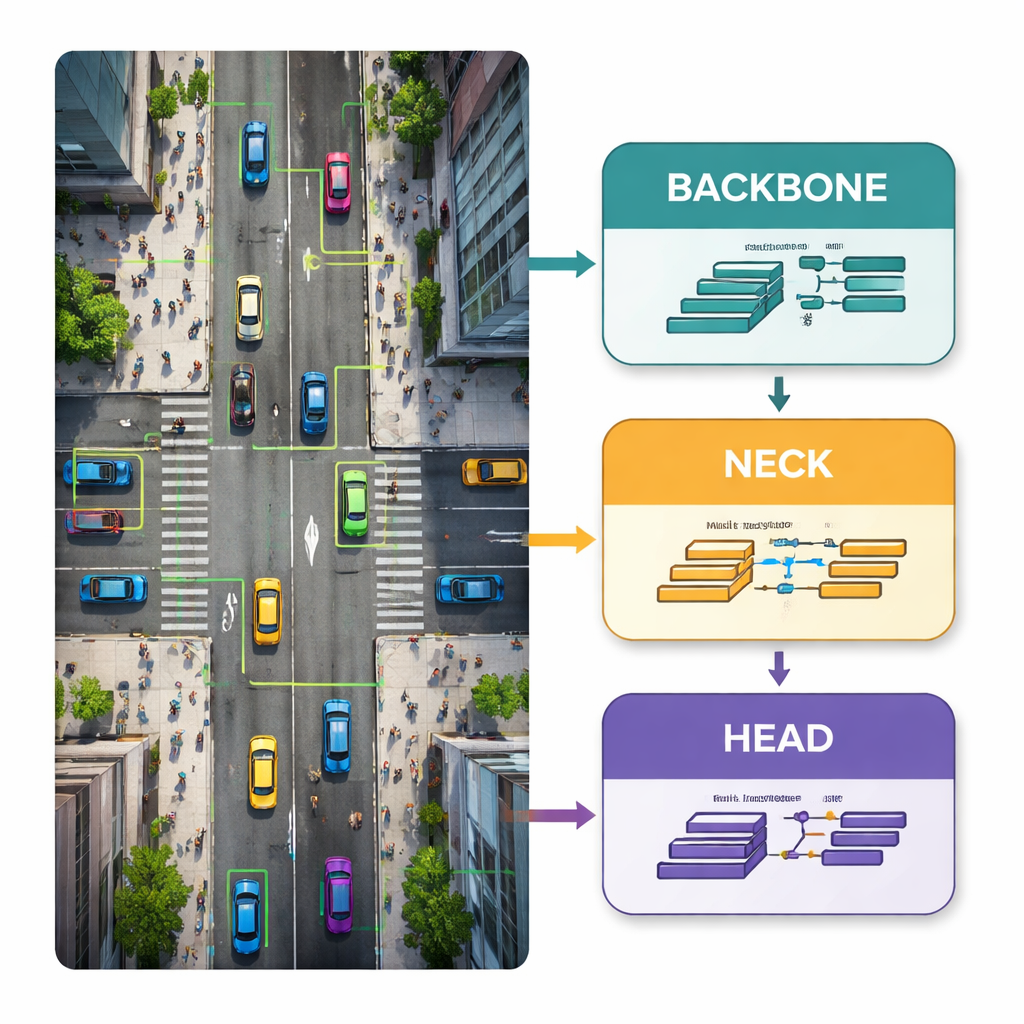

Aprender a cena em várias escalas

A primeira melhoria foca em como a rede “vê” a cena. Em vez de observar através de uma única janela de tamanho fixo, o novo módulo Multiscale Edge-Feature Adaptive Selection (MSEAF) analisa a imagem em várias escalas simultaneamente. Visões mais amplas capturam a disposição geral de estradas, edifícios e multidões, enquanto visões mais finas acompanham carros ou pessoas individuais. Uma etapa de realce de contornos enfatiza limites e formas que são fáceis para humanos perceberem, mas que frequentemente se perdem em pequenos fragmentos de imagem. Um mecanismo de fusão inteligente então realça as regiões mais informativas ao mesmo tempo que suprime o ruído de fundo. Essa representação multiescala e sensível a contornos fornece ao restante da rede um ponto de partida mais rico para localizar objetos difíceis de ver.

Preservando pequenos objetos ao longo do pipeline

Redes YOLO tradicionais reduzem repetidamente os mapas de características à medida que a informação flui da entrada para a saída. Para objetos grandes, isso é aceitável, mas para os minúsculos pode ser fatal: após várias reduções, um pedestre pode ocupar apenas um ou dois pixels em um mapa interno, ou desaparecer por completo. Para evitar isso, os autores reestruturam a parte intermediária (o “pescoço”) da rede e adicionam uma nova cabeça de detecção P2 que opera sobre características de maior resolução. Módulos customizados chamados ScalCat e Scal3DC combinam cuidadosamente informação de diferentes camadas para que detalhes finos de camadas rasas e contexto mais rico de camadas profundas se reforcem mutuamente. O resultado é um detector que acompanha pequenos carros e pessoas em múltiplas escalas, em vez de sacrificá-los em nome da velocidade.

Decisões mais precisas com menos parâmetros

A etapa final é simplificar a fase de predição, conhecida como cabeça de detecção. No desenho original, camadas mais profundas com muitos canais eram dedicadas principalmente a objetos grandes, que são relativamente raros em cenas de drone. A nova cabeça Shared Re-parameterized Detection (SRepD) equaliza a contagem de canais entre escalas e emprega um truque de treinamento inteligente: durante o aprendizado, vários ramos convolucionais especializados exploram diferentes formas de destacar características; no momento da inferência, esses ramos são matematicamente fundidos em uma única convolução simples. Esse desenho compartilhado e reparametrizado melhora a fusão de características ao mesmo tempo em que reduz o número de parâmetros e mantém os cálculos manejáveis para dispositivos de borda.

O que os números mostram em testes do mundo real

O modelo aprimorado foi testado em três conjuntos públicos desafiadores: VisDrone2019 (cenas urbanas mistas), TinyPerson (pessoas extremamente pequenas em terra e mar) e HazyDet (veículos em forte neblina vistos por drone). No VisDrone2019, o novo projeto eleva uma medida-chave de precisão (mAP50) e a precisão por 4,6 pontos percentuais em comparação com o YOLOv11n original, ao mesmo tempo que reduz os parâmetros em cerca de 8,5%. No TinyPerson, as melhorias são ainda maiores — cerca de 5,9 pontos percentuais em mAP50 e 5,6 em precisão — com redução de parâmetros semelhante, e o modelo compacto supera até um YOLOv11s muito maior que usa quatro vezes mais parâmetros. Em condições de neblina, o detector aprimorado também supera a linha de base nas medidas de precisão e robustez, tudo isso mantendo velocidades em tempo real em uma placa de borda de baixo consumo Huawei Atlas 200 DK.

Por que isso importa para o uso cotidiano de drones

Para não especialistas, a principal conclusão é que esta pesquisa mostra que drones podem ficar ao mesmo tempo mais perspicazes e mais eficientes em recursos. Ao repensar onde e como a rede busca detalhes, preservar informação de alta resolução para alvos pequenos e simplificar a maquinaria de predição, os autores rompem a troca usual entre precisão e tamanho. O sistema resultante é melhor em detectar pessoas e veículos pequenos e distantes em cenas lotadas, nebulosas ou complexas, sem exigir hardware volumoso. Esse tipo de avanço aproxima a monitoração aérea confiável e em tempo real — para segurança no trânsito, busca e salvamento e observação ambiental — de uma implantação cotidiana.

Citação: Zhu, H., Xie, X. Enhanced YOLOv11n for small object detection in UAV imagery: higher accuracy with fewer parameters. Sci Rep 16, 5536 (2026). https://doi.org/10.1038/s41598-026-35301-2

Palavras-chave: detecção de objetos por drone, reconhecimento de pequenos objetos, rede neural YOLO, análise de imagens aéreas, IA de borda para VANTs