Clear Sky Science · pt

Detecção eficiente de resumos científicos gerados por IA com um transformer leve

Por que identificar textos científicos escritos por IA importa

À medida que a inteligência artificial se torna habilidosa na escrita, ela pode redigir resumos científicos que parecem quase indistinguíveis dos produzidos por humanos. Isso levanta questões difíceis: como periódicos, universidades e leitores podem ter certeza de que um resumo realmente reflete o trabalho de um pesquisador e não a invenção de uma máquina? Este artigo aborda esse problema construindo uma ferramenta rápida e compacta capaz de sinalizar resumos científicos gerados por IA com alta confiabilidade, oferecendo uma defesa prática à integridade acadêmica.

Montando um conjunto de testes com resumos reais e sintéticos

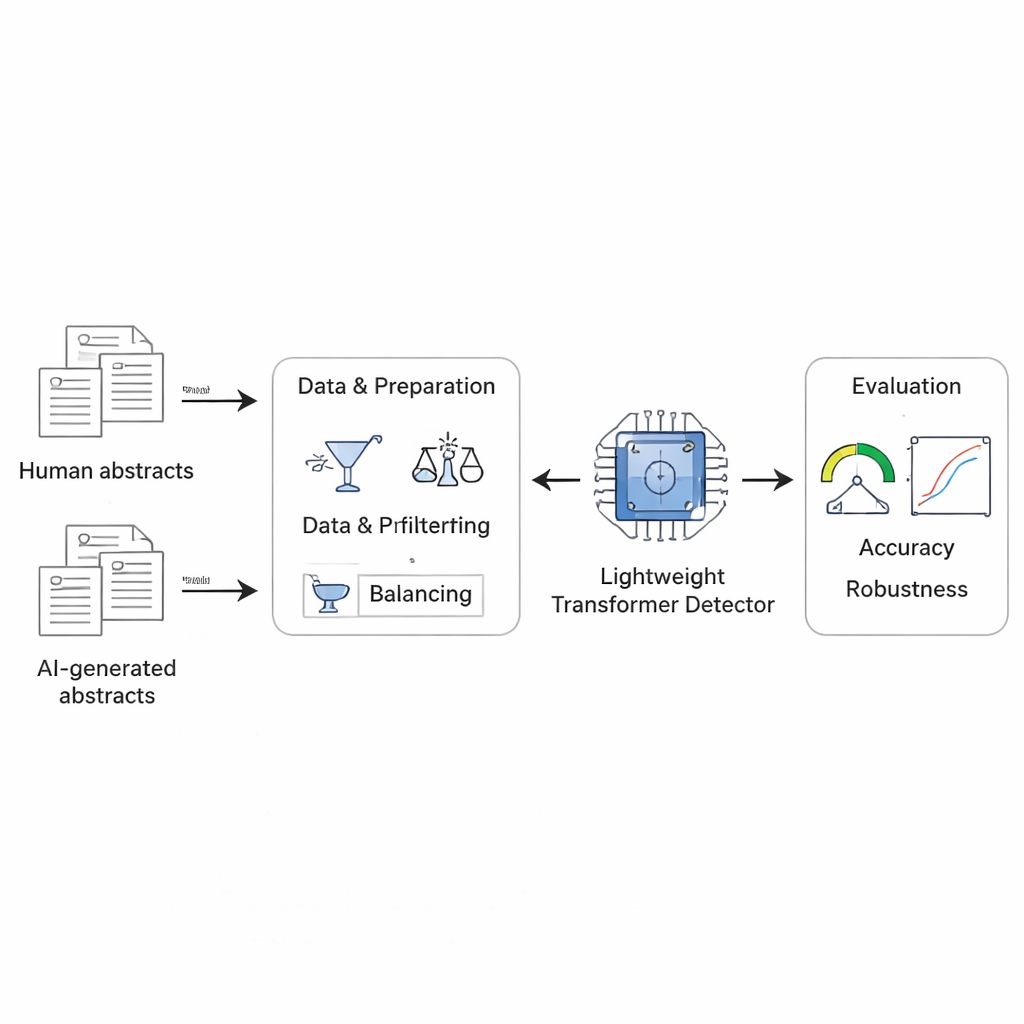

Para medir e aprimorar a detecção de texto por IA, os autores primeiro precisaram de dados confiáveis. Eles coletaram 5.000 resumos científicos do servidor de preprints arXiv, cobrindo cinco áreas: visão computacional, processamento de sinais, biologia quantitativa, física e outros tópicos de ciência da computação. Para cada resumo escrito por humanos, usaram um grande modelo de linguagem para gerar uma versão por IA a partir do título do artigo, checando cuidadosamente por textos quase duplicados e removendo pistas óbvias, como endereços da web ou trechos de código. Também garantiram que os textos de IA e humanos tivessem comprimentos semelhantes, para que o detector não pudesse se apoiar apenas em estatísticas grosseiras como contagem de palavras.

Um modelo compacto ajustado para o mundo real

Em vez de usar um modelo de IA enorme e caro, os pesquisadores optaram por um sistema menor conhecido como DistilBERT, uma versão enxuta de um modelo de linguagem popular. Eles o ajustaram (fine-tuned) para decidir, em cada resumo, se foi escrito por uma pessoa ou gerado por IA. O modelo lê até 256 tokens — aproximadamente alguns parágrafos — e produz uma pontuação entre zero e um, interpretada como a probabilidade de o texto ter sido escrito por máquina. Treinamento e avaliação seguiram um protocolo rigoroso: os dados foram divididos em conjuntos de treinamento, validação e teste sem sobreposição, e a equipe reportou não apenas a acurácia, mas também como o modelo se comporta quando a taxa permitida de alarmes falsos é mantida muito baixa, um regime que importa ao acusar autores reais do uso de IA.

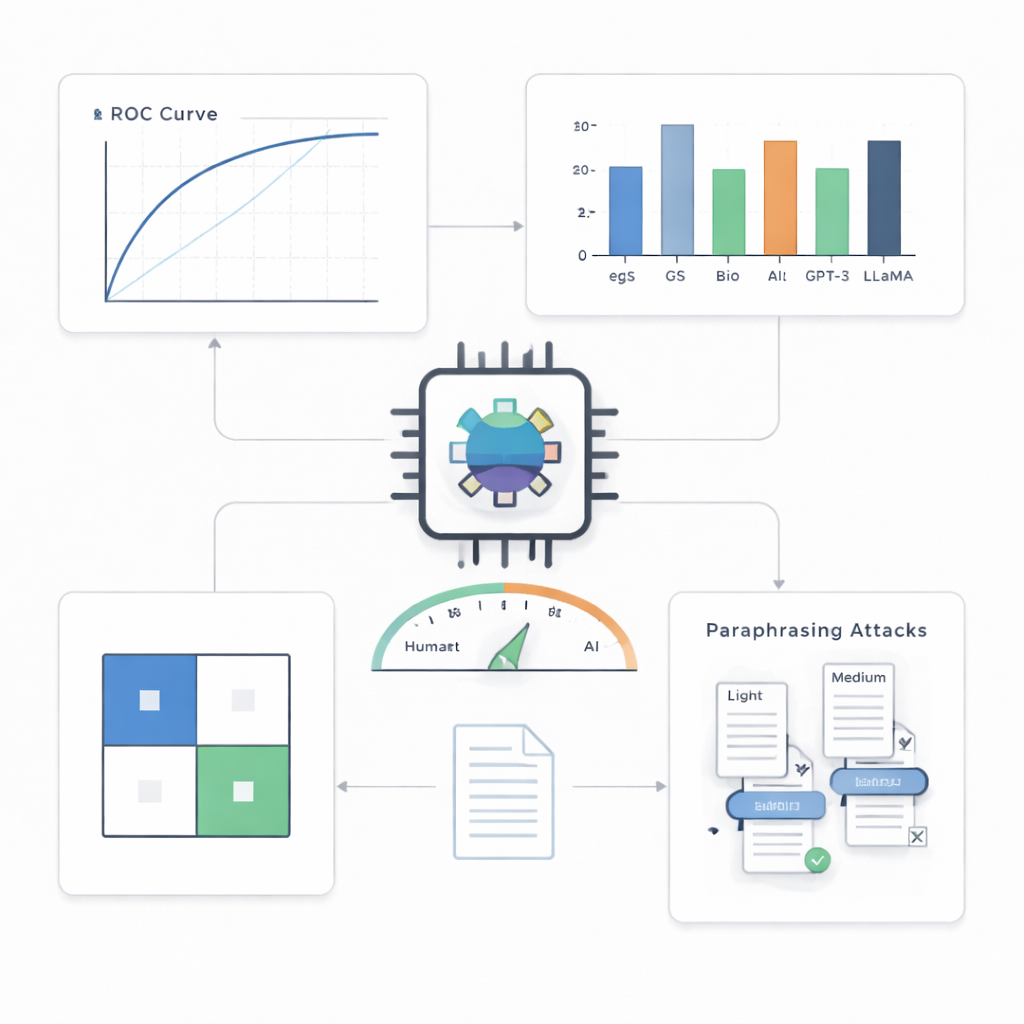

Como o detector se sai

Nos resumos de visão computacional, o principal conjunto de testes, o detector foi notavelmente preciso. Rotulou corretamente 499 de 500 textos gerados por IA e 495 de 500 textos humanos, atingindo cerca de 99,4% de acurácia e uma pontuação quase perfeita em uma curva de desempenho padrão. Quando os autores forçaram o sistema a cometer no máximo uma falsa acusação em cada cem casos, ele ainda captou cerca de 90% dos textos de IA; com uma tolerância um pouco maior de cinco alarmes falsos por cem, detectou cerca de 97%. Em comparação com uma série de alternativas — incluindo ferramentas estatísticas mais simples e outros modelos transformer — o detector compacto saiu consistentemente na frente, especialmente em cenários mais exigentes.

Além de um campo, um modelo e truques simples

Uma questão chave é se esse detector consegue lidar com estilos de escrita e sistemas de IA que nunca encontrou. Os autores o testaram em resumos de outras áreas científicas e em textos produzidos por vários modelos avançados de linguagem. Entre domínios, o desempenho permaneceu forte, com quedas modestas, sugerindo que o sistema captura padrões gerais da escrita por IA em vez de idiossincrasias de uma área específica. Contra modelos de IA não vistos, também teve bom desempenho, embora menos perfeito do que em seu ambiente original. O desafio mais difícil veio de ataques de paráfrase: quando outra IA reescreveu resumos gerados por máquina para soar diferente mantendo o significado, a detecção ficou notavelmente mais difícil. Sob reescrita de força média, a parcela de textos de IA que passaram despercebidos subiu para quase 30%, revelando que mesmo detectores sofisticados podem ser enganados por ofuscação deliberada.

O que isso significa para a ciência e suas salvaguardas

O estudo mostra que, por enquanto, resumos científicos escritos por IA ainda deixam traços sutis que um modelo bem projetado pode captar, mesmo quando esse modelo é pequeno o bastante para rodar em hardware modesto. Isso torna viável que editoras, conferências e universidades filtrar grandes volumes de submissões sem custos computacionais enormes. Ao mesmo tempo, a vulnerabilidade à paráfrase ressalta que tais ferramentas não são uma solução única. Os autores defendem que a detecção de texto por IA deva ser combinada com outras salvaguardas — como julgamento editorial, verificações de plágio e exigências de transparência — para proteger a confiabilidade da comunicação científica à medida que os sistemas de IA continuam a melhorar.

Citação: Zhang, C., Zhou, W. Efficient detection of AI-generated scientific abstracts with a lightweight transformer. Sci Rep 16, 4975 (2026). https://doi.org/10.1038/s41598-026-35203-3

Palavras-chave: detecção de texto por IA, resumos científicos, integridade acadêmica, grandes modelos de linguagem, texto gerado por máquina