Clear Sky Science · pt

Avaliação do ChatGPT-4o e do Gemini para o manejo da gota: uma análise comparativa com base nas diretrizes da EULAR

Por que chatbots inteligentes e articulações doloridas importam

A gota, uma forma dolorosa de artrite que frequentemente atinge o dedão do pé, está se tornando mais comum ao redor do mundo. Os médicos já dispõem de diretrizes claras e baseadas em evidências sobre como diagnosticar e tratar a doença, mas muitos pacientes ainda não recebem um cuidado ideal. Ao mesmo tempo, chatbots de inteligência artificial potentes, como o ChatGPT-4o e o Gemini, estão começando a aparecer em contextos clínicos, levantando uma pergunta simples e crucial: essas ferramentas podem realmente fornecer aconselhamento seguro e consistente com as diretrizes sobre gota, ou elas podem induzir médicos e pacientes ao erro?

Avaliando o quanto os chatbots seguem o manual

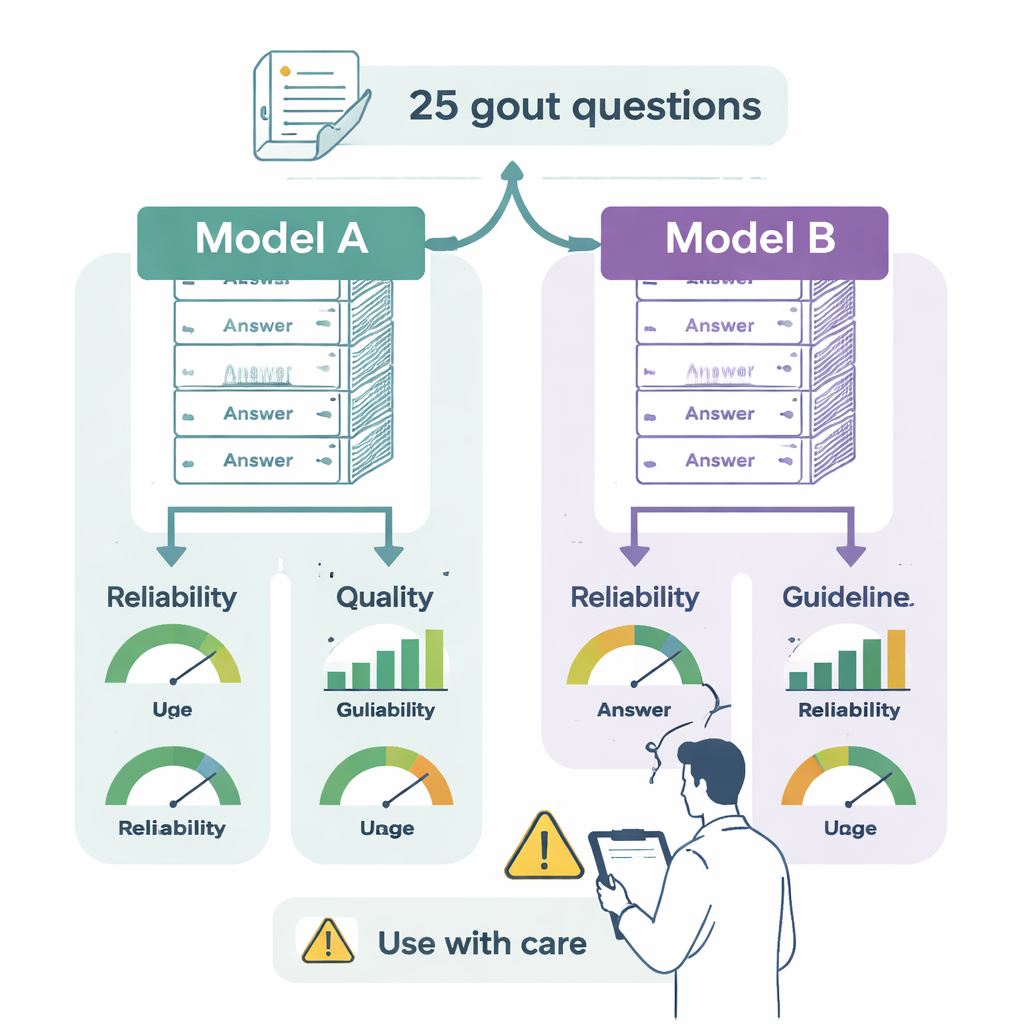

Os pesquisadores propuseram-se a testar dois dos principais modelos de linguagem — ChatGPT-4o e Gemini 2.0 Flash — em relação às diretrizes oficiais europeias (EULAR) para gota. Dois especialistas transformaram 25 recomendações-chave das diretrizes em perguntas no estilo de clínicos sobre questões do mundo real: como diagnosticar a gota, quando iniciar drogas redutoras de urato, como manejar crises, quais metas buscar em exames laboratoriais e como ajustar estilo de vida ou outros medicamentos. Ambos os chatbots receberam as mesmas perguntas em sessões separadas e limpas, de modo que respostas anteriores não influenciassem as seguintes.

Como as respostas foram pontuadas

Cada resposta foi avaliada por dois clínicos experientes em gota, que não sabiam qual modelo havia produzido cada texto. Eles pontuaram três aspectos. Primeiro, confiabilidade: a resposta parece equilibrada, objetiva e digna de confiança, ou omite fatos-chave ou exagera benefícios? Segundo, qualidade: a resposta é clara, bem organizada e útil para um especialista que toma decisões? Terceiro, alinhamento com a diretriz: corresponde ao que a EULAR realmente recomenda, concorda em parte com lacunas, ou contradiz diretamente as regras? A equipe também avaliou a dificuldade de leitura das respostas usando testes de legibilidade padrão que estimam o nível educacional necessário para compreender um texto.

ChatGPT vs. Gemini: quem se saiu melhor?

Ambos os chatbots produziram respostas, em geral, sensatas e claramente redigidas, e ambos frequentemente lembraram os leitores de consultar um profissional de saúde. Mas surgiram diferenças importantes. O ChatGPT-4o correspondeu integralmente às diretrizes de gota em 76% dos casos e forneceu respostas em sua maioria corretas, porém incompletas, em outros 20%, com apenas uma resposta contendo um erro médico claro. O Gemini esteve totalmente alinhado em 48% das respostas e foi parcialmente correto, porém incompleto, em 32%. Mais preocupante, 12% de suas respostas misturaram ideias corretas com informações erradas, e 8% contradisseram as diretrizes — por exemplo, sugerindo o uso amplo de uma potente classe anti-inflamatória (inibidores de IL-1) onde a EULAR os reserva para pacientes selecionados e de difícil tratamento, ou incentivando o início rotineiro de drogas redutoras de urato durante uma crise aguda, área em que os especialistas recomendam maior cautela.

Legível, mas de leitura difícil

No quesito estilo, os dois sistemas foram surpreendentemente semelhantes. Em várias escalas de leitura, ambos produziram textos que exigiam pelo menos um nível universitário de educação para serem acompanhados confortavelmente. Isso pode ser aceitável para médicos especialistas, mas é muito complexo para a maioria dos pacientes. Nenhum dos modelos forneceu referências ou links para fontes, a menos que solicitado especificamente, o que torna difícil verificar a origem das informações. A concordância entre os avaliadores foi considerada boa a excelente, sugerindo que a pontuação foi consistente e que as diferenças entre os chatbots eram reais, e não apenas questão de opinião.

O que isso significa para pessoas com gota

No geral, o estudo sugere que chatbots avançados podem ser assistentes úteis para médicos que gerenciam a gota, mas não estão prontos para atuar de forma autônoma. O ChatGPT-4o mostrou-se mais confiável, mais completo e mais fiel às diretrizes de especialistas do que o Gemini, ainda que até mesmo seus raros erros possam ser significativos quando envolvem medicamentos e segurança. Ambas as ferramentas comunicaram-se em nível muito complexo para a maioria dos pacientes e carecem de transparência incorporada sobre suas fontes. Por enquanto, argumentam os autores, a IA deve ser vista como uma ferramenta de apoio promissora que pode ajudar clínicos e educadores — mas somente quando seu aconselhamento for verificado frente a diretrizes atualizadas e ao julgamento de especialistas, especialmente em condições como a gota, em que detalhes de dosagem e decisões de tempo podem fazer grande diferença na dor, no dano a longo prazo e na qualidade de vida.

Citação: Meral, H.B., Kolak, E. Evaluation of ChatGPT-4o and Gemini for gout management: a comparative analysis based on EULAR guidelines. Sci Rep 16, 4831 (2026). https://doi.org/10.1038/s41598-026-35166-5

Palavras-chave: gota, diretrizes clínicas, inteligência artificial, modelos de linguagem ampla, reumatologia