Clear Sky Science · pt

Uma abordagem multimodal de aprendizado e simulação para percepção em sistemas de direção autônoma

Carros Autônomos Mais Inteligentes

Carros autônomos prometem estradas mais seguras e menos congestionamento, mas somente se realmente conseguirem entender o mundo ao redor. Este artigo explora uma nova maneira de ajudar veículos autônomos a “ver”, “sentir” e “antecipar” seu entorno de forma mais parecida com um motorista humano atento — combinando diferentes sensores, testando com segurança em uma cópia virtual do mundo real e tornando as decisões do carro mais transparentes para as pessoas.

Ver a Estrada com Muitos “Sentidos”

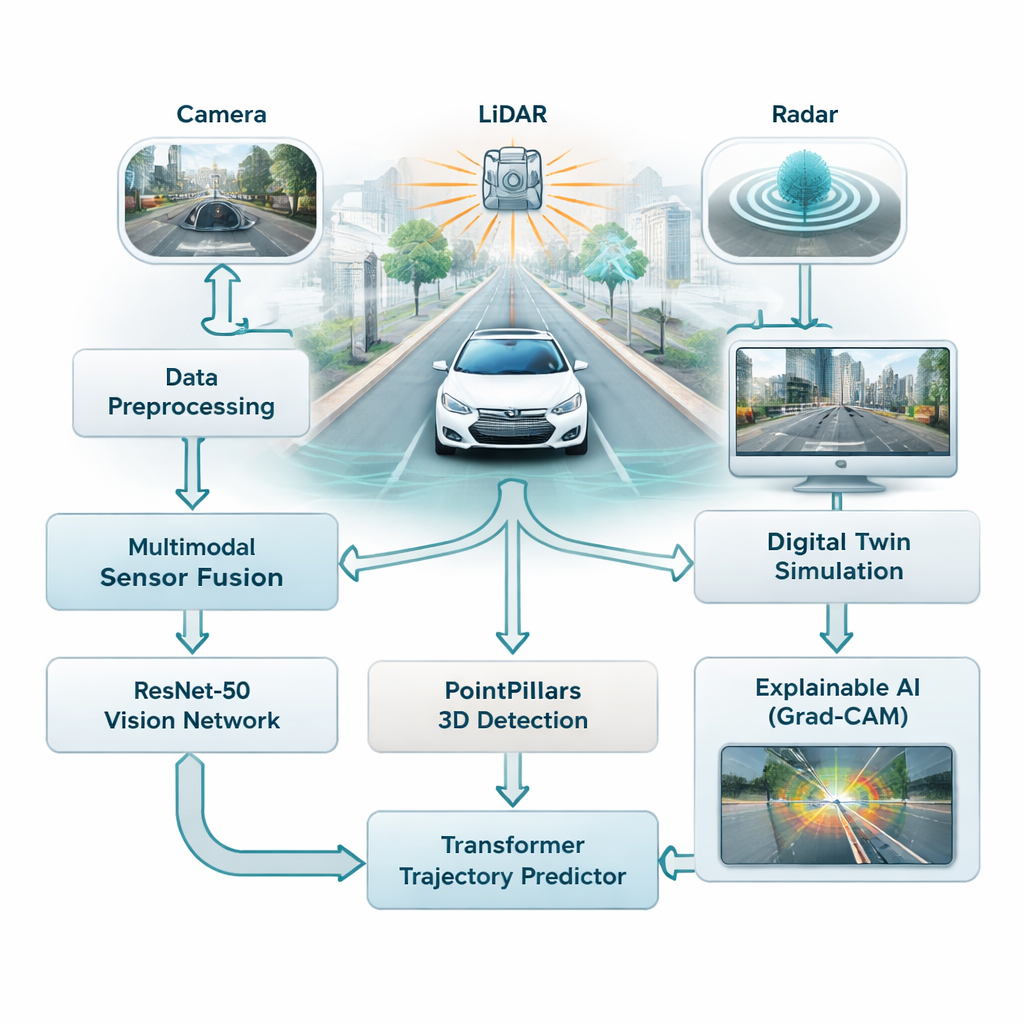

A maioria dos sistemas de assistência ao motorista hoje depende fortemente de câmeras, que funcionam bem com boa iluminação, mas têm dificuldades em neblina, chuva ou à noite. Este estudo combina três tipos de sensores — câmeras, scanners a laser (LiDAR) e radar — para que o carro não dependa de uma única fonte frágil de informação. As câmeras capturam cor e detalhes ricos, o LiDAR constrói uma imagem 3D precisa da cena e o radar permanece confiável em mau tempo. Os autores fundem os três fluxos em uma visão única do tráfego, dando ao veículo uma compreensão mais completa e confiável das vias, pedestres e outros carros.

Ensinando o Carro a Reconhecer e Antecipar

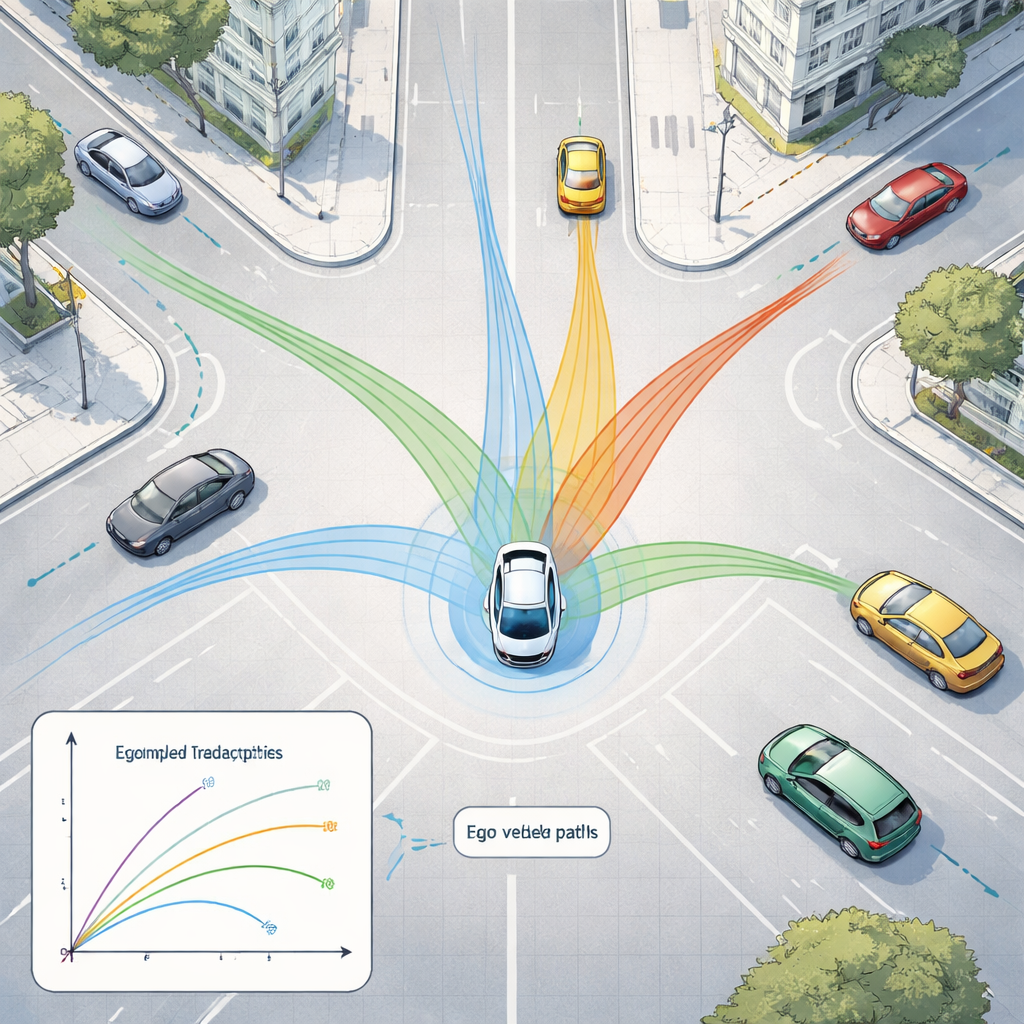

Para dar sentido a essa enxurrada de dados, a estrutura usa duas famílias de modelos de IA modernos. Primeiro, uma rede profunda de imagens chamada ResNet-50 analisa imagens de câmera para capturar a situação geral — quão cheia está a via, onde as faixas são visíveis e como a cena está disposta. Ao mesmo tempo, um modelo 3D chamado PointPillars lê as nuvens de pontos do LiDAR para localizar veículos e outros objetos em três dimensões. Esses sinais são então alimentados em um Transformer, um tipo de IA originalmente projetado para linguagem, que se destaca em entender como as coisas mudam ao longo do tempo. Aqui, ele aprende a prever como veículos próximos e outros objetos em movimento provavelmente irão se deslocar nos próximos segundos, levando em conta tanto seu movimento passado quanto a estrutura da via.

Construindo uma Pista de Testes Virtual Segura

Em vez de testar situações arriscadas diretamente em vias públicas, os pesquisadores conectam seu sistema a um gêmeo digital — uma réplica virtual de ruas reais baseada em um grande conjunto de dados público de Boston e Singapura. Neste mundo simulado, os sensores, o movimento e o entorno do carro são reproduzidos e alterados à vontade, enquanto a IA tenta rastrear objetos e prever suas futuras trajetórias. O sistema pode rodar esses cenários “e se?” em tempo real, com tempos de resposta abaixo de 50 milissegundos, permitindo que engenheiros explorem casos extremos, como frenagens súbitas, curvas acentuadas ou cruzamentos lotados, sem colocar ninguém em risco.

Espiando o “Caixa-preta” da IA

Uma crítica frequente ao aprendizado profundo é que pode ser difícil entender por que o modelo tomou uma decisão específica. Para tratar isso, os autores usam um método chamado Grad-CAM, que destaca as partes de uma imagem que mais influenciaram a saída do modelo. Esses mapas de calor mostram, por exemplo, se a rede está focando em outro carro, em um pedestre ou em uma marcação de faixa ao estimar trajetórias. Embora essa etapa de explicação rode offline e não no loop em tempo real do carro, ela ajuda engenheiros e revisores de segurança a verificar que o sistema está prestando atenção aos indícios corretos, o que é crucial para construir confiança pública.

Quão Melhor Ele Dirige?

Quando testada em centenas de cenas de direção urbana, a estrutura proposta detecta objetos 3D com precisão e prevê movimentos de forma mais exata do que regras físicas simples que assumem velocidade constante ou aceleração estável. Seus erros de previsão — o quanto as posições previstas se desviam da realidade — são significativamente menores do que os desses baselines e próximos aos de um forte modelo recorrente de IA, enquanto ainda rodam rápido o suficiente para uso em tempo real. Experimentos cuidadosos comparando diferentes designs de rede mostram que um modelo de imagem mais profundo e um detector 3D de profundidade média alcançam o melhor equilíbrio entre precisão e velocidade, e que o sistema pode ser implantado em computadores embarcados menores após compressão do modelo.

O que Isso Significa para Motoristas Comuns

Para não especialistas, a mensagem é que carros autônomos mais seguros e confiáveis provavelmente virão de uma abordagem que combine múltiplos sensores, preveja como a cena irá evoluir e seja testada exaustivamente em mundos virtuais realistas. Ao unir percepção, predição, simulação e explicações compreensíveis por humanos em um único projeto, este trabalho aproxima os veículos autônomos de se comportarem como parceiros cautelosos e transparentes na estrada, em vez de máquinas misteriosas.

Citação: Almadhor, A., Al Hejaili, A., Alsubai, S. et al. A multimodal learning and simulation approach for perception in autonomous driving systems. Sci Rep 16, 5505 (2026). https://doi.org/10.1038/s41598-026-35095-3

Palavras-chave: condução autônoma, fusão de sensores, predição de trajetórias, detecção 3D de objetos, simulação de gêmeo digital