Clear Sky Science · pt

Restauração automatizada de imagens para conservação de artefatos históricos usando a hibridização de transfer learning com modelos generativos profundos

Por que consertar arte antiga com IA importa

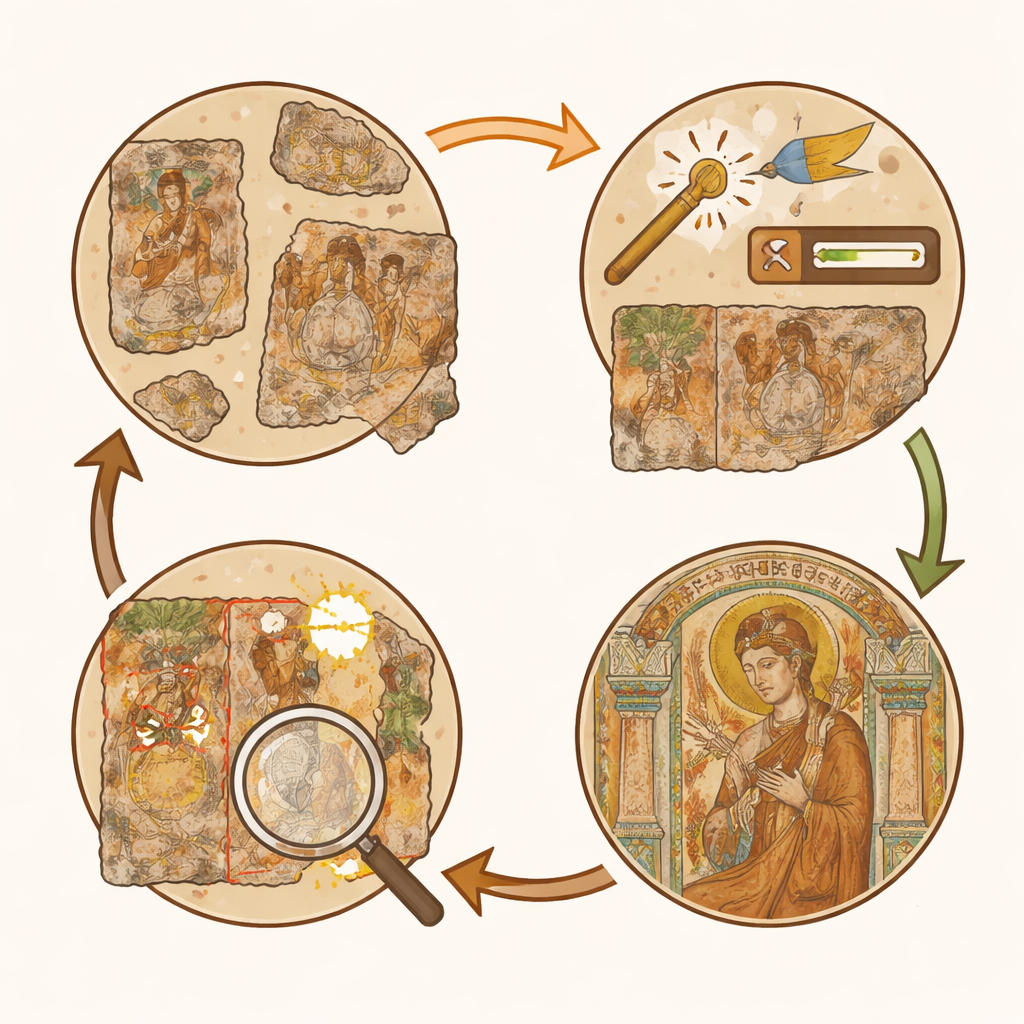

Museus e arqueólogos ao redor do mundo correm contra o tempo. Murais antigos, afrescos e paredes pintadas estão se desfazendo, desbotando e rachando após séculos de exposição à umidade, poluição e manuseio descuidado. Restaurá-los manualmente é lento, caro e às vezes irreversível. Este estudo apresenta um novo sistema de inteligência artificial capaz de reparar digitalmente imagens danificadas de obras históricas, oferecendo a curadores e pesquisadores uma forma segura de visualizar como cenas perdidas podem ter sido e de preservá-las para gerações futuras.

Paredes rachadas, tinta faltante e uma rede de segurança digital

A restauração tradicional costuma significar que um conservador retoca fisicamente a obra, adicionando nova tinta onde a antiga desapareceu. Mesmo feita com cuidado, essas intervenções não são facilmente reversíveis e podem introduzir vieses modernos. A restauração digital segue outro caminho: fotografias em alta resolução de murais danificados são processadas por algoritmos que sugerem como as regiões faltantes poderiam ser preenchidas. Como tudo ocorre em software, as propostas de restauração podem ser comparadas, revisadas ou descartadas sem tocar o objeto físico. Os autores concentram-se em murais de Dunhuang, na China — um famoso complexo de templos em cavernas cujas pinturas de parede sofreram rachaduras, descascamento, fungos e grandes áreas faltantes. O objetivo é construir um sistema que repare automaticamente essas imagens mantendo o estilo, as cores e os detalhes finos o mais intactos possível.

De fotos ruidosas a pontos de partida claros

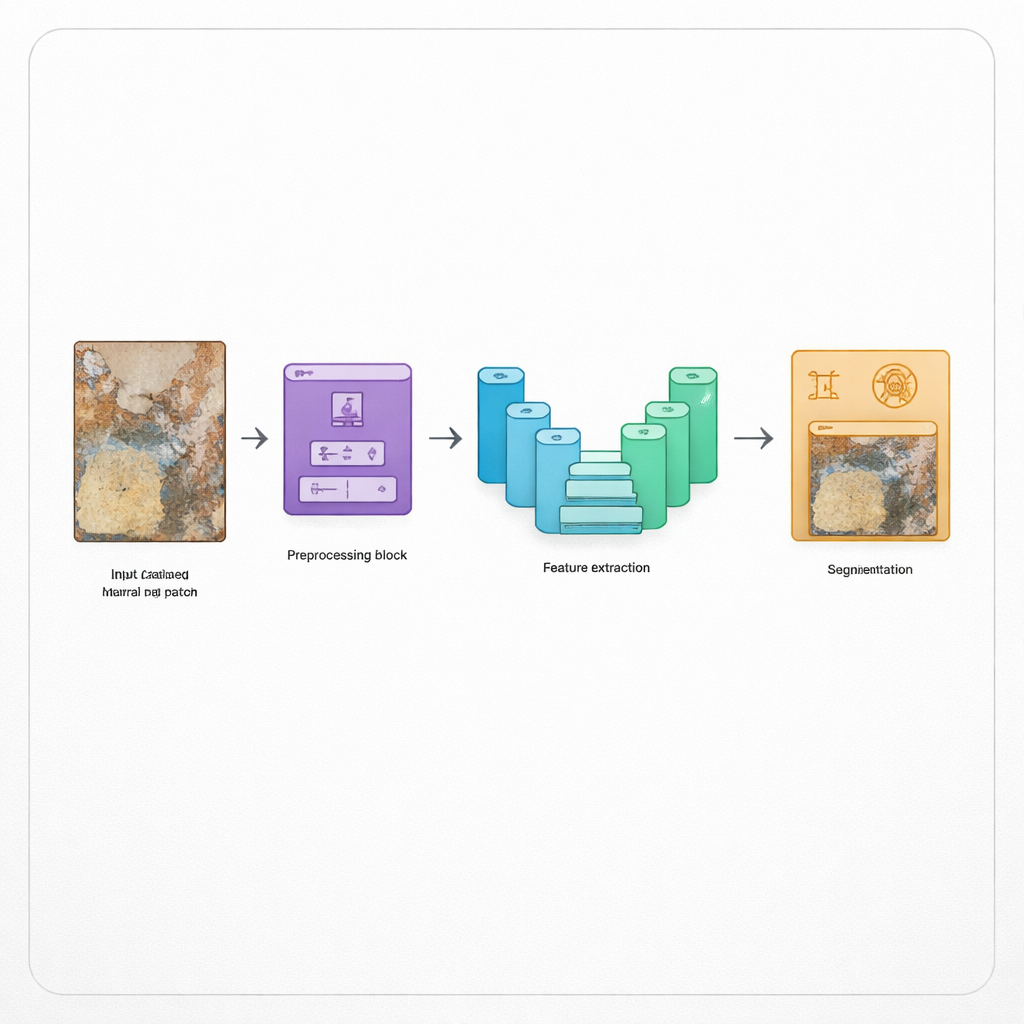

O primeiro passo do sistema é limpar as fotografias de entrada para que o processamento posterior não seja enganado por ruído da câmera ou iluminação ruim. O método utiliza um filtro mediano adaptativo, uma técnica que suaviza saliências e pixels brilhantes ou escuros aleatórios preservando bordas nítidas, como contornos em uma cena mural. Em seguida, aprimora o contraste para que linhas tênues e cores desbotadas fiquem mais fáceis de distinguir. Esses ajustes atuam como polir suavemente uma lente empoeirada: não inventam novo conteúdo, mas tornam detalhes existentes mais visíveis. Ao ajustar cuidadosamente essa etapa, os autores evitam o excesso de suavização, que poderia apagar traços delicados de pincel que interessam aos estudiosos.

Treinando o sistema para entender os danos

Uma vez que a imagem está limpa, o modelo deve decidir quais partes do mural estão intactas e quais estão danificadas. Para isso, os autores usam uma rede neural compacta mas poderosa chamada SqueezeNet, ajustada com um mecanismo de atenção para que foque em regiões informativas. Essa rede aprende a ler a linguagem visual dos murais — texturas do reboco, padrões de pigmento e formatos de rachaduras ou áreas nuas. Sua saída alimenta outra rede chamada U-Net, projetada para tarefas de precisão no estilo “recorte”. A U-Net rotula cada pixel como pintura saudável, área faltante ou outras formas de deterioração. Graças às conexões de salto e aos blocos de atenção e residuais adicionados, ela acompanha tanto a disposição geral (onde uma figura ou borda está) quanto recursos minuciosos (como fios de cabelo e ornamentos), mapeando exatamente onde é necessário o preenchimento.

Deixando um pintor IA preencher as lacunas

Com as regiões danificadas marcadas, a etapa final é imaginar como essas áreas poderiam ter sido originalmente. Aqui os autores combinam duas ideias de ponta: redes adversariais generativas (GANs), especialistas na criação de imagens realistas, e redes transformer, que se destacam em capturar relações de longo alcance. O híbrido “GAN baseado em transformer” observa a tinta intacta ao redor e o mural como um todo para inferir texturas, formas e cores plausíveis para as zonas faltantes. Não se trata de copiar e colar pixels próximos; em vez disso, sintetiza novo conteúdo que se integra suavemente à cena e respeita a composição global, como a simetria de padrões ou a continuidade de mantos e linhas arquitetônicas.

Como o restaurador digital se sai

Para testar o sistema, os pesquisadores utilizaram um conjunto de dados especializado de imagens de murais de Dunhuang que inclui versões artificialmente danificadas e as originais de referência. Isso permite medir quão próximo o resultado restaurado digitalmente chega ao referente intacto. Eles relatam que seu método, chamado HDLIP-SHAR, supera várias técnicas existentes em diversas métricas de qualidade, incluindo clareza geral (PSNR), similaridade estrutural (SSIM) e uma medida perceptual moderna (LPIPS) que reflete melhor o julgamento visual humano. O modelo também roda de forma eficiente, exigindo menos recursos computacionais e menos tempo do que muitas abordagens concorrentes, o que é importante caso museus queiram processar grandes acervos.

O que isso significa para salvar a história

Para não especialistas, a conclusão principal é que esse sistema de IA atua como um assistente cuidadoso e reversível, e não como um pintor confiante demais. Ele pode sugerir como rostos, padrões ou cenas faltantes em murais antigos poderiam ser completados, oferecendo aos estudiosos uma ferramenta poderosa de visualização sem pôr os originais em risco. Ao mesmo tempo, os autores observam limitações: o método ainda depende de material de referência razoavelmente claro, tem dificuldades com danos extremamente severos e ainda não incorpora conhecimentos históricos ou análises de materiais em suas estimativas. Mesmo assim, abordagens híbridas como a HDLIP-SHAR representam um passo importante para usar IA não apenas para embelezar imagens, mas para ajudar a preservar um patrimônio cultural insubstituível de maneira transparente, testável e não invasiva.

Citação: Swathi, B., Rao, D.B.J. Automated image inpainting for historical artifact restoration using hybridisation of transfer learning with deep generative models. Sci Rep 16, 4810 (2026). https://doi.org/10.1038/s41598-026-35056-w

Palavras-chave: restauro digital de murais, reconstrução de imagens, aprendizado profundo, patrimônio cultural, modelos GAN e transformer