Clear Sky Science · pt

Um modelo híbrido inteligente de avaliação para ensino de tradução em inglês com BERT e SVM aprimorados

Por que uma avaliação de tradução mais inteligente importa

Cada ano, professores de línguas gastam incontáveis horas corrigindo traduções de alunos. Decidir se uma frase é “boa o suficiente” é demorado, subjetivo e pode variar bastante de um professor para outro. Este artigo investiga se a inteligência artificial pode compartilhar essa carga—oferecendo pontuações rápidas e consistentes e dicas sobre o que deu errado—sem substituir o docente. Apresenta um novo modelo computacional, chamado BERT-SVM EduScore, projetado especificamente para avaliar a qualidade de traduções para o inglês em contexto educacional.

Do simples emparelhamentos de palavras a uma compreensão mais profunda

Por décadas, computadores julgaram traduções principalmente contando quantas palavras ou frases curtas coincidem com uma resposta de referência. Ferramentas conhecidas, como BLEU ou METEOR, fazem isso muito rapidamente, mas têm dificuldade com a flexibilidade da linguagem natural: duas sentenças podem expressar o mesmo significado com redações bastante diferentes. Na sala de aula, onde alunos experimentam sinônimos e estruturas frasais variadas, essas métricas antigas podem punir injustamente paráfrases válidas e oferecer pouca orientação sobre erros específicos. Por isso, pesquisadores têm recorrido a métodos mais recentes que comparam significados em vez de palavras superficiais, usando modelos de linguagem poderosos treinados em enormes coleções de texto.

Um modelo híbrido construído para salas de aula

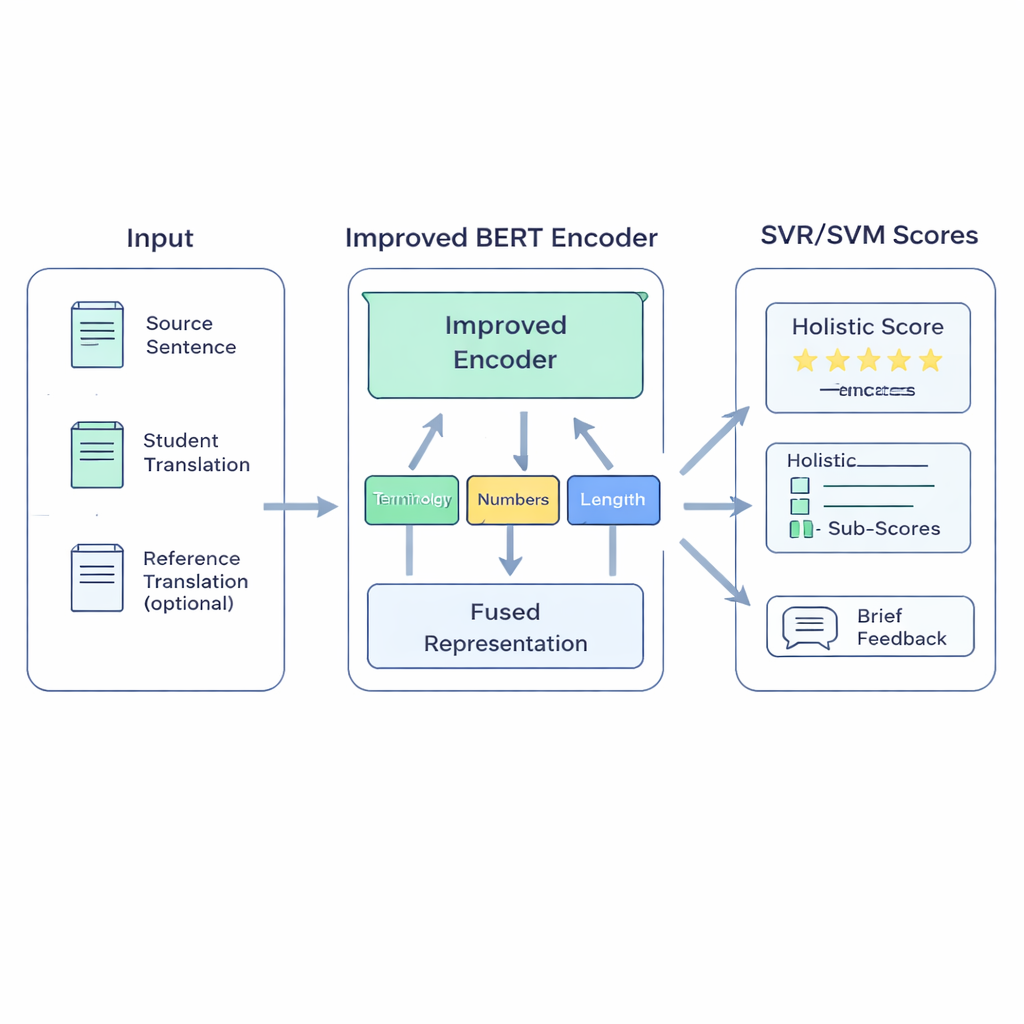

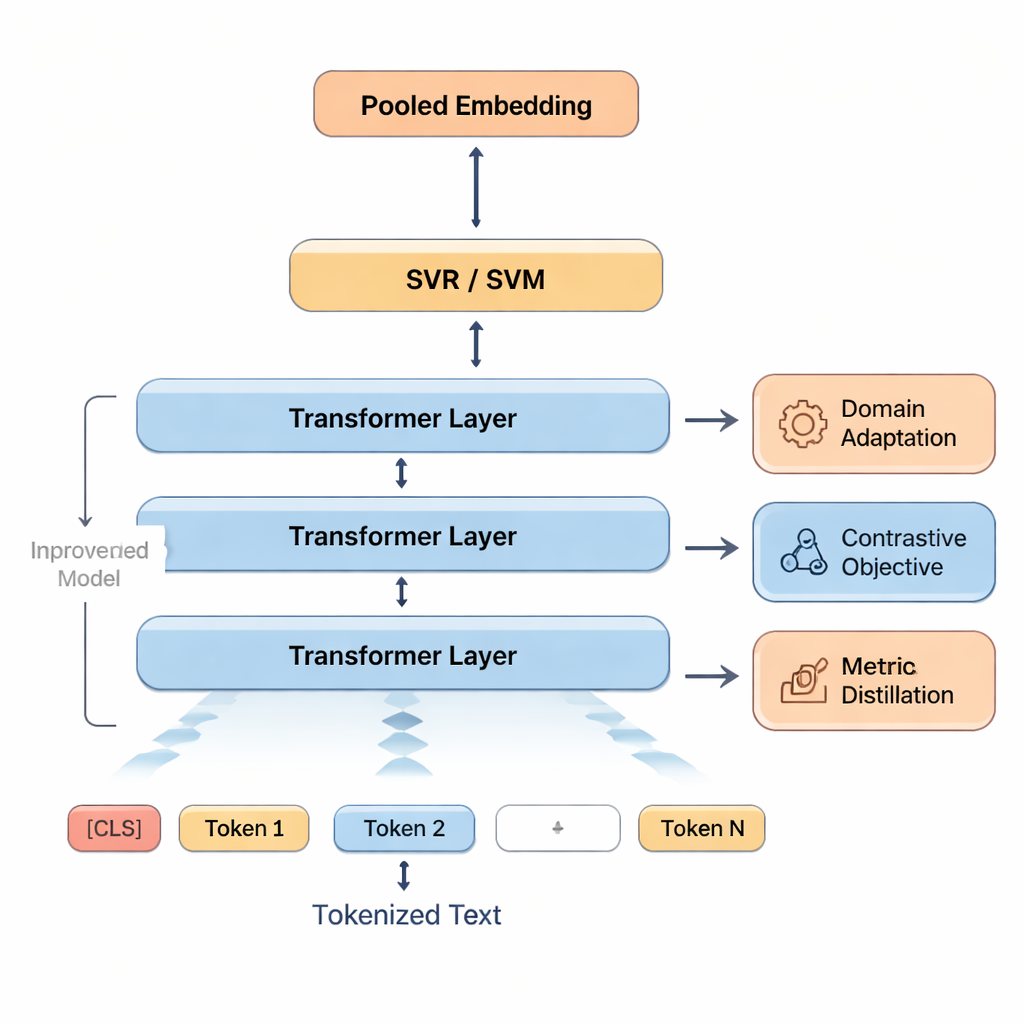

O sistema proposto BERT-SVM EduScore combina duas ideias: compreensão profunda da linguagem e estatísticas clássicas e robustas. Primeiro, ele usa uma versão aprimorada do modelo de linguagem BERT para ler três trechos de texto: a frase original, a tradução do aluno e, quando disponível, uma tradução de referência. O BERT transforma esses textos em um rico resumo numérico que reflete não apenas quais palavras estão presentes, mas quão bem os significados se alinham. Além disso, o sistema acrescenta um pequeno conjunto de verificações manuais que interessam aos professores—como se termos técnicos são traduzidos de forma consistente, se números e unidades são preservados, se a pontuação é adequada e se o comprimento da tradução corresponde ao original.

Como o sistema aprende a pontuar como um professor

Esses sinais são então alimentados em Máquinas de Vetor de Suporte, uma família de algoritmos conhecida por funcionar bem com dados limitados. Uma parte prevê uma pontuação geral; outras partes podem produzir pontuações separadas para áreas como precisão ou fluência, ou classificar traduções em faixas de qualidade. Para ajudar o modelo a se adaptar à linguagem típica de sala de aula, os autores primeiro re-treinam o BERT em textos semelhantes ao trabalho de alunos—uma abordagem chamada adaptação de domínio. Eles ainda aprimoram o senso de similaridade e diferença do BERT, fazendo-o praticar distinguir versões boas de versões levemente editadas e ruins de sentenças. Finalmente, quando métricas automáticas de alta qualidade como COMET ou BLEURT estão disponíveis, o sistema aprende a imitar alguns de seus julgamentos, emprestando pontos fortes dessas métricas enquanto se mantém sintonizado com avaliações humanas.

Colocando o modelo à prova

Os pesquisadores avaliam o BERT-SVM EduScore em um grande conjunto de dados público contendo traduções automáticas inglês–chinês avaliadas por humanos. Embora não sejam trabalhos de alunos, as avaliações a nível de sentença assemelham-se à correção em sala de aula e fornecem um teste de estresse realista. O novo sistema é comparado com pontuações tradicionais baseadas em palavras, pontuações mais recentes baseadas em significado e vários modelos neurais fortes. Ele não apenas se alinha mais de perto com os julgamentos humanos—mostrando maior concordância e erros médios menores—mas também roda rápido o suficiente para processar cerca de 44 sentenças por segundo em hardware gráfico padrão. Experimentos cuidadosos mostram que adaptar o BERT ao tipo certo de texto traz o maior ganho, enquanto os truques adicionais de aprendizagem fornecem aumentos menores e constantes sem desacelerar perceptivelmente o sistema.

O que isso pode significar para professores e alunos

Em termos práticos, o estudo mostra que um híbrido bem projetado de aprendizado profundo e métodos clássicos pode avaliar traduções de forma mais confiável do que ferramentas automáticas existentes, permanecendo rápido o suficiente para uso em sala de aula em tempo real. O BERT-SVM EduScore ainda não é um substituto plug-in para professores humanos: foi testado apenas em traduções de máquina, não em trabalhos reais de alunos, e não passou por testes em sala de aula ou verificações de equidade. Mas os resultados sugerem que tal sistema poderia em breve ajudar professores oferecendo pontuações estáveis e destacando problemas prováveis—como terminologia mal traduzida ou números ausentes—para que o feedback humano possa se concentrar em aspectos mais profundos e criativos da tradução.

Citação: Lin, C. A hybrid intelligent assessment model for English translation education with improved BERT and SVM. Sci Rep 16, 5466 (2026). https://doi.org/10.1038/s41598-026-35042-2

Palavras-chave: avaliação de tradução, educação linguística, BERT, máquinas de vetor de suporte, estimação de qualidade