Clear Sky Science · pt

Segmentação subaquática de objetos em tempo real precisa usando YOLOv11-UOS dual‑domínio melhorado com realce adaptativo guiado pela física e reforço por atenção

Mergulhando mais fundo com olhos digitais mais nítidos

Nossos oceanos são explorados cada vez mais não apenas por mergulhadores e submarinos, mas por câmeras inteligentes instaladas em robôs subaquáticos. Essas câmeras ajudam a buscar naufrágios, inspecionar dutos offshore e monitorar recifes de corais e populações de peixes. Ainda assim, imagens subaquáticas costumam ser turvas, com tom azul‑esverdeado e muito ruído visual, tornando difícil até para humanos — quanto mais para computadores — identificar objetos. Este artigo apresenta um novo sistema de visão computacional que limpa imagens subaquáticas e depois detecta e contorna objetos nelas, rápido o suficiente para guiar missões robóticas em tempo real.

Por que enxergar debaixo d’água é tão difícil

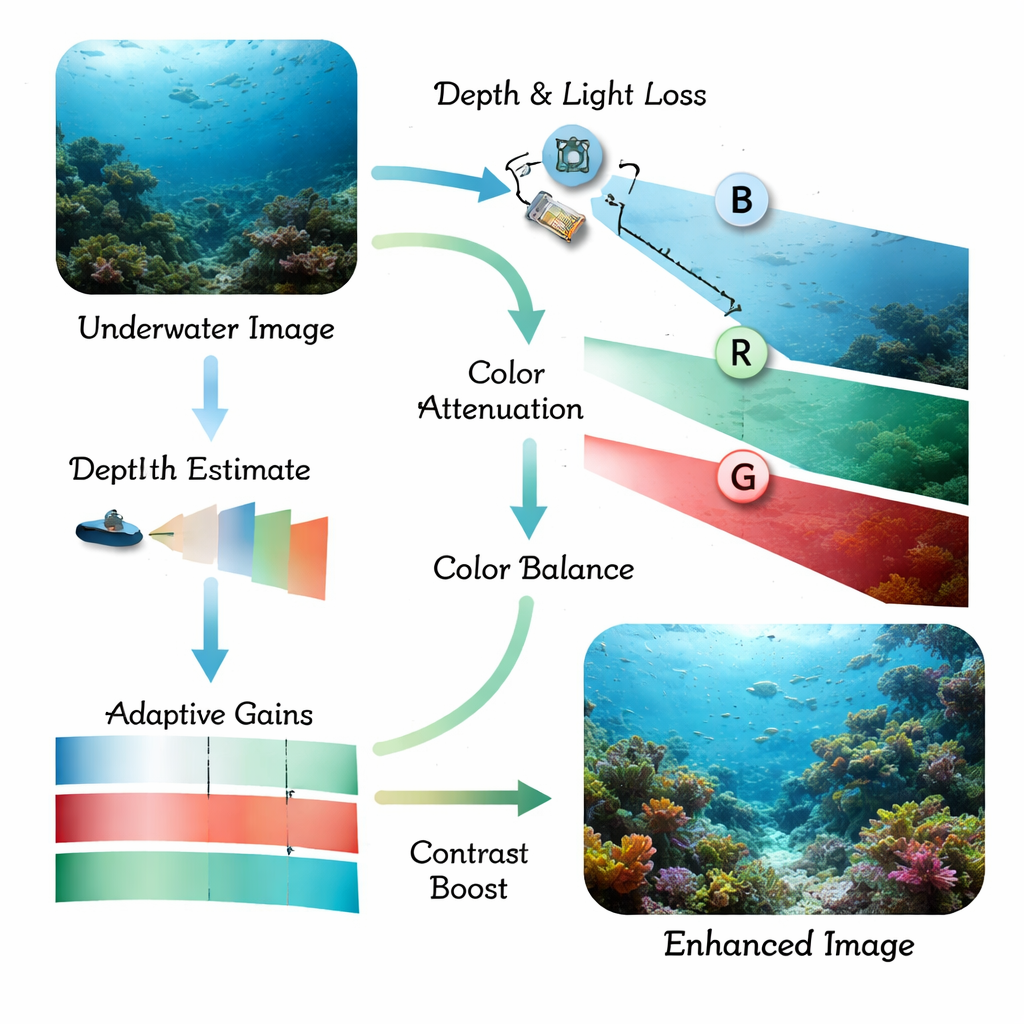

A luz se comporta de maneira muito diferente na água do que no ar. À medida que a luz solar penetra, os tons vermelhos desaparecem primeiro, depois os verdes, deixando um tom azulado e cenas com baixo contraste. Partículas minúsculas na água espalham a luz, criando neblina que embaça bordas e oculta detalhes finos. Programas tradicionais de detecção de objetos, e até modelos modernos de aprendizado profundo, têm dificuldade com essas imagens distorcidas: peixes se confundem com corais, estruturas artificiais somem no fundo e cenas com pouca luz tornam‑se quase ilegíveis. Pesquisas anteriores geralmente tratavam apenas do aprimoramento da imagem ou apenas da detecção de objetos, o que muitas vezes deixava o sistema final lento, frágil ou ainda cego em águas especialmente turvas.

Uma estratégia em duas etapas: limpar primeiro, depois focar

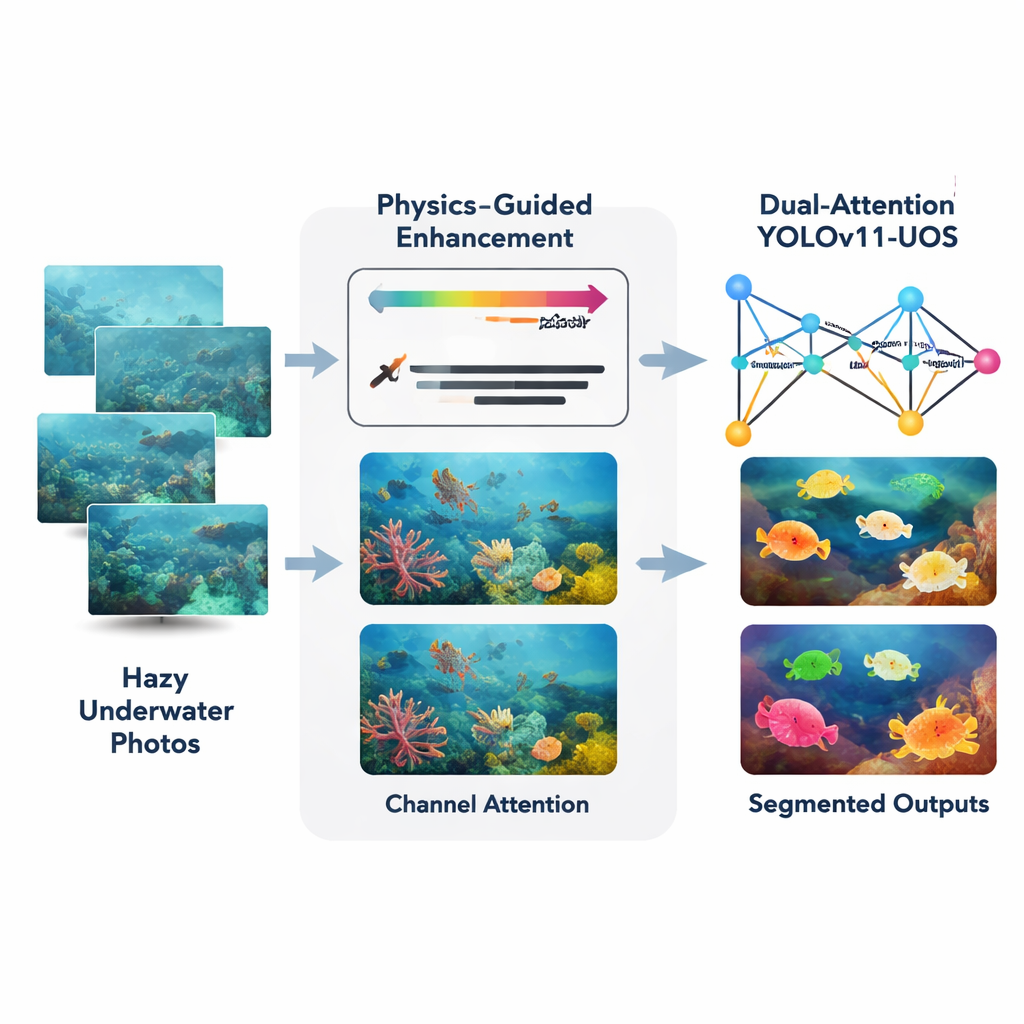

Os autores propõem uma abordagem combinada centrada em um detector em tempo real recente chamado YOLOv11, aqui customizado para cenas subaquáticas e segmentação por instância (traçar um contorno preciso para cada objeto). Primeiro, um módulo frontal chamado Realce Adaptativo Guiado pela Física recebe as fotos subaquáticas brutas e as corrige usando um modelo físico simplificado de como a luz é absorvida e espalhada na água. Ele estima a distância de cada parte da cena até a câmera e compensa a perda mais forte de luz vermelha em comparação com verde e azul. Isso restaura cores mais naturais e aumenta o contraste local, enquanto uma etapa cuidadosa baseada em histograma agudiza as bordas sem amplificar o ruído, mesmo em regiões escuras ou turvas.

Ensinando a rede onde olhar

Uma vez que a imagem é limpa, ela é encaminhada a uma espinha dorsal YOLOv11 aprimorada, equipada com mecanismos de atenção. Esses módulos adicionais agem um pouco como um holofote e um filtro de cor. A atenção espacial indica à rede para dar mais importância a regiões relevantes — como o contorno de um peixe ou a borda de um artefato submerso — e ignorar fundos distraídos, como areia ou plantas que se movem. A atenção por canais ajusta a intensidade com que o sistema pondera diferentes padrões de cor e textura, para que pistas visuais úteis sejam enfatizadas enquanto as irrelevantes são atenuadas. Juntas, essas duas etapas de atenção ajudam a rede a construir representações internas mais nítidas antes de decidir onde os objetos estão e o que eles são.

Testes em oceanos reais e condições difíceis

Para avaliar o desempenho em prática, os pesquisadores treinaram e testaram o sistema em várias coleções públicas de imagens subaquáticas, além de um novo conjunto de dados personalizado com mais de 7.000 fotos cuidadosamente rotuladas de águas costeiras com profundidades e turbidez variadas. Eles mediram métricas padrão de detecção e segmentação e compararam seu método com modelos amplamente usados, como U‑Net, DeepLab, segmentadores baseados em transformadores e um sistema YOLOv11 de referência sem os novos módulos. O design combinado de realce‑mais‑atenção melhorou a precisão média de detecção em cerca de 6,5 pontos percentuais em relação ao YOLOv11 de referência, com contornos de objetos visivelmente mais limpos e menos itens perdidos ou detectados erroneamente. Importante: o sistema ainda opera em torno de 38 quadros por segundo em um processador gráfico moderno, rápido o bastante para uso quase em tempo real em plataformas robóticas.

O que isso significa para robôs oceânicos e pesquisa

Em termos práticos, o estudo mostra que pré‑processamento inteligente e atenção focada permitem que computadores “vejam” muito melhor debaixo d’água. Ao primeiro desfazer parte da física que degrada fotos subaquáticas e depois guiar a rede de detecção a concentrar‑se nas regiões e cores mais informativas, o método entrega contornos mais nítidos e confiáveis de peixes, corais e estruturas artificiais. Isso pode ajudar veículos autônomos subaquáticos a navegar com segurança, monitorar ecossistemas marinhos frágeis e inspecionar infraestrutura crítica sob a água sem supervisão humana. Desafios permanecem em águas extremamente lamacentas ou em grandes profundidades com quase ausência de luz vermelha, mas a estrutura oferece um passo prático rumo a uma visão subaquática robusta em tempo real que pode apoiar futuros mapeamentos 3D e exploração multissensorial do oceano.

Citação: Deluxni, N., Sudhakaran, P., Alroobaea, R. et al. An accurate realtime underwater object segmentation using improved dual-domain YOLOv11-UOS with physics guided adaptive enhancement and attention-boosting. Sci Rep 16, 4804 (2026). https://doi.org/10.1038/s41598-026-35001-x

Palavras-chave: visão subaquática, robótica marinha, realce de imagem, segmentação de objetos, visão computacional