Clear Sky Science · pt

Examinando a dependência humana na inteligência artificial na tomada de decisões

Por que nossa confiança em máquinas inteligentes importa

De recomendações de filmes a seleção de candidatos e justiça criminal, a inteligência artificial (IA) está ajudando cada vez mais as pessoas a tomar decisões. Muitos de nós presumem que computadores são menos tendenciosos e mais precisos do que humanos. Mas o que realmente acontece quando as pessoas recebem conselhos de um sistema de IA — elas o usam com sabedoria ou dependem demais dele? Este estudo investiga como as pessoas respondem a orientações da IA em comparação com orientações de outros humanos, e o que isso significa para o papel crescente da IA nas decisões do dia a dia.

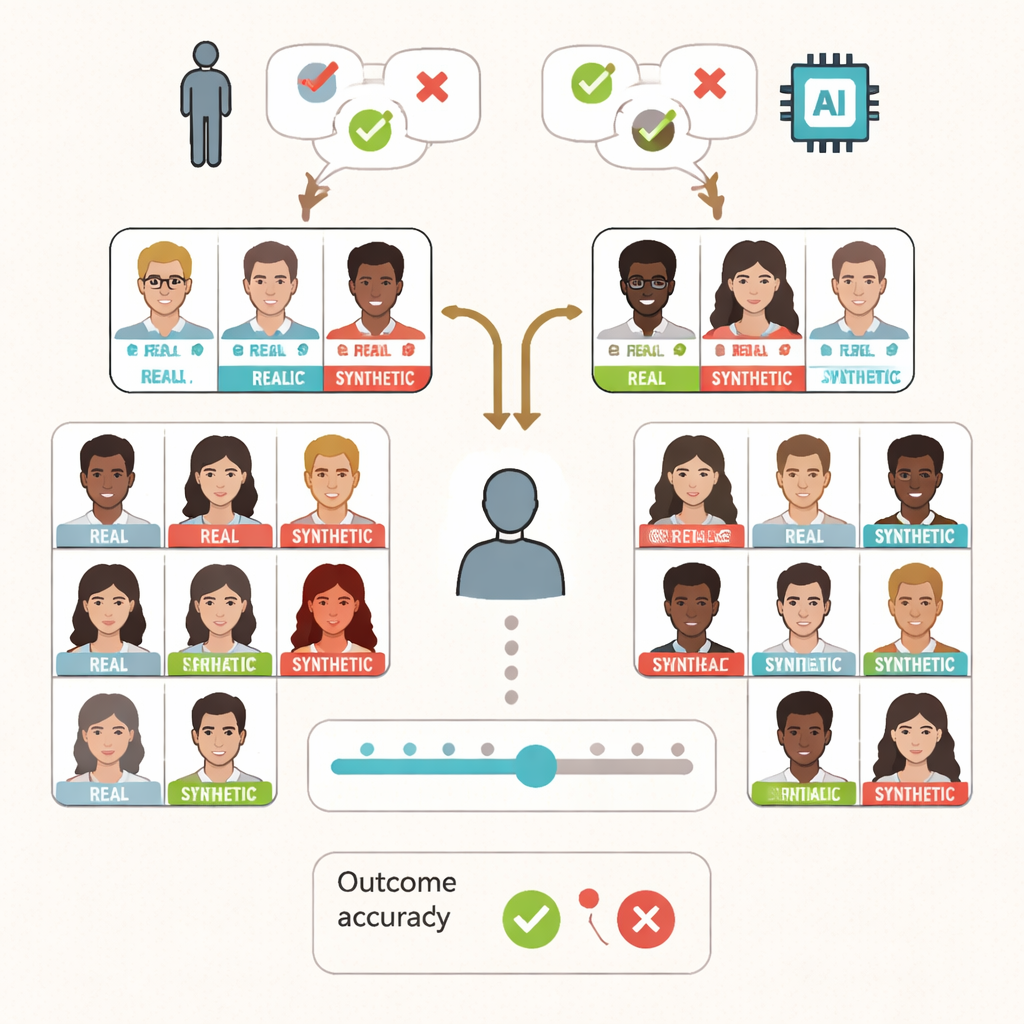

Testando pessoas reais com rostos reais e falsos

Os pesquisadores pediram a 295 adultos que realizassem uma tarefa aparentemente simples: decidir se um rosto na tela era a fotografia de uma pessoa real ou uma imagem gerada por IA. Cada participante viu 80 rostos — metade reais, metade sintéticos — que foram cuidadosamente escolhidos em trabalhos anteriores para que a maioria das pessoas pudesse acertar na maior parte, mas não perfeitamente. Ao lado de cada rosto, os participantes viam uma curta orientação indicando se o rosto era “real” ou “sintético”. Disseram-lhes que esse conselho vinha de um grupo de especialistas humanos ou de um sistema de IA, embora na prática todas as orientações fossem pré-programadas e corretas apenas metade das vezes.

Usando conselhos, mas não cegamente

A questão central era se as pessoas simplesmente seguiriam a orientação ou pensariam por si mesmas. Os resultados mostram que os participantes não se comportaram como meros apertadores de botão. Eles seguiram a orientação muito mais quando ela estava correta e foram mais propensos a ignorá-la quando estava errada, independentemente de supostamente vir de humanos ou de IA. A precisão geral em identificar rostos reais versus sintéticos ficou em torno de dois terços corretos — muito semelhante a um grupo separado de pesquisa anterior que realizou a mesma tarefa sem qualquer orientação. Em outras palavras, a presença de um “auxiliar” de IA não melhorou nem prejudicou dramaticamente o desempenho em média.

Quando atitudes positivas em relação à IA se voltam contra nós

Por trás dessas médias, contudo, surgiu um padrão mais sutil. Os participantes também responderam a questionários sobre quanto geralmente confiam em outras pessoas e como se sentem em relação à IA. Aqueles que tinham atitudes mais positivas em relação à IA na verdade pioraram na distinção entre real e falso quando receberam orientação da IA. Eles tiveram menos capacidade de diferenciar rostos genuínos de sintéticos do que participantes com visões mais cautelosas ou negativas sobre a IA. Esse efeito não apareceu quando as pessoas acreditavam que a orientação vinha de humanos, sugerindo que o conselho da IA pode moldar — e às vezes distorcer — nossa tomada de decisão de forma única. O estudo também constatou que pessoas que afirmaram sempre seguir a orientação tiveram desempenho pior do que aquelas que disseram usá-la às vezes ou não usá-la.

As pessoas ainda desempenham o papel de decisoras

Os pesquisadores investigaram mais a fundo como as pessoas equilibraram seu próprio julgamento com a orientação. Em média, os participantes mostraram um viés a rotular rostos como reais, e esse viés cresceu ligeiramente entre aqueles que relataram maior tendência a confiar em outros humanos. Ainda assim, a forma como as pessoas usaram a orientação parecia “estratégica”: elas pareciam recorrer a ela especialmente quando estavam menos certas. As avaliações de confiança corresponderam razoavelmente ao desempenho — quando as pessoas se sentiam mais confiantes, geralmente eram mais precisas — indicando que os participantes tinham uma noção razoável de quando estavam certos ou errados, mesmo com a IA no processo.

O que isso significa para ferramentas de IA do cotidiano

Para um leitor leigo, a mensagem principal é que a IA não remove magicamente o viés humano, nem automaticamente sobrecarrega nosso julgamento. As pessoas frequentemente tratam conselhos de IA de forma semelhante aos conselhos humanos e podem ignorá‑los quando parecem pouco úteis. Mas quando alguém já pensa muito positivamente sobre a IA, pode tender a se apoiar nela de maneiras que reduzem sua precisão. À medida que sistemas de IA se espalham por áreas críticas como saúde, segurança e justiça, designers e formuladores de políticas precisarão entender essas tendências humanas. Este estudo sugere que o uso eficaz da IA depende não apenas de algoritmos melhores, mas de pessoas informadas que saibam quando confiar na máquina — e quando confiar em si mesmas.

Citação: Pearson, J., Dror, I., Jayes, E. et al. Examining human reliance on artificial intelligence in decision making. Sci Rep 16, 5345 (2026). https://doi.org/10.1038/s41598-026-34983-y

Palavras-chave: inteligência artificial, tomada de decisão humana, confiança na IA, viés de automação, rostos deepfake