Clear Sky Science · pt

Multi-TPC: um conjunto de dados multimodal para conversas a três com fala, movimento e olhar

Por que como nos movemos e olhamos enquanto falamos é importante

Quando as pessoas conversam cara a cara, fazem muito mais do que trocar palavras. A gente inclina o corpo para frente, acena com a cabeça, troca olhares e faz pausas nos momentos certos. Esses movimentos sutis se tornam ainda mais importantes quando três pessoas conversam juntas, pois atenção e a vez de falar mudam constantemente. Ainda assim, até agora, cientistas e engenheiros dispuseram de pouquíssimos dados de alta qualidade mostrando como fala, movimento corporal e direção do olhar atuam em conjunto em conversas de pequenos grupos. Este artigo apresenta um novo conjunto de dados concebido para preencher essa lacuna e ajudar a criar assistentes virtuais, robôs sociais e ferramentas para estudar a interação humana cotidiana de forma mais natural.

Uma nova janela para conversas entre três pessoas

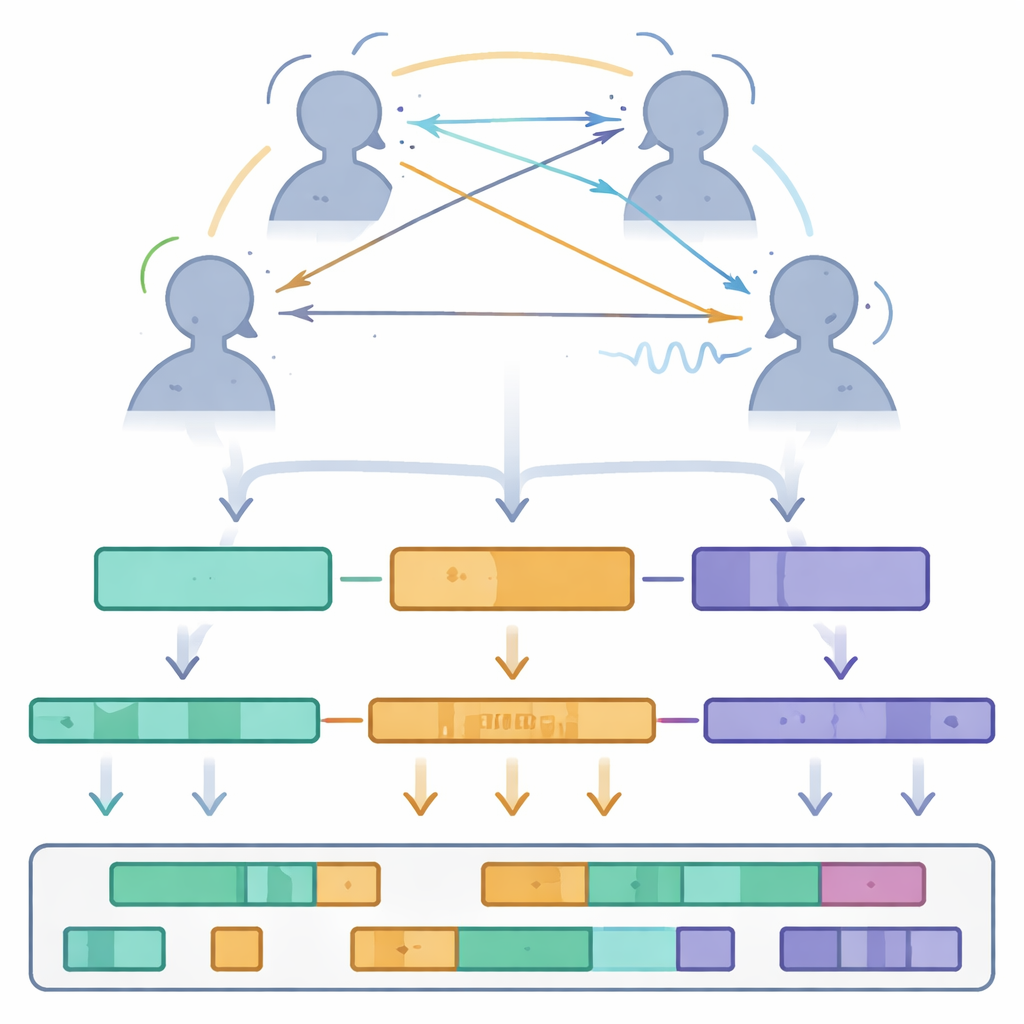

Os autores apresentam o Multi-TPC, uma coleção pública de conversas entre três pessoas gravadas em laboratório usando captura de movimento, rastreadores oculares e microfones individuais. Diferentemente de muitos recursos anteriores que se concentram em um único locutor ou em conversas entre apenas duas pessoas, o Multi-TPC captura discussões espontâneas entre três estranhos que ficam em um triângulo e falam sobre qualquer assunto que desejarem. Inclui mais de 5,3 horas de gravações de 21 participantes jovens adultos, distribuídas em 24 sessões. Para cada instante dessas conversas, o conjunto de dados fornece informações detalhadas sobre como cada pessoa fala, movimenta o corpo e para onde direciona o olhar.

Como as conversas foram registradas

Para construir esse conjunto de dados, a equipe criou um sistema de gravação híbrido. Cada participante vestia uma roupa de captura de corpo inteiro pontilhada com marcadores reflexivos para que um conjunto de oito câmeras pudesse rastrear sua postura, movimento de cabeça e gestos em três dimensões. Óculos leves com rastreamento ocular, semelhantes em sensação a óculos comuns, mediram para onde cada pessoa olhava em seu campo visual. Microfones sem fio presos perto do pescoço gravaram a voz de cada locutor em faixas de áudio separadas. Antes da gravação, os participantes foram calibrados no sistema e instruídos a permanecer em pontos fixos formando um triângulo equilátero de cerca de um metro entre si. Uma claquete, visível para as câmeras, os rastreadores oculares e os microfones, forneceu um sinal preciso para alinhar todos os dispositivos no tempo, garantindo que movimento, olhar e fala pudessem ser casados quadro a quadro.

Limpeza, organização e enriquecimento dos dados

Coletar sinais brutos foi apenas o primeiro passo. Os pesquisadores processaram cuidadosamente os dados de movimento, rotulando todos os marcadores e preenchendo pequenos vazios por interpolação matemática enquanto verificavam posições de marcadores próximas. As gravações de áudio foram limpas com métodos de redução de ruído e então submetidas a software de reconhecimento de fala para produzir transcrições palavra por palavra, que foram posteriormente corrigidas manualmente. Pontos de olhar medidos em pixels da câmera foram convertidos em ângulos 3D mostrando para onde cada pessoa estava olhando no espaço. Todos os sinais foram reamostrados para 60 quadros por segundo e sincronizados, depois armazenados em formatos simples e abertos. O conjunto de dados final está organizado por modalidade — movimento, olhar, áudio, palavras e características prosódicas como intensidade e tom — com regras claras de nomenclatura de arquivos para que pesquisadores possam rastrear facilmente qualquer instante no tempo entre os três participantes.

O que o conjunto de dados revela sobre a fala em grupo

Usando o Multi-TPC, os autores realizaram um levantamento estatístico inicial de como conversas a três se desenrolam. Mediram turnos de fala e silêncios, constatando que um turno típico de fala dura cerca de 2,7 segundos, separados por pausas pouco maiores que um segundo. Também examinaram acenos e movimentos de cabeça como forma de feedback do ouvinte, detectando em média cerca de um quarto de aceno ou balançar por segundo — evidência de que os ouvintes sinalizam atenção e atitude constantemente sem dizer uma palavra. A análise do olhar mostrou que as pessoas raramente fixam diretamente o rosto do outro por muito tempo. Em vez disso, frequentemente olham ligeiramente para o lado, e seus padrões de olhar mudam dependendo de quem está falando, se há uma pausa ou se mais de uma pessoa fala ao mesmo tempo. Durante fala sobreposta, o olhar dos participantes tende a se distribuir de forma mais uniforme ou a desviar dos dois parceiros, sugerindo incerteza sobre quem domina a vez na conversa.

Por que esse recurso importa para a tecnologia futura

Ao embalar todas essas camadas de informação em um conjunto de dados bem documentado e compartilhável, o Multi-TPC oferece uma nova base para estudar como pequenos grupos gerenciam a vez de falar, a atenção e o feedback por meio de palavras e movimento. Para leitores em geral, a conclusão é que a dança da conversa — quem fala quando, para onde se olha e como acenos sutis moldam o fluxo — agora está capturada em detalhes refinados. Para cientistas e desenvolvedores, isso abre caminho para construir personagens virtuais e robôs sociais que respondam mais como pessoas reais em contextos de grupo, além de viabilizar estudos mais profundos sobre como nos coordenamos uns com os outros por meio da voz, do corpo e do olhar.

Citação: Lee, MC., Deng, Z. Multi-TPC: A Multimodal Dataset for Three-Party Conversations with Speech, Motion, and Gaze. Sci Data 13, 429 (2026). https://doi.org/10.1038/s41597-026-06819-x

Palavras-chave: conversa multimodal, gesto e olhar, conjunto de dados de interação social, turn-taking, agentes virtuais