Clear Sky Science · pt

StatLLM: Um Conjunto de Dados para Avaliar o Desempenho de Grandes Modelos de Linguagem em Análise Estatística

Por que isso importa para usuários de dados do dia a dia

À medida que ferramentas de inteligência artificial como assistentes baseados em chat entram no cotidiano de trabalho, mais pessoas pedem que elas processem números, executem experimentos e analisem dados. Mas quando uma IA escreve o código para um estudo estatístico — por exemplo, verificar se um novo tratamento médico funciona ou explorar dados de desempenho escolar — como saber se o trabalho foi feito corretamente? Este artigo apresenta o StatLLM, um conjunto de dados público projetado para testar quão bem grandes modelos de linguagem lidam com tarefas reais de análise estatística, oferecendo a pesquisadores e profissionais um panorama mais claro de quando confiar em código gerado por IA — e quando ser cauteloso.

Um novo banco de provas para código estatístico gerado por IA

O núcleo do StatLLM é uma coleção cuidadosamente organizada de 207 tarefas de análise estatística construídas a partir de 65 conjuntos de dados reais extraídos de áreas como educação, medicina, negócios, finanças, engenharia e esportes. Cada tarefa vem com uma descrição em linguagem simples do problema, uma explicação detalhada do conjunto de dados e de suas variáveis, e um pequeno trecho de código SAS escrito e verificado por especialistas humanos. As tarefas abrangem o que um bom estudante de graduação ou de mestrado em estatística pode aprender: desde resumos e gráficos simples até regressão, análise de sobrevivência e métodos mais avançados. Isso fornece um teste realista, no estilo acadêmico e industrial, para avaliar se as ferramentas de IA conseguem entender perguntas práticas e traduzi-las em passos de análise sólidos.

Deixar a IA escrever o código e depois avaliar seu trabalho

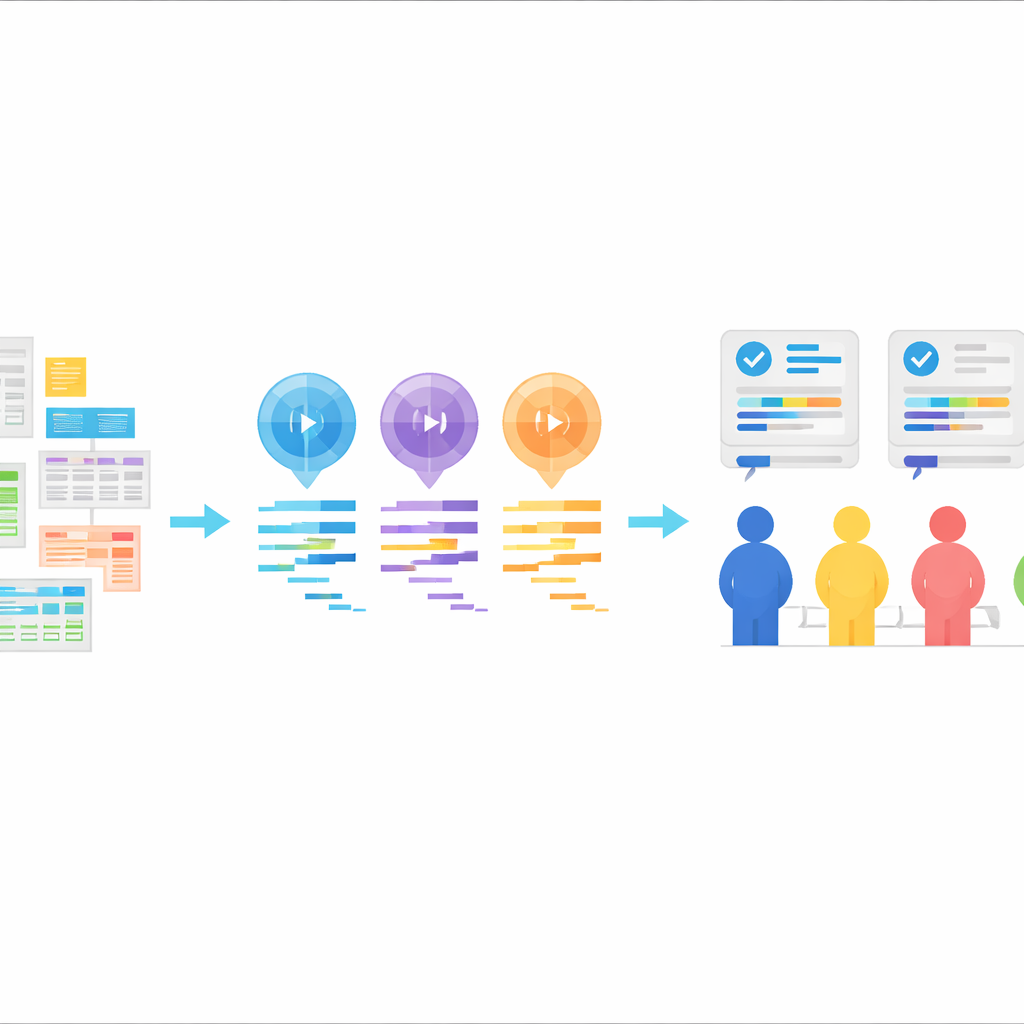

Usando essas tarefas, os autores pediram a três grandes modelos de linguagem — GPT-3.5, GPT-4 e Llama‑3.1 70B — que gerassem código SAS. Cada modelo recebeu os mesmos elementos: uma descrição da tarefa, uma descrição do conjunto de dados, o arquivo de dados em si e uma instrução explícita para produzir código SAS. Os modelos foram usados em modo “zero-shot”, ou seja, não receberam exemplos de código SAS correto previamente. As respostas foram limpas para que restasse apenas o código, sem explicações. Esse arranjo imita um padrão comum no mundo real: um usuário descreve o que deseja, a IA retorna código e esse código é então executado em um pacote estatístico.

Especialistas humanos como padrão-ouro

Para avaliar a qualidade do código gerado pela IA, a equipe organizou uma revisão humana rigorosa. Nove usuários experientes de SAS formaram três grupos, cada um focado em uma parte do desempenho: se o código em si era logicamente correto e legível, se ele realmente rodava sem erros e se a saída resultante respondia à pergunta original de forma clara e precisa. Para cada tarefa, os programas SAS dos três modelos foram embaralhados de modo que os avaliadores não soubessem qual modelo produziu cada código. As pontuações foram atribuídas em uma escala de cinco pontos e combinadas em um total geral, fornecendo uma visão detalhada de pontos fortes e fracos ao longo de centenas de pares modelo–tarefa. Essas avaliações de especialistas agora acompanham todo o código e as tarefas no conjunto de dados StatLLM.

Ensinar máquinas a julgar código como humanos

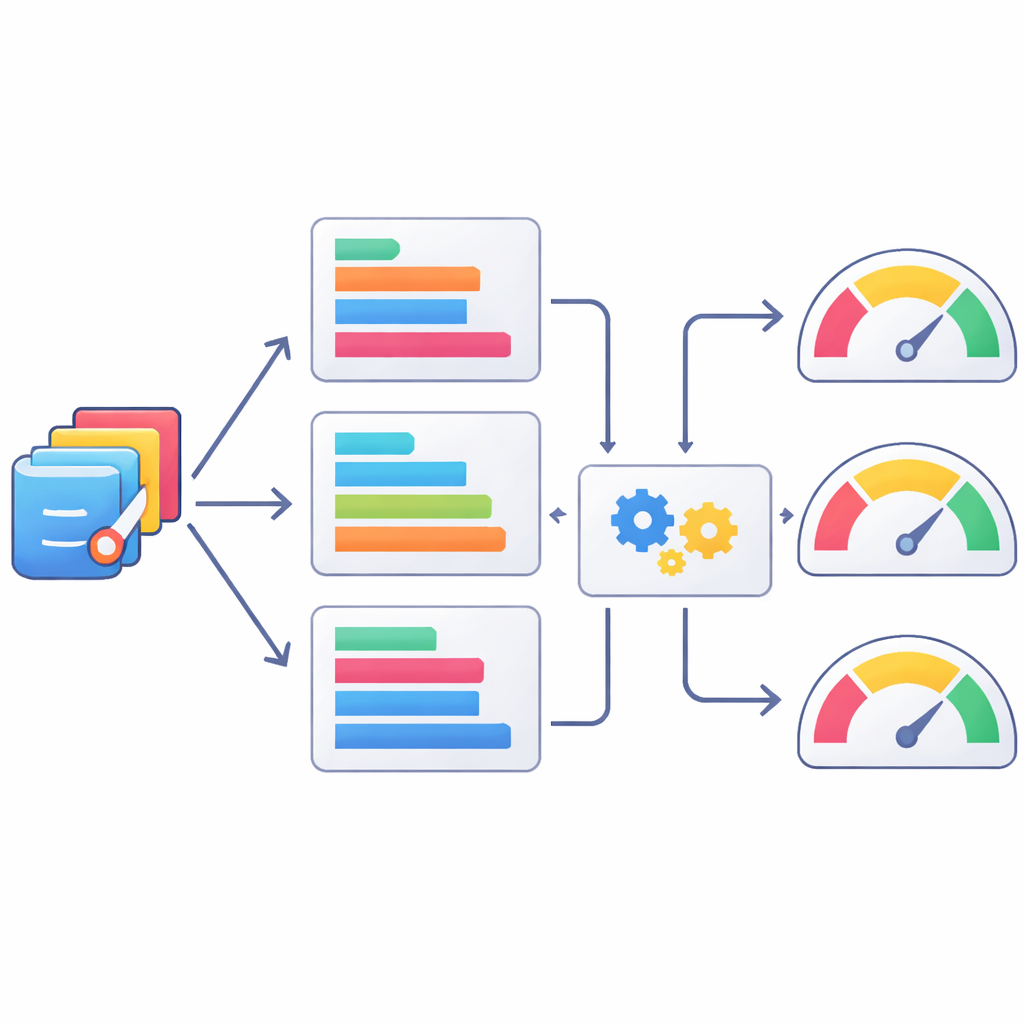

Como a revisão humana é lenta e cara, os autores também investigaram o quanto métricas automáticas baseadas em texto podem servir como juízes aproximados da qualidade de código estatístico. Eles compararam programas SAS gerados por IA com as versões verificadas por humanos usando um conjunto de métricas bem conhecidas de processamento de linguagem natural e então checaram como essas pontuações se alinhavam com as avaliações humanas. Algumas métricas, como variantes do score ROUGE que rastreiam sobreposições em sequências curtas de tokens, correlacionaram-se melhor com os julgamentos humanos do que outras, mas todas apresentaram apenas alinhamento moderado. A equipe foi além e treinou modelos de aprendizado de máquina para prever as pontuações humanas a partir de combinações dessas métricas. Métodos como XGBoost melhoraram a correspondência com as avaliações humanas, mas ainda ficaram longe de capturar perfeitamente o julgamento de especialistas, sublinhando que as pontuações automáticas são, na melhor das hipóteses, substitutos parciais.

Construindo ferramentas estatísticas dirigidas por IA para o futuro

Além do benchmarking, os autores mostram como o StatLLM pode apoiar novas ferramentas e direções de pesquisa. Como cada tarefa é descrita em termos gerais, os mesmos problemas podem ser usados para testar geração de código em outras linguagens, como R ou Python, ou mesmo para combinar código de múltiplas linguagens. O artigo destaca abordagens de ensemble que poderiam misturar diferentes soluções geradas por IA para maior confiabilidade e demonstra um protótipo de aplicativo R Shiny onde usuários carregam um conjunto de dados e a descrição da tarefa, e um sistema de IA produz e executa código R automaticamente. O StatLLM também fornece uma plataforma para projetar e testar software estatístico de próxima geração que entenda instruções em linguagem natural, mantendo padrões claros e mensuráveis.

O que isso significa para o uso de IA em análise de dados

Para não especialistas, a principal conclusão é que a IA já pode escrever trechos curtos de código estatístico — mas a confiabilidade está longe de ser garantida, especialmente para tarefas que vão além de exemplos simples. O StatLLM oferece uma maneira transparente e reutilizável de ver quão bem diferentes modelos se saem, melhorar checagens automáticas do trabalho gerado e projetar ferramentas de análise de dados mais seguras e robustas. À medida que modelos de linguagem mais novos surgirem, eles podem ser integrados a esse benchmark vivo, mantendo o campo honesto sobre o que a IA pode e ainda não pode fazer em trabalhos estatísticos sérios.

Citação: Song, X., Lee, L., Xie, K. et al. StatLLM: A Dataset for Evaluating the Performance of Large Language Models in Statistical Analysis. Sci Data 13, 369 (2026). https://doi.org/10.1038/s41597-026-06731-4

Palavras-chave: grandes modelos de linguagem, análise estatística, avaliação de código, conjunto de dados de referência, programação SAS