Clear Sky Science · pt

Um sensor coerente de imagem 4D em grande escala

Vendo o mundo em quatro dimensões

Carros autônomos, drones de entrega e headsets de realidade aumentada dependem de máquinas capazes de compreender o mundo 3D ao seu redor em tempo real. Hoje em dia, esse tipo de visão costuma ser volumoso, caro ou consumidor de energia. Este artigo relata um avanço importante rumo a uma “câmera 4D” — um sensor em tamanho de chip que não apenas mapeia a forma de uma cena em 3D, mas também mede como os objetos estão se movendo, potencialmente levando visão de máquina compacta desde robôs até smartphones.

De fotos planas a mapas vivos

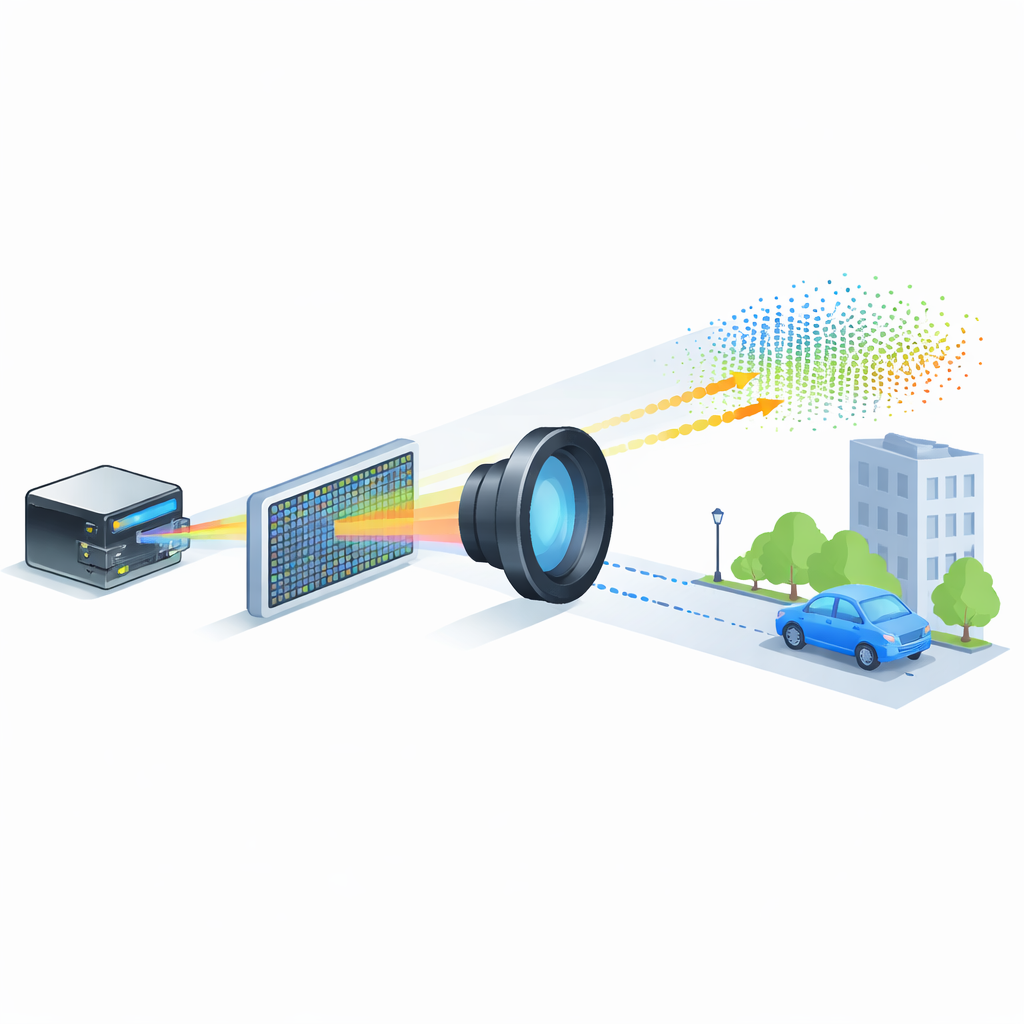

Câmeras convencionais capturam a intensidade da luz em uma superfície plana, produzindo belas imagens 2D, mas sem informação direta sobre distância. Em contraste, sistemas de detecção e alcance de luz (LiDAR) emitem pulsos de laser e medem quanto tempo eles levam para retornar, construindo um mapa 3D do entorno. Abordagens existentes conseguem ver longe e com grande detalhe, mas tendem a exigir partes móveis, óticas volumosas ou muita energia por ponto medido. Isso dificulta construir algo tão pequeno, barato e robusto quanto a câmera de um smartphone, mas capaz de escanear com segurança ruas, instalações industriais ou ambientes lotados em alto detalhe.

Um chip que mede distância e movimento

Os pesquisadores apresentam um novo tipo de matriz focal LiDAR — essencialmente uma versão LiDAR do chip de imagem dentro de uma câmera digital. O dispositivo contém 352 por 176 pixels, totalizando mais de 60.000 sítios de detecção, todos construídos em um único chip de fotônica em silício juntamente com sua eletrônica de controle. Em vez de usar pulsos curtos de laser, o sistema se baseia em luz contínua com modulação de frequência (FMCW), na qual a cor do laser é varrida em um “chirp” controlado. Quando a luz reflete em objetos e retorna ao chip, ela é combinada de forma coerente com um feixe de referência. Minúsculas diferenças de frequência revelam tanto a distância de cada ponto quanto a velocidade com que ele se aproxima ou afasta do sensor, adicionando a velocidade como uma quarta dimensão medida.

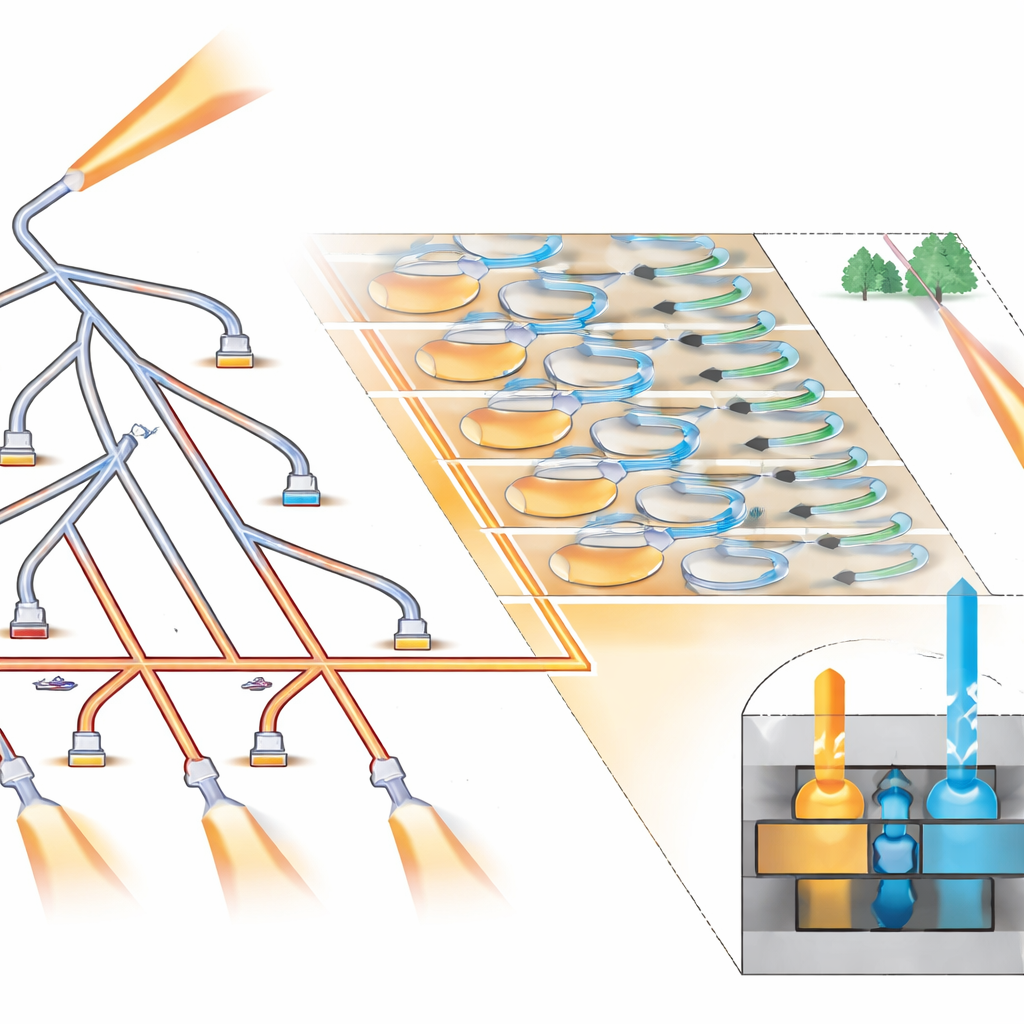

Como funciona a pequena grade de luz

Para cobrir muitos pixels sem desperdiçar energia, o chip roteia a luz chirpada através de uma árvore de minúsculos interruptores ópticos, guiando-a sequencialmente para grupos de oito pixels vizinhos. Dentro de cada grupo, a luz é dividida igualmente para que todos os oito atuem como transmissores e receptores ao mesmo tempo. Cada pixel usa um par de acopladores de grade para enviar e coletar luz, além de um par de fotodetectores balanceados e um amplificador no pixel para extrair o sinal de batimento que codifica distância e velocidade. Microlentes especialmente projetadas e depositadas diretamente no chip ajudam a canalizar mais luz para dentro e para fora, melhorando a eficiência. Como a mesma abertura emite e recebe luz (um projeto “monostático”), o sistema evita acoplamento indesejado entre pixels e precisa apenas de uma lente de imagem externa, muito parecido com uma câmera comum.

Testando a câmera 4D

Usando lentes infravermelhas de ondas curtas prontas no mercado, a equipe construiu um módulo semelhante a uma câmera em torno do chip e capturou nuvens de pontos 3D detalhadas de cenas internas e externas. Com uma lente, o sensor alcançou um campo de visão de cerca de 33 por 19 graus e uma resolução angular tão fina quanto 0,06 graus — suficiente para distinguir móveis em um escritório e elementos arquitetônicos em edifícios a dezenas de metros. O sistema mediu objetos de 4 a 65 metros usando apenas dezenas de nanojoules de energia óptica por ponto e potência média no alvo de cerca de 178 microwatts por pixel, mantendo-se dentro de limites rigorosos de segurança ocular. Também rastreou movimento: em um experimento, mediu a variação da velocidade radial de um disco giratório com precisão de milímetros por segundo.

Desempenho, limitações e crescimento futuro

Medições cuidadosas mostram que o desempenho do sensor está próximo dos limites físicos fundamentais impostos pela natureza quântica da luz, mas ainda não os alcança totalmente. Hoje, a principal limitação é o ruído eletrônico dos amplificadores em cada pixel, que reduz ligeiramente a relação sinal-ruído em comparação com um detector ideal limitado apenas por fótons. Os autores descrevem ajustes de projeto diretos — principalmente aumentar o nível de luz de referência interna e refinar o layout óptico, potencialmente usando misturas de silício e nitreto de silício — que poderiam levar o sistema a um regime realmente limitado pelo ruído de shot e aumentar o alcance utilizável além de 200 metros. Mover alguns interruptores on-chip para fora da matriz de pixels também removeria pequenas lacunas na cobertura de campo distante, produzindo nuvens de pontos mais limpas.

Rumo à visão 4D do dia a dia

Este trabalho demonstra um sensor de imagem 4D compacto e totalmente integrado que rivaliza com as contagens de pixels e alcances exigidos por muitas aplicações do mundo real, enquanto mantém controle sobre consumo de energia e tamanho. Ao reunir emissores de luz, receptores, direcionamento de feixe e eletrônica de controle em um único chip de silício, o dispositivo desempenha um papel similar para a detecção 3D e de movimento ao que o sensor CMOS desempenhou para a fotografia digital. Com refinamentos adicionais, sensores assim poderão se tornar baratos e robustos o bastante para serem incorporados em carros, robôs, telefones e headsets, dando às máquinas uma compreensão precisa e em tempo real do mundo 3D e de como ele muda de momento a momento.

Citação: Settembrini, F.F., Gungor, A.C., Forrer, A. et al. A large-scale coherent 4D imaging sensor. Nature 651, 364–370 (2026). https://doi.org/10.1038/s41586-026-10183-6

Palavras-chave: LiDAR, imagem 4D, fotônica em silício, sistemas autônomos, detecção de profundidade