Clear Sky Science · pt

Superando os limites da fatoração dimensional em modelos de difusão discreta por meio do aprendizado de distribuições conjuntas quânticas

Por que essa nova abordagem em IA e quântica importa

Sistemas de IA modernos são notavelmente bons em gerar texto, imagens e outros dados, mas ainda encontram dificuldades quando muitas partes dos dados estão fortemente interligadas. Este artigo mostra que uma classe importante de modelos generativos, chamada modelos de difusão discreta, tem uma limitação intrínseca: à medida que os dados se tornam de alta dimensão e mais correlacionados, seus erros podem crescer rapidamente. Os autores propõem uma nova abordagem que utiliza computadores quânticos para aprender essas relações complexas de forma mais fiel, potencialmente produzindo modelos generativos mais rápidos e flexíveis do que as técnicas clássicas atuais.

Quando separar as partes destrói o que importa

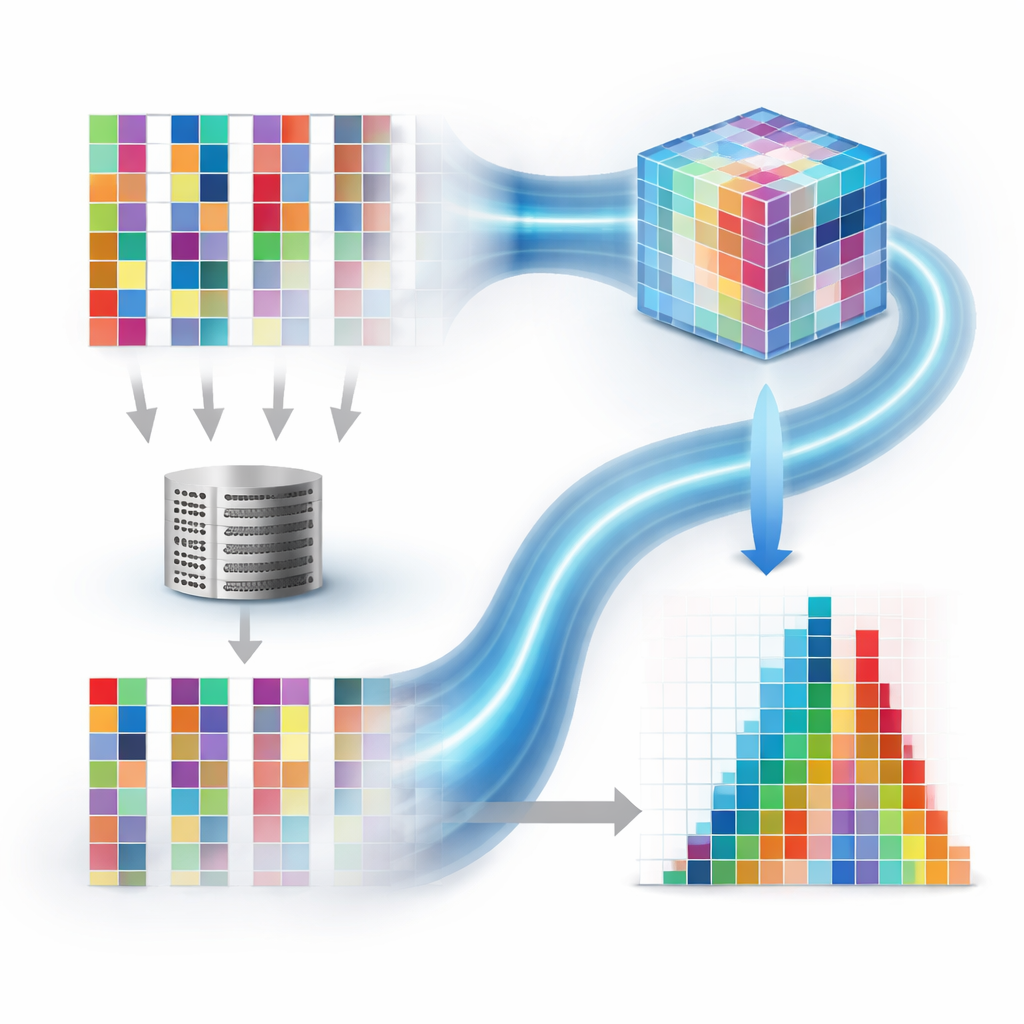

Modelos clássicos de difusão discreta funcionam corrompendo gradualmente os dados com ruído e depois aprendendo a reverter esse processo, passo a passo, para gerar novas amostras. Para manter as contas manejáveis, eles tratam cada dimensão — como cada pixel de uma imagem ou cada símbolo de uma sequência — como se mudasse de forma independente. Essa “fatoração” evita uma explosão exponencial da complexidade, mas também ignora correlações entre dimensões. Os autores analisam um cenário de pior caso em que cada parte dos dados está fortemente ligada a todas as outras. Eles provam que, para tais dados, a discrepância entre a distribuição verdadeira e o que um modelo fatorizado pode aprender pode crescer aproximadamente em proporção ao número de dimensões. Em outras palavras, à medida que os dados se tornam maiores e mais estruturados, modelos clássicos de difusão discreta podem falhar fundamentalmente em capturar como as peças da informação dependem umas das outras.

Usando estados quânticos para preservar correlações

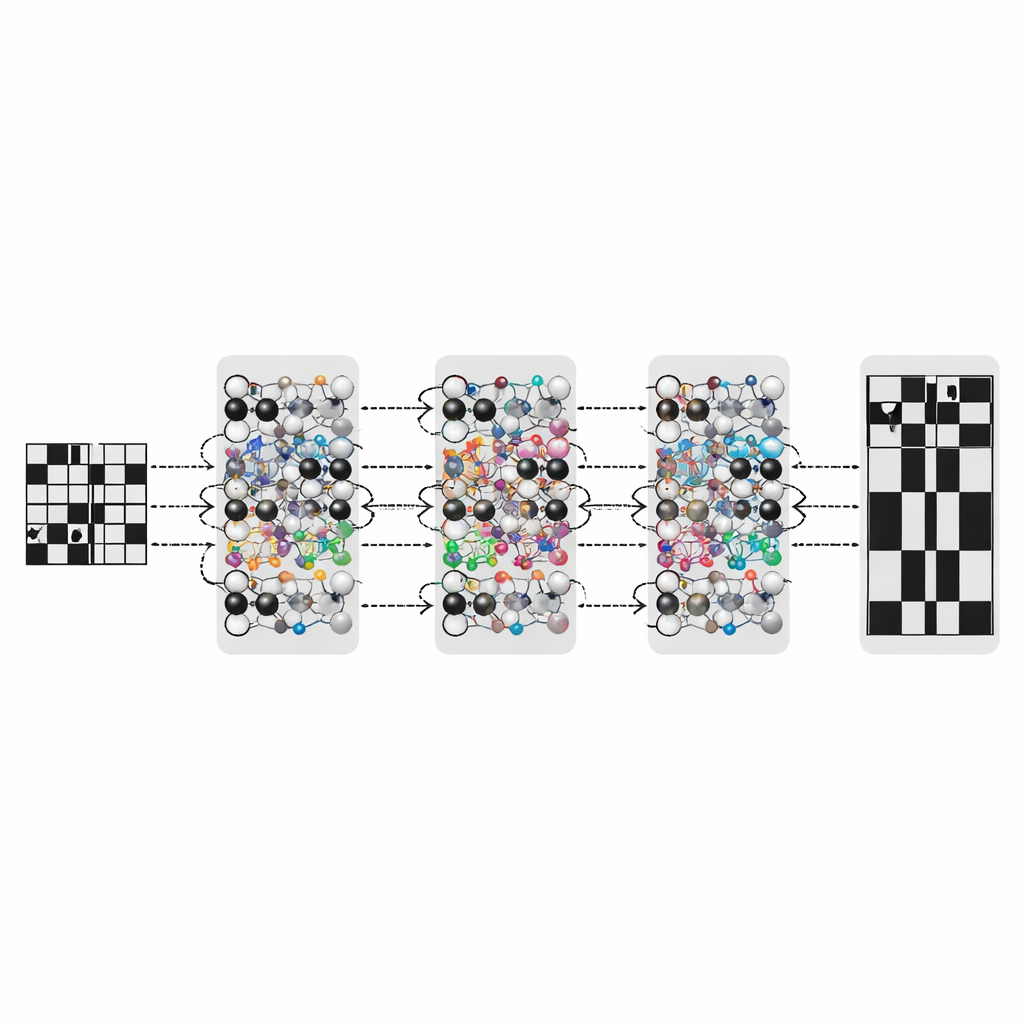

O modelo proposto, modelo probabilístico quântico discreto de difusão e remoção de ruído (QD3PM), enfrenta esse problema ao representar dados como estados quânticos em vez de variáveis clássicas separadas. Em um sistema quântico, uma coleção de qubits vive naturalmente em um espaço combinado muito grande onde configurações conjuntas e correlações são armazenadas em conjunto. O QD3PM codifica dados discretos nesse espaço, aplica um processo controlado de “difusão” que adiciona ruído por meio de canais quânticos e então aprende a reverter esse processo com um circuito quântico treinável. Crucialmente, o modelo opera sobre o estado conjunto completo, de modo que a interdependência entre dimensões é preservada durante toda a difusão e a remoção do ruído. Usando uma versão da regra de Bayes adaptada à teoria quântica, os autores derivam como calcular o estado quântico “posterior” exato que deve guiar o treinamento, e projetam circuitos que implementam fisicamente essa atualização.

De muitos passos lentos a um único salto quântico

Modelos de difusão padrão geralmente precisam de muitas rodadas de remoção gradual de ruído para transformar ruído puro em uma amostra realista, o que os torna computacionalmente caros. O QD3PM é descrito inicialmente dessa forma iterativa familiar, mas os autores então mostram como treinar o mesmo circuito quântico para saltar diretamente do ruído para dados limpos em um único passo. Eles fazem isso fazendo com que o circuito aprenda a distribuição dos dados originais condicionada a uma entrada ruidosa e então compondo cuidadosamente esse mapeamento aprendido com as regras quânticas de difusão e atualização. Graças a propriedades de operações e medições quânticas, a amostragem final depende apenas de certos elementos diagonais do estado quântico, o que permite simplificar o procedimento sem alterar os resultados observáveis. Isso gera um gerador de uma só etapa que, em princípio, pode ser muito mais rápido que a difusão clássica em vários passos, mantendo a capacidade de modelar a distribuição conjunta completa.

Preencher lacunas sem recomeçar

Uma vantagem prática do QD3PM é a forma natural como lida com tarefas condicionais, como inpainting — preencher partes faltantes de uma imagem dadas as regiões visíveis. Como o modelo descreve a distribuição conjunta completa sobre todas as dimensões, os autores podem condicionar em valores conhecidos simplesmente reinicializando repetidamente essas partes dos dados durante as etapas de remoção do ruído enquanto permitem que as partes desconhecidas variem. Isso direciona suavemente o processo de amostragem para a distribuição condicional correta, sem alterar o circuito ou retreiná‑lo. Em simulações com conjuntos de dados sintéticos que incluem padrões altamente estruturados de “barras e listras”, o QD3PM não apenas ajusta a distribuição global com mais precisão do que modelos clássicos de difusão e modelos quânticos que dependem de fatoração, como também se comporta de forma robusta sob níveis realistas de ruído do hardware quântico e lida bem com geração condicional.

O que os resultados significam adiante

No conjunto, a análise e os experimentos mostram que tratar dimensões independentemente é um gargalo sério para modelos de difusão discreta quando os dados são fortemente correlacionados. Ao usar estados quânticos para aprender distribuições conjuntas diretamente, o QD3PM evita essa limitação e pode, em teoria, corresponder perfeitamente a distribuições-alvo complexas em casos onde abordagens clássicas fatorizadas não conseguem. O trabalho também demonstra como modelos generativos quânticos podem oferecer não apenas maior poder expressivo, mas também benefícios práticos, como amostragem rápida em uma etapa e inferência condicional flexível sem retraining. Embora as demonstrações atuais sejam limitadas a sistemas relativamente pequenos que podem ser simulados em computadores clássicos, a estrutura fornece um roteiro concreto de como o hardware quântico emergente poderia um dia aprimorar o mecanismo central da IA generativa.

Citação: Chen, C., Zhao, Q., Zhou, M. et al. Overcoming Dimensional Factorization Limits in Discrete Diffusion Models through Quantum Joint Distribution Learning. npj Quantum Inf 12, 49 (2026). https://doi.org/10.1038/s41534-026-01188-0

Palavras-chave: modelos generativos quânticos, modelos de difusão, aprendizado de distribuição conjunta, correlações de alta dimensão, geração condicional