Clear Sky Science · pt

Fechando a lacuna de latência com um framework de avaliação de fluxo contínuo em percepção orientada a eventos

Por que uma visão robótica mais rápida importa

Imagine um carro autônomo detectando um obstáculo repentino ou um robô tentando rebater uma bola de pingue-pongue veloz. Nessas situações de fração de segundo, ver rapidamente é tão importante quanto ver com clareza. Este artigo explora uma nova forma de avaliar quão rápidos e confiáveis são, na prática, as avançadas “câmeras de eventos” ao rastrear objetos em movimento, e mostra que os testes de laboratório tradicionais podem superestimar dramaticamente o desempenho desses sistemas no mundo real.

De instantâneos para fluxos

A maioria dos sistemas de visão computacional atuais trata o mundo como uma apresentação de slides. Câmeras convencionais capturam imagens em intervalos fixos e algoritmos processam um quadro por vez. Mesmo quando engenheiros usam câmeras neuromórficas, ou baseadas em eventos, que detectam mudanças de brilho com resolução de microssegundos, frequentemente convertem esse fluxo contínuo e rico de volta em quadros grosseiros. Essa mentalidade baseada em quadros oculta um problema crucial: o atraso. Cada vez que o sistema espera pelo próximo quadro e depois o processa, preciosos milissegundos se perdem. Em tarefas de alta velocidade, como direção autônoma ou interação humano–robô, esse atraso faz com que o sistema reaja ao passado recente em vez do presente.

Uma nova forma de pontuar visão em tempo real

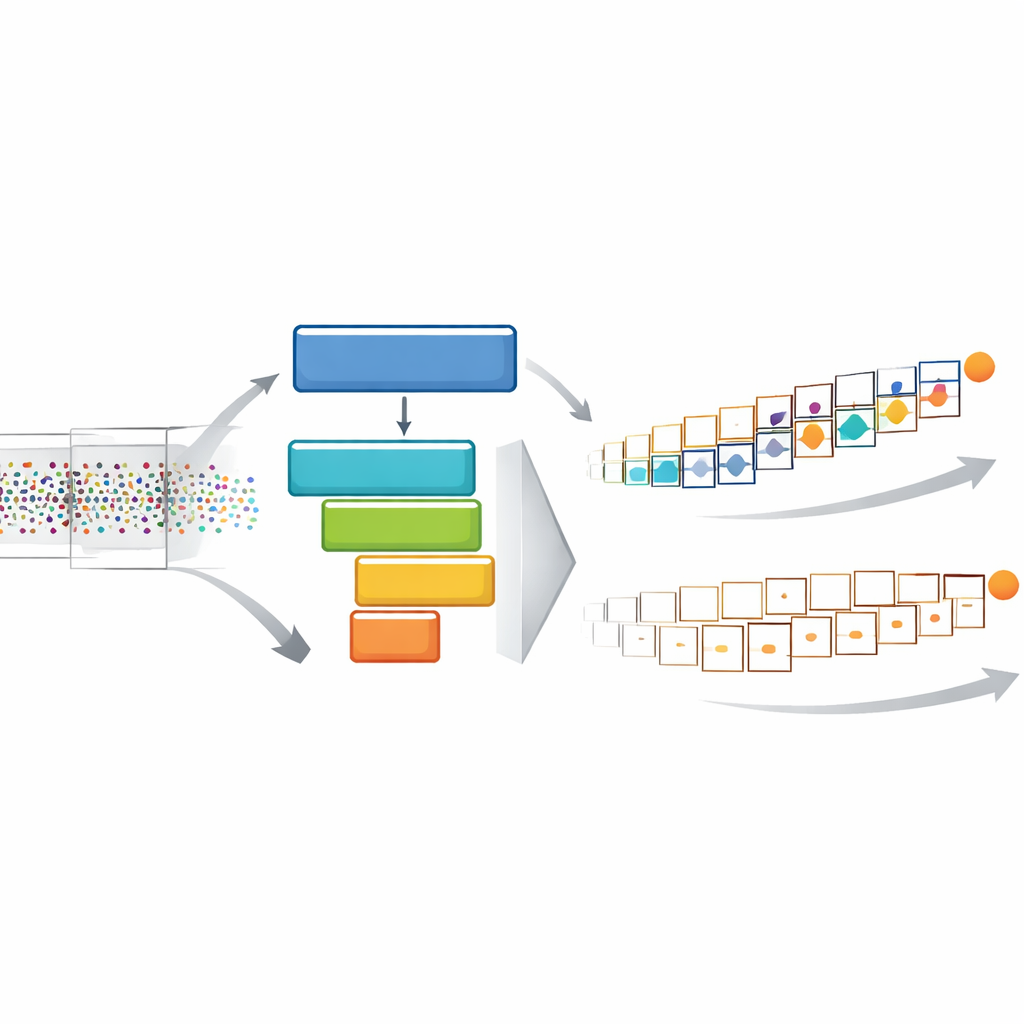

Para fechar essa lacuna entre as notas de laboratório e as necessidades do mundo real, os autores apresentam um framework chamado STream-based lAtency-awaRe Evaluation, ou STARE. Em vez de forçar os dados de eventos em quadros fixos, o STARE alimenta um modelo com os eventos mais recentes assim que ele termina sua última predição. Essa “Amostragem Contínua” mantém o modelo ocupado e eleva sua taxa de saída ao máximo que o hardware permite. Ao mesmo tempo, o STARE avalia a precisão de uma nova maneira: cada posição de verdade-terreno de um objeto em movimento é pareada com a predição mais recente disponível naquele instante. Se o modelo for lento, a mesma predição desatualizada é reutilizada para muitos instantes, e sua precisão aparente cai. Isso incorpora diretamente o custo do atraso na pontuação final.

Construindo um banco de testes de alta velocidade

Medir cronometragens tão refinadas exige dados igualmente refinados, algo que os conjuntos de dados existentes para câmeras de eventos não oferecem. Eles normalmente registram a posição de um objeto apenas algumas dezenas de vezes por segundo. Por isso, os autores criaram o ESOT500, um novo conjunto de dados em que objetos são anotados 500 vezes por segundo, usando câmeras de eventos de baixa e alta resolução e cobrindo cenas variadas, como ventiladores girando, pássaros em voo e veículos em movimento. Nessa densidade, as trilhas de verdade-terreno seguem movimentos rápidos e complexos com precisão suficiente para evitar “alising temporal”, onde amostragens lentas fazem um trajeto acelerado e sinuoso parecer enganadoramente simples. O ESOT500 atua, portanto, como um teste de estresse para qualquer método que diga lidar com dinâmicas rápidas e imprevisíveis.

O que realmente acontece quando a latência importa

Munidos de STARE e ESOT500, os autores reavaliaram uma gama de rastreadores de objetos de ponta. Quando julgados sob testes tradicionais baseados em quadros, modelos mais pesados e complexos frequentemente parecem os melhores. Sob o STARE, entretanto, muitos desses sistemas lentos, embora de alta precisão, perdem mais da metade de sua precisão efetiva quando o atraso é levado em conta. Modelos mais leves e rápidos sobem repentinamente ao topo, porque oferecem predições mais frequentes e atualizadas. A equipe confirmou isso em um experimento com robô jogando pingue-pongue: um robô usou uma câmera de eventos e um rastreador para rebater bolas que vinham em sua direção. Uma percepção moderadamente mais rápida quase dobrou a taxa de acerto, enquanto um modelo mais lento, embora forte em processamento offline, teve desempenho ruim. Em outras palavras, em tempo real, velocidade e frescor da informação podem valer mais do que precisão bruta.

Uso mais inteligente de fluxos contínuos

Além da avaliação, os autores exploram como projetar sistemas melhores para visão contínua. Uma estratégia, “Rastreamento Assíncrono”, emparelha um modelo base lento, porém cuidadoso, com um companheiro menor e ágil que atualiza a posição do objeto entre as passagens completas do modelo base. Essa configuração dupla reutiliza características compartilhadas e explora o fluxo constante de eventos, aumentando a taxa de saída em quase 80% e melhorando a precisão consciente da latência em cerca de 60%. Uma segunda estratégia, “Amostragem Consciente do Contexto”, monitora quantos eventos ocorrem ao redor do objeto rastreado. Quando a cena está calma e pouco muda, o rastreador reutiliza temporariamente sua última boa estimativa em vez de recalcular, reduzindo esforço desperdiçado. Ele então reativa quando o movimento aumenta, ajudando especialmente em condições de baixa atividade ou com eventos esparsos.

Fechando a lacuna entre laboratório e vida real

Para não especialistas, a mensagem principal é simples: em situações de movimento rápido, com que rapidez um sistema de visão consegue atualizar sua compreensão do mundo importa tanto quanto a precisão de cada predição individual. Tratando a saída da câmera como um fluxo verdadeiro e incorporando o atraso diretamente na pontuação, o STARE revela fraquezas que testes convencionais deixam passar e destaca desenhos que realmente funcionam sob pressão. Junto com o conjunto de dados ESOT500 e as estratégias de rastreamento propostas, este trabalho aponta para robôs, veículos e máquinas interativas do futuro que não apenas veem bem, mas veem no tempo certo.

Citação: Chu, J., Zhang, R., Yang, C. et al. Bridging the latency gap with a continuous stream evaluation framework in event-driven perception. Nat Commun 17, 2441 (2026). https://doi.org/10.1038/s41467-026-70240-6

Palavras-chave: câmeras de eventos, rastreamento em tempo real, visão robótica, avaliação consciente da latência, percepção neuromórfica