Clear Sky Science · pt

Estimativas de incerteza confiáveis em deep learning com algoritmos eficientes de Metropolis-Hastings

Por que incerteza mais inteligente importa

De exames médicos a carros autônomos, a inteligência artificial moderna frequentemente toma decisões nas quais estar confiante e errado pode ser perigoso. Sistemas de deep learning padrão são excelentes em reconhecer padrões, mas são notoriamente ruins em nos dizer quão inseguros estão. Este artigo aborda essa lacuna: apresenta novas formas de equipar redes neurais profundas com medidas de incerteza confiáveis, mantendo sob controle o custo computacional elevado dos métodos bayesianos tradicionais.

Do palpite à confiança mensurada

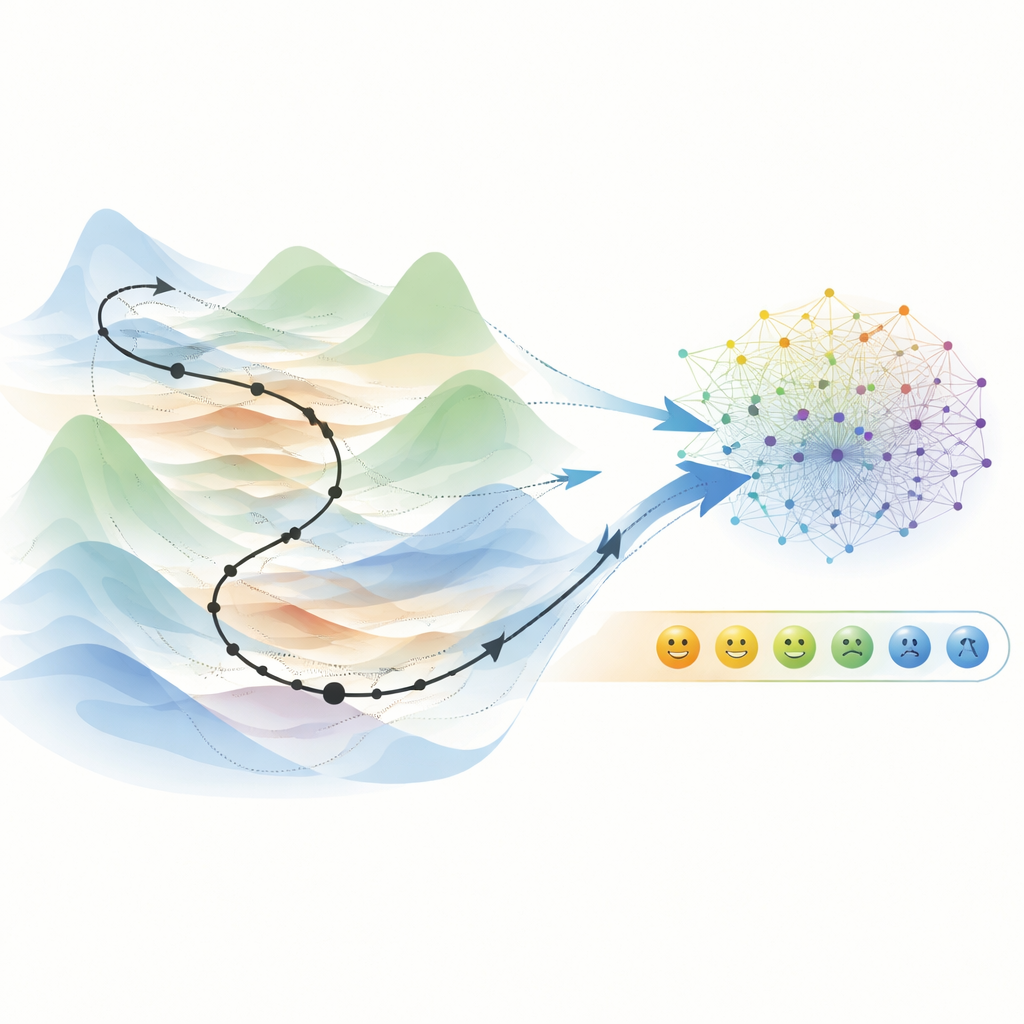

No deep learning cotidiano, um modelo é treinado uma vez e então usado como está. Ele fornece um único palpite melhor, mas oferece pouca visão sobre quão confiável é esse palpite. Redes neurais bayesianas seguem outro caminho: em vez de fixar um conjunto de parâmetros do modelo, tratam os parâmetros como variáveis aleatórias e procuram capturar toda uma distribuição de modelos plausíveis. Fazer a média das previsões ao longo dessa coleção pode revelar tanto a resposta mais provável quanto quanto o modelo deve confiar em si mesmo. O desafio é que amostrar com precisão essa distribuição com métodos de padrão-ouro, como Hamiltonian Monte Carlo, é extremamente custoso para as redes e conjuntos de dados grandes de hoje.

Amostragem mais rápida sem perder a visão global

Os autores se concentram numa família de métodos chamada Hamiltonian Monte Carlo por gradiente estocástico, que já reutiliza ideias do treinamento padrão — mini-batches e gradientes ruidosos — para acelerar a amostragem. O ingrediente que faltava é um “filtro” confiável que decide quais atualizações de parâmetro provisórias devem ser aceitas. No Hamiltonian Monte Carlo clássico, esse papel é desempenhado por um passo de aceitação de Metropolis-Hastings que corrige erros numéricos e evita que o amostrador desvie para regiões erradas. Introduzir esse passo de aceitação no mundo ruidoso e baseado em mini-batches do deep learning é difícil, porque normalmente exige avaliações sobre o conjunto de dados completo e pode travar o progresso se as taxas de aceitação forem muito baixas.

Duas novas maneiras de percorrer o espaço

O artigo apresenta duas estratégias complementares. A primeira, chamada Hamiltonian Monte Carlo por gradiente estocástico generalizado (GSGHMC), concebe um teste de aceitação que funciona com mini-batches enquanto preserva a importante propriedade de que os verdadeiros ótimos do problema completo ainda são corretamente reconhecidos. Ela usa um integrador numérico cuidadosamente escolhido para que a aceitação passo a passo permaneça estável, mesmo que ele veja apenas uma fatia dos dados por vez. Isso resulta em um amostrador eficiente que fica próximo ao quadro bayesiano verdadeiro e produz conjuntos de modelos com pontuações de confiança particularmente bem calibradas.

Percorrendo trajetórias longas para melhores previsões

O segundo método, o Hamiltonian Trajectory Ensemble (HTE), faz uma concessão deliberada: em vez de insistir em um comportamento bayesiano exato, favorece caminhadas longas e impulsionadas por momento através do espaço de parâmetros que se assemelham a execuções de treinamento agressivas. Ao final de cada trajetória, um teste no estilo Metropolis decide se o instantâneo do modelo resultante deve ser mantido. Como esses caminhos tendem a se estabelecer em vales amplos e generalizáveis da paisagem de perda, os modelos coletados formam um conjunto diverso, porém focado. Em benchmarks de classificação de imagens como EMNIST e CIFAR-10, o HTE melhora a acurácia em até cerca de seis pontos percentuais sobre fortes baselines bayesianos, e em vários pontos sobre treinamento determinístico comum, ao mesmo tempo em que ainda fornece informações úteis de incerteza e forte detecção de entradas fora da distribuição.

Conjuntos menores, uso mais inteligente

Amostrar centenas ou milhares de modelos parece caro na hora do teste, então os autores também estudam quantos membros do conjunto são realmente necessários. Ao descartar gulosa e iterativamente modelos que têm pouco efeito no desempenho, eles descobrem que aproximadamente um terço do conjunto pode frequentemente ser mantido sem prejudicar a acurácia, embora manter uma calibração muito afiada tipicamente exija mais membros. Em tarefas de imagens e num problema caótico de previsão de séries temporais, seus métodos consistentemente superam ou igualam alternativas populares, como inferência variacional, Monte Carlo dropout e ensembles simples, embora com custo de treinamento maior do que o aprendizado determinístico comum.

O que isso significa para a IA no mundo real

Para um não especialista, a mensagem central é que podemos tornar o deep learning não apenas preciso, mas também honesto sobre o que não sabe, sem precisar de recursos ao nível de supercomputadores. Ao entrelaçar cuidadosamente ideias clássicas de amostragem com o treinamento moderno baseado em mini-batches, as duas abordagens propostas oferecem melhores previsões e estimativas de confiança mais confiáveis do que muitas técnicas existentes. Essa combinação de eficiência, robustez e incerteza calibrada é um passo chave para implantar deep learning de forma segura em domínios sensíveis onde o custo do excesso de confiança pode ser medido em vidas, e não apenas em pontos percentuais.

Citação: Schmal, M., Mäder, P. Reliable uncertainty estimates in deep learning with efficient Metropolis-Hastings algorithms. Nat Commun 17, 2531 (2026). https://doi.org/10.1038/s41467-026-70015-z

Palavras-chave: redes neurais bayesianas, estimação de incerteza, Hamiltonian Monte Carlo, conjuntos em deep learning, MCMC por gradiente estocástico