Clear Sky Science · pt

Um transformador pré-treinado equivariante para aprendizagem unificada de representações moleculares 3D

Ensinando Computadores a Ver Moléculas em 3D

Projetar novos medicamentos e materiais depende de compreender como as moléculas realmente são e se movem em três dimensões, não apenas como fórmulas bidimensionais no papel. Este artigo apresenta um novo e potente modelo de inteligência artificial que pode aprender a partir das formas 3D de muitos tipos de moléculas ao mesmo tempo — desde pequenos compostos semelhantes a fármacos até grandes proteínas e seus complexos — e então usar esse conhecimento para prever quão fortemente interagem e quais podem se tornar futuros medicamentos.

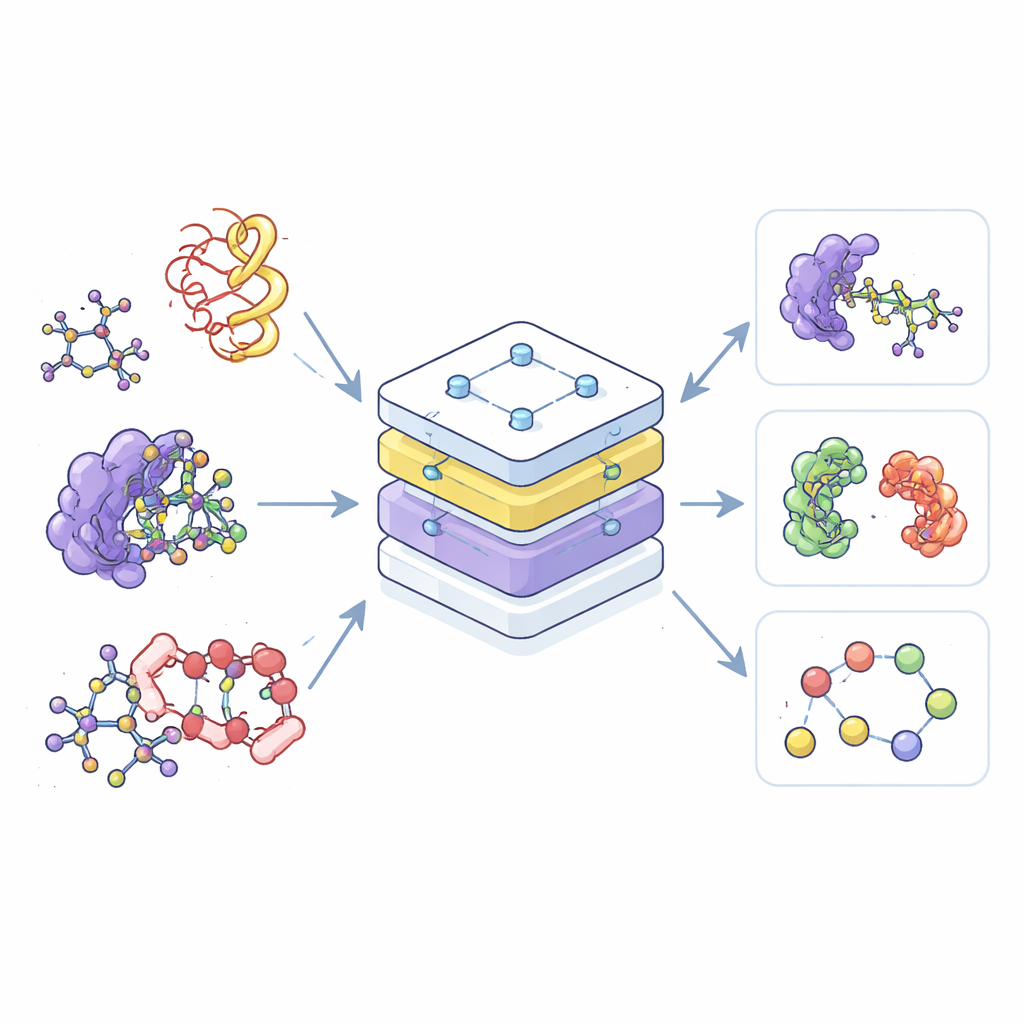

Um Único Mapa para Muitos Mundos Moleculares

A maioria das ferramentas de IA atuais para química é especializada: uma é treinada apenas em pequenas moléculas, outra somente em proteínas e uma terceira apenas em seus complexos. Essa separação desperdiça dados e dificulta transferir o que se aprendeu de uma área para outra. Os autores constroem, em vez disso, um único modelo “fundacional”, chamado Transformador Pré-Treinado Equivariante (EPT), que aprende a partir de uma vasta coleção de estruturas moleculares 3D extraídas de múltiplos bancos de dados públicos. Ao tratar todas essas estruturas dentro de um mesmo arcabouço, o modelo consegue reconhecer padrões comuns em como os átomos se organizam e interagem, seja em uma molécula simples ou em um emaranhado complexo de cadeias proteicas.

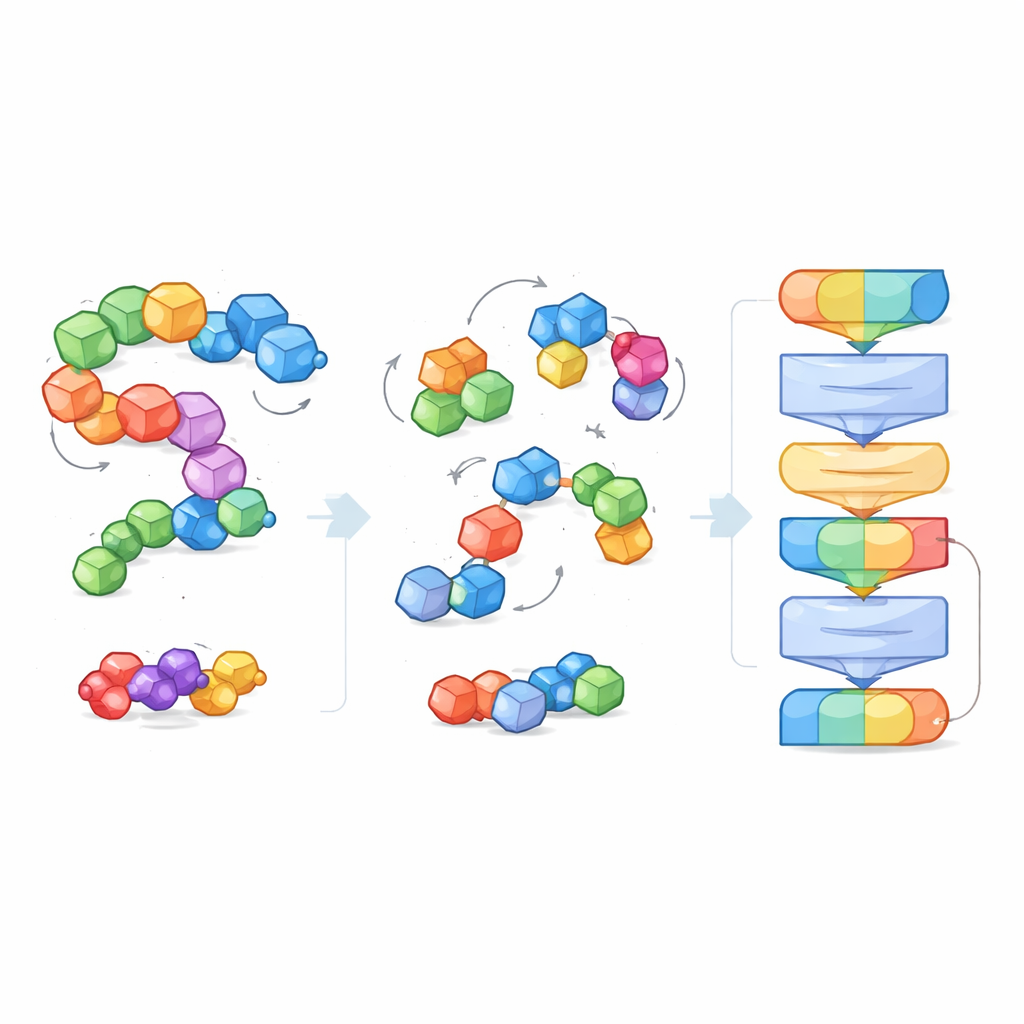

Fragmentando Moléculas em Pedaços Gerenciáveis

Para lidar com a enorme variedade e tamanho dos sistemas moleculares, os pesquisadores introduzem a ideia de “blocos” — pequenos pedaços significativos de átomos. Para moléculas pequenas, um bloco agrupa um átomo pesado com os hidrogênios ligados a ele; para proteínas, cada aminoácido vira um bloco. Durante o treinamento, o modelo vê tanto os átomos em detalhe quanto a estrutura mais grosseira em blocos, permitindo conectar detalhes químicos locais a formas 3D mais amplas, como a espinha dorsal da proteína ou bolsões de ligação. Essa visão em blocos também cria uma linguagem comum que funciona através de tipos moleculares muito diferentes, tornando possível um único modelo entendê-los todos.

Aprendendo ao Reparar Estruturas Ruidosas

Em vez de receber rótulos explícitos como “esta molécula é solúvel” ou “esta se liga fortemente”, o EPT é treinado de maneira auto-supervisionada. Os autores perturbam deliberadamente cada bloco molecular, deslocando e girando-o aleatoriamente fora de sua posição verdadeira, e então pedem ao modelo que infira as forças e torques necessários para restaurar a estrutura original. Como o treinamento respeita regras geométricas fundamentais — a molécula deve parecer a mesma se todo o sistema for rotacionado ou movido no espaço — o modelo aprende um senso fisicamente coerente de forma 3D. Esse jogo de denoising ensina o EPT como os átomos dentro e entre blocos se mantêm juntos e como mudanças sutis na geometria afetam a estabilidade.

Confrontando o Modelo com Testes

Após pré-treinamento em mais de cinco milhões de estruturas, o EPT é refinado para várias tarefas científicas reais. Ele prevê quão fortemente uma pequena molécula se liga a um bolsão proteico, como uma única mutação na interface de uma proteína afeta a ligação, e propriedades físicas-chave de pequenas moléculas que interessam aos químicos. Em diversos benchmarks, o modelo unificado iguala ou supera as melhores ferramentas existentes, incluindo as cuidadosamente ajustadas para apenas um domínio. Notavelmente, quando treinado em um tipo de dado, como pequenas moléculas, ele ainda ajuda em tarefas aparentemente diferentes, como ligação a proteínas, revelando que capturou princípios químicos amplamente úteis em vez de truques específicos.

Buscando Novos Tratamentos para a COVID‑19

Os autores demonstram ainda o valor prático do EPT ao aplicá-lo a um desafio de reposicionamento de fármacos. Eles primeiro ajustam o modelo em complexos proteína–ligante e então o usam para ranquear quase 2.000 medicamentos já aprovados segundo sua capacidade predita de se ligar à protease principal do SARS‑CoV‑2, uma enzima-chave que o vírus precisa para se replicar. Medicamentos conhecidos contra a COVID‑19 sobem para o topo do ranking, e o modelo destaca candidatos promissores adicionais. Doze moléculas com pontuação alta são examinadas mais detalhadamente com simulações computacionais, e duas — incluindo uma não desenvolvida originalmente para COVID‑19 — mostram ligação predita especialmente forte e são confirmadas experimentalmente como inibidoras da protease viral em níveis micromolares.

Um Passo Rumo à IA Molecular Geral

Em termos simples, este trabalho mostra que um único modelo de IA consciente da geometria pode aprender um entendimento 3D compartilhado de muitos sistemas moleculares e então usá-lo para responder a uma ampla gama de perguntas científicas. Ao organizar moléculas em blocos e treinar o modelo para “reparar” estruturas distorcidas, os autores criam uma ferramenta que não apenas prevê números com mais precisão, mas também pode acelerar tarefas como encontrar novos antivirais. O EPT aponta para um futuro em que sistemas de IA molecular de uso geral ajudam químicos e biólogos a explorar o espaço químico com mais eficiência, orientando experimentos e encurtando o caminho da estrutura atômica até terapias e materiais práticos.

Citação: Jiao, R., Kong, X., Zhang, L. et al. An equivariant pretrained transformer for unified 3D molecular representation learning. Nat Commun 17, 2606 (2026). https://doi.org/10.1038/s41467-026-69185-7

Palavras-chave: representação molecular 3D, transformador equivariante, descoberta de fármacos, ligação proteína–ligante, aprendizado auto-supervisionado