Clear Sky Science · pt

Aprendizado por transferência no DeepLC melhora a predição do tempo de retenção em LC para modificações e configurações substancialmente diferentes

Por que prever o tempo químico importa

Cada vez que cientistas estudam as proteínas em nossas células, eles dependem de uma técnica que primeiro faz passar pequenos fragmentos de proteína, chamados peptídeos, por uma coluna preenchida com líquido antes de pesá‑los em um espectrômetro de massa. Quanto tempo cada peptídeo passa na coluna — seu “tempo de retenção” — é extremamente informativo, ajudando pesquisadores a reconhecer e confirmar o que está sendo medido. Mas, como cada laboratório usa instrumentos e configurações ligeiramente diferentes, modelos computacionais que prevêem esses tempos de retenção frequentemente falham ao serem transferidos de um sistema para outro. Este artigo mostra como um truque moderno de aprendizado de máquina chamado aprendizado por transferência pode tornar essas predições muito mais confiáveis e flexíveis em diversas condições experimentais.

Cronometrando a jornada dos fragmentos proteicos

Na pesquisa proteica, a cromatografia líquida acoplada à espectrometria de massa é o método central. A etapa de cromatografia líquida separa milhares de peptídeos com base em suas propriedades químicas, para que não cheguem todos ao detector ao mesmo tempo. O tempo de retenção resultante, junto com a massa medida do peptídeo, fornece aos cientistas uma poderosa impressão digital bidimensional. Na última década, pesquisadores treinaram modelos computacionais para prever tempos de retenção diretamente a partir de sequências de peptídeos. Essas predições aumentam a confiança nas identificações de peptídeos, ajudam a planejar experimentos melhores e são essenciais para construir grandes bibliotecas espectrais geradas por computador usadas em fluxos de trabalho de alto rendimento modernos.

O problema das condições de laboratório que mudam

Infelizmente, o tempo de retenção é altamente sensível a detalhes como acidez do solvente, material da coluna, pressão e temperatura. Mesmo pequenas mudanças podem reordenar a sequência em que os peptídeos emergem da coluna. Abordagens tradicionais tentam contornar isso “calibrando” um modelo treinado em outro lugar com um pequeno conjunto de peptídeos de referência, presumindo que a ordem de eluição dos peptídeos permanece a mesma. Quando essa suposição falha — por exemplo, quando a química da coluna ou o pH da amostra mudam — a calibração pode falhar de forma pronunciada. Outra opção é treinar um modelo completamente novo para cada configuração, mas isso exige muitos peptídeos bem medidos, que nem sempre estão disponíveis, especialmente para modificações químicas raras ou incomuns.

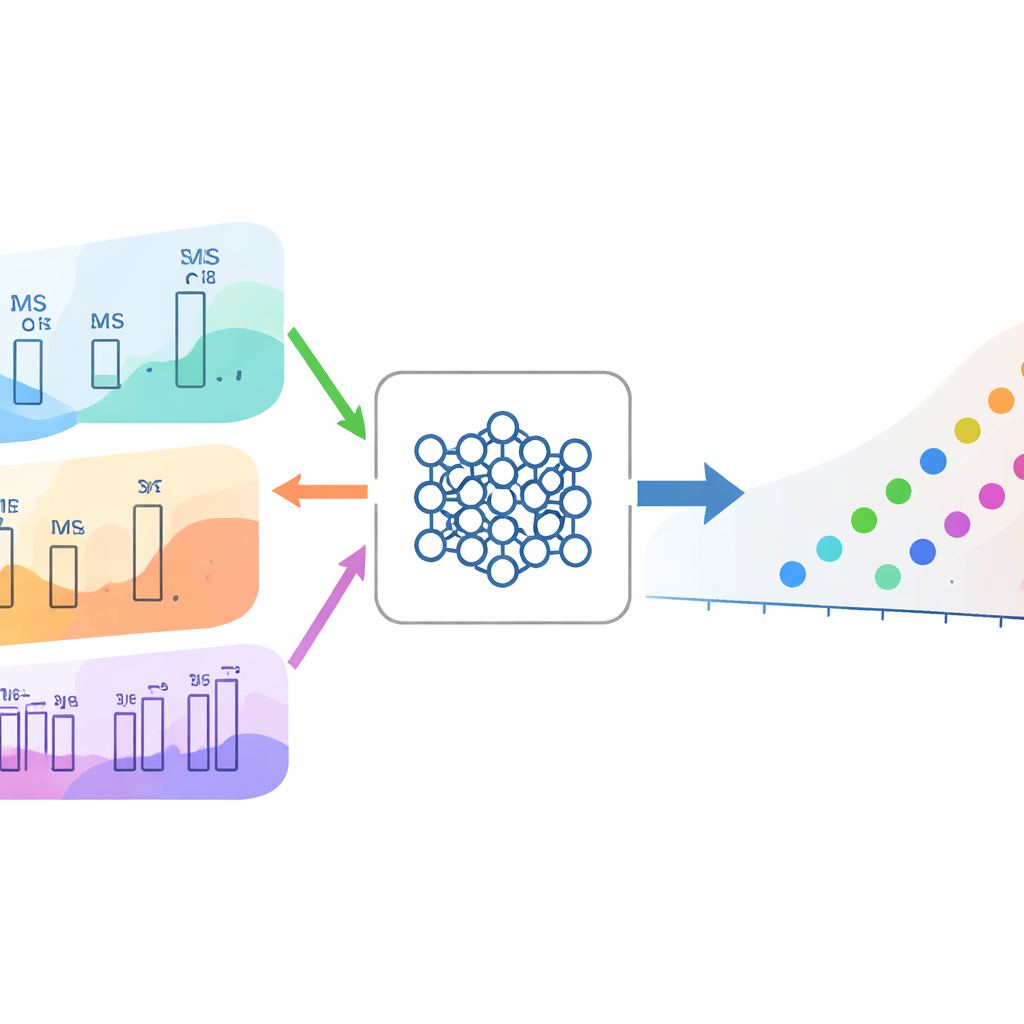

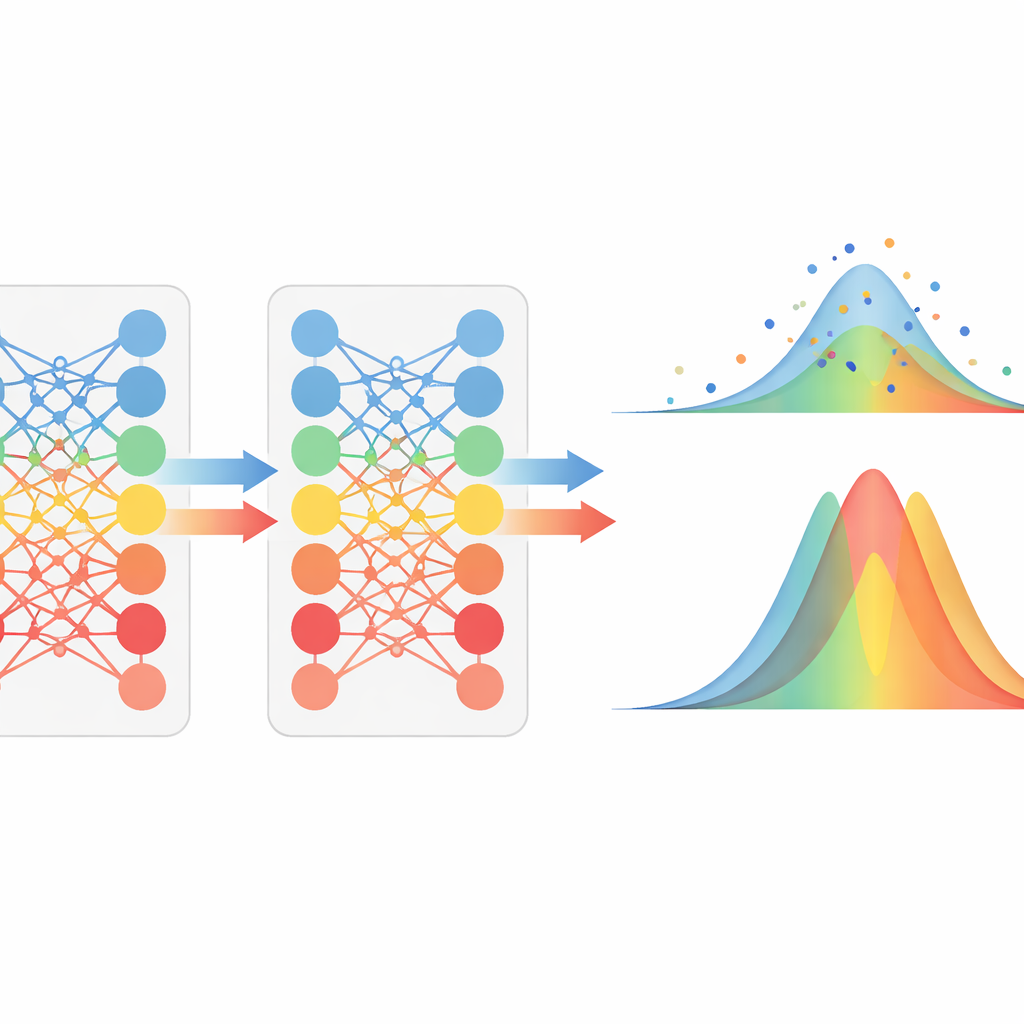

Reutilizando conhecimento com aprendizado por transferência

Os autores partem do DeepLC, um modelo de aprendizado profundo que já prevê tempos de retenção para muitos tipos de peptídeos. Em vez de começar do zero para cada nova situação, eles reutilizam um modelo treinado em um grande conjunto de dados de alta qualidade e o ajustam (fine‑tune) em uma coleção muito menor de peptídeos da nova configuração. Em 474 conjuntos de dados provenientes de centenas de experimentos públicos, essa estratégia de aprendizado por transferência quase sempre superou tanto a calibração simples quanto o treinamento de um novo modelo a partir de parâmetros iniciais aleatórios. Os ganhos são especialmente evidentes quando apenas algumas centenas a alguns milhares de peptídeos de treino estão disponíveis, um cenário comum em estudos reais. Mesmo quando muitos exemplos existem, o aprendizado por transferência tende a oferecer uma precisão ligeiramente melhor.

Lidando com químicas incomuns e condições extremas

Para testar até onde essa abordagem pode ser levada, a equipe examinou cenários muito desafiadores. Em um deles, os peptídeos carregavam um rótulo químico volumoso que os torna muito mais “oleosos”, deslocando fortemente seus tempos de retenção. Em outro, o líquido na coluna era básico em vez de ácido, mudando fundamentalmente como os peptídeos interagem com a coluna. Em ambos os casos, simplesmente calibrar um modelo antigo falhou, e mesmo um modelo recém‑treinado precisou de muitos exemplos para alcançar boa precisão. O aprendizado por transferência, no entanto, se adaptou rapidamente, alcançando desempenho similar ou melhor com duas a três vezes menos peptídeos de treino. O método também melhorou predições para um amplo painel de modificações pós‑translacionais que nunca foram vistas durante o treino, indicando que o conhecimento prévio do modelo sobre a química dos peptídeos transfere para novas modificações.

O que isso significa para futuros estudos de proteínas

Para não especialistas, a mensagem central é que reutilizar o que uma rede neural já aprendeu sobre o comportamento dos peptídeos torna muito mais fácil obter predições de tempo precisas sob novas condições experimentais. Em vez de coletar laboriosamente grandes conjuntos de treino ou aceitar desempenho ruim a partir de uma calibração simples, os pesquisadores podem ajustar um modelo DeepLC existente com um número modesto de exemplos e ainda alcançar tempos de retenção altamente precisos. Isso torna ferramentas avançadas de predição mais robustas e acessíveis, permitindo análises confiáveis entre diferentes instrumentos, condições químicas e modificações raras de peptídeos, e, em última instância, ajudando os cientistas a ler o mundo das proteínas com maior clareza e eficiência.

Citação: Bouwmeester, R., Nameni, A., Declercq, A. et al. Transfer learning in DeepLC improves LC retention time prediction across substantially different modifications and setups. Nat Commun 17, 2601 (2026). https://doi.org/10.1038/s41467-026-68981-5

Palavras-chave: proteômica, cromatografia líquida, predição de tempo de retenção, aprendizado profundo, aprendizado por transferência