Clear Sky Science · pt

Colaboração humano-IA para melhorar a precisão e eficiência do pré-triagem de critérios de elegibilidade em ensaios oncológicos: um ensaio randomizado de avaliação usando prontuários eletrônicos retrospectivos

Por que encontrar os pacientes certos importa

Para muitas pessoas com câncer, participar de um ensaio clínico pode abrir portas para tratamentos de ponta e melhores desfechos. Ainda assim, apenas uma pequena fração dos adultos com câncer chega a se inscrever. Um gargalo importante ocorre muito antes de o paciente assinar um termo de consentimento: a equipe precisa vasculhar prontuários longos e bagunçados para saber quem realmente se qualifica. Este estudo questiona se emparelhar especialistas humanos com um sistema de inteligência artificial pode tornar essa triagem inicial mais precisa — sem retardar o processo.

Como a triagem de ensaios funciona hoje

Antes que uma pessoa possa ingressar em um ensaio oncológico, a equipe de pesquisa clínica deve decidir se o paciente atende a dezenas de regras detalhadas de inclusão, como tipo de câncer, estadiamento, resultados de exames e nível funcional diário. Muito dessa informação está enterrada em notas não estruturadas — laudos de radiologia, consultas ambulatoriais, resumos de exames — que frequentemente são repetitivas, incompletas ou contraditórias. Vasculhar esses documentos manualmente é lento e exaustivo, e até profissionais experientes podem deixar passar detalhes-chave. Como resultado, alguns pacientes elegíveis nunca são identificados e opções que poderiam prolongar a vida se perdem.

O que os pesquisadores testaram

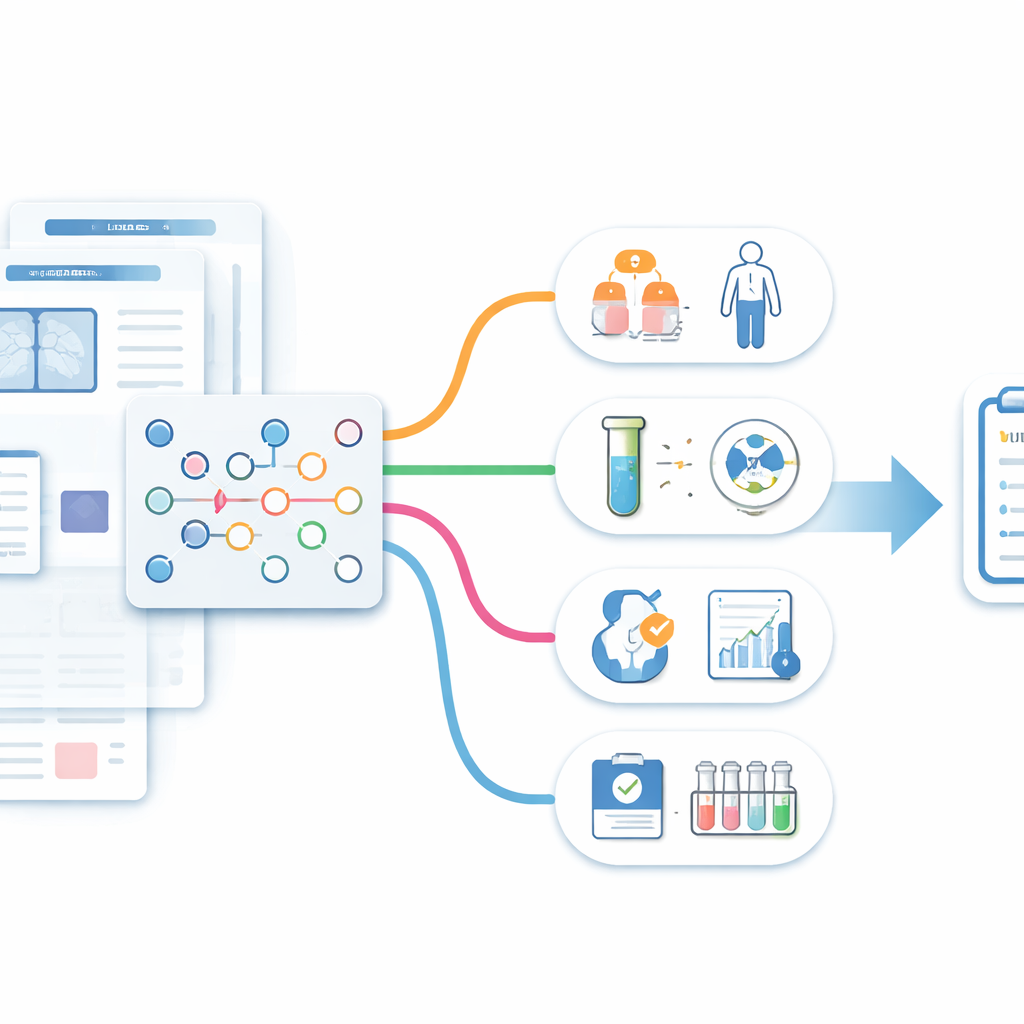

Para verificar se a IA poderia ajudar, a equipe usou registros eletrônicos de 355 pessoas com câncer de pulmão ou colorretal tratadas em uma prática comunitária. Focaram em 12 critérios comuns de ensaios, incluindo estadiamento tumoral, biomarcadores específicos, resposta a tratamentos prévios e estado geral de saúde. Um sistema de linguagem neurossimbólico especializado primeiro converteu prontuários digitalizados em texto e, em seguida, identificou fatos estruturados como resultados de exames e detalhes de estadiamento. Dois coordenadores de pesquisa treinados revisaram cada prontuário duas vezes — uma com sugestões da IA na tela (abordagem Humano+IA) e outra sem elas (abordagem Somente Humano), em ordem aleatória. Um grupo separado de clínicos já havia criado um gabarito “padrão-ouro” para cada prontuário para avaliar a precisão.

Desempenho da equipe Humano–IA

Quando humanos e IA trabalharam juntos, corresponderam às respostas padrão-ouro com mais frequência do que humanos sozinhos. No geral, a equipe Humano+IA acertou cerca de três em cada quatro itens, comparado com pouco mais de sete em cada dez para revisores humanos isolados, e muito melhor do que o sistema de IA por si só. Os maiores ganhos ocorreram em áreas complexas, como testes e resultados de biomarcadores, estadiamento preciso do tumor e resposta a tratamentos anteriores. Nesses critérios, a habilidade da IA em vasculhar grandes volumes de texto ajudou os coordenadores a identificar informações que poderiam passar despercebidas, enquanto os humanos corrigiam erros da IA e interpretavam casos incertos.

Velocidade, trade-offs e vieses humanos

Surpreendentemente, a adição da IA não acelerou o processo. Ambas as abordagens levaram um pouco mais de meia hora por prontuário, em média. Os autores sugerem que, em vez de economizar tempo, a IA mudou o trabalho dos coordenadores: em vez de procurar cada detalhe por conta própria, eles passaram a dedicar mais esforço a checar e interpretar as entradas sugeridas pela IA. Isso pode ser, de fato, uma salvaguarda saudável, reduzindo o risco de que as pessoas aceitem as respostas da máquina sem questionar. O estudo também investigou onde a colaboração pode falhar. Em uma medida de funcionamento do paciente, a IA mostrou-se pouco confiável, e revisores humanos que confiaram excessivamente em sua saída tiveram desempenho ligeiramente pior — um sinal de “viés de automação”. Em outras áreas, os humanos pareceram subutilizar sinais precisos da IA, sugerindo um “viés de confirmação”, em que as pessoas preferem informações que confirmem suas impressões iniciais.

O que isso significa para o cuidado oncológico futuro

Em termos simples, este ensaio mostra que uma parceria bem projetada entre pessoas e IA pode tornar a triagem inicial para ensaios um pouco mais precisa sem torná-la mais lenta. As melhorias são modestas, mas concentradas exatamente nos tipos de detalhes complexos — como status de biomarcadores e estadiamento preciso — que frequentemente decidem se um paciente pode participar de um estudo. Se tais sistemas forem refinados e testados em fluxos de trabalho clínicos ao vivo, eles poderão ajudar a descobrir mais pacientes elegíveis, ampliar quem tem acesso a ensaios oncológicos de ponta e fazê-lo mantendo os humanos no controle final das decisões.

Citação: Parikh, R.B., Kolla, L., Beothy, E.A. et al. Human-AI teaming to improve accuracy and efficiency of eligibility criteria prescreening for oncology trials: a randomized evaluation trial using retrospective electronic health records. Nat Commun 17, 2306 (2026). https://doi.org/10.1038/s41467-026-68873-8

Palavras-chave: ensaios clínicos de câncer, prontuários eletrônicos, inteligência artificial, elegibilidade do paciente, colaboração humano-IA