Clear Sky Science · pt

Conexões recorrentes facilitam o reconhecimento de objetos ocultos por meio do "explaining-away"

Como o Cérebro Vê o que Não Está Lá

Na vida cotidiana, reconhecemos sem esforço objetos parcialmente escondidos—um gato atrás de uma cortina, um carro atrás de uma árvore. Este artigo investiga como cérebros, e redes artificiais inspiradas no cérebro, realizam essa façanha. Os autores mostram que circuitos com loops de retroalimentação podem usar informações sobre o objeto que bloqueia para “preencher” mentalmente o que está atrás dele, revelando um truque-chave que nosso sistema visual pode usar quando o mundo está confuso e incompleto.

Por que Objetos Ocultos São um Problema Difícil

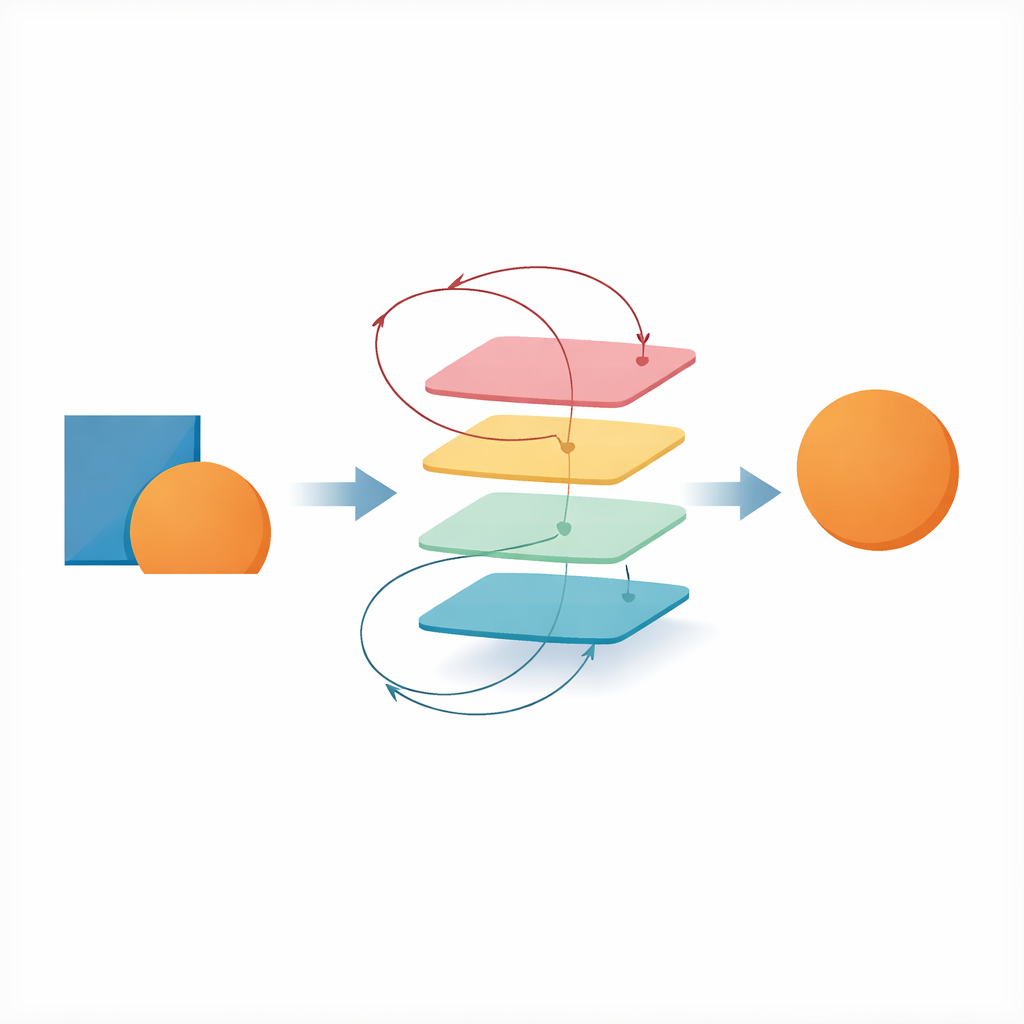

Quando um objeto está ocluído, muitas de suas características visuais habituais estão ausentes ou distorcidas. Um sistema visual simples e feedforward, onde a informação flui diretamente dos olhos para centros de reconhecimento, precisa adivinhar o objeto oculto com base apenas nos fragmentos visíveis. Cérebros biológicos, no entanto, são repletos de conexões recorrentes—loops em que áreas superiores se comunicam de volta com áreas anteriores. Esses loops são há muito suspeitos de ajudar em tarefas difíceis como reconhecer objetos ocluídos, mas não estava claro exatamente qual vantagem eles oferecem ou como alteram as representações internas do que vemos.

Testando Redes Inspiradas no Cérebro

Os autores construíram uma extensa bateria de redes convolucionais profundas que imitam estágios do processamento visual. Algumas eram puramente feedforward, enquanto outras tinham loops recorrentes ou retroalimentação top-down adicional. Treinaram esses modelos em conjuntos de imagens personalizados em que um item de moda cobria parcialmente outro. As redes precisavam identificar tanto o objeto à frente (oclusor) quanto o de trás (oculto) em diferentes configurações de tarefa. O desempenho dependia menos de o modelo ser recorrente ou feedforward e mais de sua “profundidade computacional” — quantas etapas sequenciais de processamento uma entrada percorre. Modelos feedforward profundos puderam igualar ou superar redes recorrentes na tarefa básica de reconhecimento, mostrando que a recorrência por si só não é magicamente superior.

Um Truque Especial: Explicando o Oclusor

Embora a profundidade fosse o fator mais importante para a acurácia bruta, redes recorrentes mostraram uma vantagem distintiva na forma como usavam o contexto. Quando essas redes foram instruídas a identificar primeiro o objeto da frente e só então o objeto oculto, seu desempenho no objeto oculto melhorou em comparação com quando o classificavam isoladamente. Esse padrão não apareceu em redes feedforward comuns que geravam ambos os rótulos ao mesmo tempo. Os autores interpretam isso como "explaining away": uma vez que o sistema reconhece o oclusor, ele pode tratar as características estranhas ou ausentes na imagem como causadas por esse oclusor, em vez de evidência de algum objeto novo e bizarro. Em cenas 3D mais realistas e em um modelo inspirado em primatas (CORnet), a mesma ordem—objeto da frente antes do objeto oculto—também melhorou o reconhecimento.

Vendo o Mesmo Efeito em Pessoas

Para investigar se humanos usam uma estratégia similar, os pesquisadores conduziram um experimento online. Participantes viram brevemente um único objeto, depois uma cena onde um objeto ocluía outro, e por fim precisaram escolher qual de duas opções fora o objeto oculto. Em alguns ensaios, o objeto único inicial era o mesmo que o oclusor posterior; em outros, era não relacionado. Quando as pessoas tinham acabado de ver o oclusor real, identificavam o objeto oculto com mais precisão e respondiam mais rápido, em diversos níveis de oclusão. Isso sugere que nossos cérebros, como as redes recorrentes, se beneficiam de processar primeiro o item que bloqueia e então usar esse conhecimento para interpretar as evidências parciais do que está por trás.

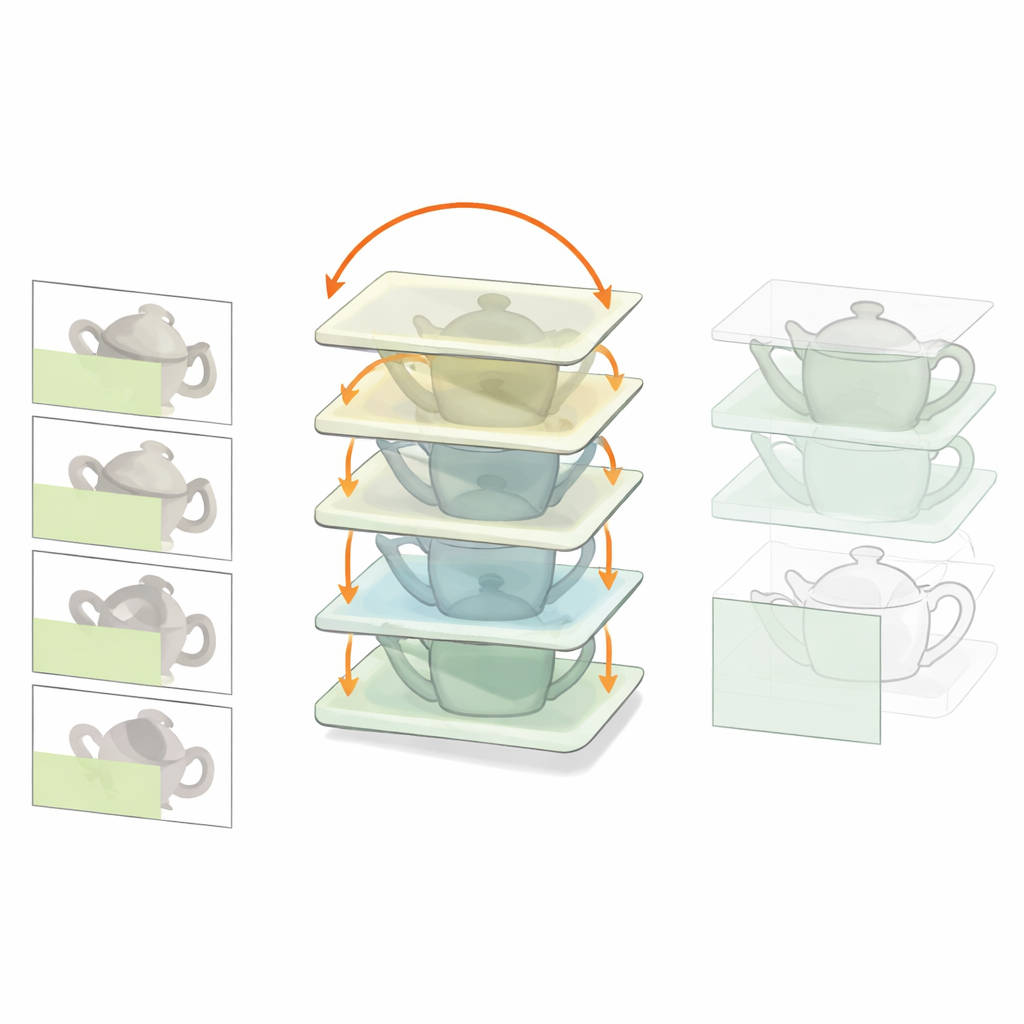

Reconstruindo Imagens Ocultas de Dentro

Para aprofundar o mecanismo, os autores projetaram um modelo mais biologicamente inspirado, Recon-Net, vagamente baseado nas interações entre córtex visual e córtex pré-frontal. Recon-Net recebe uma imagem contendo um objeto ocluído mais uma visão separada do oclusor e transforma iterativamente uma representação interna até que ela corresponda ao que a versão não ocluída do objeto oculto deveria parecer. Notavelmente, classificadores treinados apenas em imagens limpas e não ocluídas conseguem reconhecer as saídas do Recon-Net quase tão bem como se tivessem sido treinados diretamente em exemplos ocluídos. Isso significa que o processamento recorrente efetivamente “reconstitui” uma imagem interna limpa do objeto oculto, mesmo que os pixels estejam ausentes.

O que Isso Significa para Cérebros e Máquinas

No geral, o estudo mostra que loops de retroalimentação não tratam apenas de desempenho bruto, mas de uma maneira qualitativamente diferente de usar o contexto. Conexões recorrentes naturalmente suportam o explaining-away: elas permitem que o sistema visual explique como um oclusor distorce o que vemos e restaure uma representação interna estável do objeto oculto. Ao mesmo tempo, os autores constatam que treinar com imagens fortemente ocluídas pode deixar as respostas a imagens limpas em grande parte inalteradas, possivelmente facilitando o aprendizado em cérebros reais ao evitar reconfigurações constantes. Esses insights apontam para um princípio comum tanto para a neurociência quanto para a inteligência artificial: quando o mundo esconde informações, sistemas inteligentes não apenas olham mais — eles inferem por que elas estão faltando.

Citação: Kang, B., Midler, B., Chen, F. et al. Recurrent connections facilitate occluded object recognition by explaining-away. Nat Commun 17, 2225 (2026). https://doi.org/10.1038/s41467-026-68806-5

Palavras-chave: reconhecimento de objetos ocultos, redes neurais recorrentes, percepção visual, explaining away, neurociência computacional