Clear Sky Science · pt

Percepção visual ultrarrápida além das capacidades humanas viabilizada por análise de movimento usando transistores sinápticos

Por que uma visão robótica mais rápida importa

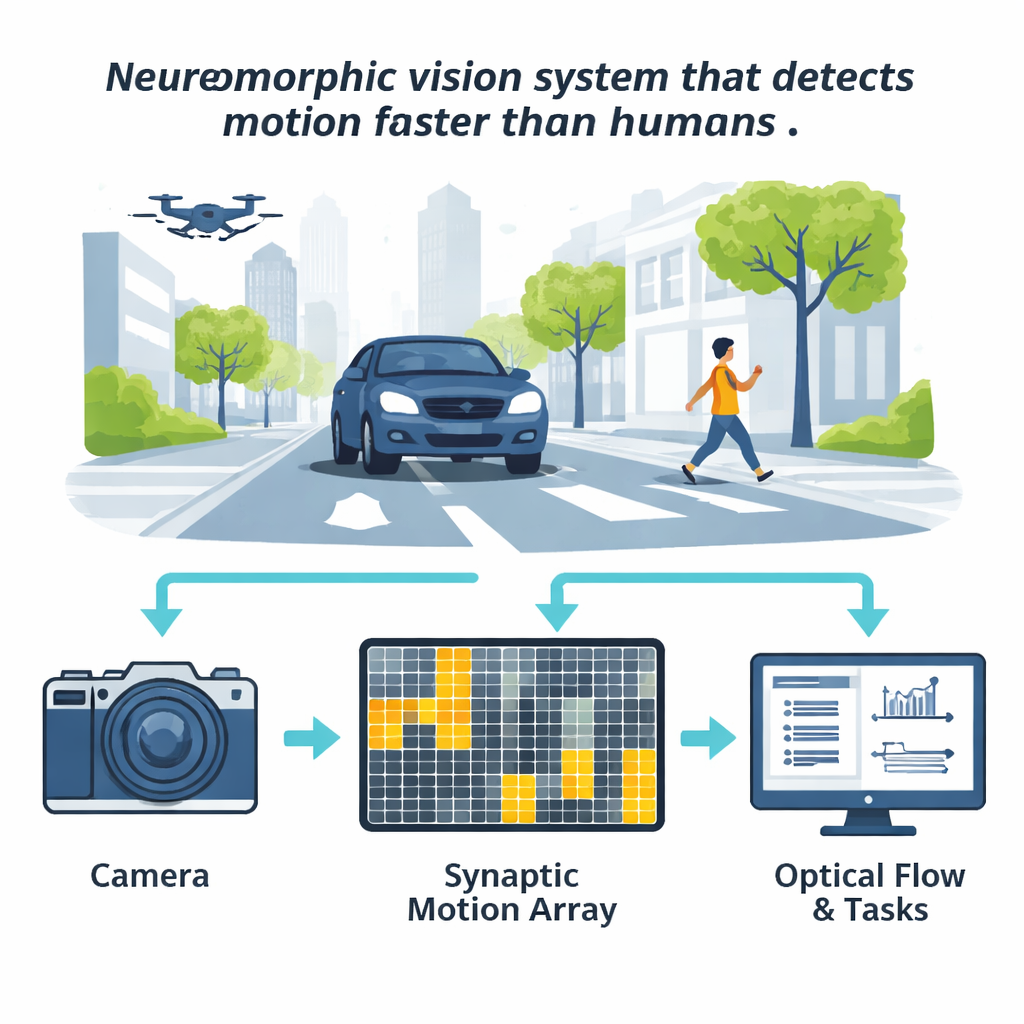

Quando o sistema de direção autônoma de um carro ou um drone reage mesmo uma fração de segundo tarde, as consequências podem ser sérias. Os melhores algoritmos de visão computacional atuais podem igualar ou superar humanos em testes padrão, mas ainda levam tempo demais para processar cada quadro de vídeo em tempo real. Este artigo apresenta um novo tipo de hardware de visão, inspirado no cérebro, que permite às máquinas detectar movimento muito mais rápido que os humanos, sem sacrificar a precisão.

Como normalmente ensinamos máquinas a ver o movimento

A análise de movimento convencional baseia-se em uma técnica chamada fluxo óptico, que estima como cada ponto de uma imagem se desloca de um quadro para o outro. Funciona bem, mas é computacionalmente pesada: para uma imagem em alta definição, uma placa gráfica potente pode precisar de mais de meio segundo para completar o processo. Em cenários de movimento rápido, como dirigir em rodovias, esse atraso pode se traduzir em dezenas de metros percorridos antes que o sistema reconheça um perigo. Ao contrário do sistema visual humano, que rapidamente foca nas partes mais relevantes de uma cena, os algoritmos padrão processam todos os pixels, inclusive regiões de fundo estáticas que pouco oferecem em termos de informação útil.

Tomando emprestado um truque dos estágios iniciais da visão no cérebro

A biologia resolve esse problema usando camadas de filtragem precoces no olho e no tálamo para destacar onde a mudança acontece e atenuar o restante. Os autores imitam essa ideia em silício construindo um módulo neuromórfico de “atenção temporal”. Uma câmera padrão ainda captura as imagens, mas as variações de brilho também são alimentadas em uma grade compacta de transistores sinápticos — dispositivos eletrônicos que se comportam de modo semelhante a conexões ajustáveis no cérebro. Cada dispositivo acumula localmente o quanto a luz em sua região designada mudou durante uma curta janela temporal. Trechos da grade que registram mudanças fortes se acendem como regiões de interesse, enquanto áreas mais calmas desvanecem para o fundo.

Transistores inteligentes que lembram movimento

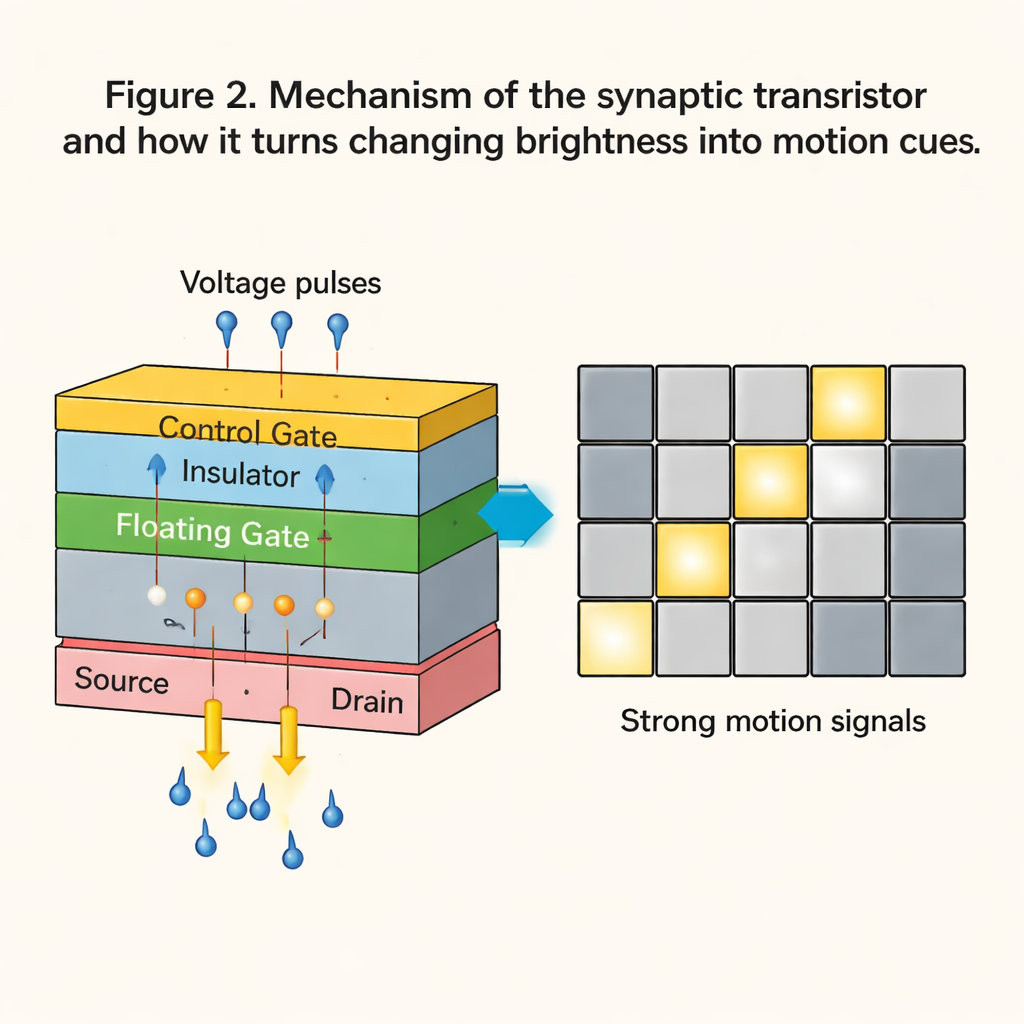

No cerne deste sistema está um transistor sináptico de porta flutuante especialmente projetado, construído a partir de materiais empilhados com espessura atômica. Aplicando pulsos de tensão breves, a condutância do dispositivo pode ser ajustada e então mantida por horas, armazenando efetivamente uma memória da atividade visual recente. Os transistores respondem em cerca de 100 microssegundos — rápido o suficiente para vídeo de alta velocidade — e suportam milhares de ciclos de atualização sem degradar. A equipe escalonou um único dispositivo para uma matriz 4×4 e mostrou como mudanças no brilho da câmera são convertidas em pulsos de tensão que impulsionam seletivamente algumas células para estados de alta condutância “de movimento”, enquanto suprimem cintilações e ruídos menores.

Focando o processamento pesado apenas onde interessa

A saída da matriz é transformada em um “mapa de calor” grosseiro do movimento que marca regiões compactas de interesse. Em vez de executar o custoso código de fluxo óptico na imagem inteira, o sistema analisa apenas essas áreas destacadas, com um pequeno contorno ao redor. Os autores demonstram que essa abordagem se conecta diretamente a vários métodos populares de fluxo óptico, desde algoritmos clássicos como Farneback até modelos modernos de aprendizado profundo como RAFT e GMFlow. Em testes envolvendo carros, drones, braços robóticos e esportes rápidos como tênis de mesa, a interface neuromórfica de frente rotineiramente reduz o tempo gasto na estimação de movimento e em tarefas subsequentes — como prever para onde um objeto se moverá, segmentar objetos em movimento do fundo ou rastrear um alvo — por cerca de um fator de quatro.

Superando a reação humana sem perder precisão

Crucialmente, essa aceleração não ocorre ao custo da confiabilidade. Ao fornecer informação adicional sobre onde o movimento é provável, os indícios temporais frequentemente melhoram a precisão, especialmente no rastreamento de objetos e na segmentação em cenas lotadas. Em cenários com veículos e pequenos drones, métricas de desempenho de tarefas mais que dobraram em comparação com pipelines convencionais, enquanto os tempos totais de processamento caíram para dezenas de milissegundos — comparáveis ou melhores que os tempos típicos de reação humana de cerca de 150 milissegundos. Os autores argumentam que essa interface neuromórfica de movimento pode ser combinada com muitos algoritmos de visão existentes, e mesmo com detectores de objetos além do fluxo óptico, para dar a robôs, veículos e máquinas interativas uma maneira muito mais rápida e focada de entender ambientes dinâmicos.

Citação: Wang, S., Zhao, J., Pu, T. et al. Ultrafast visual perception beyond human capabilities enabled by motion analysis using synaptic transistors. Nat Commun 17, 1215 (2026). https://doi.org/10.1038/s41467-026-68659-y

Palavras-chave: visão neuromórfica, fluxo óptico, transistores sinápticos, percepção robótica, condução autônoma