Clear Sky Science · pt

Computação analógica em memória para fatoração de matrizes não negativas

Por que dividir grandes dados em partes importa

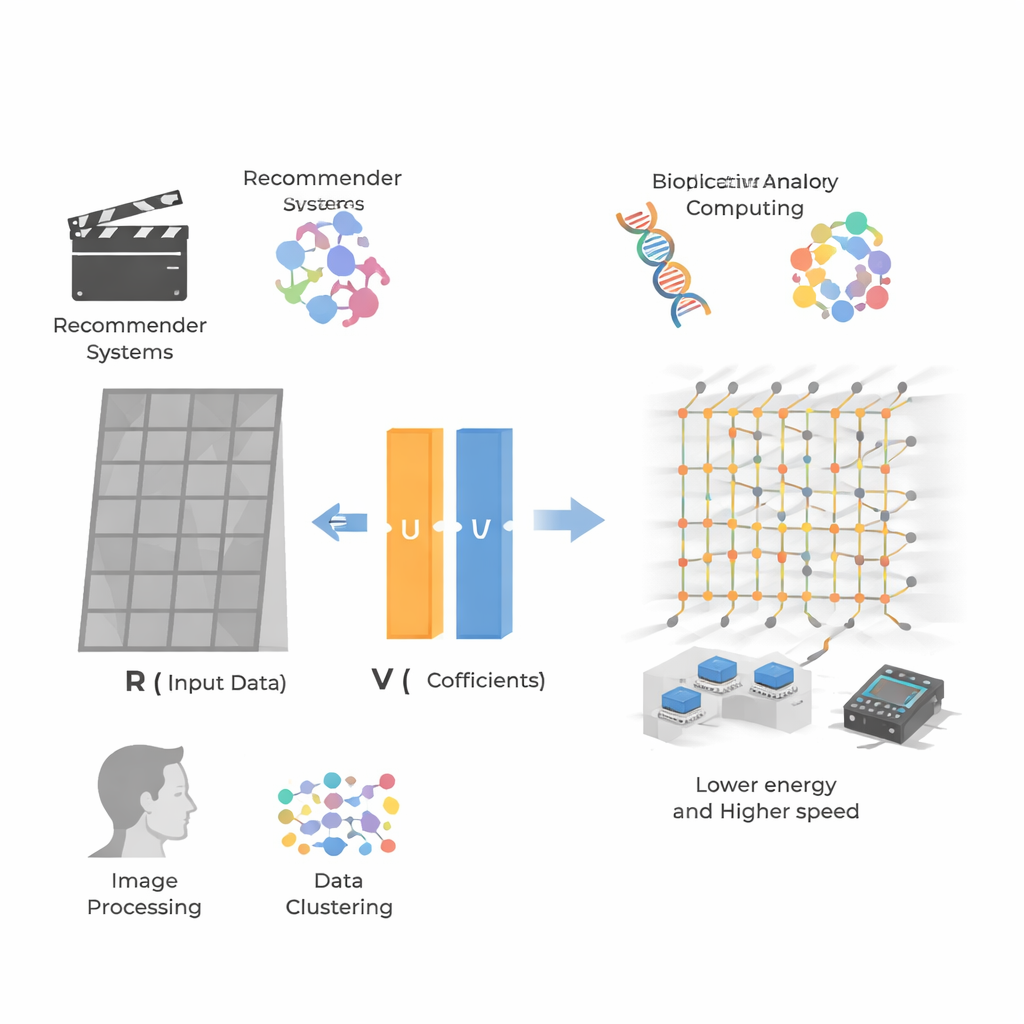

Serviços do dia a dia como recomendações de filmes, aplicativos de fotos e análises genéticas dependem de encontrar padrões ocultos em enormes tabelas de números. Uma maneira popular de fazer isso é a fatoração de matrizes não negativas (NMF), que decompõe uma grande tabela de dados em blocos construtivos mais simples e mais fáceis de interpretar. Mas à medida que conjuntos de dados crescem para milhões de usuários, itens ou pixels, os chips digitais atuais podem ter dificuldade para acompanhar em tempo real. Este artigo mostra como uma abordagem analógica, de computação em memória, pode realizar esse pesado trabalho matemático muito mais rápido e com muito menos energia, abrindo caminho para serviços de IA mais responsivos e eficientes.

Extraindo padrões de tabelas gigantes

No cerne do trabalho está a fatoração de matrizes não negativas (NMF), um método que pega uma grande grade de números não negativos — como avaliações de usuários para filmes ou valores de pixels de imagem — e a reescreve como o produto de duas grades menores. Uma grade representa "características" ocultas (por exemplo, a preferência de um usuário por ação versus romance) e a outra representa o quão fortemente cada item ou pixel manifesta essas características. Como todos os valores permanecem não negativos, essas características tendem a parecer partes intuitivas: componentes faciais em imagens ou perfis de preferência em dados de recomendação. Isso torna a NMF popular em sistemas de recomendação, bioinformática, processamento de imagens e clustering, mas também a torna computacionalmente exigente para conjuntos de dados muito grandes e esparsos.

Por que os chips digitais encontram um limite

Processadores tradicionais — CPUs, GPUs e até FPGAs — tratam operações matriciais como longas sequências de passos básicos, movendo dados para frente e para trás entre memória e unidades de computação. Para problemas modestos isso funciona bem, mas para conjuntos de dados modernos com milhões de linhas e colunas o custo em tempo e energia torna‑se enorme. O abrandamento da lei de Moore e o chamado gargalo de von Neumann, onde o acesso à memória domina o consumo de energia e o atraso, tornam cada vez mais difícil escalar a NMF para aplicações em tempo real, como recomendações ao vivo ou análise rápida de imagens. Mesmo algoritmos digitais inteligentes ainda enfrentam complexidade polinomial e alto tráfego de memória sempre que matrizes precisam ser atualizadas repetidamente.

Computando dentro da memória com sinais analógicos

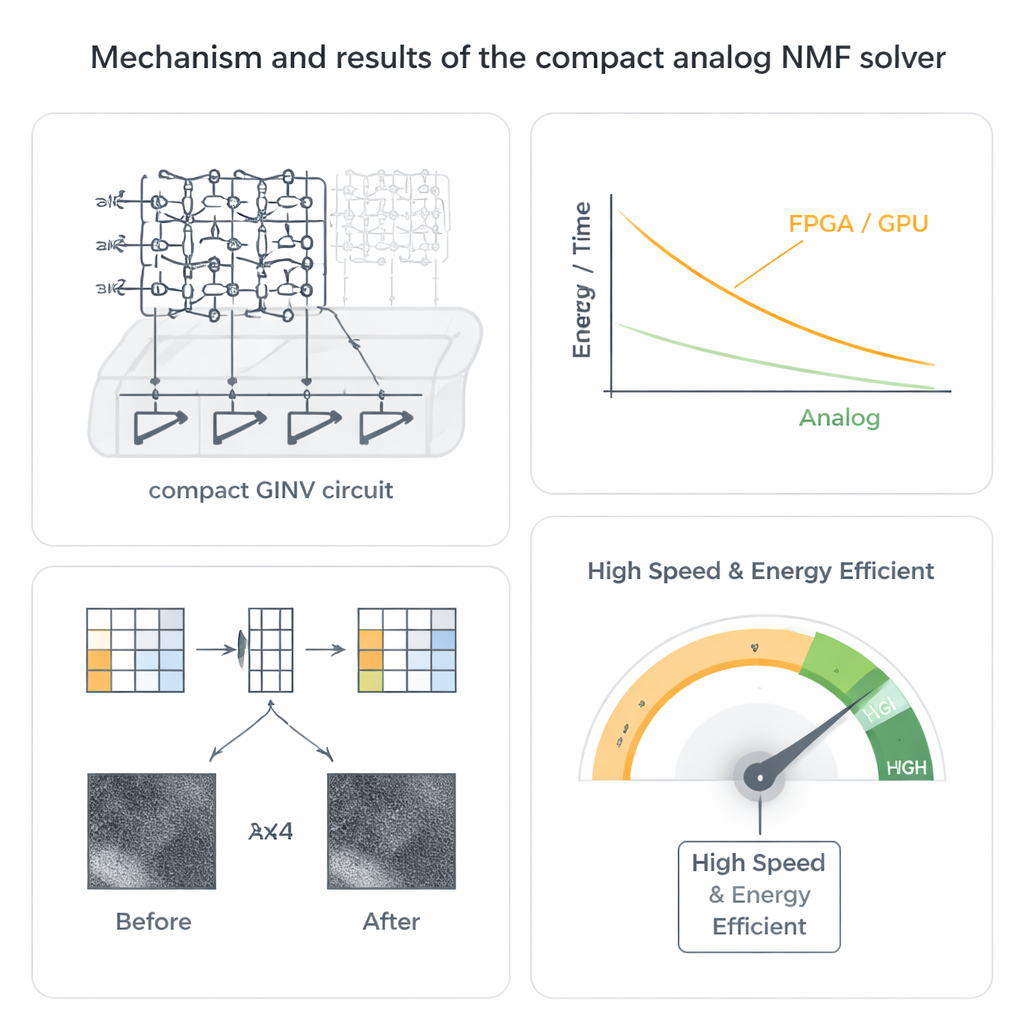

Os autores seguem uma rota diferente, usando computação matricial analógica baseada em dispositivos de memória resistiva conhecidos como memristores. Esses dispositivos podem ser dispostos em matrizes crossbar densas onde cada junção armazena um valor de condutância. Quando tensões são aplicadas em um lado da matriz, correntes que fluem para o outro lado realizam naturalmente muitas operações de multiplicação e soma em paralelo. Ao conectar essas matrizes em um loop fechado com um pequeno número de amplificadores operacionais, a equipe constrói um circuito inverso generalizado compacto (GINV) que resolve problemas inteiros de regressão essencialmente em um único passo analógico, em vez de muitas iterações digitais. Eles refinam o projeto com um esquema de compensação de condutância que mantém o circuito estável ao mesmo tempo em que reduz fortemente o número de amplificadores, economizando área do chip e energia.

Do truque matemático ao hardware funcional

Para tornar isso prático para NMF, os pesquisadores combinam seu circuito GINV compacto com uma estratégia bem conhecida chamada mínimos quadrados não negativos alternados. Em vez de tentar resolver ambas as matrizes fatoradas ao mesmo tempo — um problema não convexo e difícil — o método melhora alternadamente uma matriz enquanto mantém a outra fixa, dividindo a tarefa em uma cadeia de problemas de regressão não negativa mais simples que o circuito analógico pode resolver. Eles fabricam matrizes de memristores de óxido de háfnio e constroem uma placa de circuito impresso como plataforma, então demonstram duas aplicações chave. Para compressão de imagens, uma fotografia de nebulosa é dividida em pequenos patches que são fatorados, reduzindo o armazenamento pela metade enquanto reproduzem a imagem com apenas uma pequena perda na qualidade visual. Para sistemas de recomendação, eles fatoram dados de avaliação usuário–item como o conjunto MovieLens 100k, prevendo com precisão avaliações ausentes mesmo quando a matriz é extremamente esparsa.

Velocidade, eficiência e robustez no mundo real

Além da correção básica, o solver analógico mostra vantagens notáveis de velocidade e energia. Porque a corrente através do crossbar representa muitas operações realizadas ao mesmo tempo, o tempo para resolver um problema de regressão torna‑se quase independente do tamanho da matriz, em nítido contraste com métodos digitais. Estimativas em nível de sistema sugerem acelerações variando de centenas a milhares de vezes em relação a implementações avançadas em FPGA e GPU, juntamente com melhorias de várias ordens de magnitude na eficiência energética. Talvez surpreendentemente, a natureza analógica do hardware não é uma fraqueza, mas uma vantagem: o algoritmo NMF tolera naturalmente ruído dos dispositivos e erros de programação, e em simulações a qualidade final das imagens e recomendações permanece alta mesmo quando os valores dos memristores subjacentes são bastante imprecisos ou derivam com a temperatura.

O que isso significa para a tecnologia do dia a dia

Em termos simples, o estudo mostra que um novo tipo de "calculadora na memória" pode lidar com uma das ferramentas principais da ciência de dados moderna muito mais rápido e de forma mais eficiente que os chips digitais atuais. Ao incorporar a fatoração de matrizes diretamente em circuitos analógicos compactos, serviços como recomendações por streaming, ranqueamento de conteúdo personalizado e processamento de imagens no dispositivo poderiam, eventualmente, rodar em tempo real consumindo muito menos energia. O trabalho fornece tanto um roteiro de circuito quanto uma prova experimental de que essa computação analógica em memória pode enfrentar conjuntos de dados realistas com precisão próxima ao software de precisão total, apontando para um hardware futuro capaz de vasculhar fluxos massivos de dados com a mesma facilidade com que a luz atravessa o vidro.

Citação: Wang, S., Luo, Y., Zuo, P. et al. In-memory analog computing for non-negative matrix factorization. Nat Commun 17, 1881 (2026). https://doi.org/10.1038/s41467-026-68609-8

Palavras-chave: computação analógica em memória, fatoração de matrizes não negativas, crossbar de memristores, compressão de imagens, sistemas de recomendação