Clear Sky Science · pt

A memória em mosaico dos grandes modelos de linguagem

Por que cópias quase idênticas importam

Grandes modelos de linguagem como o ChatGPT aprendem com oceanos de texto e, às vezes, memorizam trechos desse texto. Isso levanta preocupações sobre privacidade, direitos autorais e sobre quão justamente podemos avaliar o que esses sistemas realmente sabem. Este artigo mostra que a memorização não se resume a copiar e colar exatamente. Em vez disso, os modelos podem reconstruir passagens a partir de muitas versões ligeiramente diferentes, muito parecido com montar um mosaico. Compreender esse tipo oculto de memória é crucial para quem se preocupa com IA segura e confiável.

Uma nova maneira de pensar sobre a memória da máquina

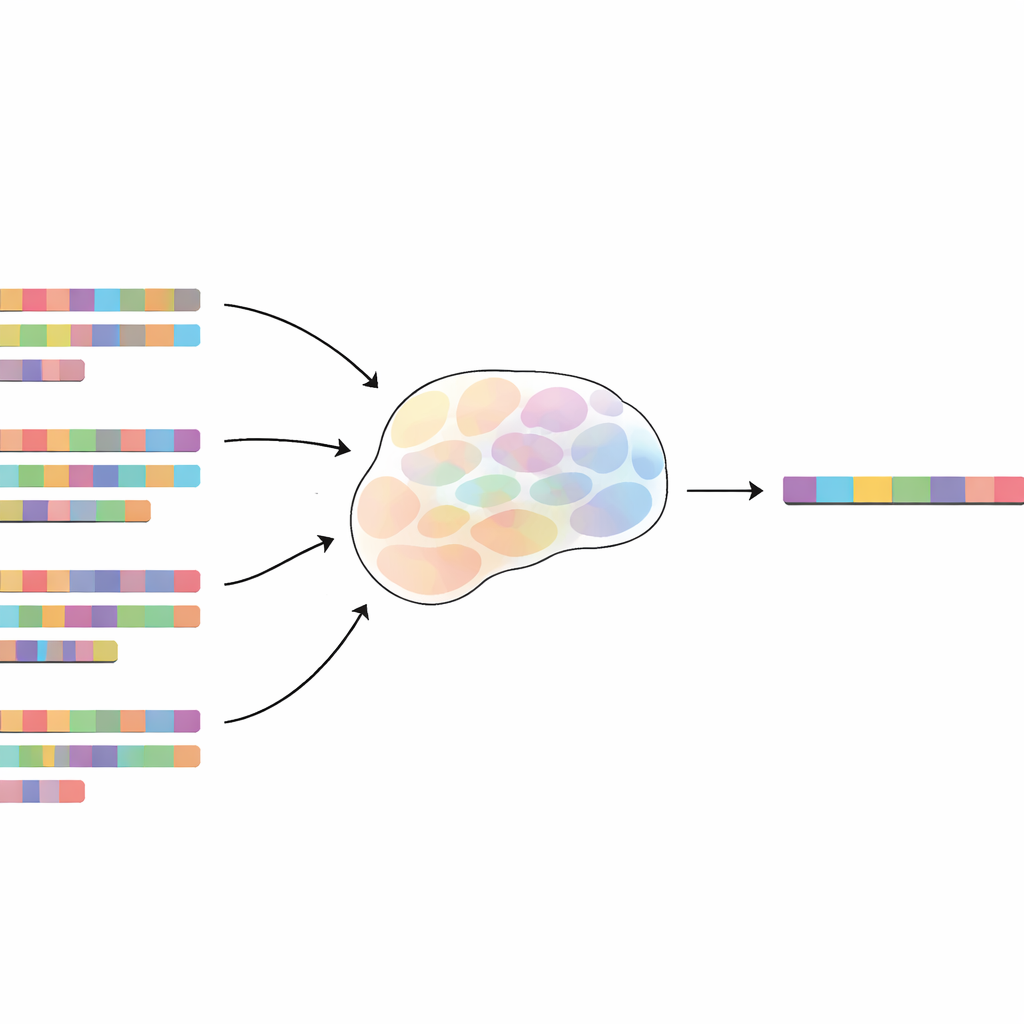

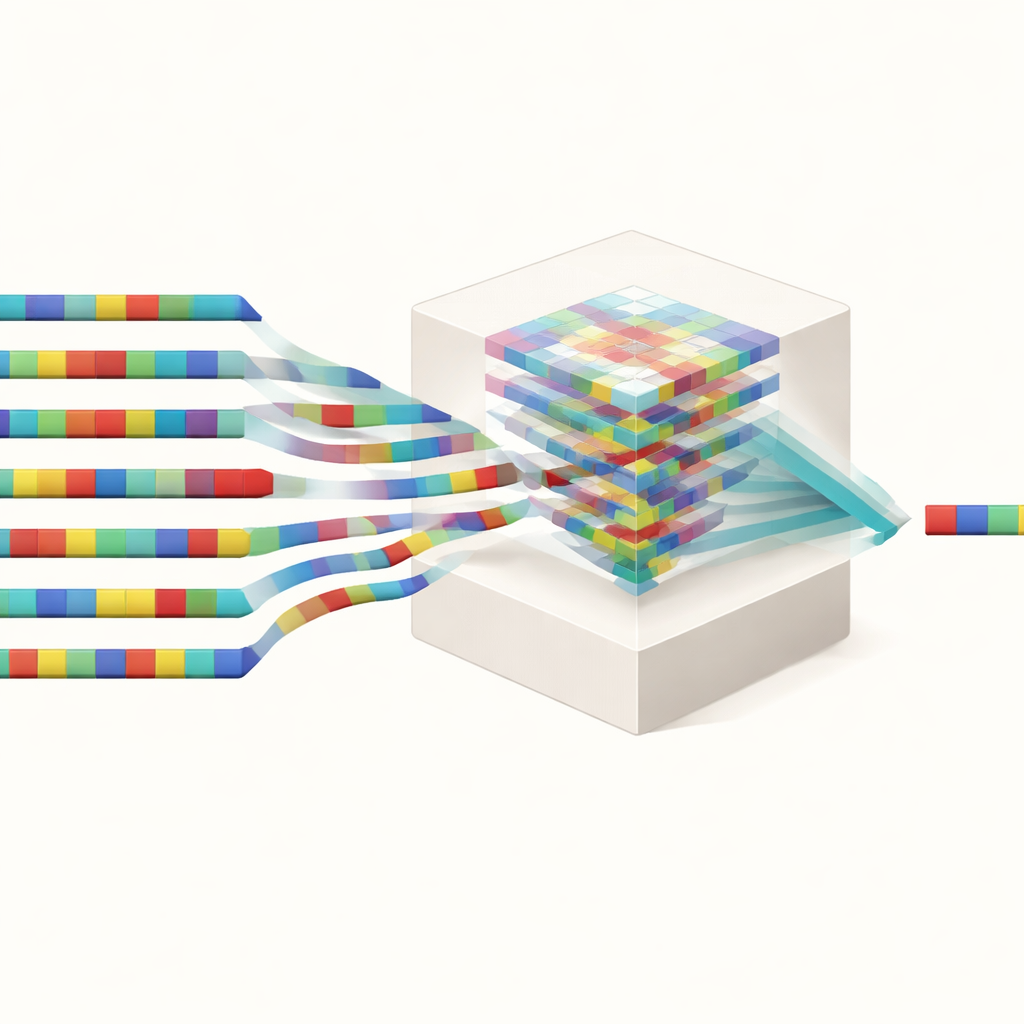

A maioria das pessoas supõe que um modelo de linguagem só memoriza algo se vir a mesma frase idêntica repetidas vezes. Os autores desafiam essa visão ao introduzir a “memória em mosaico”. Nessa perspectiva, um modelo pode memorizar uma passagem de 100 palavras não apenas por repetições exatas, mas também por muitas duplicatas imprecisas—versões em que algumas palavras faltam, são trocadas ou embaralhadas. Para estudar isso cuidadosamente, eles plantam frases de teste artificiais, chamadas canários, nos dados de treinamento do modelo, juntamente com muitas versões alteradas. Após o treinamento, medem quão fácil é determinar se um canário específico esteve no conjunto de treinamento, usando um tipo de teste de privacidade chamado ataque de inferência de membro.

Como cópias imprecisas ainda deixam um traço claro

Ao comparar duplicatas imprecisas com repetições exatas, os pesquisadores definem um “equivalente de duplicata exata”: quanto uma cópia imprecisa contribui para a memorização em comparação com uma cópia perfeita. Eles descobrem que até mudanças muito leves mal enfraquecem a memorização. Se apenas cerca de 10% das palavras em cada duplicata forem substituídas aleatoriamente, uma única cópia imprecisa ainda contribui com aproximadamente 60–65% do efeito de uma duplicata exata. Mesmo quando metade das palavras é alterada, cada versão modificada ainda conta por cerca de 15–20% de uma cópia completa. O efeito é robusto: adicionar palavras de preenchimento aleatórias entre frases-chave ou embaralhar trechos da sentença reduz a memorização, mas não a elimina. O modelo parece capaz de ignorar ruído, focar em fragmentos sobrepostos e costurá-los de volta.

Forma mais que significado no que os modelos armazenam

Dado que modelos modernos podem resolver problemas de matemática, seguir instruções e traduzir entre idiomas, pode-se esperar que suas memórias sejam sobre significado. Surpreendentemente, o estudo encontra o oposto. Quando os autores substituem palavras por alternativas que preservam o significado da frase, a memorização melhora apenas ligeiramente em comparação com substituí‑las por palavras aleatórias. Paráfrases geradas por outros sistemas de IA—que preservam a mesma ideia, mas mudam muitos detalhes superficiais—contribuem relativamente pouco para a memorização, a menos que ainda compartilhem muitas sequências curtas de tokens com a passagem original. Em uma variedade de testes, o que realmente impulsiona a memória é a sobreposição nos tokens exatos (as peças básicas de palavras do modelo), não ideias compartilhadas. Em outras palavras, a memória em mosaico do modelo é principalmente sobre forma, não significado.

Duplicatas ocultas em dados de treinamento do mundo real

Os autores então investigam quão comuns são duplicatas imprecisas em um conjunto de dados web popular e fortemente limpo usado para treinar modelos, conhecido como SlimPajama. Mesmo que esse conjunto já tenha removido documentos quase idênticos, a equipe encontra que muitas sequências de 100 tokens que aparecem exatamente 1.000 vezes também têm milhares de versões quase idênticas. Para pequenas distâncias de edição—cerca de 10% dos caracteres alterados—há, em média, cerca de 4 vezes mais duplicatas imprecisas do que exatas, e dezenas de milhares a mais em distâncias maiores, mas ainda influentes. Importante: técnicas padrão de “desduplicação” usadas na indústria, que tipicamente removem apenas grandes sobreposições exatas, deixam a maior parte dessas cópias imprecisas intactas. Isso significa que modelos ainda podem memorizar material sensível ou protegido por direitos autorais ao montá‑lo a partir de muitas fontes ligeiramente alteradas.

Por que isso importa para privacidade, justiça e controle

Essas descobertas têm implicações de amplo alcance. Para a privacidade, mostram que simplesmente remover repetições exatas dos dados de treinamento não é suficiente: informações pessoais ou confidenciais podem ser memorizadas por famílias de passagens similares. Para direitos autorais e avaliação de benchmarks, duplicatas imprecisas podem fazer com que modelos reproduzam textos protegidos ou aumentem artificialmente pontuações em testes que eles, na prática, viram em forma disfarçada. Para esforços de “desaprendizado” de dados específicos, não basta deletar um exemplo ofensivo se muitas variantes permanecerem. De modo geral, o trabalho revela que a memória dos modelos de linguagem é um mosaico complexo construído a partir de muitas pequenas sobreposições, desafiando as ferramentas de segurança atuais e exigindo formas mais inteligentes e refinadas de limpar e auditar dados de treinamento.

Citação: Shilov, I., Meeus, M. & de Montjoye, YA. The mosaic memory of large language models. Nat Commun 17, 2142 (2026). https://doi.org/10.1038/s41467-026-68603-0

Palavras-chave: memorização de modelos de linguagem, duplicatas imprecisas, privacidade de dados, desduplicação de dados de treinamento, contaminação de benchmark