Clear Sky Science · pt

Aprendizado online com memória linear e independente do modelo em redes neurais de spikes

Por que treinar computadores estilo cérebro é tão difícil

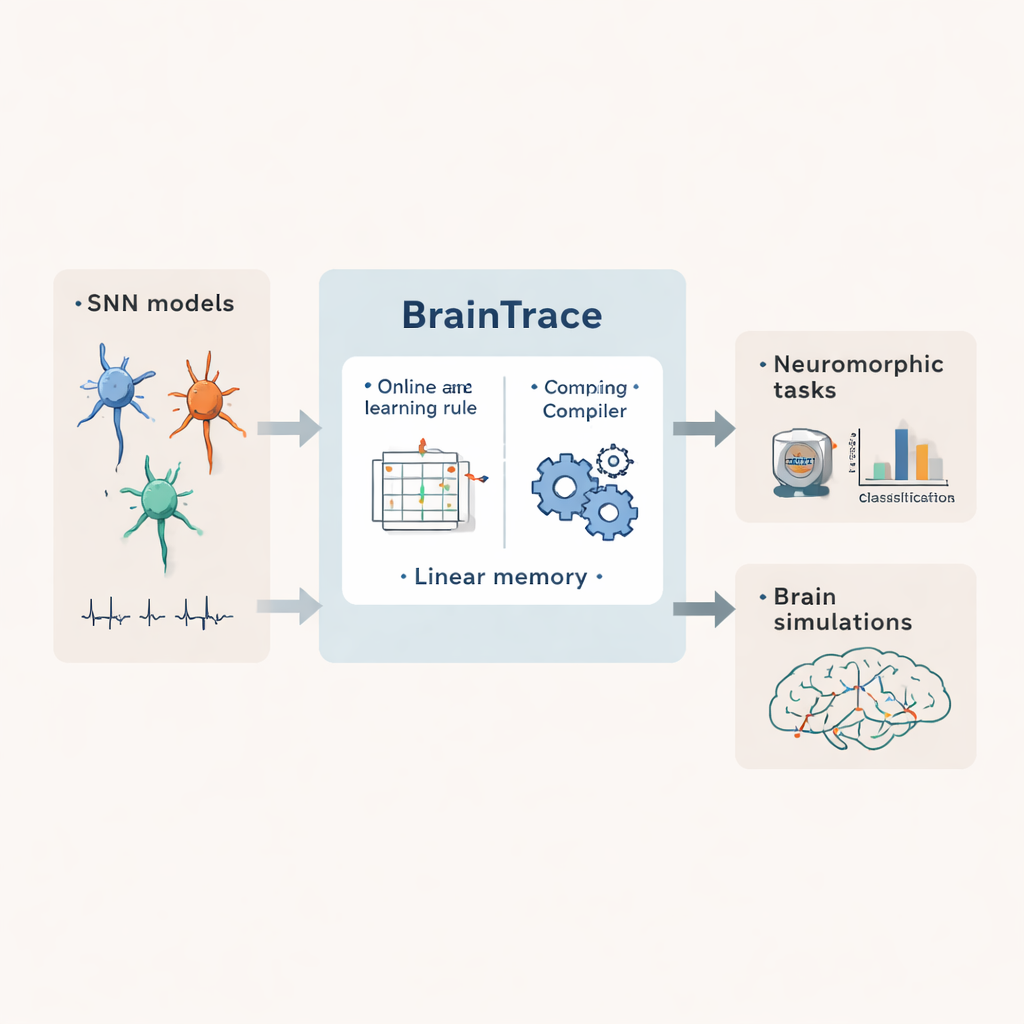

Redes neurais de spikes são uma classe de redes artificiais que comunicam usando pulsos elétricos breves, muito parecidos com as células cerebrais reais. Elas prometem computação ultra‑eficiente inspirada no cérebro e simulações mais realistas de circuitos neurais. Mas ensinar essas redes a executar tarefas complexas, especialmente ao longo de longos períodos, costuma exigir enormes quantidades de memória de computador e código artesanal. Este artigo apresenta o BrainTrace, um sistema projetado para tornar o treinamento de redes de spikes prático e amplamente utilizável.

Ensinando redes que aprendem em tempo real

A maioria dos métodos de treinamento mais potentes para redes estilo cérebro funciona reproduzindo toda a sequência de atividade e propagando sinais de erro para trás através de cada passo temporal. Essa abordagem, conhecida como backpropagation through time, pode ser muito precisa, mas rapidamente encontra problemas quando as sequências são longas ou as redes são grandes: cada estado intermediário precisa ser armazenado, levando a um crescimento de memória que escala com o tempo e com o tamanho da rede. Métodos “online” alternativos atualizam as conexões passo a passo enquanto os dados chegam, o que reduz muito as necessidades de armazenamento. Contudo, regras online existentes ou funcionam apenas para modelos de neurônio muito simplificados ou ainda exigem memória cujo crescimento é quadrático em relação ao tamanho da rede, tornando difícil sua aplicação a sistemas realistas em escala cerebral.

Uma receita geral para muitos tipos de redes de spikes

O BrainTrace aborda isso descrevendo primeiro as redes de spikes de forma unificada. Os autores mostram que muitos tipos de neurônios e sinapses podem ser expressos como duas partes interagentes: dinâmicas internas que descrevem como o estado de cada neurônio muda ao longo do tempo, e dinâmicas de interação que transformam spikes de entrada em correntes que fluem entre as células. Eles ainda introduzem dois pontos de vista de modelagem, chamados AlignPre e AlignPost, que organizam as sinapses em torno do neurônio emissor ou do neurônio receptor. Essa abstração permite que uma grande variedade de modelos biológicos e projetados seja tratada com a mesma maquinaria matemática, desde neurônios leaky simples até células mais ricas com limiares adaptativos e sinapses complexas.

Uma forma econômica de memória para acompanhar causa e efeito

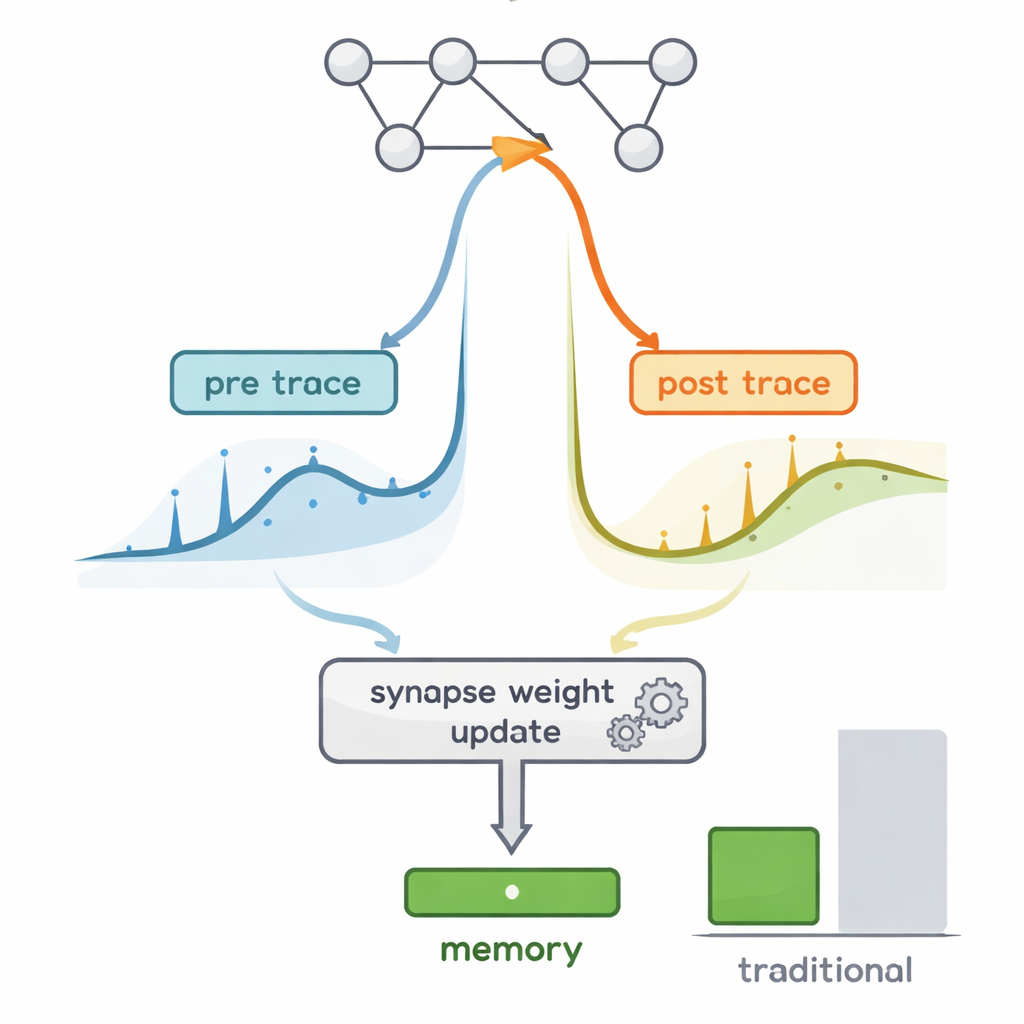

O desafio central no aprendizado online é rastrear como pequenas mudanças em cada conexão viriam a afetar o comportamento da rede, uma quantidade capturada pelas chamadas “trilhas de elegibilidade”. Em princípio, manter a informação completa de elegibilidade exige rastrear matrizes vastas que escalam com o cubo do número de neurônios. O BrainTrace explora três propriedades-chave das redes de spikes: a maioria dos neurônios fica inativa a maior parte do tempo; o decaimento (leak) e o reset do próprio neurônio dominam como seu estado muda; e spikes e condutâncias sinápticas são sempre positivas. Usando esses fatos, os autores mostram que as pesadas matrizes de elegibilidade podem ser aproximadas de forma estreita pelo produto de apenas duas trilhas compactas por sinapse, uma resumindo a atividade pré‑sináptica e outra a atividade pós‑sináptica. Essa regra de propagação pré‑pós, batizada de pp‑prop, usa memória que cresce apenas de forma linear com o tamanho da rede, ao mesmo tempo em que produz gradientes alinhados com os do backpropagaton completo.

Ferramentas automáticas que escondem a matemática

Além da própria regra de aprendizagem, o BrainTrace fornece um compilador que desempenha um papel semelhante ao das bibliotecas de diferenciação automática em deep learning. O usuário descreve as dinâmicas de seu modelo de spikes em uma linguagem de alto nível. O compilador do BrainTrace então analisa como estados e parâmetros estão conectados, constrói as trilhas de elegibilidade necessárias e gera código otimizado que executa o pp‑prop ou um algoritmo relacionado de forma eficiente em CPUs, GPUs ou aceleradores especializados. Isso significa que modeladores podem se concentrar em questões científicas em vez de implementar manualmente código de gradiente delicado, enquanto ainda se beneficiam de aprendizado online e eficiente em memória.

De sensores minúsculos a um cérebro inteiro de mosca

Os autores testam o BrainTrace em benchmarks neuromórficos padrão, onde redes de spikes classificam versões baseadas em eventos de imagens, sons e gestos. Em vários conjuntos de dados e arquiteturas, o pp‑prop iguala a acurácia do backpropagation completo usando ordens de magnitude a menos memória e rodando mais rápido que outros métodos online. Crucialmente, o sistema também escala para problemas exigentes da neurociência. Em um exemplo, uma rede de spikes biologicamente detalhada com populações excitatórias e inibitórias separadas aprende uma tarefa de acumulação de evidências e desenvolve padrões de atividade semelhantes aos registrados no córtex de camundongos. Em outro, um modelo de spikes com mais de 125.000 neurônios, conectado segundo o conectoma da mosca‑da‑fruta, é treinado para reproduzir atividade em estado de repouso registrada em todo o cérebro da mosca — um feito que excede a capacidade de memória do treinamento convencional em uma única placa de vídeo.

O que isso significa para a computação estilo cérebro no futuro

Para não especialistas, a mensagem principal é que o BrainTrace transforma um sonho antes impraticável — treinar redes ricas de spikes em escala cerebral em tempo real — em uma possibilidade realista. Ao encontrar uma maneira engenhosa de acompanhar causa e efeito com uma quantidade pequena de memória, e ao embalar isso em ferramentas automatizadas, o trabalho aproxima a computação inspirada no cérebro do uso cotidiano tanto na inteligência artificial quanto na neurociência básica. Sugere um caminho para máquinas que aprendem e se adaptam com a eficiência e a precisão temporal dos sistemas nervosos reais, sem exigir recursos no nível de supercomputadores.

Citação: Wang, C., Dong, X., Ji, Z. et al. Model-agnostic linear-memory online learning in spiking neural networks. Nat Commun 17, 1745 (2026). https://doi.org/10.1038/s41467-026-68453-w

Palavras-chave: redes neurais de spikes, aprendizado online, computação neuromórfica, simulação cerebral, treinamento baseado em gradiente