Clear Sky Science · pt

Reconhecimento de feições em perfis de MEV em DRIE orientado por IA baseado em autoencoder variacional com restrição física

Chips mais nítidos por meio de imagens mais inteligentes

Cada smartphone, sensor de airbag automotivo e microagulha médica depende de pequenas estruturas tridimensionais gravadas profundamente no silício. Fabricar essas feições limpas, lisas e repetíveis é difícil — e verificar sua qualidade em um microscópio eletrônico é ainda mais desafiador. Este artigo apresenta uma nova ferramenta de inteligência artificial capaz de interpretar automaticamente essas imagens microscópicas com muito mais precisão do que humanos, prometendo uma produção de microdispositivos avançados mais rápida, barata e confiável.

Por que gravar sulcos profundos e minúsculos é tão complicado

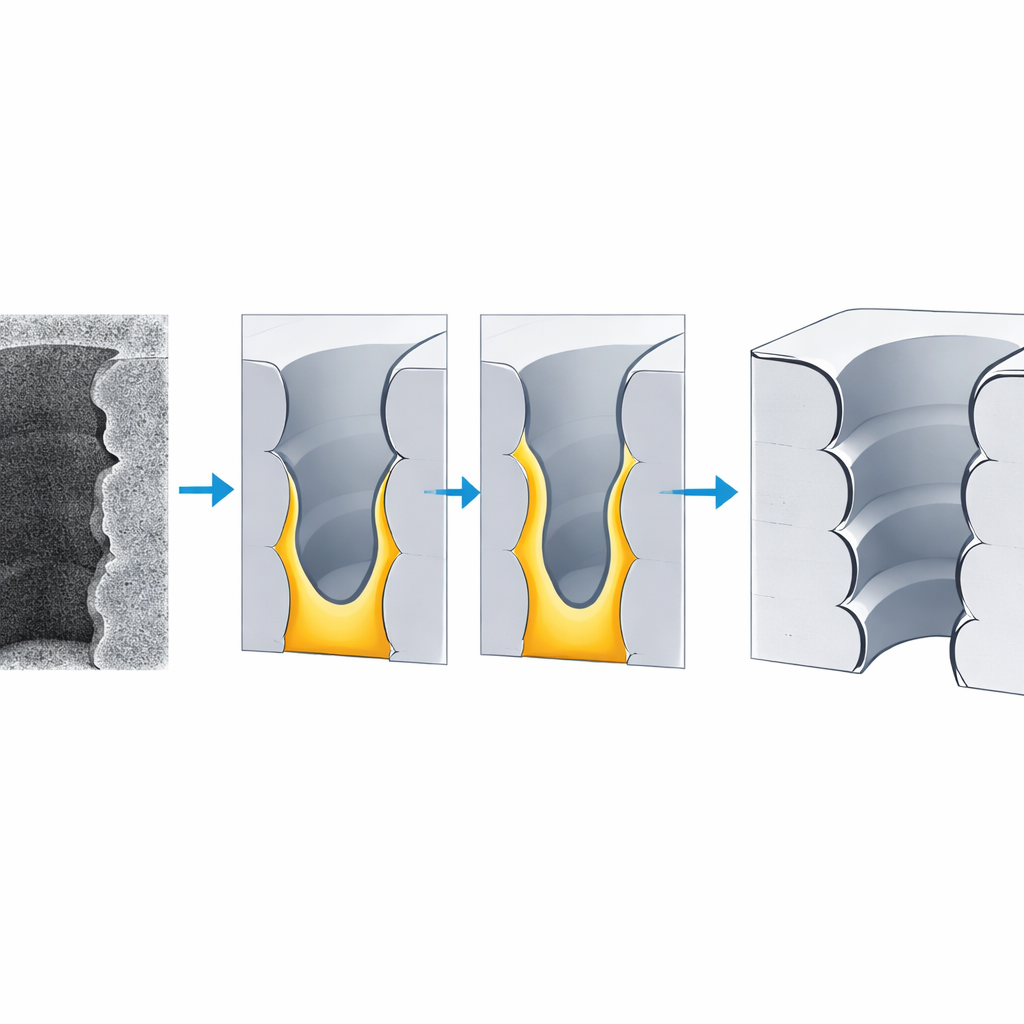

Sistemas microeletromecânicos modernos (MEMS) dependem de valas profundas e estreitas gravadas no silício usando um processo chamado deep reactive ion etching (DRIE). Os engenheiros desejam paredes quase perfeitamente verticais e lisas, mas na prática as laterais desenvolvem ondulações, protuberâncias e outras distorções conforme o plasma alterna entre ciclos de gravação e de deposição. Pequenas variações no tempo, no fluxo de gás, na temperatura ou no desgaste da ferramenta podem transformar uma receita boa em ruim, e essas mudanças aparecem como diferenças sutis no perfil da vala que só são visíveis em seções transversais por microscopia eletrônica de varredura (MEV).

O gargalo da leitura humana de imagens

Hoje, avaliar essas estruturas gravadas é em grande parte um ofício manual. Engenheiros fatiam wafers, capturam centenas de imagens de MEV e então traçam bordas e medem profundidades e larguras no computador de forma meticulosa. Cada imagem pode levar uma hora ou mais para ser analisada, e pessoas diferentes frequentemente discordam em 15–20% sobre a mesma feição. Métodos automáticos simples e ferramentas de aprendizado de máquina anteriores, como redes neurais convencionais, podem acelerar o processo, mas têm dificuldades com as imagens ruidosas e de baixo contraste típicas de valas profundas e muitas vezes deixam de captar como a estrutura muda com a profundidade. Como resultado, a análise de imagens tornou-se um sério gargalo para a manufatura de alto rendimento e para o uso da IA para otimizar o próprio processo de gravação.

Uma IA que respeita a física

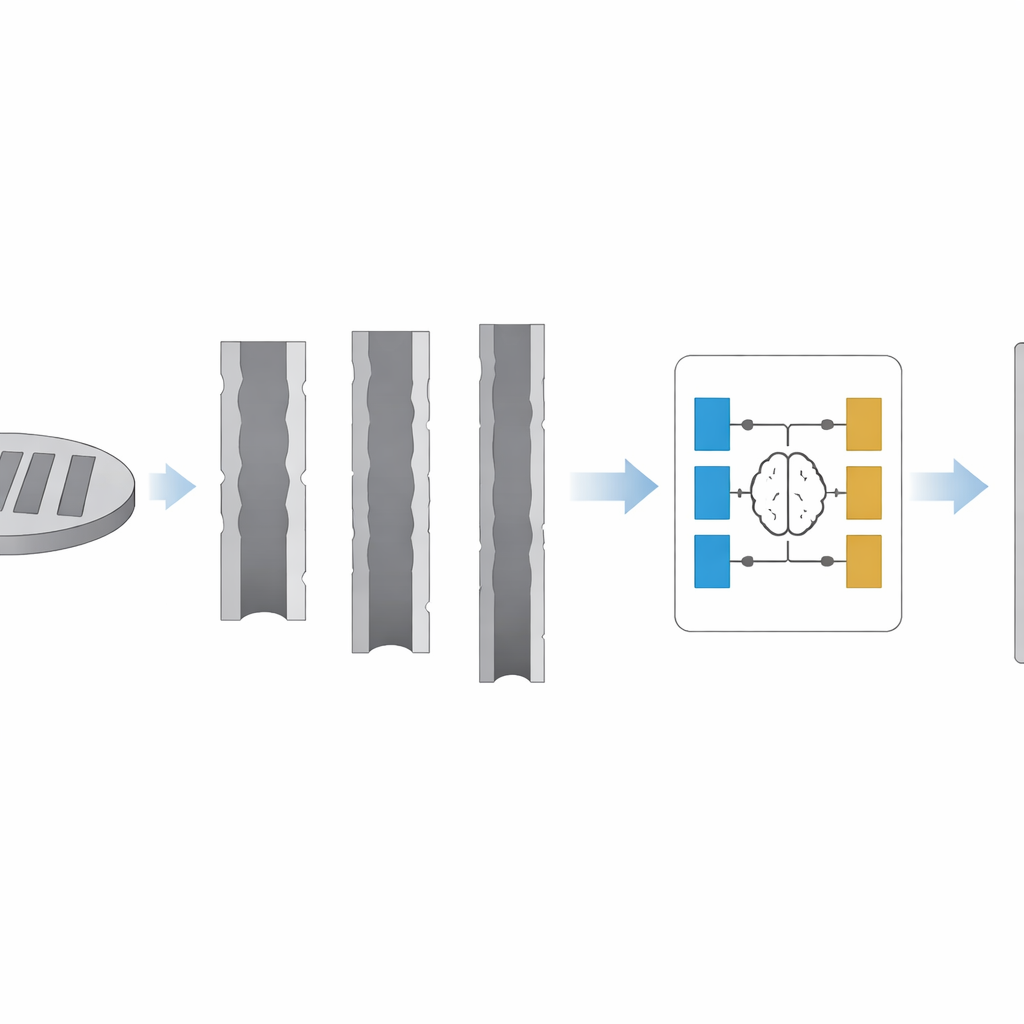

Os autores propõem uma nova abordagem chamada autoencoder variacional de nível de conjunto com restrição física, ou VLSet‑AE. No cerne desse sistema de IA, ele “comprime” uma imagem de MEV em um código interno compacto e então “reconstrói” a forma da vala a partir desse código. Em vez de tratar a borda da vala apenas como um conjunto de pixels brilhantes, modela-se a fronteira como uma interface em movimento que cresce até encontrar o material real, semelhantemente a uma bolha em expansão que para ao atingir as paredes. O movimento dessa interface é guiado por equações que descrevem como uma superfície gravada deve realmente evoluir no tempo, de modo que a IA é orientada não somente pelos dados, mas também pela física conhecida do processo de gravação.

Vendo a vala inteira no espaço e no tempo

Para treinar e testar o sistema, a equipe projetou um conjunto cuidadoso de 16 receitas de gravação, variou os tempos de ciclo chave que controlam quanto tempo o plasma grava e quanto tempo protege, e coletou 1.000 imagens de seções transversais por MEV. Cada imagem de vala foi dividida em muitas camadas finas ao longo de sua profundidade, cada uma representando um ciclo de gravação e deposição. O VLSet‑AE acompanha como o contorno evolui camada por camada e então costura essas fatias de volta em uma visão tridimensional completa. A partir disso, calcula automaticamente nove medidas cruciais: a profundidade e a largura das ondulações na parede, o raio local de curvatura, o quão vertical é o perfil, e a largura da vala no topo, meio e fundo, juntamente com a profundidade total e a curvatura das paredes.

Mais rápido, mais preciso e pronto para a fábrica

Quando comparado com medições humanas e outros sete modelos populares de IA, o VLSet‑AE sai na frente. Em média, ele discorda das medições manuais por apenas cerca de 3,7% — melhor que a variação entre humanos — e alcança uma acurácia geral de reconhecimento em torno de 94–96%. Também é eficiente: treinar com o conjunto completo leva na ordem de dezenas de segundos, e analisar uma nova imagem leva cerca de um segundo. Mesmo quando testado com menos imagens de treinamento, sua precisão se degrada apenas ligeiramente, mostrando que ele pode lidar com dados limitados — uma situação comum na manufatura de ponta.

O que isso significa para a tecnologia do dia a dia

Em termos simples, este trabalho transforma a inspeção por MEV de uma tarefa artesanal em algo industrial. Ao ler automática e de forma confiável detalhes estruturais finos de imagens ruidosas de microscópio, o VLSet‑AE torna prático coletar os enormes volumes de dados necessários para permitir que a IA ajuste e monitore receitas de gravação em tempo real. Isso, por sua vez, pode levar a valas mais lisas, sensores mais precisos e chips mais consistentes, todos produzidos com menos tentativa e erro e com menor custo. O método também oferece um roteiro geral para combinar física e aprendizado de máquina para entender outras etapas complexas de manufatura, apontando para um futuro em que micro e nano dispositivos são projetados e aperfeiçoados por fábricas integradas e dirigidas por IA.

Citação: Wang, F., Yu, H., Miao, Y. et al. AI-driven feature recognition of SEM profiles in deep reactive ion etching based on physics-constrained variational autoencoder. Microsyst Nanoeng 12, 82 (2026). https://doi.org/10.1038/s41378-025-01105-z

Palavras-chave: deep reactive ion etching, microscopia eletrônica de varredura, IA informada pela física, autoencoder variacional, microfabricação