Clear Sky Science · pt

Computação em memória óptica em espaço livre de alta taxa de clock

Por que isso importa para a tecnologia inteligente do dia a dia

De carros autônomos e drones de entrega a negociações de alta velocidade e cirurgia remota, cada vez mais decisões precisam ser tomadas em frações de segundo, muitas vezes longe de grandes centros de dados. A eletrônica atual tem dificuldade para acompanhar sem superaquecer ou esgotar baterias. Este artigo apresenta um novo tipo de motor de cálculo baseado em luz que pode executar tarefas cruciais de inteligência artificial com extrema rapidez e baixo consumo de energia, com potencial para transformar o funcionamento de dispositivos inteligentes na “ponta” da rede.

Transformando luz em calculadora

A IA moderna depende fortemente de uma operação básica: multiplicar e somar grandes grades de números, algo semelhante a deslizar repetidamente um pequeno estêncil sobre uma imagem e contabilizar o que aparece. Fazer isso com elétrons em chips é potente, mas ineficiente, porque os dados precisam ser continuamente movimentados entre memória e processadores. Os pesquisadores, em vez disso, constroem um sistema chamado FAST‑ONN que permite que a luz realize grande parte do trabalho no ar. Eles usam minúsculos lasers semicondutores dispostos em uma grade ordenada para codificar pixels de imagem como intensidade luminosa e deixam esses feixes percorrerem componentes ópticos que aplicam os “pesos” de uma rede neural diretamente no espaço, antes de atingirem sensores de luz que transformam os resultados novamente em sinais elétricos.

Como o motor óptico é construído

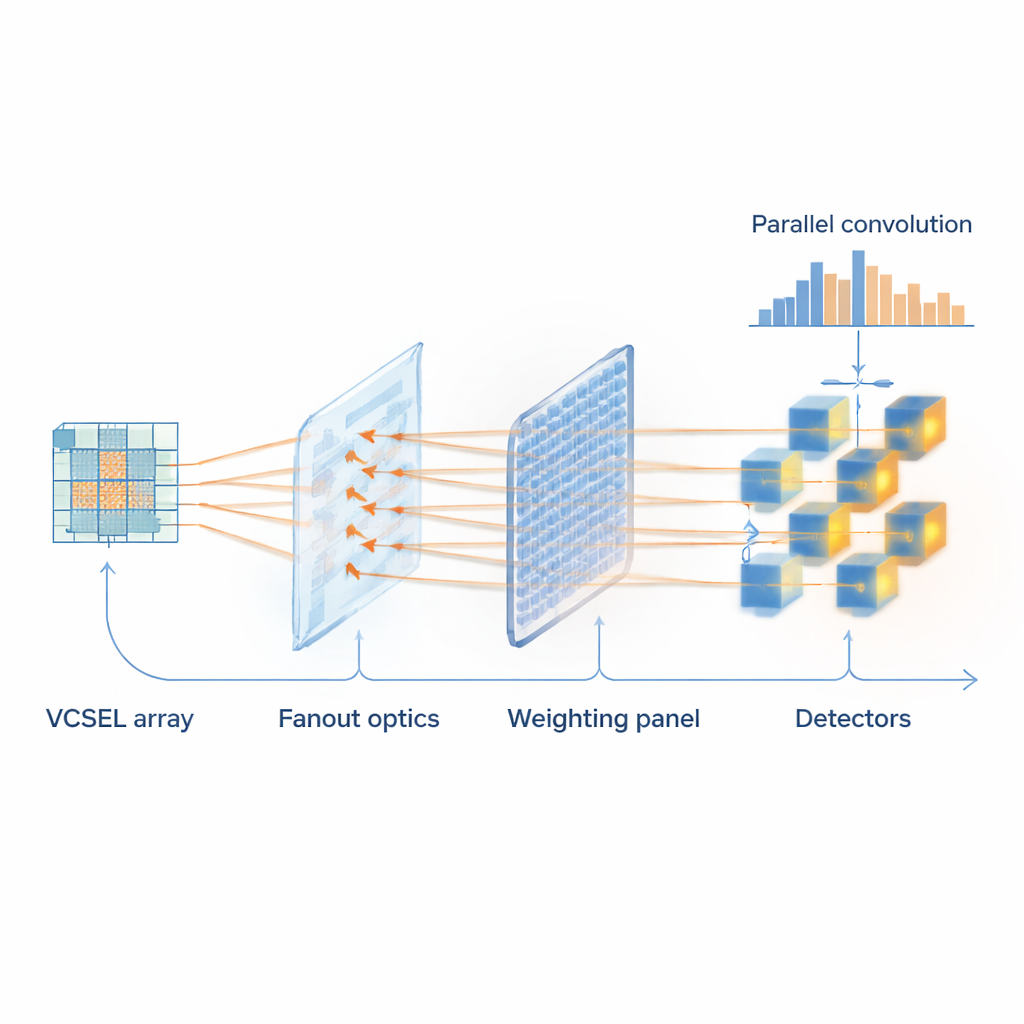

No coração do sistema está uma matriz densa de lasers microscópicos conhecidos como VCSELs (vertical‑cavity surface‑emitting lasers). Cada dispositivo em uma grade 5×5 representa um pixel de um pequeno trecho de imagem e pode ser comutado em velocidades de gigahertz — bilhões de vezes por segundo. Um elemento de vidro com padrão divide essa grade de feixes em várias cópias, de modo que o mesmo trecho possa ser processado em paralelo por vários filtros diferentes. Um modulador espacial de luz programável, semelhante em espírito a um display de alta resolução, atua como armazenamento em memória para os valores dos filtros: seus milhões de pequenos pixels atenuam ou deixam passar a luz para representar um peso de rede neural. Em seguida, os feixes convergem para detectores acoplados a fibras que somam a luz para cada filtro, efetivamente completando um lote de operações de convolução em uma etapa óptica.

Lidando com “pensamentos” positivos e negativos

Modelos de IA não precisam apenas reforçar certos padrões; eles também devem suprimir outros, o que exige pesos positivos e negativos. Como a intensidade da luz naturalmente nunca é negativa, isso é um desafio antigo para computação puramente óptica. Os autores resolvem isso dividindo a luz em um caminho de sinal que carrega os feixes ponderados e um caminho de referência que fica sem ponderação. Ambos são alimentados em detectores emparelhados especiais que subtraem um do outro, de modo que menos luz pode representar uma contribuição negativa. Essa leitura diferencial engenhosa permite que o hardware óptico imite o comportamento completo das redes neurais padrão enquanto se mantém robusto ao ruído e a pequenas imperfeições nos dispositivos.

Colocando o sistema à prova

Para mostrar que o FAST‑ONN não é apenas uma demonstração de física, a equipe o conecta a tarefas reais de reconhecimento. Eles ligam o motor óptico a uma rede de visão padrão treinada no conjunto de imagens COCO, amplamente usado para testar detecção de objetos. Em um experimento que espelha um cenário de carro autônomo, regiões recortadas de cenas de tráfego são analisadas para decidir se cada uma contém um veículo. A camada de convolução mais exigente é deslocada para o hardware óptico, enquanto as etapas restantes são executadas digitalmente. As versões óptica e puramente eletrônica do modelo concordam de perto, alcançando desempenho quase idêntico ao distinguir carros do fundo. Eles também demonstram classificação de dígitos manuscritos e de roupas, e até realizam treinamento onde o sistema óptico computa as passagens à frente enquanto um computador atualiza os pesos, que são então recarregados no modulador de luz.

Velocidade, eficiência e o que vem a seguir

Em sua forma atual, o protótipo processa 100 milhões de pequenos trechos de imagem por segundo usando lasers 5×5 e nove filtros ao mesmo tempo, já alcançando quase um bilhão de operações de convolução por segundo com tempos de decisão na escala de microssegundos. Análises detalhadas sugerem que, usando matrizes maiores e lasers comerciais mais rápidos, essa abordagem poderia ser escalada para executar dezenas de milhares de trilhões de operações por segundo enquanto consome muito menos energia do que os aceleradores eletrônicos líderes. Como os componentes-chave são compactos e fabricáveis em massa, o FAST‑ONN poderia, em última instância, viabilizar pequenos coprocessadores ópticos de baixo consumo dentro de câmeras, drones e outros dispositivos de ponta, permitindo que eles “pensem com luz” e respondam ao mundo quase tão rapidamente quanto ele muda.

Citação: Liang, Y., Wang, J., Xue, K. et al. High-clockrate free-space optical in-memory computing. Light Sci Appl 15, 115 (2026). https://doi.org/10.1038/s41377-026-02206-8

Palavras-chave: redes neurais ópticas, hardware de IA para ponta (edge), matrizes de VCSEL, computação em memória, convolução em alta velocidade