Clear Sky Science · pl

Asystent chirurgiczny RARP: model wizualno-językowy dla robotycznej radykalnej prostatektomii

Inteligentniejsze wsparcie na sali operacyjnej

Nowoczesne zabiegi chirurgii prostaty wykonywane są przy użyciu zaawansowanych robotów i kamer, a mimo to chirurdzy nadal muszą równocześnie podejmować złożone decyzje, reagować na szybko zmieniające się obrazy i odpowiadać na ciągłe pytania stażystów oraz personelu. W artykule przedstawiono sztuczną inteligencję w roli „kopilota”, która może obserwować transmisję wideo z operacji i na miejscu odpowiadać na zadawane ustnie pytania — podobnie jak bardzo dobrze poinformowany asystent. Dla pacjentów oznacza to perspektywę bezpieczniejszych, bardziej spójnych operacji; dla chirurgów to wizja przyszłości, w której eksperckie wsparcie i nauczanie są dostępne w każdej sali operacyjnej.

Cyfrowy asystent, który widzi i rozmawia

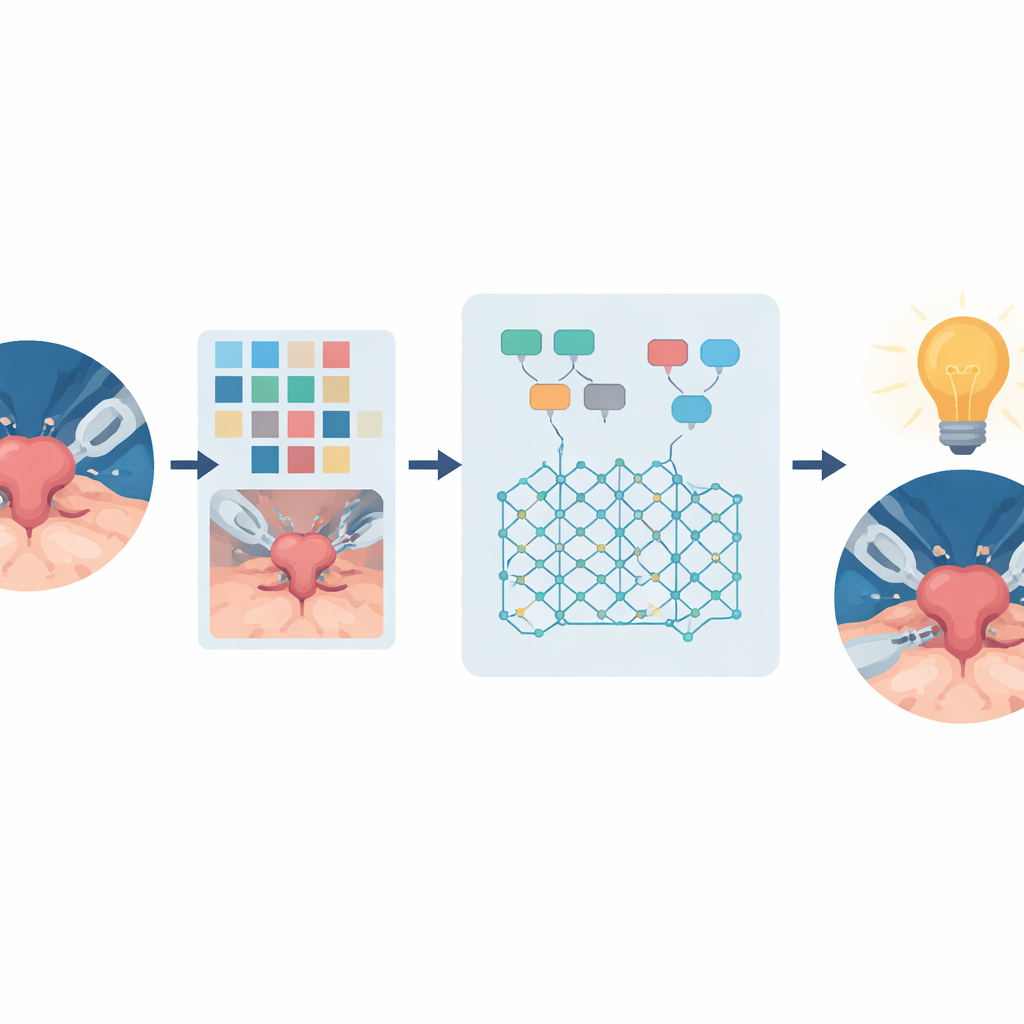

Naukowcy zbudowali Surgical RARP Copilot dla konkretnego zabiegu: robotycznej radykalnej prostatektomii, standardowej operacji u wielu mężczyzn z miejscowo ograniczonym rakiem prostaty. W tym zabiegu system robotyczny sterowany przez chirurga usuwa prostatę przez niewielkie nacięcia, kierując się obrazem z kamery wysokiej rozdzielczości umieszczonej wewnątrz ciała. Tradycyjne systemy AI oparte na czacie przetwarzają tylko tekst, więc nie potrafią interpretować obrazu kamery chirurgicznej. Copilot łączy widzenie komputerowe z dużym modelem językowym, co pozwala mu „widzieć” pole operacyjne i generować odpowiedzi w języku naturalnym na pytania o to, co się dzieje, jakie narzędzia są widoczne lub jakie powinny być kolejne kroki w operacji.

Nauczanie kopilota wiedzy chirurgicznej

Aby wyposażyć Copilota w sensowną wiedzę chirurgiczną, zespół przygotował wyspecjalizowany zbiór treningowy zamiast polegać na ogólnodostępnych obrazach z internetu. Zebrano niemal 20 000 oznakowanych klatek z nagranych operacji prostaty, oznaczając pozycje narzędzi, narządów i aktualny etap procedury. Dodano też przybliżone informacje o głębi, dzięki czemu system mógł wnioskować, które obiekty znajdują się bliżej lub stykać się ze sobą. Przy pomocy reguł zaprojektowanych przez ekspertów etykiety te zostały przekształcone w szczegółowe opisy tekstowe określające, co przedstawia każda klatka i na jakim etapie operacji się znajduje. Duże modele językowe zostały następnie nakłonione, w głosie różnych „person” od doświadczonych chirurgów po ciekawskie dzieci, do wygenerowania ponad miliona par pytań i odpowiedzi opartych na tych opisach. Osobny model sprawdził te pary pod kątem spójności logicznej, a błędne przykłady odfiltrowano przed szkoleniem.

Jak dobrze radzi sobie Copilot

Po treningu Copilot był testowany na kilka sposobów. Na wydzielonym zbiorze syntetycznych par pytań i odpowiedzi dostrojenie poprawiło zdolność modelu do udzielania przynajmniej częściowo poprawnych odpowiedzi z około 61% do 83%, a w pełni poprawnych odpowiedzi z 0% do 59%. Następnie recenzenci ludzie zadali 650 pytań dotyczących nagranych zdjęć chirurgicznych; niemal siedem na dziesięć odpowiedzi oceniono jako w pełni poprawne. System poradził sobie także z klasycznymi zadaniami widzenia komputerowego bez dodatkowego dokształcania: zidentyfikował etap prostatektomii na podstawie pojedynczej klatki wideo z dokładnością 82% oraz rozpoznał narzędzia chirurgiczne z miarą F1 na poziomie 94%, jednocześnie szacując też, ile czasu pozostało do końca operacji. Wyniki te sugerują, że jeden zunifikowany model może dorównać wyspecjalizowanym narzędziom w wielu zadaniach, a jednocześnie prowadzić otwartą konwersację.

Wprowadzenie AI do operacji na żywo

Najbardziej spektakularna demonstracja miała miejsce na rzeczywistej sali operacyjnej. Copilot został uruchomiony na wydajnym komputerze brzegowym podłączonym bezpośrednio do transmisji wideo z robota chirurgicznego. Podczas operacji prostatektomii wykonanej na innej platformie robotycznej niż ta użyta do treningu, publiczność składająca się z chirurgów i inżynierów przesłała 276 pytań za pomocą smartfonów. Po odfiltrowaniu pytań nieistotnych i powtórzeń, eksperci ocenili, że Copilot odpowiedział poprawnie na około 77% pozostałych pytań — porównywalnie z jego wynikami offline. System odpowiadał w około pół sekundy przed rozpoczęciem wypowiedzi i generował tekst na tyle szybko, by wydawać się interaktywny, jednocześnie stosując filtry bezpieczeństwa i zachowawczą postawę w przypadku niepewności.

Co to oznacza dla przyszłej chirurgii

Dla czytelników niebędących specjalistami kluczowy przekaz jest taki, że system AI potrafi teraz obserwować delikatną operację onkologiczną w czasie rzeczywistym i udzielać użytecznych, uwzględniających kontekst odpowiedzi na temat tego, co się dzieje i co powinno się wydarzyć dalej. Chociaż obecny Copilot jest ograniczony do jednego typu zabiegu, opiera się na pojedynczych migawkach zamiast pełnej pamięci wideo i nie ma jeszcze dostępu do pełnych dokumentów medycznych, dowodzi, że multimodalną AI można bezpiecznie wprowadzić na salę operacyjną. W miarę jak podobne systemy będą rozszerzane na kolejne procedury, łączone z bogatszymi danymi pacjentów i rygorystycznie testowane pod kątem wpływu klinicznego, mogą wspierać szkolenie, poprawiać komunikację zespołu i ostatecznie przyczynić się do zwiększenia bezpieczeństwa i przejrzystości złożonych operacji.

Cytowanie: Bogaert, W., Remy, F., Tejero, J.G. et al. Surgical RARP copilot: a vision language model for robot-assisted radical prostatectomy. npj Digit. Surg. 1, 3 (2026). https://doi.org/10.1038/s44484-025-00003-1

Słowa kluczowe: chirurgia robotyczna, rak prostaty, AI chirurgiczna, model wizualno-językowy, wsparcie na sali operacyjnej